ИИ экономит учителю 6 часов в неделю. Но 97% этого не замечают

Опрос Gallup и Walton Family Foundation (2024–2025, репрезентативная выборка учителей США) зафиксировал впечатляющую цифру: преподаватели, регулярно использующие AI, экономят в среднем 5,9 часов в неделю – эквивалент шести полных рабочих недель за учебный год. Звучит как решённая проблема.

Но параллельный опрос Royal Society of Chemistry (2024, Великобритания) показывает другую картину: 44% учителей пробовали AI, но только 3% сообщили о реальном снижении нагрузки. Учитель математики из Ирландии объяснил разрыв точнее, чем любая статистика: «AI генерирует рабочие листы быстро, но их нужно тщательно проверять – и экономия времени оказывается меньше, чем казалось».

Кто прав? Мы уже разбирали кризис AI в образовании со стороны учеников – 86% школьников используют нейросети, но критическое мышление деградирует. Теперь – сторона преподавателей. За последние два года накопилось достаточно экспериментальных данных, чтобы ответить на этот вопрос не мнениями, а цифрами.

Что показали эксперименты

Структурированные задачи: AI работает

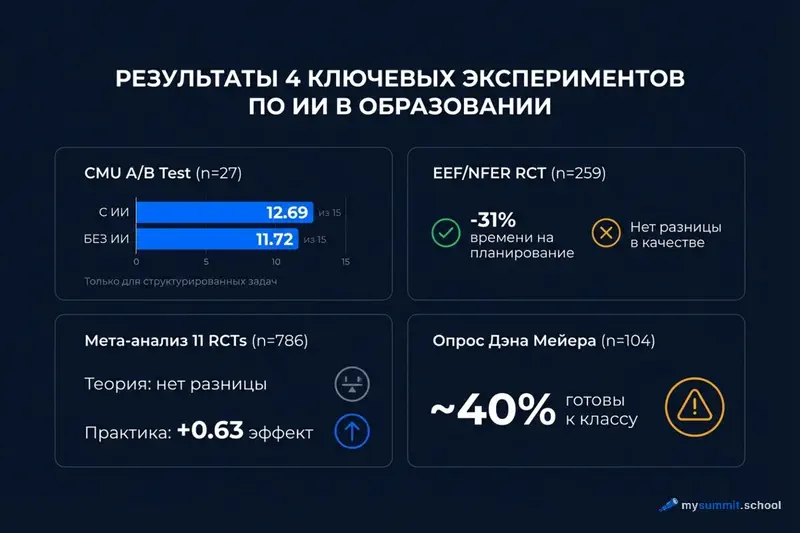

Исследование Carnegie Mellon University (Moore et al., AIED 2025) провело A/B-эксперимент: 27 студентов-магистрантов создавали по 8 микроуроков – четыре с помощью ChatGPT (GPT-4), четыре без. Оценка велась слепым методом по 5-критериальной рубрике (максимум 15 баллов).

Результат: микроуроки с AI набрали 12,69/15 против 11,72/15 без AI. Разница статистически значимая. Но – и это ключевое – эффект проявился только для структурированных задач: универсальный дизайн обучения, направленное открытие, «объясни–отработай». Для задач, требующих творческого подхода или социальной чувствительности – совместное обучение, взаимное обучение – разницы не было.

Аналогичный паттерн зафиксировала Philippa Hardman в исследовании: для «структурированных и широко известных» задач AI дал прирост качества, для нестандартных и социально нюансных – снижение на 19 процентных пунктов.

Вывод из обоих исследований одинаков: AI усиливает то, что уже хорошо формализовано. Там, где нужно оригинальное педагогическое решение, он бесполезен или вреден.

Реальный класс: время экономится, качество – нет

Самое масштабное рандомизированное контролируемое исследование в этой области провел Education Endowment Foundation (EEF) совместно с NFER: 259 учителей в 68 школах Великобритании. Учителя получили ChatGPT и подробное руководство по применению.

Результат по времени: 25,3 минуты экономии в неделю – снижение времени планирования на 31%. Но независимая экспертная панель, оценивавшая качество созданных уроков, не обнаружила заметной разницы между уроками, подготовленными с AI, и контрольной группой.

Это самая неудобная находка во всём корпусе исследований. AI экономит время – но не улучшает то, что учитель производит за это время.

Мета-анализ: практические навыки – да, теория – нет

Мета-анализ 11 рандомизированных контролируемых исследований (PMC, 2025, 786 студентов-медиков) подтвердил закономерность: теоретические знания в группах с AI и без AI не различались. Но практические навыки оказались значимо выше в AI-группе – с заметным размером эффекта.

AI помогает освоить «как делать». Он не помогает понять «почему это работает».

Где AI ломается: три системных проблемы

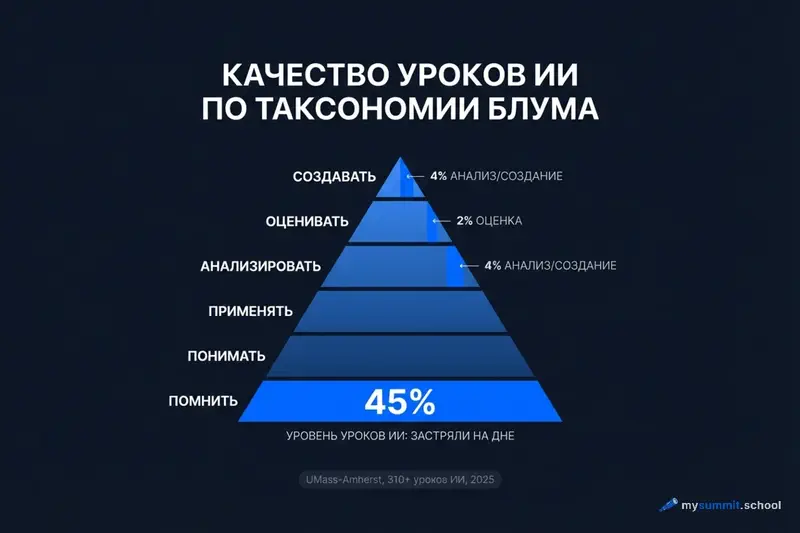

45% уроков застревают на «вспомни»

Исследование UMass-Amherst (2025, 310+ уроков граждановедения, 3 AI-системы) показало масштаб проблемы. Из всех AI-сгенерированных уроков:

- 45% оставались на уровне «вспомни» – низшем по таксономии Блума (иерархия когнитивных задач: от запоминания фактов до анализа, оценки и творческого синтеза)

- Только 4% предлагали анализ или создание

- Только 2% просили учеников оценить информацию

- Лишь 11–16% включали осмысленное использование образовательных технологий

AI производит уроки, которые выглядят структурированными, но по когнитивной глубине – на уровне рабочей тетради 1990-х. Это не недостаток конкретной модели. Это следствие того, как языковые модели обучаются: на массиве текстов, где простые объяснения и проверочные вопросы встречаются в разы чаще, чем задания на критическое мышление.

Отчёт aiEDU и Burning Glass Institute (февраль 2026) проясняет механику этого провала. Авторы проанализировали влияние AI на 1 000 востребованных навыков рынка труда и 140 учебных целей K-12 и разделили все навыки на четыре типа:

- AI-исполнитель (Streamline) – навыки, которые AI выполняет самостоятельно: проверка грамматики, арифметические расчёты, форматирование данных. Ученику важно понять принцип, а не отрабатывать рутину.

- AI-соавтор (Transform) – навыки, где AI и выполняет, и усиливает: написание текстов, анализ данных, исследование. Ученик направляет AI, оценивает результат, итерирует.

- AI-тренер (Deepen) – навыки, которые AI не выполняет, но усиливает: устная речь, стратегическое мышление, концептуальное понимание. AI даёт обратную связь, но выполнение остаётся за учеником.

- Чисто человеческое (Anchor) – навыки, которые AI не может ни выполнить, ни усилить: лидерство, этическое суждение, живая презентация.

AI-уроки по умолчанию застревают в первом типе – «AI-исполнитель». Это зона, где AI сильнее всего и где когнитивная планка ниже всего. Чтобы урок затронул навыки второго и третьего типа – анализ, аргументацию, стратегическое планирование – учитель должен явно направить AI в эту зону через структурированный запрос.

Учителя переоценивают готовность AI-уроков

Опрос Dan Meyer (104 учителя математики, 2024) дал конкретную оценку: AI-материалы готовы к использованию в классе примерно на 40%. Миф о «правиле 80/20» – AI делает 80% работы, учитель дорабатывает 20% – оказался ближе к обратному соотношению. Цитата одного из респондентов: «Мне проще создать слайды с нуля, чем извлекать что-то из того, что выдал AI».

Исследование SUNY Geneseo (студенты педвузов, 2024) подтвердило это с другой стороны: когда будущие учителя получили задание внимательно проанализировать AI-сгенерированные планы уроков, их уверенность в инструменте значимо снизилась. Они нашли несоответствия между целями и заданиями, фактические ошибки, отсутствие опор для учеников с разным уровнем подготовки.

Вывод парадоксален: чем глубже учитель разбирается в AI-уроке, тем хуже он его оценивает. Поверхностная проверка создаёт иллюзию качества.

«Налог на проверку» съедает экономию

Это объясняет разрыв между Gallup (5,9 часов экономии) и RSC UK (3% реально заметили разницу). Учителя, которые сообщают об экономии, часто не учитывают время на проверку и доработку. Те, кто учитывает – видят, что экономия частично или полностью исчезает.

Почему структурированные промпты меняют результат

Исследования показывают, что примерно 50% улучшения качества AI-уроков определяется не моделью, а тем, как сформулирован запрос.

Конкретные данные:

- Структурированные промпты дают на ~60% более точный и релевантный образовательный контент по сравнению с неструктурированными

- Указание уровня по Блуму сместило распределение с 78% вопросов на запоминание к большинству на уровне анализа и применения

- Включение принципа обратного дизайна (от результата – к заданиям) улучшило согласованность целей, заданий и оценки на 40–60%

- Указание критериев оценки снизило объём доработки после генерации на ~35%

Разница между «Создай урок по квадратным уравнениям для 9 класса» и структурированным запросом с указанием уровня по Блуму, формата работы, ожидаемого результата и критериев оценки – это разница между 40%-й и 75%-й готовностью урока.

Данные aiEDU/Burning Glass подтверждают это с другой стороны: разрыв проходит не между предметами, а внутри каждого из них. В одном уроке по русскому языку грамматика – это навык типа «AI-исполнитель» (AI справляется сам), а риторическая аргументация – «AI-соавтор» (AI усиливает, но не заменяет). Учитель, который не различает эти типы навыков в запросе, получает урок, целиком смещённый в зону рутинного исполнения.

Это же объясняет, почему структура промпта имеет значение не только для менеджеров – для преподавателей она критична.

Отдельная линия доказательств: целевые образовательные инструменты (Curipod, MagicSchool AI, Diffit, SchoolAI) показывают значимо более высокую удовлетворённость учителей по сравнению с ChatGPT без настроек. Причина не в модели – а в том, что промпт уже содержит педагогические ограничения: стандарты, возрастной фильтр, шаблон урока. Учителям, использующим ChatGPT напрямую, эти ограничения приходится формулировать самостоятельно. Большинство этого не делает.

Получите кейсы ИИ для вашего урока

Введите предмет и тему – получите готовые сценарии применения ИИ в классе, рабочие промпты и задания, которые ученик не сможет выполнить с помощью нейросети.

Без регистрации · Результат за 30 секунд

Пробел в СНГ: массовое обучение без глубины

Западные данные показывают: AI работает, когда учитель умеет с ним работать. Это заставляет задуматься об отдельном вопросе – что происходит в СНГ? Массовое знакомство с AI уже произошло, но практического применения почти нет.

Россия: знают, но не применяют

Крупнейший российский опрос РАНХиГС зафиксировал: только 16% используют AI для подготовки к занятиям. 33% знают об AI, но никогда не пробовали. 37% «что-то слышали».

При этом 87% студентов активно используют AI. Разрыв «студент знает больше преподавателя» – не западный феномен. В России он острее.

Среди школьных учителей ситуация чуть лучше: 50% пробовали AI, но регулярно используют только 12%. Данные Учи.ру и НИУ ВШЭ показывают, для чего: генерация идей (37%) и создание конспектов (27%). Ни один массовый сценарий не включает работу с контекстом учеников, формативную оценку или адаптацию под конкретный класс – то есть именно те задачи, где AI показал эффективность в экспериментах.

Главный барьер – не мотивация. По данным Фоксфорда, 41% учителей говорят: «Не знаю, как применить практически». Это разрыв между «знаю, что AI существует» и «использую AI во вторник на уроке».

Казахстан: 252 000 сертификатов, ноль данных о практике

Казахстан провёл самую масштабную программу обучения учителей AI в СНГ: 324 000 регистраций, 252 000 завершений через Orleu/UNESCO (2025). Программа обязательная и бесплатная.

Но содержание – общая AI-грамотность по фреймворку UNESCO, а не предметное применение. 252 000 учителей сертифицированы как «AI-грамотные», но ни один публичный отчёт не фиксирует, сколько из них применяют AI в реальных уроках. Сертификат ≠ применение.

Косвенное подтверждение проблемы: в феврале 2026 года несколько казахстанских педагогических университетов объявили о создании факультетов AI для педагогов – что сигнализирует о признании: текущее обучение недостаточно.

Беларусь: маленькая выборка, лучший результат

БГПУ (Беларусь) обучил 97 учителей по углублённой программе AI в преподавании. Результат: 70%+ разработали собственные AI-методики и внедрили их в практику. Это самый высокий показатель конверсии «обучение → практика» среди всех данных по региону.

На общем фоне Беларуси (113-е место из 160 по AI Adaptation Index, 43% населения никогда не пользовались AI, менее 10% учителей используют AI регулярно) результат БГПУ – аномалия. Она подтверждает то, что показывают западные эксперименты: глубина обучения важнее охвата. 97 учителей с реальными навыками дают больше, чем 252 000 сертификатов без практического выхода.

Этот вывод напрямую связан с тем, что исследования показывают «иллюзию глубины» в AI-обучении: массовые программы без практической привязки создают ощущение компетентности, которое не подкреплено навыком.

Практические рекомендации: как использовать AI для подготовки урока

Совокупность исследований даёт конкретную систему координат.

Принцип: AI – первый черновик, не готовый урок

Ни одно исследование не показало, что AI-сгенерированный урок можно использовать без доработки. Данные Dan Meyer (40% готовности), EEF (нет разницы в качестве), UMass (45% на уровне «вспомни») согласованы: AI производит отправную точку, не финальный продукт.

Ценность – в устранении проблемы чистого листа. AI помогает быстро получить структуру, которую можно критически переработать. Это быстрее, чем начинать с нуля – но только если учитель знает, что именно перерабатывать.

Что указывать в запросе при генерации урока

Уровень по Блуму нужно указывать для каждой секции явно – без этого 45% контента застрянет на уровне «вспомни» (данные UMass). Пример: «Введение – понимание, практика – применение/анализ, рефлексия – оценка».

Конкретный результат работы учеников лучше задавать напрямую: не «обсудите в группах», а «ученики создают X, демонстрирующий понимание Y». Это отделяет работающий урок от формального.

Предвосхищение типичных ошибок стоит запрашивать в промпте: «Какие типичные заблуждения встречаются у учеников при изучении этой темы?» Это то, что отличает экспертный план урока от шаблонного – и что AI не делает без прямого запроса.

Обратный дизайн меняет порядок: начните с критериев оценки, затем выведите задания. AI по умолчанию делает наоборот – сначала генерирует активности, потом подгоняет оценку.

«Налог на проверку» нужно закладывать заранее: AI-урок потребует 30–60% времени на проверку фактов, адаптацию под конкретный класс и корректировку когнитивного уровня. Если вы не заложили это время – вы не сэкономили, вы перенесли нагрузку.

Что проверять в AI-уроке

- Соответствие заданий заявленным целям – главная слабость, найденная в исследовании SUNY Geneseo

- Фактическая точность – AI галлюцинирует в 3–9% случаев по общим темам и до 30% по специализированным

- Когнитивный уровень каждого задания – маркируйте по Блуму вручную

- Наличие опор и подсказок для учеников с разным уровнем подготовки

- Связь с предыдущими и последующими уроками (AI обрабатывает каждый урок как изолированный)

AI работает лучше всего для тех, кому он меньше всего нужен

Самый неудобный вывод из семи экспериментов: AI-инструменты для подготовки уроков дают наибольший эффект в руках преподавателей, которые уже хорошо понимают, как выглядит качественный урок. Для них AI – ускоритель: быстрый черновик, который они знают, как переработать.

Для преподавателей без этого фундамента AI создаёт другой риск. SUNY Geneseo показал: без критической проверки AI-уроки выглядят убедительно, но содержат системные слабости. Если учитель не видит этих слабостей – он воспроизводит их в классе.

Это точно тот же механизм, который исследование Anthropic зафиксировало у разработчиков: AI снижает когнитивное трение – и вместе с ним снижает глубину понимания. Для преподавателя, который ещё формирует своё педагогическое мышление, это не ускорение. Это обход.

Данные из СНГ подтверждают: 252 000 казахстанских учителей с сертификатом AI-грамотности не знают, как применить её на уроке. 41% российских учителей говорят то же самое. Проблема не в AI-инструментах. Проблема в разрыве между знанием «AI существует» и навыком «я могу использовать AI для улучшения конкретного урока во вторник».

97 белорусских учителей из программы БГПУ закрыли этот разрыв – и 70% из них создали собственные методики. Разница: не объём обучения, а его глубина и предметная привязка. Я наблюдаю тот же паттерн в разговорах с менеджерами и преподавателями: знать, что AI существует, и уметь его применить во вторник – это разные компетенции с разными путями развития.

Вопрос для каждого преподавателя, читающего этот текст: ваш следующий AI-сгенерированный конспект урока – вы его проверили по Блуму? Или приняли, потому что он выглядит структурированным?

Вы применяете AI – но видите ли скрытые ошибки?

9 диагностических уроков: попробуйте применить AI на реальных задачах – и узнайте, какие ошибки делает большинство. Бесплатно, без регистрации.