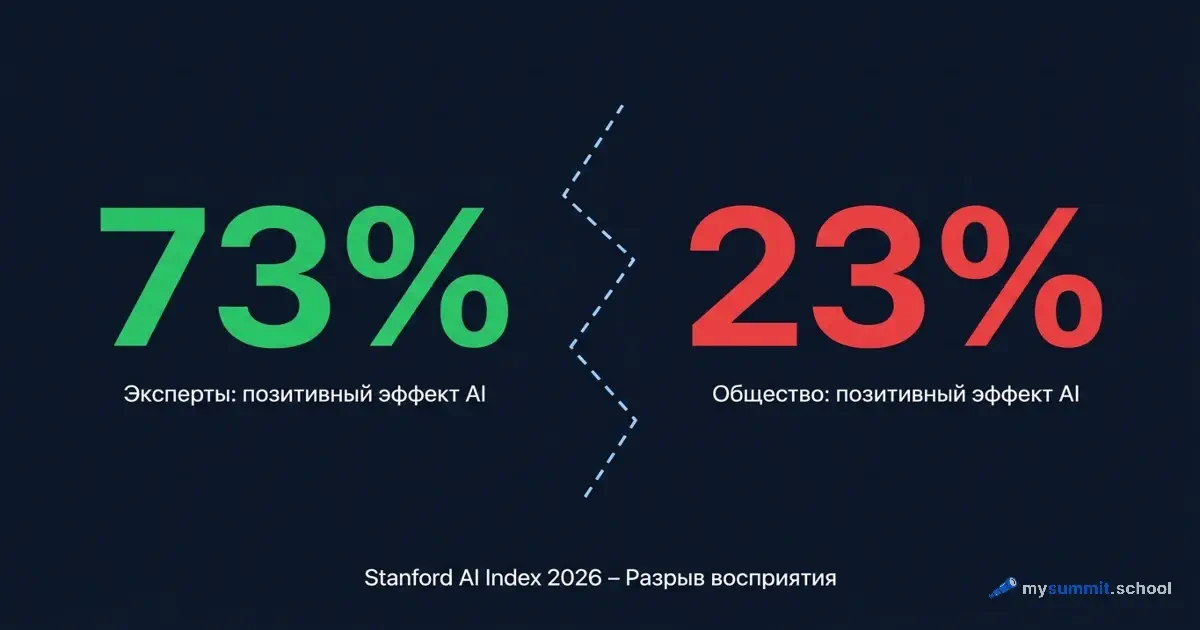

73% экспертов верят в AI – и только 23% обычных людей. Кто прав?

73% исследователей искусственного интеллекта ожидают, что AI окажет позитивное влияние на рынок труда. Среди обычных людей так думают 23%. Пятьдесят процентных пунктов – это не разница во мнениях. Это два параллельных разговора, которые почти не пересекаются.

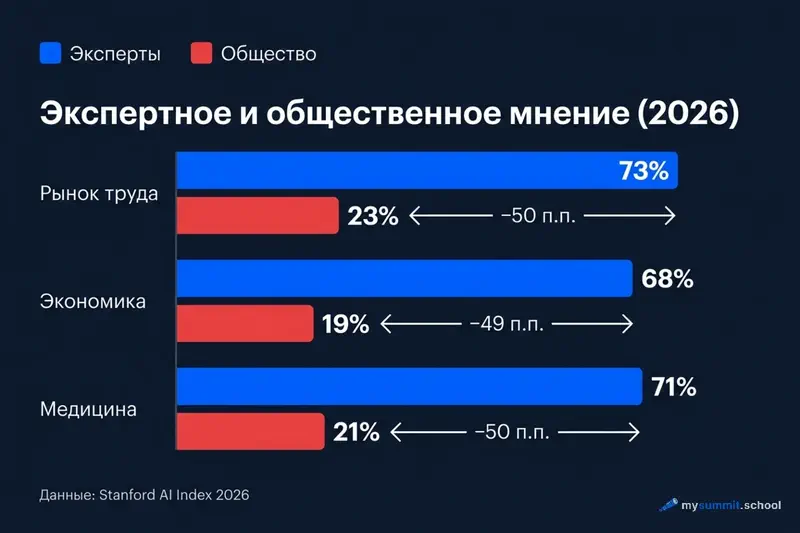

Stanford AI Index 2026 зафиксировал этот разрыв по нескольким направлениям: занятость, экономика, медицина. И везде одна картина – эксперты видят перспективу, общество видит угрозу. Кто-то из них неизбежно ошибается. Но прежде чем выбирать сторону, стоит разобраться, откуда берётся сам разрыв – и почему он растёт.

Это четвёртая статья из серии «Stanford AI Index 2026». В предыдущих мы разбирали парадокс массового внедрения, экономику моделей и неровный фронтир возможностей. Здесь – о том, что происходит, когда технология развивается быстрее, чем общество успевает её осмыслить.

Два мира, одни данные

Начнём с самой цифры. AI Index 2026 приводит результаты опросов, в которых AI-исследователей и широкую публику спрашивают одно и то же: ожидаете ли вы позитивное влияние AI на определённые сферы?

По рынку труда – 73% против 23%. По экономике и медицине разрывы похожие. Это не ситуация «одни чуть оптимистичнее других». Это два непересекающихся множества: большинство экспертов верит в позитивный исход, большинство общества – нет. Причём речь не о маргинальных группах – это мейнстримные позиции в обеих выборках.

Можно, конечно, списать это на то, что «эксперты знают больше». Но это ленивый ответ. Эксперты знают больше о технических возможностях моделей – это правда. Но они далеко не всегда знают больше о том, как технология проникает в реальные рабочие процессы, как меняется рынок труда за пределами Кремниевой долины, и как выглядит внедрение AI в компании на 50 человек в Новосибирске или Дижоне. У экспертного оптимизма есть своя слепая зона – и она не меньше, чем у общественного скепсиса.

Почему эксперты оптимистичны

Для начала – отдадим экспертам должное. Их оптимизм не на пустом месте.

Данные о производительности устойчивы и воспроизводимы: рост от 14% до 26% в зависимости от сектора. Стоимость инференса продолжает падать – мы разбирали экономику моделей в отдельном материале серии, и там динамика впечатляет. Возможности моделей растут быстрее, чем успевают обновляться бенчмарки – хотя, как мы показали в статье о бенчмарках, рост на тестах и рост полезности – не одно и то же.

Эксперты видят вещи, которые ещё не дошли до массового пользователя. Они работают с моделями, которые появятся на рынке через полгода-год. Они видят, как agent-based системы начинают решать задачи, которые год назад считались невозможными. Они видят, как стоимость создания прототипа падает с недель до часов. С этой точки зрения, конечно, трудно не быть оптимистом.

Но вот что важно: эксперты оптимистичны по поводу возможностей технологии. А общество отвечает на вопрос о последствиях технологии – для себя, своей работы, своих детей. Это разные вопросы, даже когда формулировка анкеты одинаковая.

Сократить разрыв между возможностями и реальным использованием можно – но для этого нужен навык, а не вера.

Разрыв между тем, что AI может, и тем, что с ним делают – это вопрос навыка. Попробуйте 9 реальных задач менеджера бесплатно – без регистрации.

Доступ сразу после регистрации

Почему общество скептично

У общественного скепсиса тоже есть основания – и они не сводятся к «люди не разбираются в технологиях».

Во-первых, инциденты. AI Index фиксирует 362 AI-инцидента за год – deepfakes, ошибки автоматизации, утечки данных, некорректные решения алгоритмов. Это не абстрактные риски из научных статей – это истории, которые попадают в новости. Человек, который прочитал про AI-сгенерированный фейк с политиком или ошибочно отклонённую страховую заявку, имеет все основания для осторожности.

Во-вторых, рынок труда. Мы разбирали данные о junior-позициях в первой статье серии: занятость среди американских разработчиков 22–25 лет снизилась почти на 20% с 2024 года. Для выпускника, который видит сокращение позиций в своей области, 73% экспертного оптимизма выглядят не убедительно, а оторванно от реальности.

В-третьих – и это, пожалуй, самое интересное – доверие к регуляторам. AI Index 2026 показывает, что общество не доверяет тем, кто должен защищать его интересы. США продемонстрировали самый низкий уровень доверия населения к своему правительству в вопросах регулирования AI – 31%. Страна, которая производит подавляющую долю AI-инструментов, меньше всех доверяет собственным властям в вопросе их контроля.

Это не паранойя. Это рациональная реакция на ситуацию, в которой технология развивается быстрее институтов. Когда правительство одновременно субсидирует AI-индустрию и обещает её регулировать, скепсис закономерен. Особенно если правительство при этом разворачивается от регулирования к дерегулированию, как произошло в США в 2025 году.

Евросоюзу доверяют больше – и глобально, и внутри. Но и здесь доверие далеко от безусловного.

Образование не успевает

Есть область, где разрыв между реальностью и институциональной реакцией виден особенно отчётливо. Это образование.

Цифры AI Index 2026 складываются в узнаваемый паттерн: более 80% американских студентов используют AI для учебных задач. Половина школ имеет хоть какую-то AI-политику. И всего 6% учителей говорят, что эта политика им понятна.

Перечитайте ещё раз. 80% – 50% – 6%. Студенты массово используют инструмент, для которого у половины школ нет правил, а там, где правила есть, их понимает один учитель из шестнадцати.

И ещё одна цифра, которая замыкает картину: по данным AI Index 2025, 80% знаний о генеративном AI люди получают за пределами формального образования. Из YouTube, подкастов, рабочих чатов, проб и ошибок – откуда угодно, кроме системного обучения. Формальное образование не просто отстаёт – оно почти не участвует.

При этом навыки в области AI-инжиниринга растут быстрее всего в ОАЭ, Чили и Южной Африке. Число AI-аспирантов в США и Канаде выросло на 22% за два года (2022–2024) – но прирост ушёл в индустрию, не в академию. Университеты готовят специалистов, которые немедленно уходят в корпорации. Те, кто мог бы учить следующее поколение, этого не делают – потому что Google и OpenAI платят в три раза больше.

Вклад open-source сообщества из развивающихся стран уже обгоняет Европу и приближается к уровню США. Знание распределяется не через институции, а через сети – и это одновременно воодушевляет и тревожит.

Вопрос не в том, учиться ли – а в том, где и как.

80% знаний об AI – из неформального образования. Курс MySummit.school: 9 реальных задач менеджера, результат с первого урока. Бесплатно, без регистрации.

Доступ сразу после регистрации

Регулирование: одна технология, десять подходов

Если образование отстаёт, то регулирование – фрагментировано. И AI Index 2026 документирует это с хирургической точностью.

С одной стороны – EU AI Act, первый в мире комплексный закон об AI, чьи первые запреты вступили в силу в 2025 году. С другой – США, которые в том же 2025 году развернулись от регулирования к дерегулированию. Между ними – Япония, Южная Корея и Италия, каждая с собственным национальным законом. И множество развивающихся стран, принимающих национальные AI-стратегии.

Идея ‘AI-суверенитета’ становится центральным организующим принципом. Каждая страна хочет контролировать свою AI-инфраструктуру, свои данные, свои модели. Это логично с точки зрения национальной безопасности. Но это создаёт лоскутное одеяло из правил, которое для международного бизнеса выглядит примерно так: то, что разрешено в Дубае, запрещено в Брюсселе, неопределено в Вашингтоне и регулируется особым порядком в Токио.

Для менеджера, который работает с распределённой командой или международными клиентами, это практическая проблема. Какой AI-инструмент можно использовать для обработки данных европейских клиентов? Можно ли отправлять содержимое рабочих документов через американский API? Ответы зависят от юрисдикции, типа данных и – всё чаще – от конкретной модели.

Фрагментация регулирования усиливает разрыв в восприятии. Когда правила нечёткие, а подходы правительств противоречат друг другу, общество не получает внятного сигнала: «это безопасно, мы контролируем ситуацию». Вместо этого – шум, в котором каждый слышит подтверждение своих опасений.

Кто прав?

Итак. Эксперты видят падение стоимости, рост возможностей, устойчивые данные о производительности – и говорят: будет хорошо. Общество видит 362 инцидента, сокращение junior-позиций, правительства, которым не доверяет, и школы, которые не справляются – и говорит: мы не уверены.

Кто ближе к истине?

Я думаю, что оба – и ни один из них.

Эксперты правы в том, что технология работает и будет работать лучше. Возможности моделей растут. Стоимость падает. Продуктивность увеличивается – мы это видим на реальных данных, а не в маркетинговых обещаниях.

Общество право в том, что «технология работает» не означает «всё будет хорошо». Технология может работать и при этом ухудшать ситуацию для конкретных групп. Может повышать среднюю продуктивность и при этом увеличивать неравенство. Может создавать ценность и при этом разрушать институты, которые ещё не адаптировались.

Но настоящая проблема – не в том, кто прав. Настоящая проблема – в том, что разрыв между экспертным и общественным восприятием означает разрыв в знаниях. Эксперты оптимистичны потому, что знают, как работать с технологией. Общество скептично потому, что не знает. И этот разрыв не закроется сам – потому что формальное образование, как мы видели, почти не участвует.

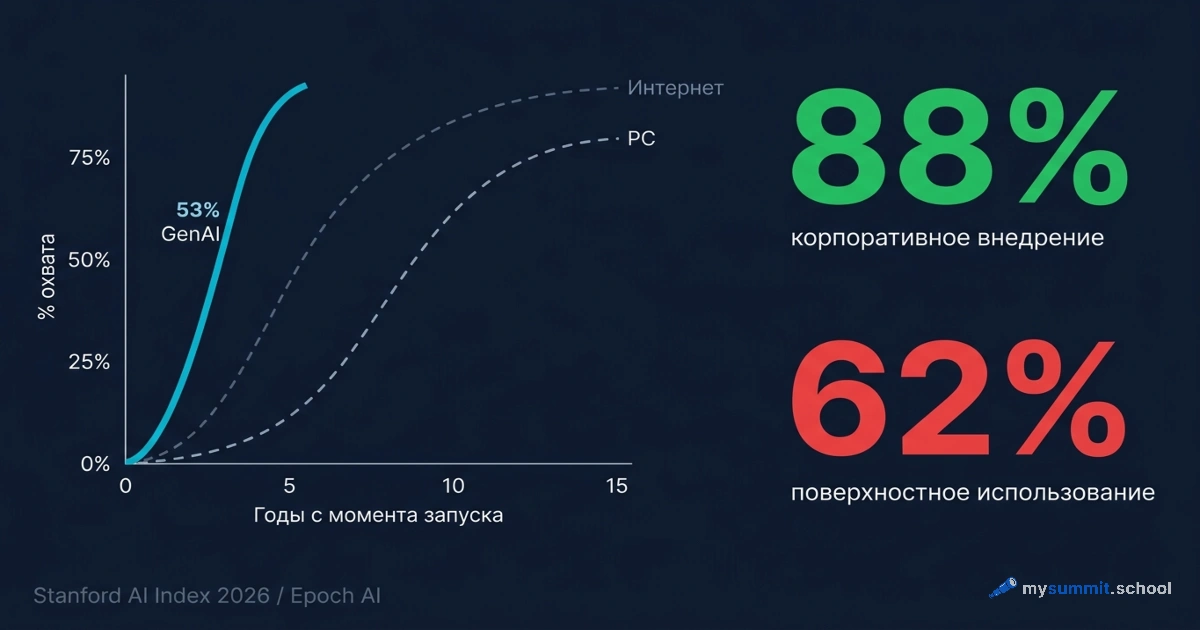

Мы подробно разбирали тот же разрыв на данных Epoch AI: 62% используют AI поверхностно не потому, что инструменты плохие, а потому, что никто не показал, как использовать их глубоко. 80% знаний о GenAI приходит из неформальных источников. Школы не справляются. Университеты теряют кадры. Регуляторы фрагментированы.

В этой ситуации 50-процентный разрыв восприятия – не загадка. Это предсказуемый результат. Когда технология развивается быстрее институтов, те, кто внутри, видят возможности, а те, кто снаружи – угрозу. И единственный способ сократить разрыв – не убеждать скептиков в том, что «всё будет хорошо», а дать им навыки, которые превратят угрозу в инструмент.

Серия «Stanford AI Index 2026»

Это четвёртая статья основной серии. За четыре материала мы прошли от парадокса массового внедрения через экономику моделей и неровный фронтир возможностей к разрыву восприятия. Сквозной сюжет оказался одним и тем же: технология работает, но между «работает» и «приносит пользу конкретному человеку» – дистанция, которая определяется не бюджетом и не доступом, а навыком.

Внедрение AI достигло 88% организаций – но большинство пользователей застряли на поверхностном уровне. Знания об AI на 80% приходят извне формального образования, а разрыв в восприятии между экспертами и обществом остаётся на уровне 50 процентных пунктов.

В дополнительном выпуске серии мы подробно разбираем образовательный разрыв: почему 80% студентов уже используют AI, но формальное образование отстаёт на годы – и что с этим делать менеджеру.

Разрыв не закроется сам. Но для тех, кто готов его закрывать, окно открыто – и конкуренция за него пока удивительно невелика.

Разрыв – это возможность

Stanford AI Index показывает: 80% знаний об AI приходит не из университетов. Курс MySummit.school построен для менеджеров, которые хотят перейти из 62% поверхностных пользователей в число тех, кто применяет AI системно. От реальных задач – к измеримому результату.

Stanislav Belyaev

Engineering Leader в Microsoft18 лет в управлении инженерными командами. Основатель mysummit.school. 700+ выпускников в Яндекс Практикуме и Стратоплане.