AI не делает вас тупее. Дело в том, как вы его используете

Полтора года назад я написал заметку в личном блоге о том, что замечаю в работе коллег и в своей собственной: чем больше доверяешь AI, тем реже задаёшь себе вопрос «а это точно правильно?». Я тогда опирался на исследование Microsoft – оно показывало, что доверие к AI подавляет критическую оценку выдаваемых ответов. Аргумент казался мне сильным, но у него был очевидный изъян: корреляция, а не причинно-следственная связь.

В феврале 2026 года исследователи Anthropic Джуди Шэнь и Алекс Тамкин опубликовали эксперимент, который закрыл этот пробел. Рандомизированный контроль. Конкретные данные. И вывод, который, как мне кажется, неправильно понимают большинство людей, кто о нём читал.

Потому что это не история о том, что AI делает нас глупее. Это история о том, как именно мы его используем.

Что произошло в эксперименте

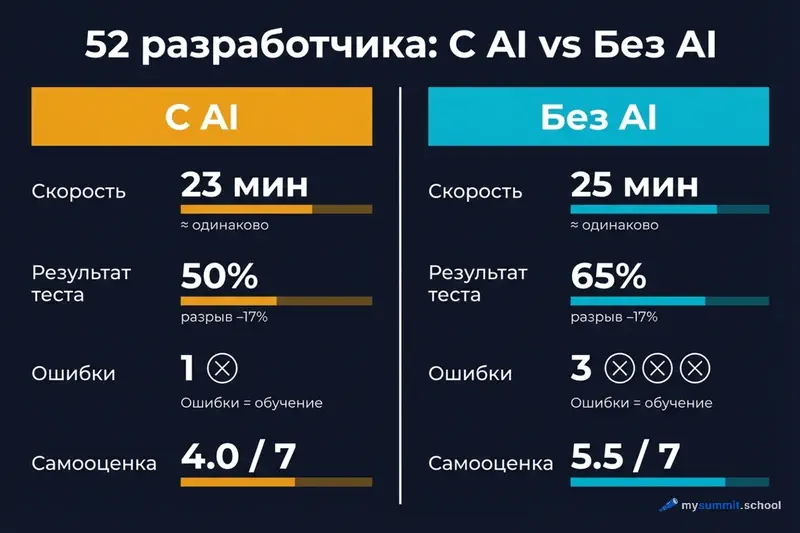

52 разработчика получили задание: научиться работать с новой для них Python-библиотекой для асинхронного программирования Trio. 26 человек работали с AI-ассистентом, 26 – без него. После завершения задачи все написали тест на понимание материала.

Результат группы с AI оказался на 17% хуже. Разрыв статистически значимый и по меркам поведенческих исследований – ощутимый.

Но вот что интересно: скорость выполнения задания у обеих групп была практически одинаковой. AI не помог работать быстрее. Зато помог меньше понять.

Исследователи также зафиксировали любопытную деталь: некоторые участники тратили до 11 минут только на то, чтобы сформулировать один запрос к AI. Транзакционные издержки работы с AI оказались сопоставимы со временем самостоятельного поиска решения.

И ещё один факт, который объясняет, почему группа без AI справилась лучше: они столкнулись с медианой 3 ошибки на участника, тогда как группа с AI – с медианой 1. Это кажется преимуществом. На самом деле это недостаток: именно встреча с ошибкой заставляет разбираться, что происходит.

Участники из группы с AI сами это признали. В рефлексии по окончании они писали, что чувствовали себя «ленивыми» и сожалели, что не вникали в детали. AI снижал когнитивное трение – и вместе с ним снижал глубину усвоения.

Аналогичный паттерн зафиксирован в образовании: исследование показало, что 86% школьников, использующих AI, демонстрируют деградацию критического мышления – именно потому что перестали встречаться с трудностями.

Шесть паттернов – и почему это важнее, чем «использовать или нет»

Здесь начинается самое интересное. Исследователи не остановились на сравнении групп. Они изучили, как именно участники взаимодействовали с AI, и выделили шесть устойчивых паттернов.

Три паттерна показали низкие результаты на тесте (24–39% правильных ответов). Три – высокие (65–86%).

Разница не в том, использовал ли человек AI. Разница в том, оставался ли он думающим агентом в процессе.

Паттерны с низкими результатами

AI Delegation – полное делегирование. Участник просто просил AI написать код и принимал результат без изучения. Средний балл: около 24%.

Типичный запрос выглядел так:

Напиши функцию для асинхронного чтения файлов с использованием библиотеки Trio.

Код работал. Понимания не было. При встрече с любым отклонением от шаблона участник снова шёл к AI.

Progressive AI Reliance – нарастающая зависимость. Начинали самостоятельно, но постепенно делегировали всё больше, пока не отдавали AI целиком. Средний балл: около 28%.

Типичная прогрессия:

Как работает nursery в Trio? ... (несколько итераций) ... Просто напиши мне рабочий пример с nursery для моей задачи.

Ключевой момент: переход от вопросов к «напиши за меня» происходил незаметно, как только появлялась первая трудность.

Iterative AI Debugging – отладка через AI без понимания причин. Участник запускал код, получал ошибку, отправлял её в AI и применял предложенное исправление. Цикл повторялся. Средний балл: около 39%.

Получаю ошибку: TaskGroup is not a function. Как исправить?

Код в итоге работал. Но почему – участник так и не понял.

Паттерны с высокими результатами

Generation-Then-Comprehension – генерация с последующим изучением. AI пишет код, но участник затем разбирает его построчно, задавая уточняющие вопросы. Средний балл: около 86%.

Напиши функцию для параллельного выполнения задач с Trio nursery. После этого объясни мне: - Почему используется именно async with, а не просто with? - Что происходит, если одна из задач внутри nursery выбросит исключение? - Как это отличается от стандартного asyncio?

Разница радикальная. AI становится не заменой мышления, а его инструментом.

Hybrid Code-Explanation – одновременный запрос кода и объяснения. Участник с самого начала просил не просто решение, а понимание. Средний балл: около 75%.

Покажи пример использования trio.open_nursery() и объясни одновременно: 1. Что делает каждая строка 2. Какие ключевые концепции я должен понять, чтобы уметь это применять самостоятельно 3. Какие типичные ошибки делают при первом использовании

Conceptual Inquiry – концептуальные вопросы, самостоятельная реализация. Участник использовал AI только для понимания принципов, а код писал сам. Средний балл: около 65%.

Объясни концепцию structured concurrency в Trio. Не показывай код – только идею. Почему это лучше, чем просто запускать coroutines напрямую?

После такого объяснения участник реализовывал решение сам, сталкивался с ошибками – и разбирался в них. Именно так, как делала контрольная группа.

Что это значит для менеджера

Здесь важно не совершить ошибку интерпретации. Исследование проводилось на разработчиках, изучающих технический инструмент. Но механизм универсален – и, возможно, для менеджеров он даже более значим.

Разработчик может проверить: код либо работает, либо нет. У менеджера такой немедленной обратной связи нет. Письмо, которое написал AI, выглядит убедительно. Анализ рисков – структурированно. Резюме встречи – связно. Проверить, насколько это точно отражает реальность и насколько соответствует вашим управленческим интуициям, значительно сложнее.

Это означает, что деградация навыков у менеджера может происходить тише и дольше оставаться незамеченной.

Посмотрите на типичные управленческие задачи через призму шести паттернов.

Возьмём итоги встречи. Паттерн делегирования выглядит так:

Вот транскрипт встречи. Напиши summary с ключевыми решениями и следующими шагами.

Паттерн с высоким результатом выглядит иначе:

Вот транскрипт встречи. Выдели три момента, где участники, кажется, говорили об одном, но имели в виду разное. Объясни, почему ты так решил.

Во втором случае AI становится инструментом для развития вашего восприятия, а не его замены.

Или подготовка к переговорам. Делегирующий запрос:

Подготовь аргументы для переговоров о бюджете на следующий квартал.

Концептуальный запрос выглядит иначе:

Какие психологические механизмы влияют на то, как люди воспринимают бюджетные запросы? Не давай мне аргументы – объясни, что происходит в голове у человека, который их слушает.

Разница не в эффективности на конкретной встрече. Разница в том, что вы накапливаете за месяцы работы.

Это прямо связано с тем, что исследователи называют Disempowerment – постепенной заменой собственного суждения алгоритмическим. Не драматичной и не заметной в моменте. Просто тихим сдвигом от «я решил» к «AI подсказал».

40 уроков по AI для менеджеров – включая модуль о безопасном использовании AI без потери навыков

Без платёжных данных • Доступ сразу после регистрации

Три вопроса как практический инструмент

Исследование предлагает не запрет на AI, а изменение паттерна. Прежде чем отправить запрос, стоит задать себе три вопроса.

Первый: понимаю ли я, почему AI дал именно этот ответ? Не «работает ли это», а «понимаю ли я логику». Если нет – это сигнал к уточняющему запросу, а не к принятию ответа.

Второй: если AI ошибается здесь – я это замечу? Как показывает исследование Workday, 37% времени, сэкономленного с AI, уходит на исправление его ошибок. Это возможно только если у вас есть компетенция для их обнаружения. Если паттерн делегирования подавил эту компетенцию – вы не сэкономите ничего.

Третий: через месяц я смогу сделать это без AI? Это не вопрос об отказе от инструмента. Это вопрос о том, формируется ли навык или только видимость его наличия. Как показывает исследование MIT об управлении, реальная сила специалиста – в способности критически оценить варианты, а не в наличии инструмента, который их генерирует.

Если на все три вопроса ответ «нет» – это не повод отказаться от AI. Это повод переключиться на другой паттерн.

Парадокс, который стоит удержать в голове

Полтора года назад я предположил, что доступность AI снижает стандарты оценки выдаваемых результатов. Теперь у этого предположения есть экспериментальное подтверждение – и оно точнее, чем я думал.

Дело не в том, что AI делает нас хуже. Дело в том, что AI убирает трение – а трение было частью процесса обучения. Контрольная группа встречала в три раза больше ошибок. И именно это заставляло их понимать.

Это важно и в контексте более широкого тренда: AI не столько освобождает время, сколько уплотняет рабочую нагрузку, снижая видимые барьеры и увеличивая темп. Глубина понимания при этом может тихо убывать.

Исследование зафиксировало: высокоскорящие участники не избегали AI – они использовали его для того, чтобы лучше понять, а не чтобы не думать. Разница в намерении, не в инструменте.

Вопрос, который я оставляю без ответа: какой навык вы хотите сохранить в себе через год – и как именно вы сейчас с этим работаете с AI?

Работаете с AI, но не уверены, что делаете это правильно?

40 бесплатных уроков по AI для менеджеров: паттерны безопасного использования, детекция галлюцинаций, практические сценарии – без регистрации и оплаты.