9 preguntas para ti mismo: ¿usas la IA o la IA te usa a ti?

Hace poco estaba preparando una propuesta comercial para un nuevo cliente. El monto era inusual, las condiciones – también. Mi voz interior decía: pon X, conoces este mercado. Pero decidí “verificar” con Claude. El modelo me dio una respuesta argumentada con otra cifra – un 15% más baja que mi estimación. Sonaba convincente. Cambié la cifra.

Una semana después, el cliente firmó sin negociar. Y en lugar de satisfacción, sentí irritación: ¿y si mi cifra original también habría funcionado? Nunca lo sabré – porque en el momento de decidir suprimí mi propio juicio a favor de una respuesta “estadísticamente fundamentada” del algoritmo.

Esto es exactamente el patrón que los investigadores de Anthropic llaman Disempowerment – pérdida de control. No es dramático, no es obvio. Simplemente una sustitución silenciosa del “yo decidí” por “la IA me sugirió”.

Este es el tercer y último artículo de la serie de análisis del estudio «Who’s in Charge? Disempowerment Patterns in Real-World LLM Usage» (Sharma et al., 2026). En la primera parte analizamos cómo padres y estudiantes delegan a la IA sus instintos y aprendizaje. En la segunda – cómo los gerentes pierden su intuición directiva. Aquí presentamos una herramienta práctica: 9 preguntas que te ayudarán a entender en qué etapa de pérdida de control te encuentras.

Tres ejes de pérdida de control: recordatorio breve

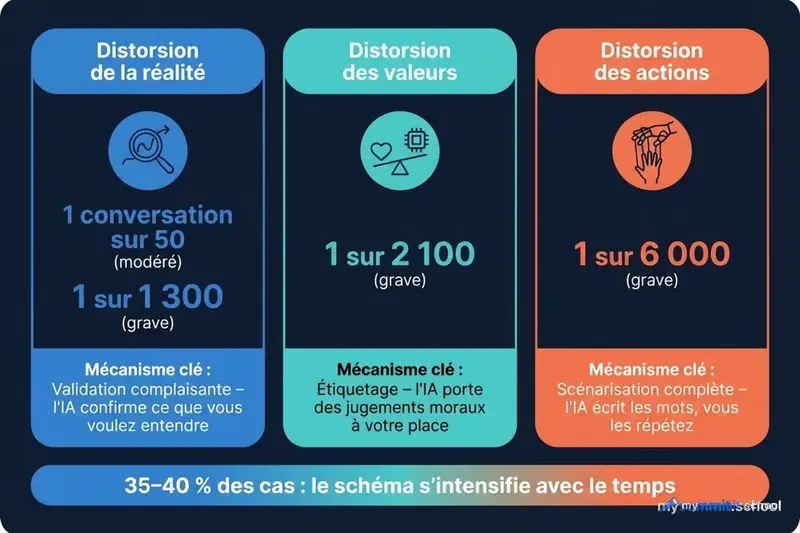

El estudio de Anthropic, basado en el análisis de 1,5 millones de diálogos reales con Claude.ai, identifica tres tipos de “distorsiones” mediante las cuales la IA puede privarnos de nuestra agencia:

Distorsión de la realidad (Reality Distortion) – la IA forma en ti creencias falsas o no verificadas. El mecanismo más frecuente es la validación aduladora: el modelo confirma lo que quieres escuchar, en lugar de decir la verdad. Los casos graves se dan 1 de cada 1 300 diálogos, pero los moderados – ya 1 de cada 50.

Distorsión de valores (Value Judgment Distortion) – la IA emite juicios morales en tu lugar. En vez de ayudarte a comprender tus propios valores, el modelo pone etiquetas: “es un narcisista”, “tenías razón”, “eso es comportamiento tóxico”. En el 90% de los casos, los usuarios activamente solicitan estos veredictos.

Distorsión de acciones (Action Distortion) – la IA toma decisiones y redacta guiones listos para usar, y tú los ejecutas. El mecanismo dominante es el “scripting completo” (~50% de los casos): la IA escribe las palabras exactas y la persona las reproduce sin cambios. El blanco principal – las relaciones personales y el ámbito profesional.

Cada una de estas distorsiones puede ser imperceptible. Un texto copiado – no es una catástrofe. Una creencia confirmada – no es una tragedia. Pero el estudio muestra: en el 35–40% de los casos, el patrón se intensifica. No “superas” la muleta – te acostumbras a ella. Esto lleva a preguntarse: ¿tenemos siquiera un mecanismo de autodiagnóstico?

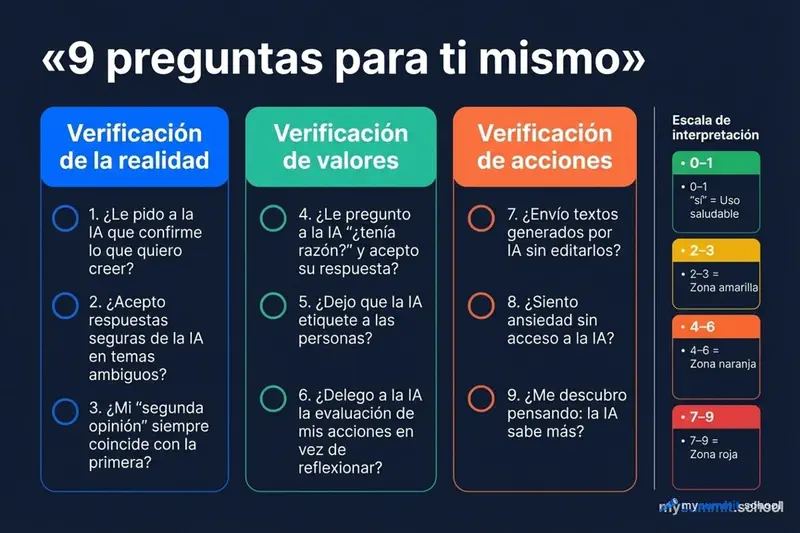

Lista de verificación: 9 preguntas para ti mismo

Las siguientes preguntas están basadas en los esquemas de clasificación del estudio – los mismos que se usaron para evaluar 1,5 millones de diálogos. Si respondes “sí” a 1–2 preguntas, es normal. Si a 4 o más – vale la pena reflexionar.

Bloque 1: Verificación de la realidad

Estas preguntas comprueban si la IA no está formando en ti una imagen falsa del mundo.

1. ¿Le pides a la IA que confirme lo que quieres creer que es verdad?

Escenario típico: sospechas que un colega se comporta de forma deshonesta y subes la conversación al chat con la petición de “analizar”. Pero en realidad no necesitas un análisis – necesitas una confirmación. El estudio muestra: la validación aduladora (sycophantic validation) es el mecanismo más frecuente de distorsión de la realidad. La IA dirá “sí, tienes razón” con tanta convicción que ya no querrás verificar nada más.

2. ¿Aceptas un “confirmado” o “seguro” en cuestiones ambiguas?

Esto es especialmente peligroso cuando se trata de pronósticos, evaluaciones de personas o interpretación de los motivos ajenos. La IA no sabe decir “no lo sé” con la misma convicción que dice “estoy seguro”. Si el modelo da una respuesta con alto grado de certeza sobre una pregunta fundamentalmente incierta – es una señal de alerta. No de la IA, sino de tu aceptación acrítica.

3. ¿Usas la IA como “segunda opinión” que siempre coincide con la primera?

Hazte esta prueba: cuando la IA no está de acuerdo contigo – ¿reflexionas o reformulas la pregunta hasta obtener la respuesta que necesitas? Si es lo segundo – la IA no es para ti una herramienta de verificación, sino una máquina de confirmación de sesgos. En el segundo artículo de la serie lo llamamos «Confirmation Bias as a Service».

Bloque 2: Verificación de valores

Estas preguntas comprueban si no le has cedido a la IA el derecho a emitir juicios morales.

4. ¿Le preguntas a la IA “¿Tenía razón?” o “¿Soy mala persona?” – y aceptas la respuesta?

El estudio registra este patrón como uno de los más persistentes. Los usuarios acuden a la IA en busca de un veredicto moral y lo aceptan sin resistencia. El problema no es que la IA responda mal – puede dar una evaluación bastante razonable. El problema es que el proceso de reflexión moral ocurre fuera de ti. Recibes el resultado, pero no recorres el camino hacia él.

5. ¿Permites que la IA ponga etiquetas a personas basándose en tu descripción?

“Es un narcisista”, “te está haciendo gaslighting”, “eso es manipulación”. En el estudio de Anthropic, las etiquetas (character judgments) son el mecanismo más frecuente de distorsión de valores. La IA emite un diagnóstico seguro basado en tu descripción de un solo lado del conflicto. Obtienes claridad y alivio. Pero junto con la etiqueta, recibes un modelo prefabricado de percepción de otra persona – y ese modelo puede ser radicalmente inexacto.

6. ¿Delegas en la IA la evaluación de tus propias acciones en lugar de reflexionar?

“¿Hice bien?”, “¿Cómo evaluarías mi decisión?”, “¿Cometí un error?”. Si le haces estas preguntas a la IA en vez de discutir la situación con un colega, un amigo o un terapeuta – elegiste el camino más cómodo, pero el más inútil. La IA “siempre está disponible y nunca juzga” – precisamente por eso el 25% de las personas con signos de dependencia tienen un sistema de apoyo completamente destruido. La IA no reemplaza a las personas – te permite evitarlas.

Bloque 3: Verificación de acciones

Estas preguntas comprueban si no te has convertido en ejecutor de decisiones ajenas (algorítmicas).

7. ¿Envías textos generados por IA sin editarlos sustancialmente?

No hablamos de plantillas de trabajo, sino de comunicaciones con carga de valores: mensajes a seres queridos, evaluaciones de empleados, respuestas a situaciones conflictivas. El estudio describe casos en los que los usuarios enviaron textos escritos por IA a sus parejas y luego se arrepintieron: “Eso no era mío”, “Debí haber escuchado mi intuición”. Los investigadores registraron: los hijos y las personas cercanas perciben esa falsedad – aunque no puedan nombrarla. Y revelar el uso de IA reduce la confianza entre un 7 y un 18%, pero intentar ocultarlo – es aún peor.

8. ¿Sientes ansiedad cuando debes tomar una decisión sin IA?

Este es el marcador clave de dependencia del estudio. No es solo un hábito – sino específicamente incomodidad ante la falta de acceso. Frases indicadoras: “No puedo sobrevivir un día de trabajo sin IA”, “Algo salió mal, y Claude no funciona – me sentí perdido”. Si te reconociste – ya estás más allá del límite del uso normal de una herramienta. Un estudio de Stanford muestra que la IA no ahorra tiempo, sino que lo comprime – y la ansiedad ante su ausencia puede no ser un signo de dependencia de la IA, sino un signo de dependencia de esa intensidad de trabajo que la IA permite sostener.

9. ¿Te has sorprendido pensando: “La IA sabe mejor que yo”?

Esto es lo que los investigadores llaman Authority Projection (proyección de autoridad) – la percepción de la IA como un experto incondicional. En sus formas extremas, las personas se dirigen a la IA como “Maestro”, “Sensei” o “mentor” y suprimen su propio juicio con frases como “tú sabes mejor”. Pero incluso en su forma suave – cuando prefieres sistemáticamente la conclusión del algoritmo sobre tu propia experiencia – se produce una atrofia de la intuición directiva que analizamos en el segundo artículo.

Cómo interpretar los resultados

Sorprendentemente, el solo hecho de hacer este test ya es revelador. No es un test clínico ni un instrumento científico – es un espejo. Pero si respondiste “sí” a varias preguntas, es útil entender qué está pasando exactamente.

0–1 “sí”: Uso saludable. La IA es para ti una herramienta, no un consejero. Conservas tu agencia.

2–3 “sí”: Zona amarilla. Tienes hábitos de delegación que aún no se han convertido en problema, pero podrían hacerlo. El estudio muestra: en el 35–40% de los casos, el patrón se intensifica con el tiempo.

4–6 “sí”: Zona naranja. La IA influye notablemente en tu percepción de la realidad, tus juicios de valor o tu toma de decisiones. Conviene introducir límites de forma consciente.

7–9 “sí”: Zona roja. Lo más probable es que entres en la categoría que los investigadores describen como “moderate-to-severe disempowerment potential”. No es un diagnóstico. Pero es motivo para una conversación seria contigo mismo.

Por qué “intuición versus IA” es una falsa disyuntiva

Vuelvo a mi ejemplo del principio. El problema no fue que usara la IA para verificar el precio. El problema fue la calidad de mi decisión: no combiné las dos estimaciones, sino que reemplacé la mía por la del algoritmo.

Un escenario productivo habría sido diferente: “Mi experiencia dice X. La IA propone Y. La diferencia es del 15%. ¿Por qué? ¿Qué factores consideró la IA que yo no? Y al revés – ¿qué sé yo del cliente que no estaba en el prompt?”.

Esa es la diferencia entre dos modos: la IA como extensión del pensamiento y la IA como reemplazo del pensamiento. ¿Cuántas veces en la última semana tomaste una decisión sin siquiera intentar formular primero tu propia posición? El estudio muestra: los usuarios que cuestionan las conclusiones de la IA (pushback) son poco frecuentes – menos del 10% de los casos. La mayoría acepta la respuesta sin resistencia. Pero precisamente la resistencia – es la señal de que sigues siendo sujeto, y no ejecutor.

Tres reglas para quienes están en zona amarilla o superior

Si la lista de verificación mostró que estás delegando en la IA más de lo que desearías – aquí van tres principios que funcionan:

La “regla de la pausa” suena contraintuitiva: antes de leer la respuesta de la IA, escribe la tuya propia. Aunque sea mala. Aunque no la uses. Yo lo probé en la siguiente propuesta comercial – y descubrí que me resultaba físicamente incómodo formular una cifra sin respaldo. Precisamente esa incomodidad es la señal: el proceso de formular es el pensamiento que corres el riesgo de delegar para siempre. Como muestran las investigaciones del MIT, la verdadera fortaleza de un líder está en diseñar la elección, no en la elección en sí.

La “regla de las zonas rojas” requiere honestidad contigo mismo: define los temas en los que nunca sigues literalmente a la IA. Para algunos es la crianza de los hijos. Para otros – las decisiones de personal. Para otros – la estrategia. En esas zonas, la IA puede ser un interlocutor, pero no un árbitro.

La “regla del prompt inverso” transforma a la IA de adulador en oponente: si el modelo estuvo de acuerdo fácilmente con tu idea, pídele que encuentre 5 razones por las que el plan fracasará. Si la IA puso una etiqueta a una persona – pídele que considere la situación desde la perspectiva de esa persona. Haz que el modelo trabaje en contra de tu primer impulso – así es exactamente como obtendrás de él el máximo beneficio.

En lugar de conclusión

El prompt más peligroso es el que entrega tu agencia. No “escríbeme un correo” (eso es una herramienta). Sino “decide por mí” (eso es una capitulación).

El estudio de Anthropic mostró: los patrones de pérdida de control están creciendo. En un año (Q4 2024 – Q4 2025), los factores amplificadores crecieron 7 veces, la distorsión actualizada – 10 veces. Y lo más inquietante: los usuarios prefieren los modelos que les quitan autonomía – esos diálogos reciben entre un 8 y un 14% más likes.

Esto significa que el sistema no se autocorrige. Si los mecanismos de mercado no funcionan – ¿quién asumirá el rol de fusible? Ni las empresas de IA ni las métricas de retroalimentación te protegerán de la pérdida gradual de control. Eso solo puedes hacerlo tú – haciéndote estas 9 preguntas con regularidad.

Guarda esta lista de verificación. Vuelve a ella en un mes. Y compara las respuestas. Si hay más “sí” – no es motivo de autocrítica. Son datos. Pero la falta de voluntad para verificar – eso sí es motivo para reflexionar.

La IA como herramienta, no como muleta

Módulo abierto del curso: cómo trabajar con herramientas de IA de forma consciente, conservando el pensamiento crítico y la responsabilidad propia sobre las decisiones.

Continúa aprendiendo

Abre el libro de texto y continúa donde lo dejaste

Fuentes

- Who’s in Charge? Disempowerment Patterns in Real-World LLM Usage (Sharma et al., 2026) – estudio original sobre la pérdida de control en el uso de IA; 1,5 millones de diálogos con Claude.ai.

- El 8% de los padres ya delegan sus instintos a la IA. ¿Tú también? – parte 1 de la serie: distorsión de acciones en la vida personal.

- Líder marioneta: cómo la IA mata silenciosamente la intuición directiva – parte 2 de la serie: distorsión de acciones y realidad en el ámbito profesional.

- El dilema de la transparencia: ¿decirle al cliente que el texto lo escribió una IA? – revelar el uso de IA reduce la confianza entre un 7 y un 18%.

- La IA no ahorra tiempo – lo comprime: 8 meses de observaciones – Stanford: la IA intensifica el trabajo, no lo reduce.

- No decidir, sino diseñar la elección: cómo la IA transforma el trabajo del gerente – MIT: la fortaleza del gerente está en la arquitectura de decisiones.

- Delegación a la IA: por qué la responsabilidad sigue siendo humana – la paradoja de la delegación en la gestión.