El 86% de los estudiantes usa IA, pero empeoran. Un experimento lo cambió todo

Los enfoques tradicionales de la educación están dejando de funcionar. La IA escribe ensayos y redacciones en minutos – y eso ha cambiado para siempre el sentido de las tareas creativas en las escuelas. Prohibir las redes neuronales no funciona, aislar a los alumnos de la tecnología tampoco. La pregunta no es si usar IA o no. La pregunta es cómo usarla para que la tecnología desarrolle las habilidades de los estudiantes en lugar de reemplazar su pensamiento.

Obtén escenarios de IA para tu clase

Introduce tu asignatura y el tema de la clase – obtén escenarios listos de uso de IA en el aula, prompts y tareas que los alumnos no pueden resolver con una red neuronal (actualmente en ruso).

Sin registro · Resultado en 30 segundos

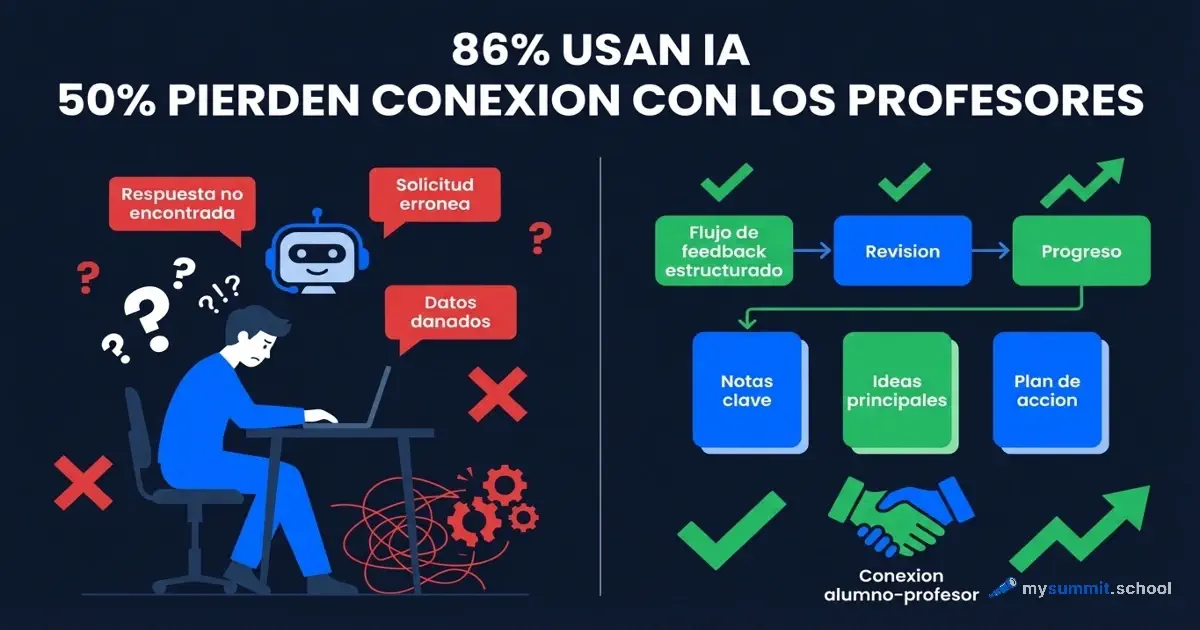

Dos investigaciones de 2025 revelan una paradoja: el 86% de los estudiantes usa IA en sus estudios, pero la mitad de ellos siente que pierde conexión con sus profesores. En teoría, la tecnología debería ayudar – pero por alguna razón todo sale mal.

Lo interesante es que el problema no es la IA en sí. La Universidad de Illinois demostró el resultado opuesto – cuando la IA se calibra correctamente, 5 de cada 6 estudiantes mejoran sus habilidades de escritura. Analicemos la diferencia entre el fracaso y el éxito. Y qué pueden hacer las escuelas que no quieren quedarse atrás tecnológicamente, pero tampoco quieren perder calidad educativa.

Qué está pasando en las escuelas ahora mismo

Las cifras del informe de Education Week son impresionantes. El 86% de los estudiantes en EE.UU. usa IA – prácticamente todos los alumnos. Dos tercios la utilizan como tutor, casi la mitad para consejos de orientación profesional. Parece una revolución educativa. Una tecnología que ayuda a aprender.

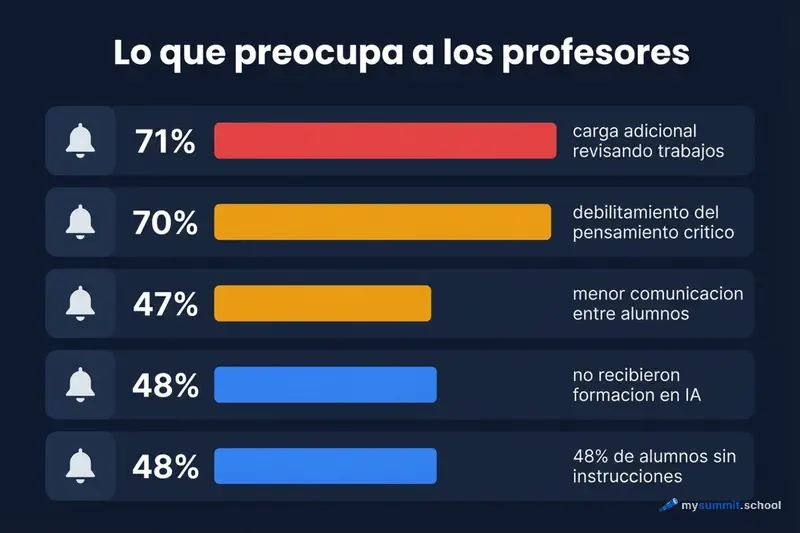

Pero hay un matiz. La mitad de esos mismos estudiantes admite que se siente menos conectada con sus profesores cuando trabaja con IA. El 70% de los docentes observa cómo se atrofia el pensamiento crítico. Los alumnos dejan de pensar – simplemente copian respuestas de ChatGPT.

Y aquí es donde la situación se vuelve realmente alarmante. El 43% de los estudiantes usa IA para consejos sobre relaciones personales. El 42% recurre a ella para temas de salud mental. Un adolescente con depresión le pregunta a ChatGPT qué hacer. El bot responde algo genérico – y en lugar de ayuda real se crea una ilusión de apoyo. El aislamiento solo se intensifica.

Mientras tanto, los profesores están sobrecargados. El 71% habla de carga adicional – ahora hay que revisar cada trabajo para detectar si lo escribió un bot. ¿Realmente el alumno escribió esto? ¿O simplemente copió de ChatGPT y reformuló ligeramente? Y lo más absurdo – solo el 48% de los profesores ha recibido algún tipo de formación sobre IA. Y exactamente el mismo porcentaje de estudiantes ha recibido instrucciones sobre cómo usar la IA correctamente.

El resultado es una paradoja: las escuelas implementan masivamente una tecnología que ni los profesores ni los alumnos saben usar. Y en lugar de ayuda, obtienen problemas – aislamiento, deterioro de habilidades, sobrecarga de los docentes.

¿Se puede hacer de otra manera?

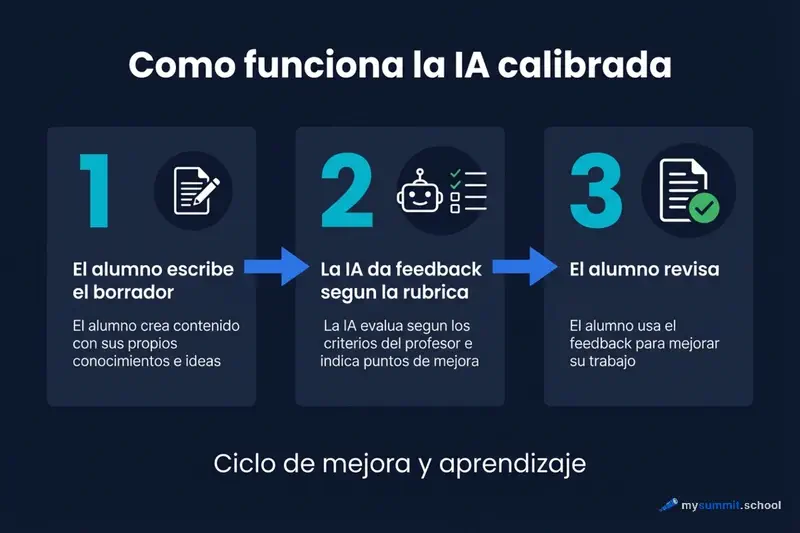

Mientras algunas escuelas luchan contra el caos, el equipo de la Universidad de Illinois (Zheldibayeva et al., 2025) probó un enfoque diferente. No prohibir la IA. No dejarla sin control. Sino calibrarla – configurarla para un profesor específico, sus tareas, sus criterios de evaluación.

La conclusión principal de su investigación suena simple: «La IA generativa no es adecuada para la educación sin calibración. Es necesario recalibrarla según el profesor, sus rúbricas y materiales». Lógico. ¿Pero funciona?

El experimento se realizó en una escuela pública con bajo financiamiento en el Medio Oeste de EE.UU. Seis estudiantes de penúltimo año, un profesor de inglés con dos maestrías. La tarea era sencilla – escribir un ensayo de 200 palabras comparando dos textos.

Los investigadores fueron rigurosos: protocolo IRB (aprobación ética), múltiples fuentes de datos (borradores, versiones finales, grupos focales, encuestas al profesor). Todos dieron su consentimiento, se mantuvo el anonimato. Es decir, no se trata de un simple «probamos y contamos» – es un estudio metodológicamente sólido.

La clave estuvo en dos aspectos de la calibración. Primero, la IA se configuró para la tarea específica del profesor. Solo trabajaba con los materiales cargados en el sistema (lo que se llama RAG – Retrieval-Augmented Generation). Nada de datos aleatorios de internet.

Segundo, la IA evaluaba los trabajos estrictamente según la rúbrica del profesor. Seis criterios: comparación y contraste, gramática, presencia de tesis, evidencia textual, nivel de detalle, análisis. No un feedback genérico de «bien escrito», sino una evaluación concreta por cada punto.

¿Y qué resultó?

Cinco de seis estudiantes mejoraron sus trabajos en al menos un criterio. Uno progresó en tres criterios a la vez. La mejora más significativa fue en «comparación y contraste». Tres alumnos pasaron de 0-1 estrellas a 2-3 estrellas.

Pero las cifras son solo una parte. Lo más interesante es lo que dicen los propios estudiantes. Una cita del grupo focal:

«Fue útil porque después de escribir tenía algo concreto que corregir. Me dijo exactamente qué necesitaba cambiar».

Otro estudiante añade: «Puedo volver atrás y ver qué puedo hacer bien para luego corregirlo».

El profesor también notó la diferencia: «La herramienta motivó a los estudiantes a revisar sus trabajos. Eso era difícil de lograr antes». Normalmente los alumnos entregan el ensayo y se olvidan. Aquí apareció un incentivo para mejorar – porque el feedback era concreto y comprensible.

Cuando los investigadores analizaron todos los comentarios, destacaron cuatro palabras clave: Helpful (útil), Direct (concreto), Encouraging (motivador), Fixable (se entiende qué corregir). Es decir, la IA no solo criticaba – daba una hoja de ruta clara para mejorar.

Un momento, ¿se puede confiar en este estudio?

Honestamente, cuando vi estos resultados por primera vez, mi primer pensamiento fue: «¿Solo 6 estudiantes? ¿En serio?»

Pero analicémoslo. Es un estudio piloto – una prueba de concepto, no un veredicto final. Para un estudio piloto, seis participantes es normal. Además, la metodología es transparente: múltiples fuentes de datos (borradores, versiones finales, grupos focales, encuestas), protocolo IRB (estándares éticos estrictos), publicación en una revista revisada por pares.

Y lo que es especialmente importante – los propios autores reconocen las limitaciones. Eso siempre es buena señal. Escriben directamente: sí, la muestra es pequeña. Sí, es una sola escuela con bajo financiamiento – los resultados podrían no escalar a colegios privados de élite. Sí, es un experimento a corto plazo – no se conoce el efecto después de seis meses. Sí, hay datos incompletos – no todos los estudiantes completaron las encuestas pre/post.

¿Significa eso que el estudio no demuestra nada? No. Significa que vemos una prueba de concepto. No la respuesta definitiva, pero un convincente «sí, la IA calibrada funciona mejor que simplemente soltar ChatGPT sin control». Suficiente para intentarlo. Insuficiente para declarar una revolución.

¿Cuál es la diferencia entre fracaso y éxito?

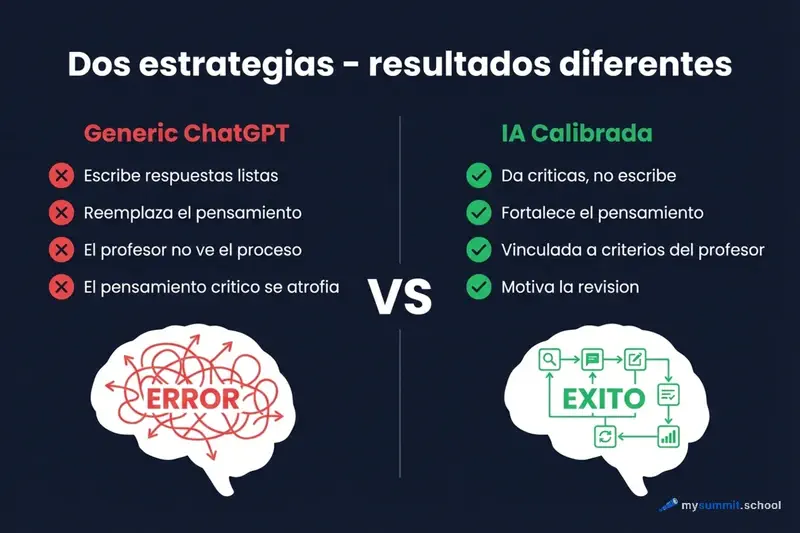

La misma tecnología. ChatGPT allá, LLM aquí. Pero los resultados son opuestos. ¿Por qué?

Cuando las escuelas simplemente permiten ChatGPT sin metodología, los alumnos copian respuestas hechas. Los profesores no saben distinguir el trabajo del alumno del trabajo del bot. El pensamiento crítico se atrofia – no es mi suposición, es lo que dice el 70% de los docentes. El aislamiento social crece. ¿Para qué hablar con los compañeros si ChatGPT siempre responde?

Pero cuando la IA se configura correctamente – la historia es otra. La IA actúa como crítico, no como autor. El feedback es concreto y vinculado a los criterios del profesor. El estudiante escribe por sí mismo, la IA señala los puntos débiles. La motivación para revisar crece – el profesor de Illinois lo confirma.

Paradójico, ¿verdad? La IA genérica reemplaza el pensamiento. La IA calibrada potencia el pensamiento. La misma tecnología, resultados opuestos. Todo depende de cómo se aplica, no de qué es capaz de hacer.

Calibre la IA para sus desafíos educativos – el método del estudio de la Universidad de Illinois

Sin pago requerido • Notificación al lanzamiento

¿Y qué pueden hacer las escuelas de habla hispana?

De acuerdo, el estudio de Illinois es impresionante. Pero utilizaron CGScholar AI Helper – una herramienta especializada que no está disponible en todas partes. ¿Funciona la calibración con las herramientas que tenemos a mano? ChatGPT, Claude, Gemini – o incluso alternativas regionales como YandexGPT o GigaChat.

En resumen: sí. El principio de calibración es universal y no depende de un modelo concreto. ¿Qué opciones hay?

ChatGPT y Claude – son las herramientas más accesibles y potentes para este propósito. Ambos admiten prompts personalizados, carga de documentos y creación de instrucciones detalladas. Claude, en particular, permite cargar materiales en Projects, lo que facilita enormemente la calibración por asignatura.

Gemini de Google – disponible gratuitamente, con buena comprensión del español y capacidad para seguir instrucciones complejas. Integrado con Google Workspace, lo que facilita el uso en entornos educativos.

La pregunta es: ¿qué hacer si no se dispone de una herramienta especializada? ¿Se puede aplicar el método de calibración «manualmente» con un LLM convencional? Sí, se puede.

Primer paso – cree un prompt de sistema con su rúbrica. Por ejemplo, para ChatGPT o Claude:

Eres un asistente docente. Tu tarea es evaluar el ensayo de un estudiante según los siguientes criterios: 1. Comparación y contraste (0-3 estrellas) 2. Gramática y ortografía (0-3 estrellas) 3. Presencia de tesis (0-3 estrellas) 4. Evidencia textual (0-3 estrellas) 5. Nivel de detalle (0-3 estrellas) 6. Análisis (0-3 estrellas) No escribas el ensayo por el estudiante. Solo señala los puntos débiles concretos y cómo mejorarlos.

Segundo paso – cargue los materiales en el contexto. En ChatGPT, añada los textos directamente en la conversación o use GPTs personalizados. En Claude, cargue los documentos en Projects. En Gemini, aproveche la integración con Google Drive.

Tercer paso – verifique que la IA no escriba en lugar del alumno. Pida solo crítica: «Evalúa este ensayo, pero NO propongas un texto alternativo». Si la IA empieza a reescribir – ajuste el prompt.

Aquí un ejemplo completo para ChatGPT o Claude:

Instrucción del sistema: "Eres un revisor exigente de ensayos. Evalúa el trabajo del estudiante según los criterios del profesor. Señala únicamente los puntos débiles. No reescribas el texto por el estudiante." Solicitud del usuario: "Aquí está la rúbrica de evaluación: [insertar criterios]. Aquí está el ensayo del estudiante: [texto]. Evalúa cada criterio y di qué necesita mejorar concretamente."

No es un reemplazo idéntico de CGScholar, pero el principio es el mismo – la IA como crítico, no como autor.

¿Qué deben hacer los profesores y las escuelas?

Primero – no permitan «IA en estado salvaje». Autorizar simplemente ChatGPT o cualquier otro LLM sin metodología conduce al deterioro de habilidades. Se necesitan protocolos claros. No «pueden usar IA», sino «así es como se usa la IA correctamente».

Segundo – calibren la IA para sus tareas específicas. Incluso sin software especializado. Creen un prompt de sistema con su rúbrica de evaluación. Carguen los materiales de estudio en el contexto. La IA debe funcionar como crítico, no como autor.

Tercero – utilicen el método «Sándwich» (Humano-IA-Humano). Primera etapa: el estudiante escribe el borrador por su cuenta. Segunda etapa: la IA da feedback según criterios específicos. Tercera etapa: el estudiante edita el trabajo basándose en la crítica. El ser humano al principio, el ser humano al final. La IA – en el medio, como revisor.

Implemente el método Humano-IA-Humano en la formación de empleados – sin perder calidad ni motivación

Sin pago requerido • Notificación al lanzamiento

Cuarto – evalúen el proceso, no solo el resultado. Defensa oral del trabajo – el alumno debe explicar cada tesis. Historial de versiones en Google Docs – se ve todo el proceso de escritura. Evaluación de la calidad de los prompts – un buen prompt demuestra comprensión profunda del tema.

Quinto – preserven el contacto humano. IA para las tareas en casa, interacción real para el aula. Debates y discusiones obligatorios sin dispositivos. Entrevistas de 5 minutos después de cada trabajo escrito. La tecnología no debe reemplazar la comunicación.

Para gerentes y padres

Si está eligiendo una escuela o evaluando un programa educativo, conviene hacer algunas preguntas clave. ¿Los profesores han recibido formación en IA? Actualmente solo el 48% la tiene, y es un punto crítico. ¿Existe una política clara de uso de IA en la escuela, o se limita a «pueden usar ChatGPT»? ¿Está la IA configurada para el programa de estudios específico, o la escuela usa soluciones genéricas? ¿Cómo previene la escuela el aislamiento social de los alumnos? Y finalmente – ¿existe un código ético para el trabajo con IA?

Las buenas señales son: el alumno puede explicar cómo exactamente usó la IA para un trabajo concreto. Los profesores tienen rúbricas de evaluación que contemplan el trabajo con IA. La IA se usa para feedback y crítica, no para la simple generación de contenido. Y lo fundamental – se conserva suficiente tiempo para la interacción real con el profesor, porque sin eso la educación pierde su sentido.

Las señales de alarma: el alumno simplemente copia y pega de ChatGPT y no puede explicar el contenido. Los profesores no saben cómo evaluar trabajos en la era de la IA y están desorientados. La escuela no tiene una política clara de uso de IA – cada quien hace lo que quiere. Y lo más peligroso – el estudiante ha perdido notablemente la motivación para estudiar, porque «todo se le puede preguntar al bot».

Para la formación corporativa y formadores

Es interesante que los mismos principios funcionan perfectamente para la capacitación de empleados en empresas. Calibren la IA corporativa según sus estándares y procesos – igual que un profesor configura la IA según su rúbrica. El método «Sándwich» es ideal para la preparación de presentaciones, informes y estrategias – el empleado escribe el borrador, la IA critica, el empleado perfecciona.

Evalúen la calidad de los prompts de sus empleados – es un indicador directo de comprensión de la tarea. Si una persona puede formular un buen prompt, significa que entiende profundamente el problema. Y la defensa oral de ideas siempre es más importante que unas diapositivas bonitas generadas por IA.

Un ejemplo concreto. En lugar de «Pidan a ChatGPT que escriba la estrategia», prueben así: «Escriban los puntos clave de la estrategia por su cuenta, pidan a la IA que encuentre debilidades en la lógica, perfeccionen basándose en la crítica y defiendan oralmente ante el equipo». ¿Ven la diferencia? En el primer caso, la persona queda fuera del proceso. En el segundo, está en el centro, y la IA la potencia.

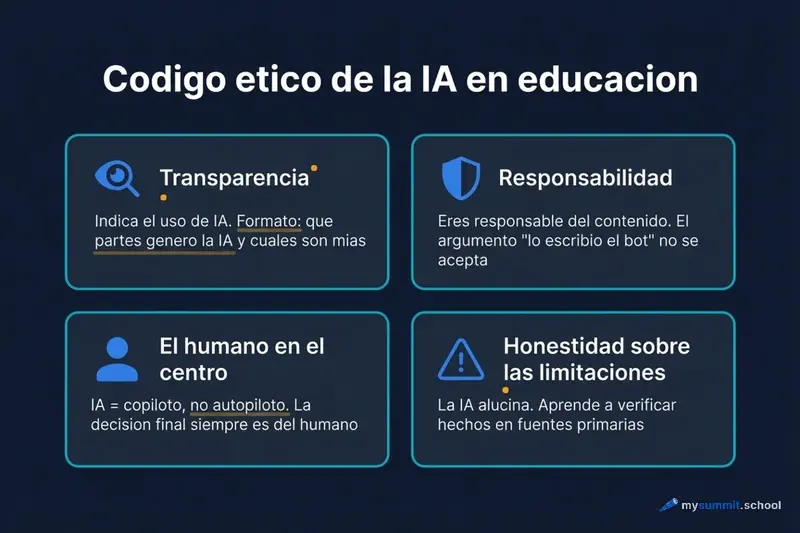

Código ético de la IA en educación

A partir de ambas investigaciones, se pueden establecer cuatro principios clave que deberían existir en cada institución educativa.

Transparencia – primer principio. Si el alumno usó IA, debe indicarlo. Y no simplemente «sí, usé ChatGPT», sino con detalle: «La introducción fue generada por ChatGPT, el cuerpo principal lo escribí yo, las conclusiones las formulamos en conjunto». Este nivel de detalle enseña honestidad y ayuda al profesor a evaluar la contribución real del estudiante.

Responsabilidad – segundo principio. De cualquier texto entregado al profesor, el responsable es el alumno. Punto. El argumento «así lo escribió el bot» no se acepta y nunca debería aceptarse. Si se entrega un trabajo con errores o inexactitudes – es tu problema, aunque ChatGPT te haya fallado.

El ser humano permanece en el centro – tercer principio. La IA funciona como copiloto, no como piloto automático. La decisión final siempre es del ser humano. Esto no son solo palabras bonitas – es la diferencia crítica entre potenciar las capacidades y su deterioro.

Honestidad sobre las limitaciones – cuarto principio. La IA alucina – enseñemos a verificar los hechos en fuentes primarias. La IA puede tener sesgos – enseñemos a evaluar críticamente sus recomendaciones. La IA no comprende el contexto de tu situación particular – enseñemos a aportar experiencia propia y sentido común. La tecnología es poderosa, pero no mágica.

Conclusiones: ¿qué viene después?

Reunamos todo. De las investigaciones de 2025 emergen tres ideas clave.

Primera – la implementación masiva y descontrolada de la IA destruye la educación. Las cifras hablan por sí solas: el 86% de los estudiantes usa IA, pero la mitad siente que pierde conexión con sus profesores. El 70% de los docentes observa el deterioro del pensamiento crítico en sus alumnos. El aislamiento social crece – ¿para qué hablar con los compañeros si ChatGPT siempre está disponible?

Segunda idea – la IA calibrada muestra el efecto contrario. Cinco de seis estudiantes mejoraron sus habilidades de escritura cuando trabajaron con una IA correctamente configurada. Los propios alumnos describen el feedback con las palabras «helpful, direct, encouraging, fixable» – útil, concreto, motivador, se entiende qué corregir. Los profesores destacan el aumento de la motivación para revisar los trabajos, algo que antes era imposible de lograr.

Tercera idea – la clave del éxito no está en las prohibiciones, sino en la metodología. Calibración de la IA para un profesor específico mediante RAG y rúbricas de evaluación. El método «Sándwich» con el ciclo Humano-IA-Humano. Evaluación del proceso de trabajo, no solo del resultado final. Y la preservación del contacto humano – sin esto, la educación pierde su sentido, por buena que sea la IA.

Qué hacer ahora mismo

Pasos concretos para diferentes roles.

Si eres profesor – empieza con poco, pero empieza ya. Toma una formación sobre IA, aunque sea un webinar de 1-2 horas – la comprensión básica es crítica. Crea una rúbrica de evaluación clara que contemple el trabajo con IA – sin ella estarás evaluando a ciegas. Prueba el método «Sándwich» en al menos una tarea y observa los resultados.

Si eres gerente de un proyecto educativo – aquí es donde se necesita la inversión. Invierte en la formación de los docentes, porque ahora solo el 48% ha recibido capacitación, y eso es alarmantemente poco. Implementa soluciones calibradas en lugar de simplemente decir «usen ChatGPT». La IA genérica sin metodología es el camino hacia el deterioro. Crea un código ético de uso de IA para que todos tengan reglas de juego claras.

Si eres padre o madre – haz preguntas incómodas. Pregunta a la escuela sobre su política de uso de IA. Habla con tu hijo sobre cómo exactamente usa la IA – ¿para recibir feedback o para copiar sin más? Insiste en mantener el contacto humano con los profesores, porque sin eso la educación se convierte en una formalidad.

Si eres formador corporativo – adapta el método «Sándwich» a la formación empresarial, funciona igual de bien que en las escuelas. Evalúa la calidad de los prompts de tus empleados – es el mejor indicador de comprensión de la tarea. Implementa la defensa oral de ideas y no te limites a presentaciones bonitas generadas por IA.

Domine la calibración de IA para programas educativos

Aprenda a aplicar los principios del estudio: configuración de IA según sus criterios, método «Sándwich», evaluación de calidad de prompts. Para formadores, RRHH y responsables de programas educativos.

El futuro de la educación: el modelo híbrido

Las investigaciones de 2025 señalan el camino – y no está en los extremos. Ni prohibición total de la IA, ni inmersión completa en la tecnología. Un modelo híbrido.

En casa, a solas con el ordenador y la IA calibrada – recopilar material, estructurar ideas, recibir crítica concreta según los criterios del profesor. Aquí la tecnología ayuda al estudiante a pensar con más profundidad, ver los puntos débiles, mejorar la argumentación.

En el aula, sin dispositivos ni IA – las conclusiones finales se escriben a mano. Debates y discusiones con personas reales, donde hay que reaccionar rápido y defender la propia posición. Defensa oral del trabajo ante el profesor, donde es imposible esconderse detrás de un texto ajeno.

Paradójicamente, el mejor resultado no lo da «IA vs. ser humano», sino «IA + ser humano» – cada uno en su lugar. La IA como copiloto, no como piloto automático. ¿Suena familiar? En la formación corporativa funciona exactamente el mismo principio – la tecnología potencia al ser humano, pero no lo reemplaza.

Fuentes y materiales adicionales

Investigaciones principales:

Zheldibayeva, R., Nascimento, A. K. de O., Castro, V., Kalantzis, M., & Cope, B. (2025). The impact of AI-driven tools on student writing development: A case study. Online Journal of Communication and Media Technologies, 15(3), e202526. Texto completo en arXiv

Vilcarino, J., & Langreo, L. (2025, October 8). Rising use of AI in schools comes with big downsides for students. Education Week. Artículo en Education Week