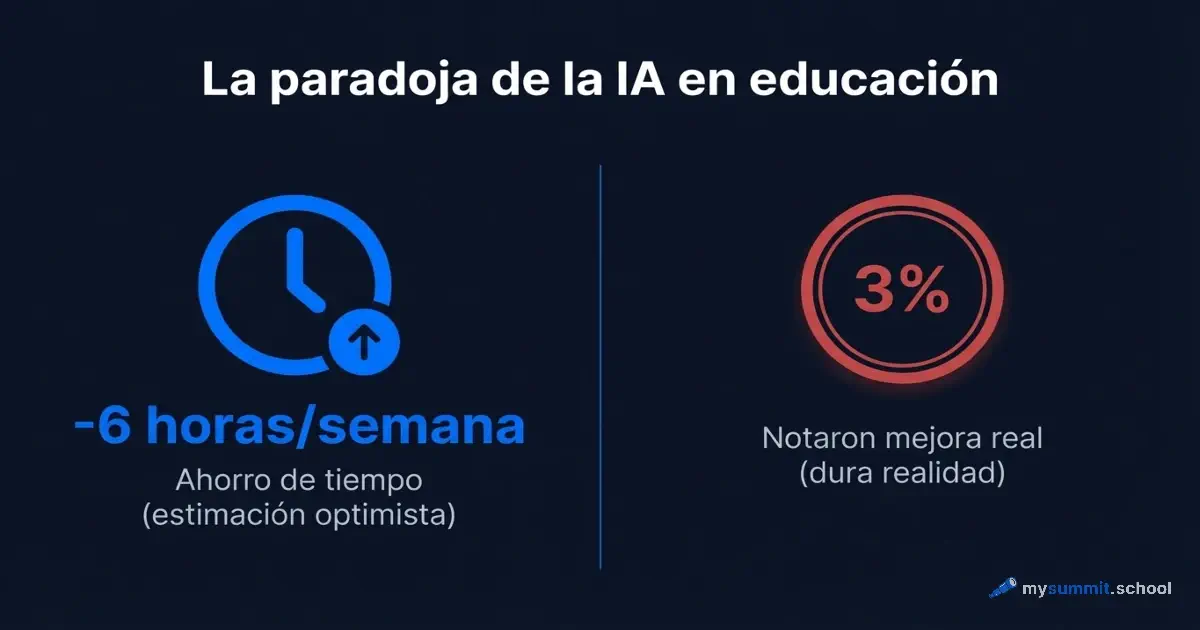

La IA ahorra al docente 6 horas por semana. Pero el 97% no lo nota

La encuesta de Gallup y Walton Family Foundation (2024–2025, muestra representativa de docentes en EE.UU.) registró una cifra impresionante: los profesores que usan IA de forma regular ahorran en promedio 5,9 horas por semana – el equivalente a seis semanas laborales completas en un año escolar. Suena como un problema resuelto.

Pero la encuesta paralela de la Royal Society of Chemistry (2024, Reino Unido) muestra otra realidad: el 44% de los docentes probó la IA, pero solo el 3% reportó una reducción real de su carga laboral. Un profesor de matemáticas de Irlanda explicó la brecha con más precisión que cualquier estadística: «La IA genera fichas rápido, pero hay que revisarlas a fondo – y el ahorro de tiempo termina siendo menor de lo esperado».

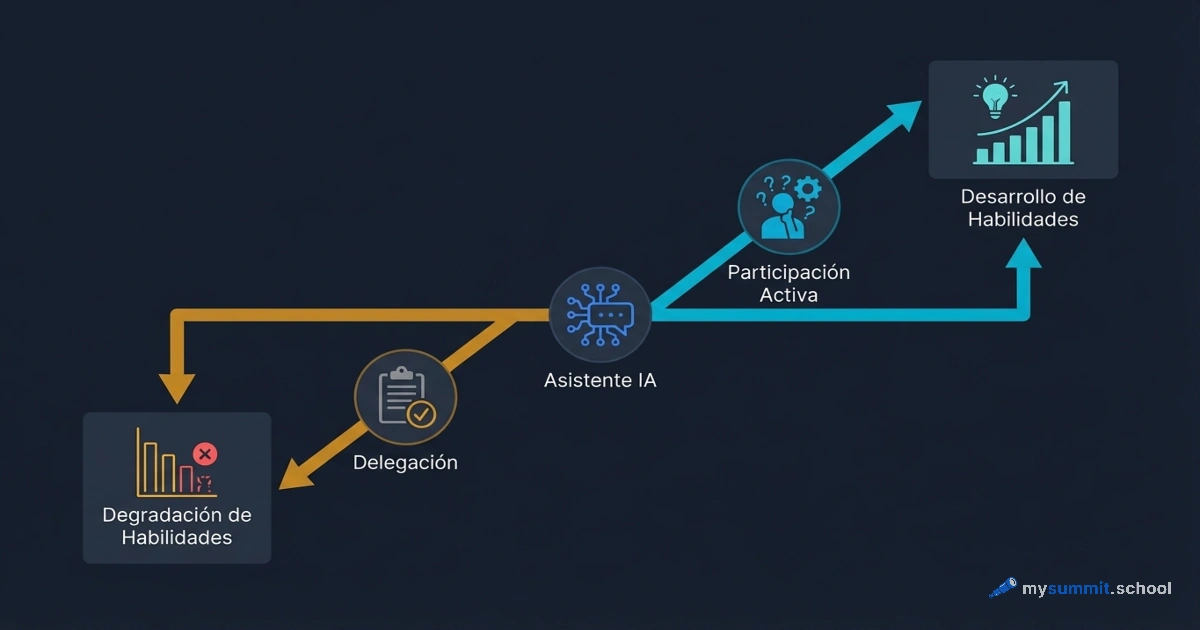

¿Quién tiene razón? Ya analizamos la crisis de la IA en la educación desde la perspectiva del estudiante – el 86 % de los estudiantes usan IA, pero el pensamiento crítico se degrada. Ahora – la perspectiva del instructor. En los últimos dos años se han acumulado suficientes datos experimentales para responder a esta pregunta no con opiniones, sino con cifras.

Qué mostraron los experimentos

Tareas estructuradas: la IA funciona

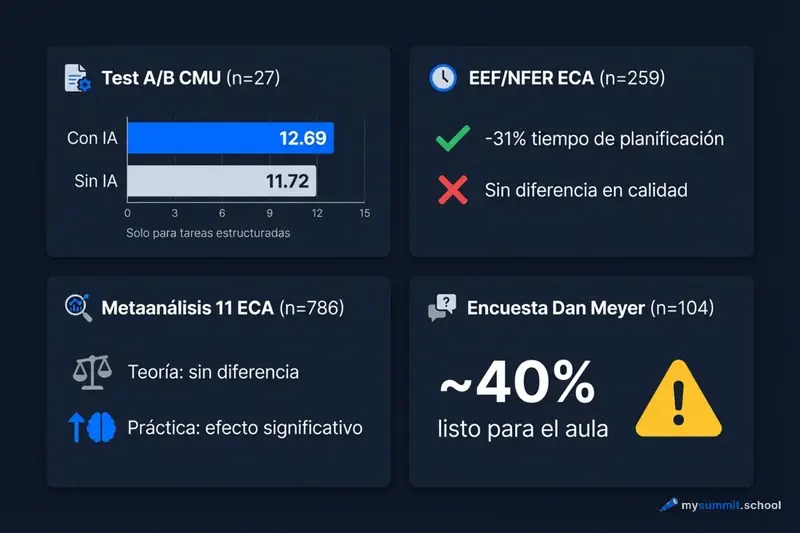

Un estudio de Carnegie Mellon University (Moore et al., AIED 2025) realizó un experimento A/B: 27 estudiantes de maestría crearon 8 microlecciones cada uno – cuatro con ayuda de ChatGPT (GPT-4) y cuatro sin. La evaluación fue ciega, con una rúbrica de 5 criterios (máximo 15 puntos).

Resultado: las microlecciones con IA obtuvieron 12,69/15 frente a 11,72/15 sin IA. La diferencia fue estadísticamente significativa. Pero – y esto es clave – el efecto se manifestó solo en tareas estructuradas: diseño universal de aprendizaje, descubrimiento guiado, «explica–practica». Para tareas que requieren creatividad o sensibilidad social – aprendizaje colaborativo, enseñanza entre pares – no hubo diferencia.

Philippa Hardman registró el mismo patrón en su estudio: para tareas «estructuradas y ampliamente conocidas», la IA mejoró la calidad; para las no convencionales y socialmente matizadas, hubo una caída de 19 puntos porcentuales.

La conclusión de ambos estudios es la misma: la IA potencia lo que ya está bien formalizado. Donde se necesita una solución pedagógica original, resulta inútil o contraproducente.

En el aula real: se ahorra tiempo, pero no calidad

El estudio controlado aleatorizado más grande en este campo lo realizó la Education Endowment Foundation (EEF) junto con NFER: 259 docentes en 68 escuelas del Reino Unido. Los docentes recibieron ChatGPT y una guía detallada de uso.

Resultado en tiempo: 25,3 minutos de ahorro semanal – una reducción del 31% en el tiempo de planificación. Pero el panel de expertos independientes que evaluó la calidad de las lecciones creadas no encontró diferencias apreciables entre las lecciones preparadas con IA y el grupo de control.

Este es el hallazgo más incómodo de todo el corpus de investigación. La IA ahorra tiempo – pero no mejora lo que el docente produce con ese tiempo.

Metaanálisis: habilidades prácticas sí, teoría no

Un metaanálisis de 11 estudios controlados aleatorizados (PMC, 2025, 786 estudiantes de medicina) confirmó la tendencia: los conocimientos teóricos en los grupos con IA y sin IA no difirieron. Pero las habilidades prácticas fueron significativamente superiores en el grupo con IA – con un tamaño de efecto notable.

La IA ayuda a aprender el «cómo hacerlo». No ayuda a entender el «por qué funciona».

Donde la IA falla: tres problemas sistémicos

El 45% de las lecciones se queda en «recordar»

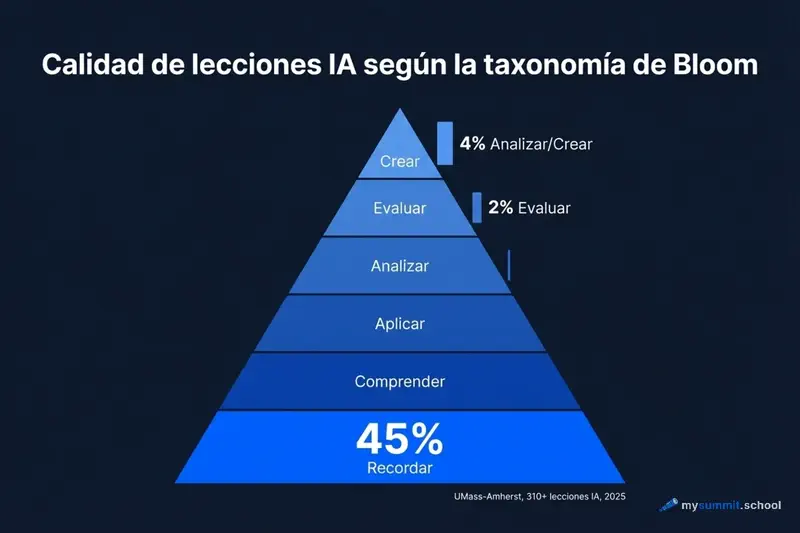

Un estudio de UMass-Amherst (2025, 310+ lecciones de educación cívica, 3 sistemas de IA) reveló la magnitud del problema. De todas las lecciones generadas por IA:

- 45% se quedaban en el nivel de «recordar» – el más bajo en la taxonomía de Bloom (jerarquía de tareas cognitivas: desde memorizar datos hasta analizar, evaluar y crear)

- Solo el 4% proponía análisis o creación

- Solo el 2% pedía a los estudiantes evaluar información

- Apenas el 11–16% incluía uso significativo de tecnologías educativas

La IA produce lecciones que parecen estructuradas, pero en profundidad cognitiva están al nivel de un cuaderno de ejercicios de los años 90. No es un defecto de un modelo concreto. Es una consecuencia de cómo se entrenan los modelos de lenguaje: con un corpus de textos donde las explicaciones simples y las preguntas de repaso aparecen con mucha más frecuencia que las actividades de pensamiento crítico.

Los docentes sobreestiman la calidad de las lecciones con IA

La encuesta de Dan Meyer (104 profesores de matemáticas, 2024) dio una valoración concreta: los materiales generados por IA están listos para usarse en clase en aproximadamente un 40%. El mito de la «regla 80/20» – la IA hace el 80% del trabajo, el docente ajusta el 20% – resultó estar más cerca de la proporción inversa. Cita de uno de los encuestados: «Me resulta más fácil crear las diapositivas desde cero que rescatar algo de lo que produjo la IA».

Un estudio de SUNY Geneseo (estudiantes de pedagogía, 2024) lo confirmó desde otro ángulo: cuando los futuros docentes recibieron la tarea de analizar en detalle planes de clase generados por IA, su confianza en la herramienta disminuyó significativamente. Encontraron discrepancias entre objetivos y actividades, errores factuales y falta de apoyos para estudiantes con distintos niveles.

La conclusión es paradójica: cuanto más a fondo un docente examina una lección con IA, peor la evalúa. La revisión superficial crea una ilusión de calidad.

El «impuesto de verificación» se come el ahorro

Esto explica la brecha entre Gallup (5,9 horas de ahorro) y RSC UK (3% notó una diferencia real). Los docentes que reportan ahorro a menudo no contabilizan el tiempo de revisión y ajuste. Quienes lo contabilizan ven que el ahorro desaparece parcial o totalmente.

Por qué los prompts estructurados cambian el resultado

Los estudios muestran que aproximadamente el 50% de la mejora en calidad de las lecciones con IA no depende del modelo, sino de cómo se formula la solicitud.

Datos concretos:

- Los prompts estructurados generan contenido educativo un ~60% más preciso y relevante que los no estructurados

- Indicar el nivel de Bloom desplazó la distribución del 78% de preguntas de memorización a una mayoría en niveles de análisis y aplicación

- Incluir el principio de diseño inverso (del resultado a las actividades) mejoró la coherencia entre objetivos, actividades y evaluación en un 40–60%

- Especificar criterios de evaluación redujo el volumen de reelaboración posterior en un ~35%

La diferencia entre «Crea una lección sobre ecuaciones cuadráticas para 3° de ESO» y una solicitud estructurada con nivel de Bloom, formato de trabajo, resultado esperado y criterios de evaluación – es la diferencia entre un 40% y un 75% de preparación de la lección.

Esto también explica por qué la estructura del prompt importa no solo para directivos – para los docentes es crítica.

Una línea de evidencia aparte: herramientas educativas especializadas (Curipod, MagicSchool AI, Diffit, SchoolAI) muestran una satisfacción significativamente mayor entre los docentes en comparación con ChatGPT sin ajustes. La razón no está en el modelo, sino en que el prompt ya contiene restricciones pedagógicas: estándares, filtro por edad, plantilla de lección. Los docentes que usan ChatGPT directamente necesitan formular estas restricciones por su cuenta. La mayoría no lo hace.

Obtén escenarios de IA para tu clase

Introduce tu asignatura y el tema de la clase – obtén escenarios listos de uso de IA en el aula, prompts y tareas que los alumnos no pueden resolver con una red neuronal (actualmente en ruso).

Sin registro · Resultado en 30 segundos

La brecha global de formación

Los datos experimentales muestran con claridad: la IA funciona cuando el docente sabe trabajar con ella. Pero la distancia entre «probar la IA» y «usarla de forma sostenida» es un problema global – no limitado a un solo país o región.

EE.UU.: la mayoría prueba, pocos persisten

Según Gallup, más del 50% de los docentes estadounidenses han probado la IA. Sin embargo, datos de EdWeek y RAND muestran que solo alrededor del ~20% la usan de forma regular. La brecha entre experimentación puntual y adopción sostenida es enorme – y no se debe a falta de acceso, sino a falta de formación pedagógica específica para integrar la IA en el aula.

El 41% de los docentes estadounidenses que probaron herramientas de IA reportan no saber cómo aplicarlas de forma práctica en su contexto. El patrón es el mismo que en el resto del mundo: conocer la herramienta no equivale a saber usarla el martes en clase.

Reino Unido: ahorro de tiempo sin mejora de calidad

Los datos de la RSC (ya mencionados) – 44% probaron la IA, solo el 3% notó una reducción real de carga – se alinean perfectamente con el estudio de la EEF: se ahorra tiempo de planificación, pero la calidad del producto final no mejora. El hallazgo de la EEF – 31% menos tiempo, cero diferencia de calidad – es quizás la prueba más contundente de que la herramienta sin la competencia pedagógica no genera valor educativo.

Certificación masiva vs. formación profunda

Dos casos de estudio internacionales ilustran el contraste de forma elocuente.

Kazajistán llevó a cabo el programa de formación docente en IA más grande del mundo: 324 000 inscripciones, 252 000 certificaciones a través de Orleu/UNESCO (2025). El programa fue obligatorio y gratuito. Pero el contenido era alfabetización general en IA según el marco UNESCO – no aplicación por asignatura. 252 000 docentes están certificados como «alfabetizados en IA», pero ningún informe público registra cuántos de ellos usan la IA en sus clases reales. Certificado ≠ aplicación. Dato revelador: en febrero de 2026, varias universidades pedagógicas kazajas anunciaron la creación de facultades de IA para educadores – señal de que la formación actual es insuficiente.

Bielorrusia (BGPU) formó a 97 docentes en un programa intensivo de IA aplicada a la enseñanza. Resultado: más del 70% desarrollaron sus propias metodologías con IA y las implementaron en la práctica. Es la tasa de conversión «formación → práctica» más alta de todos los datos disponibles.

La conclusión es clara: la profundidad de la formación importa más que la amplitud de la certificación. 97 docentes con habilidades reales generan más impacto que 252 000 certificados sin aplicación práctica.

Este hallazgo se conecta directamente con lo que las investigaciones llaman «la ilusión de profundidad» en la formación en IA: los programas masivos sin anclaje práctico crean una sensación de competencia que no está respaldada por la habilidad real.

Recomendaciones prácticas: cómo usar la IA para preparar una clase

El conjunto de investigaciones ofrece un sistema de coordenadas concreto.

Principio: la IA es un primer borrador, no una clase terminada

Ningún estudio ha demostrado que una lección generada por IA pueda usarse sin reelaboración. Los datos de Dan Meyer (40% de preparación), EEF (sin diferencia de calidad), UMass (45% en nivel «recordar») son consistentes: la IA produce un punto de partida, no un producto final.

El valor está en eliminar el problema de la hoja en blanco. La IA ayuda a obtener rápidamente una estructura que se puede revisar críticamente. Es más rápido que empezar de cero – pero solo si el docente sabe exactamente qué reelaborar.

Qué incluir en el prompt al generar una clase

El nivel de Bloom debe indicarse para cada sección de forma explícita – sin esto, el 45% del contenido se quedará en el nivel «recordar» (datos de UMass). Ejemplo: «Introducción – comprensión, práctica – aplicación/análisis, reflexión – evaluación».

El resultado concreto del trabajo de los estudiantes conviene definirlo directamente: no «discutan en grupos», sino «los estudiantes crean X que demuestre la comprensión de Y». Esto separa una clase funcional de una formalidad.

La anticipación de errores típicos debe solicitarse en el prompt: «¿Cuáles son los malentendidos más comunes entre los estudiantes al estudiar este tema?» Esto es lo que distingue un plan de clase experto de uno genérico – y lo que la IA no hace sin una solicitud directa.

El diseño inverso cambia el orden: comience por los criterios de evaluación y luego derive las actividades. La IA por defecto hace lo contrario – primero genera actividades y luego ajusta la evaluación.

El «impuesto de verificación» debe presupuestarse desde el inicio: una lección con IA requerirá un 30–60% del tiempo para verificar datos, adaptar al grupo concreto y corregir el nivel cognitivo. Si no ha previsto ese tiempo, no ha ahorrado – ha trasladado la carga.

Qué revisar en una lección generada por IA

- Coherencia entre las actividades y los objetivos declarados – la principal debilidad encontrada en el estudio de SUNY Geneseo

- Precisión factual – la IA alucina en un 3–9% de los casos en temas generales y hasta un 30% en temas especializados

- Nivel cognitivo de cada actividad – marque según Bloom manualmente

- Presencia de apoyos y pistas para estudiantes con distintos niveles

- Conexión con las clases anteriores y posteriores (la IA trata cada lección como un elemento aislado)

La IA funciona mejor para quienes menos la necesitan

La conclusión más incómoda de los siete experimentos: las herramientas de IA para preparar clases producen el mayor efecto en manos de docentes que ya entienden bien cómo luce una clase de calidad. Para ellos, la IA es un acelerador: un borrador rápido que saben cómo reelaborar.

Para docentes sin esa base, la IA genera un riesgo diferente. SUNY Geneseo lo demostró: sin revisión crítica, las lecciones con IA parecen convincentes pero contienen debilidades sistémicas. Si el docente no ve esas debilidades, las reproduce en el aula.

Es exactamente el mismo mecanismo que el estudio de Anthropic registró en desarrolladores de software: la IA reduce la fricción cognitiva – y con ella reduce la profundidad de comprensión. Para un docente que aún está formando su pensamiento pedagógico, esto no es aceleración. Es un atajo.

Los datos globales lo confirman: 252 000 docentes kazajos con certificado de alfabetización en IA no saben cómo aplicarla en clase. En EE.UU., solo alrededor del 20% de quienes probaron la IA la usan de forma regular. En el Reino Unido, apenas el 3% notó una diferencia real en su carga laboral. El problema no son las herramientas de IA. El problema es la brecha entre saber que «la IA existe» y la competencia de «puedo usar la IA para mejorar una clase concreta el martes».

Los 97 docentes bielorrusos del programa BGPU cerraron esa brecha – y el 70% de ellos creó metodologías propias. La diferencia: no el volumen de la formación, sino su profundidad y su vinculación con la asignatura. Observo el mismo patrón en conversaciones con directivos y docentes: saber que la IA existe y saber aplicarla el martes son competencias distintas con caminos de desarrollo distintos.

Una pregunta para cada docente que lee este texto: su próximo plan de clase generado por IA – ¿lo revisó según Bloom? ¿O lo aceptó porque parecía bien estructurado?

Usas IA – ¿pero detectas los errores ocultos?

9 lecciones diagnósticas: prueba a aplicar la IA en tareas reales – y descubre los errores que la mayoría no ve. Gratis, sin registro.