33 modelos de IA para managers: por que necesitamos sus evaluaciones

Durante el ultimo anio, han aparecido en el mercado 33 nuevos modelos de IA, cada uno reclamando el titulo de “mejor asistente del manager”. ChatGPT se actualizo a GPT-5.2, Claude lanzo Opus 4.5, Gemini agrego una nueva version Pro, Yandex y Sber anunciaron nuevas mejoras, y los modelos chinos salieron en OpenSource. Como elegir una herramienta cuando cada una promete una revolucion en la productividad? Decidimos realizar un estudio comparativo a gran escala – pero nos encontramos con un problema que puede parecer paradojico.

El problema de la objetividad en la evaluacion de la IA

Imagine: le pide a tres modelos de IA que preparen un plan para una reunion 1 a 1 con un empleado cuyo rendimiento esta bajando. ChatGPT ofrece una lista detallada de 12 preguntas con explicaciones de tecnicas psicologicas. Claude propone una estructura concisa de 5 puntos centrada en la empatia. YandexGPT redacta un plan que tiene en cuenta las normas de RRHH rusas y la etica corporativa.

Cual respuesta es mejor?

Este no es un caso en el que se pueda verificar la correccion mediante calculo – como en matematicas. No existe un unico plan correcto para una reunion 1 a 1. La calidad depende del contexto: la experiencia del manager, la personalidad del empleado, la cultura de la empresa y la urgencia del problema. Un manager apreciara el detalle de ChatGPT, otro preferira la brevedad de Claude, y un tercero elegira YandexGPT por su especificidad local.

Sorprendentemente, incluso al probar 33 modelos en 32 escenarios reales (mas de 1 000 respuestas), queda una pregunta fundamental: quien determina que se considera una “buena” respuesta?

Por que estamos probando estos 33 modelos especificos

La lista no es aleatoria. Seleccionamos los modelos segun tres criterios: disponibilidad en Rusia, relevancia para la gestion y representacion de diferentes segmentos de precio.

Lideres globales (8 modelos):

- OpenAI: GPT-5.2-Pro, GPT-4o, GPT-4o-mini (de pago y API)

- Anthropic: Claude Opus 4.5, Sonnet 4.5, Haiku 4.5 (tres niveles de rendimiento)

- Google: Gemini 2.5 Pro, Gemini 3.0 Flash (versiones mas recientes)

Disponibles en Rusia sin VPN (6 modelos):

- Yandex: AliceLLM, YandexGPT 5 Pro, YandexGPT 5 Lite

- Sber: GigaChat Pro, GigaChat

- DeepSeek, Qwen, Xiaomi (modelos chinos en crecimiento)

Especializados y de nicho (19 modelos):

- Meta Llama 3.3 70B, Mistral Large, Qwen 2.5 y otras soluciones de codigo abierto

- Modelos optimizados para razonamiento (DeepSeek R1, OpenAI o1-mini)

- Modelos ligeros para tareas basicas (Phi-4 Mini, Gemma 3)

Por que tantos? Porque en nuestro curso ensenamos a elegir la herramienta adecuada para cada tarea especifica. Un escenario requiere analisis profundo (funciona bien un modelo caro como GPT-5.2 Pro), otro necesita generacion rapida de texto (el gratuito Gemini 3.0 Flash es suficiente). Un tercero requiere trabajar sin VPN (solo modelos rusos). Un cuarto implica procesar grandes volumenes de datos (los tokens y el costo son criticos).

En el modulo abierto ya puede explorar este material – contiene 12 lecciones con escenarios practicos. El estudio nos dara datos concretos: cual modelo es mejor para el analisis de equipos, cual para la preparacion de presentaciones, cual para escribir retroalimentacion. Los estudiantes recibiran no consejos abstractos como “use IA”, sino una tabla con resultados de pruebas.

La metodologia del “Manager ingenuo”

Aqui comienza una decision metodologica importante. Deliberadamente no optimizamos los prompts. No usamos chain-of-thought, few-shot examples, ni dividimos la tarea en subtareas. Los prompts se formulan tal como los escribiria un manager comun sin experiencia en ingenieria de prompts.

Por que? Porque esa es la realidad. La mayoria de los usuarios de IA escriben consultas en lenguaje natural:

“Ayudame a prepararme para una reunion con el director sobre el presupuesto del proyecto”

Y no asi:

“Eres un consultor experimentado en finanzas corporativas. Usa razonamiento paso a paso. Analiza el siguiente contexto: [detalles del proyecto]. Proporciona tres opciones de argumentacion para defender el presupuesto, cada una con justificacion cuantitativa del ROI…”

El primer prompt es lo que escribe el 90% de los usuarios. El segundo es el resultado de formacion en ingenieria de prompts. Probamos los modelos con la primera opcion porque queremos entender: cual herramienta funciona mejor con un usuario “ingenuo”?

Esto refleja el problema real de la adopcion de IA en las empresas. Se puede ensenar a los empleados a escribir prompts perfectos, pero requiere tiempo y disciplina. En la practica, las personas quieren hacer una pregunta como a un colega – y obtener una respuesta util. Cual modelo maneja esto mejor?

Aprenda a escribir prompts efectivos – modulo abierto, sin registro

Sin pago requerido • Notificación al lanzamiento

Dual LLM-as-Judge: cuando la IA evalua a la IA

Con las mil respuestas que tenemos, surge un problema de escala. Un humano no puede evaluar objetivamente mil textos en un tiempo razonable. Incluso dedicando 5 minutos por respuesta, son 88 horas de trabajo – mas de dos semanas laborales. Durante ese tiempo, los estandares de evaluacion inevitablemente “derivan”: lo que parecia una buena respuesta al inicio de la semana puede parecer mediocre frente a nuevos ejemplos.

La solucion es usar LLM-as-Judge: un modelo de IA evalua las respuestas de otros modelos. Es un enfoque popular en la investigacion de IA, pero tiene un problema de sesgo. Un modelo puede calificar mejor las respuestas de un estilo “similar” al suyo o inflar inconscientemente las puntuaciones de ciertos enfoques.

Utilizamos Dual Judge – dos modelos jueces diferentes:

Juez A: Claude Opus 4.5 – evalua matices, tono y consideracion del contexto regional. Claude entiende bien la empatia, las diferencias culturales y los aspectos eticos. Notara si un modelo dio un consejo inaplicable en la cultura corporativa rusa.

Juez B: Gemini 3 Pro – evalua la estructura del razonamiento, la precision de los datos y el formato de la respuesta. Gemini es mas fuerte en analitica, verificacion de cadenas logicas e identificacion de errores factuales.

Cada respuesta recibe dos calificaciones independientes en una escala de 0 a 5. La puntuacion final es la media aritmetica. Si los jueces difieren en mas de 0,75 puntos (por ejemplo, uno da 2,0 y el otro 3,0), la respuesta se marca para revision humana.

Por que estos modelos jueces especificos? Claude Opus 4.5 y Gemini 3 Pro son los mejores en sus clases, pero tienen diferentes “filosofias”. Claude tiende a respuestas detalladas y empaticas. Gemini tiende a respuestas estructuradas y basadas en hechos. Al usar ambos modelos, equilibramos la evaluacion entre la “humanidad” y la “analiticidad” de la respuesta.

Calibracion con la opinion humana: por que necesitamos su ayuda

Aqui surge una pregunta critica: como sabemos que los jueces estan evaluando correctamente?

Un modelo juez puede ser consistente – siempre dando puntuaciones similares a respuestas similares. Pero la consistencia no garantiza la alineacion con las preferencias humanas. Si Claude Opus 4.5 subestima sistematicamente las respuestas breves (porque el mismo tiende al detalle), sera injusto con los modelos de estilo conciso.

La solucion es la Auditoria humana: un humano evalua respuestas aleatorias en la misma escala de 0 a 5. Esto se llama “Gold Set” – evaluaciones de referencia con las que comparamos el trabajo de los jueces.

Estadisticamente, la correlacion entre las puntuaciones del LLM-Judge y las humanas debe ser > 0,60 para que la evaluacion automatizada sea valida. Si la correlacion es menor, los jueces no son confiables y sus puntuaciones no pueden usarse para clasificar modelos.

Por que se necesitan evaluaciones humanas adicionales?

Primero, para la verificacion independiente de la fiabilidad de los jueces. Una muestra del 5% es suficiente para la validacion estadistica, pero cuantas mas evaluaciones humanas haya, mas precisa sera la calibracion. Si 10 personas diferentes califican la misma respuesta, veremos la dispersion de opiniones y entenderemos cuan subjetiva es la evaluacion de “calidad” para un escenario especifico.

Segundo, para detectar errores sistematicos. Si un juez constantemente da puntuaciones altas a respuestas con muchos puntos de lista, pero las personas prefieren respuestas concisas – es una senal para recalibrar el prompt del juez.

Tercero, para entender que es importante para los managers. Quiza los profesionales califiquen una respuesta mas alto si contiene metricas especificas. O al contrario – prefieran un tono empatico a los numeros. Estos son insights cualitativos que no se pueden obtener de evaluaciones automatizadas.

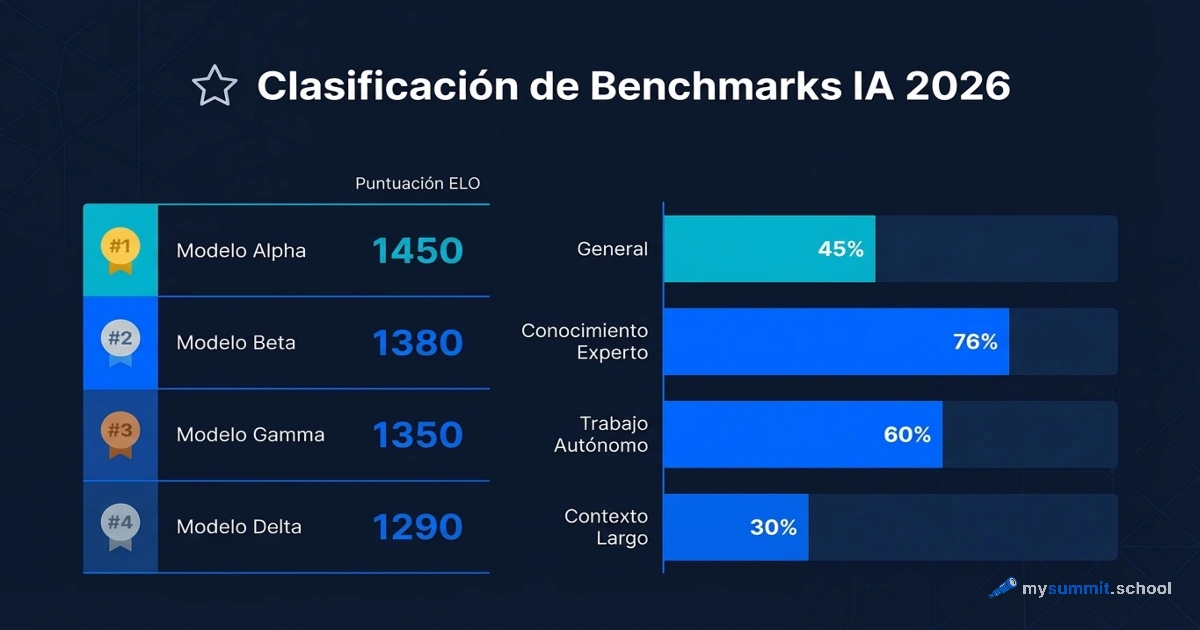

Que publicaremos el proximo mes

Febrero 2026 – publicacion de los resultados completos del estudio.

Que vera en el informe:

- Ranking global – top 33 modelos por puntuacion promedio en todos los escenarios

- Ranking de modelos disponibles en Rusia – cuales herramientas son mejores para quienes trabajan sin VPN

- Ganadores por categoria – el mejor modelo para analisis de datos, comunicacion, toma de decisiones y trabajo textual

- Russia Availability Gap – evaluacion cuantitativa de la brecha entre el mejor modelo global y el mejor disponible en Rusia

- Relacion precio/calidad – cuales modelos ofrecen el mejor ROI

- Fiabilidad de los modelos – tasa de rechazo para tareas empresariales legitimas

- Analisis de preferencias humanas – como las evaluaciones humanas se correlacionan con las puntuaciones de los jueces IA

Por que importa esto para el curso?

El modulo “Eleccion de herramientas de IA” de nuestro curso abierto recibira datos concretos en lugar de recomendaciones generales. Los estudiantes no veran “ChatGPT es bueno para el analisis”, sino “ChatGPT GPT-4o obtuvo una puntuacion promedio de 4,2/5 en la categoria ‘Profundidad analitica’, YandexGPT 5 Pro – 3,8/5, pero esta disponible sin VPN”.

Esto cambiara el enfoque del aprendizaje. En lugar de consejos abstractos – una tabla comparativa con escenarios especificos. En lugar de “pruebe diferentes modelos” – datos: cual modelo es estadisticamente mejor para cada tarea.

Quiere ser de los primeros en ver los resultados del estudio?

El modulo abierto del curso contiene 12 lecciones practicas sobre la eleccion de herramientas de IA. Tras la publicacion de los resultados en febrero, recibira materiales actualizados con datos reales de las pruebas.

Como participar en la calibracion

El proceso es simple y toma 15–20 minutos:

- Vaya a la pagina /evaluate

- Lea la descripcion de un escenario real de gestion (por ejemplo, “Preparar retroalimentacion para un empleado”)

- Vea la respuesta de uno de los modelos de IA (anonimizada – no sabe cual modelo)

- Califique la respuesta en una escala de 0 a 5 con breves explicaciones (opcional)

- Repita para 5–10 escenarios diferentes

Que le aporta participar:

- Influencia en la metodologia – sus evaluaciones ayudaran a calibrar los jueces IA

- Acceso anticipado a los resultados – los participantes recibiran el informe 2 semanas antes de la publicacion

- Comprension de sus propias preferencias – vera cuales estilos de respuesta valora (detalladas vs. concisas, empaticas vs. analiticas)

Importante: todas las evaluaciones son anonimas. Solo registramos la calificacion y un comentario opcional. Sus datos solo se necesitan para enviarle el informe y, si lo desea, mencionarle en el informe (a su solicitud).

Por que esto importa para la industria

La mayoria de las comparaciones de modelos de IA se centran en tareas de benchmark: resolver problemas matematicos, escribir codigo, responder preguntas academicas. Esto es medible y objetivo, pero esta lejos de la realidad de la gestion.

Un manager no resuelve ecuaciones matematicas. Escribe retroalimentacion, se prepara para conversaciones dificiles, analiza el rendimiento del equipo y toma decisiones en condiciones de incertidumbre. Para estas tareas, no hay una “respuesta correcta” – hay respuestas que funcionan mejor en un contexto especifico.

Los estudios que prueban la IA en tareas reales de gestion teniendo en cuenta la especificidad rusa son practicamente inexistentes. La mayoria de la investigacion se realiza en ingles, en el contexto de la cultura corporativa estadounidense, con enfoque en tareas tecnicas. Nosotros llenamos ese vacio.

Contribucion metodologica: el uso de Dual LLM-as-Judge con calibracion humana en prompts “ingenuos” es un enfoque que puede escalarse. Si resulta valido (correlacion con humanos > 0,60), otros investigadores podran aplicarlo para probar nuevos modelos u otros dominios.

Contribucion practica: recomendaciones concretas para managers que quieren adoptar la IA pero no saben por donde empezar. No “use ChatGPT”, sino “para analisis de equipo, pruebe Claude Opus 4.5 (si tiene VPN) o Yandex Alice (si trabaja sin VPN) – mostraron los mejores resultados en esta categoria”.

Conclusiones

Elegir una herramienta de IA para un manager no es una cuestion tecnica, sino una cuestion de adecuacion a las tareas y el contexto. 33 modelos en el mercado no es un exceso, sino una diversidad necesaria: para diferentes presupuestos, requisitos de confidencialidad, disponibilidad regional y estilos de trabajo.

El problema es que comparar objetivamente los modelos en tareas “blandas” es dificil. Una respuesta a “como prepararse para una reunion con el director” puede ser buena para un manager e inutil para otro. La evaluacion automatizada mediante LLM-Judge acelera el proceso, pero requiere calibracion con la opinion humana.

Por eso su participacion importa. Cuantas mas personas evaluen las respuestas de la IA, mas precisa sera la calibracion de los jueces y mas fiables los resultados del estudio. Esto no es ciencia abstracta – son datos que cambiaran el contenido del curso para cientos de estudiantes.

En febrero vera los resultados. Por ahora, vaya a /evaluate, califique algunas respuestas y ayude a hacer el estudio mas objetivo.

Ha enfrentado el problema de elegir una herramienta de IA? Que criterios son mas importantes para usted – precio, disponibilidad sin VPN, calidad de las respuestas? Puede discutirlo en nuestro canal de Telegram.

Fuentes

- Stanford AI Index Report 2025 – estadisticas sobre el uso de IA en los negocios

- McKinsey: The state of AI in 2024 – datos sobre la adopcion de IA en empresas

- LLM-as-Judge: A Survey – panorama de la metodologia de evaluacion automatizada de modelos de IA