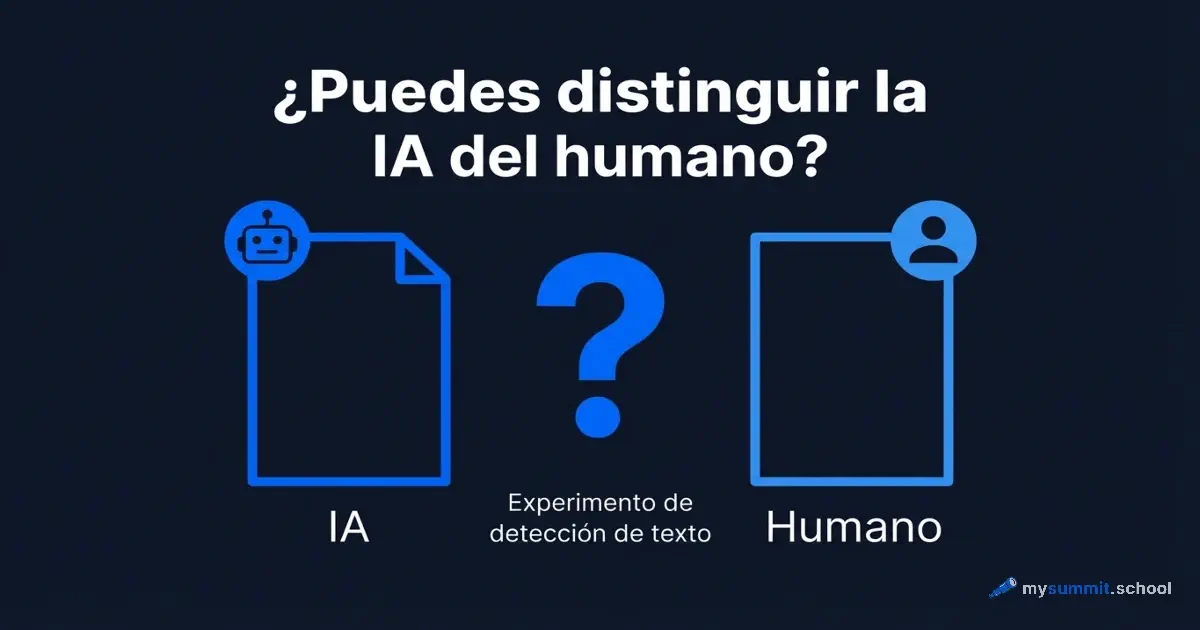

Test de detección de IA 2025: 77% de precisión en 140 participantes + hazlo tú mismo

En mysummit.school lanzamos un experimento: creamos un test de 11 pares de textos donde había que determinar cuál fue escrito por un humano y cuál por una red neuronal. De junio a diciembre, 140 personas lo completaron hasta el final. Los resultados nos sorprendieron – tanto a nosotros como a los participantes.

Nota sobre el contexto del experimento: Este estudio se realizó con participantes de habla rusa, y los textos del test estaban en ruso. Algunos ejemplos hacen referencia a plataformas rusas como VK (red social rusa), Bashorg (sitio de humor ruso) y Samizdat (plataforma rusa de autopublicación). Sin embargo, los patrones identificados – dónde la IA resulta indistinguible del humano y dónde se delata – son universales y aplican a cualquier idioma.

⚠️ Sobre la calidad de los datos

Tras un análisis minucioso, excluimos de las estadísticas:

- Intentos incompletos (menos de 11 preguntas)

- 21 casos de trampa (15%): participantes que repitieron el test memorizando las respuestas

Muestra final: 140 intentos legítimos. Los detalles de la metodología están al final del artículo.

Las cifras principales

140 personas completaron el test. El resultado promedio fue del 77% (8,4 de 11 respuestas correctas). El tiempo promedio de realización fue de 9,1 minutos.

77% de respuestas correctas – es notablemente superior al azar (50%), pero aún lejos de la perfección. Una de cada cuatro respuestas fue errónea.

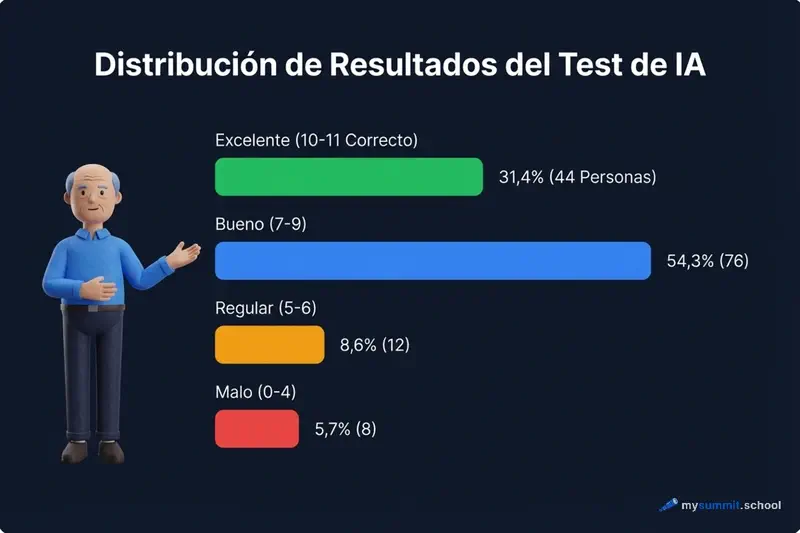

Distribución de resultados: cómo les fue a los participantes

Casi un tercio de los participantes (31,4%) acertaron 10-11 respuestas – eso son 44 personas de 140. Otro 54,3% obtuvo un buen resultado (7-9 aciertos). Con un análisis atento, distinguir la IA del humano es bastante posible – el 86% logró una calificación de «bueno» o superior.

Pero hay otra cara: el 5,7% de los participantes (8 personas) acertaron menos de la mitad – peor que si simplemente lanzaran una moneda. Esto demuestra que sin conocer las señales básicas de la IA, detectar contenido generado es casi imposible.

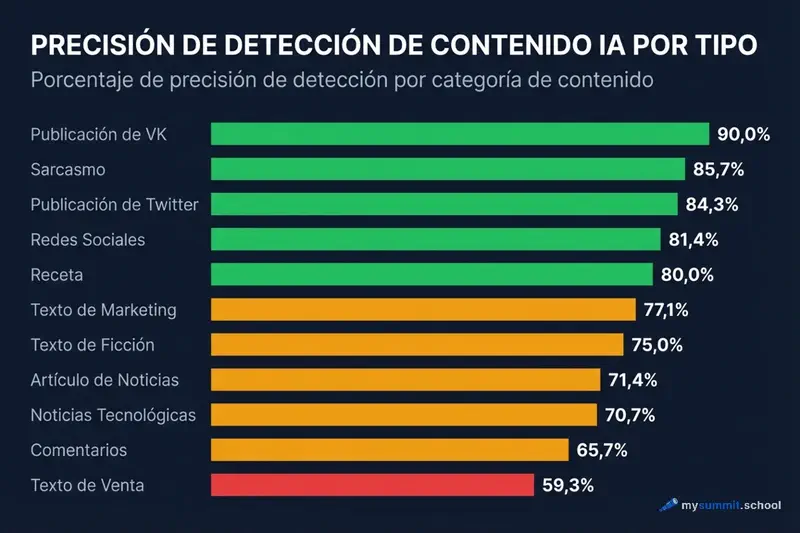

Qué preguntas resultaron más difíciles

Aquí es donde se pone realmente interesante. Diferentes tipos de contenido se reconocen con distinta precisión.

Los líderes en precisión fueron los posts de VK (red social rusa) (90%) y el sarcasmo (85,7%). Los participantes detectan fácilmente el lenguaje vivo de las historias personales y el humor sutil, con los cuales la IA tiene dificultades.

En el rango medio – recetas (80%), posts de redes sociales y Twitter (81-84%), texto literario (75%). Aquí la IA ya se acerca al humano, pero los detalles específicos y los recuerdos personales delatan la autoría.

Los más difíciles – artículos de noticias y comentarios (68-71%) y textos publicitarios (59,3%). Estos últimos son casi azar puro: el lenguaje corporativo es tan formulaico que la IA lo reproduce a la perfección.

Cómo distinguir la IA del humano: patrones del test

Analizando las respuestas de los participantes, identificamos varias señales que ayudan a reconocer texto generado por IA.

La IA se delata por:

Introducciones grandilocuentes. Una receta comienza con «un verdadero viaje en el tiempo, lleno de aromas de canela». Un humano simplemente escribiría sobre waffles.

Exceso de estructura. Listas ordenadas, viñetas, «Top 5 must-read» – la IA adora organizar todo en categorías perfectas.

Lenguaje de marketing. «Game-changers», «ventaja competitiva», «no pierdas esta oportunidad» – vocabulario típico de la IA.

Hashtags y emojis. Post humano: «Mis abuelos. Gente sencilla de pueblo». Versión IA que termina con #amorparasiempre #familia 🙈

Texto demasiado pulido. Sin pausas, titubeos ni muletillas – el texto suena como un comunicado de prensa.

El humano se delata por:

Detalles concretos y referencias de época. «20 dólares de los de antes», «aquel restaurante que ya no existe», «el viejo modelo de carro» – la IA no conoce estos matices o no se le ocurre incluirlos.

Construcciones coloquiales. «Y para qué necesitábamos playas del Caribe», «qué diablos» – lenguaje vivo con emociones reales.

Recuerdos personales. «Los waffles con dulce de leche en casa de la tía» – experiencia concreta, no una abstracta «nostalgia».

Estructura imperfecta. Un humano puede saltar de un tema a otro, olvidar terminar una idea – y eso es completamente normal.

Tres categorías de dificultad

Fácil de reconocer (78-87% de precisión)

Posts de redes sociales – nuestros participantes distinguen muy bien entre un post real de LinkedIn y la generación de IA. Especialmente revelador fue un post sobre libros para product managers: 87% de precisión.

Sarcasmo y humor – la IA aún no maneja bien el humor sutil. Un texto de Bashorg (sitio de humor ruso) sobre gorriones, palomas y obreros con casco fue detectado por el 81% de los participantes.

Twitter – las historias personales cortas con emociones se distinguen fácilmente de la generación por IA.

Dificultad media (68-78% de precisión)

Recetas – la receta humana de stroopwafels con recuerdos de infancia fue detectada por el 78%. La versión IA, con su grandilocuente introducción sobre un «viaje en el tiempo», se delata sola.

Noticias de tecnología – un artículo antiguo de Cnews de 1998 sobre la certificación de 1C (software empresarial ruso) se reconoce por los detalles específicos de la época.

Texto literario – paradójicamente, la prosa de Samizdat (plataforma rusa de autopublicación) se reconoce mejor (78%) de lo que esperábamos.

Difícil de reconocer (54-68% de precisión)

Reseñas de marketing – solo 62% de precisión. Una reseña emocional de un bolso en un sitio de opiniones y la versión IA con emojis son casi indistinguibles.

Textos publicitarios – solo 54%, prácticamente al azar. El anuncio de una mesa redonda profesional y la versión IA usan exactamente los mismos clichés.

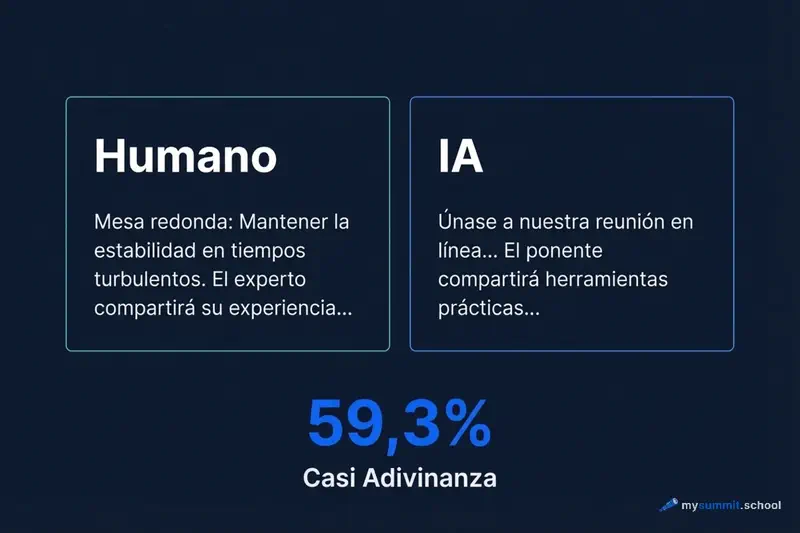

Por qué los textos publicitarios son los más difíciles

Ambos textos usan las mismas plantillas: «el experto compartirá su experiencia», «herramientas prácticas», «no pierdas esta oportunidad». El lenguaje corporativo está tan estandarizado que la IA lo reproduce a la perfección.

Conclusión: cuando el texto humano ya es formulaico de por sí, la IA se vuelve indistinguible. Solo el 59% de los participantes logró distinguir el texto publicitario – prácticamente como lanzar una moneda.

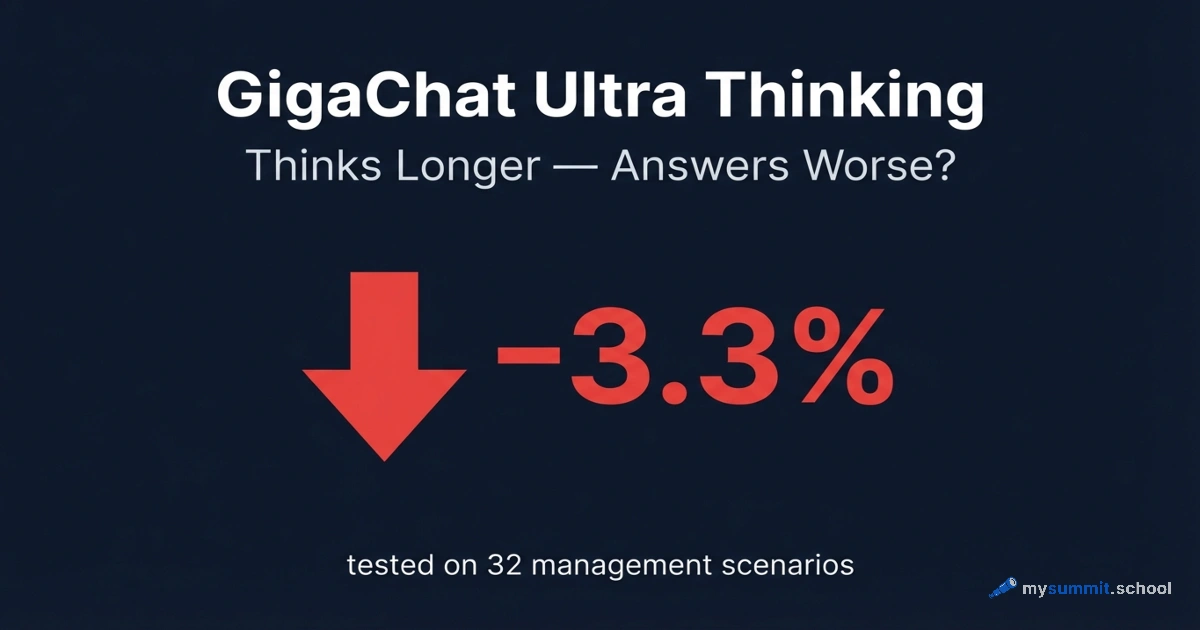

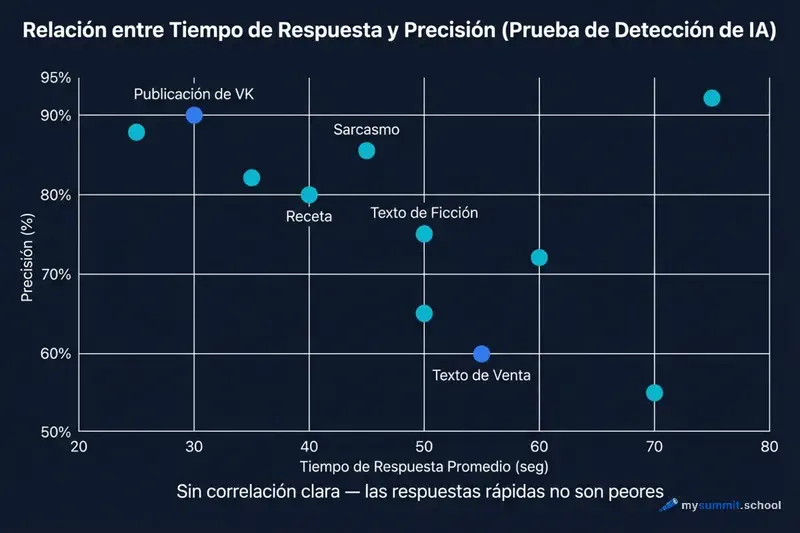

Tiempo de respuesta: pensar más no significa acertar más

Un patrón interesante: pensar más tiempo no significa acertar más. La velocidad promedio de respuesta fue de 41,7 segundos por pregunta, pero no hay correlación con la precisión.

En cambio, las preguntas con mayor precisión (posts de VK, 90%) se resuelven rápido – sin pensarlo mucho. Los textos publicitarios, por el contrario, requieren más tiempo, pero la precisión sigue siendo baja (59%).

La intuición funciona mejor que el análisis prolongado – la primera impresión suele ser la correcta.

Qué significa esto para los gerentes

1. Tu intuición funciona – pero no en todo

77% de precisión general es notablemente superior al azar, pero aún hay un 23% de errores. Existen tipos de contenido donde la intuición falla especialmente:

- Textos publicitarios (59%) – prácticamente al azar

- Comentarios (66%) – la IA imita bien el estilo coloquial

- Artículos de noticias (68-71%) – el estilo formal se reproduce fácilmente

2. Cuanto más formulaico el texto, más difícil detectar la IA

Si el original humano usa clichés y fórmulas estándar, la IA lo reproduce a la perfección. Distinguirlos es imposible.

Conclusión práctica: evalúa el contenido por su valor, no por su «humanidad».

3. Las decisiones rápidas no son peores que las lentas

Los datos muestran que el análisis prolongado no aumenta la precisión (velocidad promedio de 41,7 segundos por pregunta). Confía en tu primera impresión, especialmente para redes sociales e historias personales – ahí la intuición funciona mejor.

Haz el test tú mismo

Seguimos recopilando datos. Pon a prueba tu intuición y compara tu resultado con el promedio.

Qué obtendrás:

- 11 rondas con pares de textos

- Resultado instantáneo con explicaciones

- Tu percentil – cómo te fue en comparación con los demás

Conclusiones

- 77% de precisión promedio entre quienes completaron el test – las personas detectan IA notablemente mejor que el azar, pero el 23% de errores persiste

- 31% de los participantes son expertos (10-11 aciertos), el 86% logró una calificación de «bueno» o superior

- Los textos publicitarios son la categoría más difícil (59%), la IA y los humanos escriben con las mismas fórmulas

- Redes sociales y sarcasmo son los más fáciles (85-90%), la IA aún no domina el lenguaje vivo ni el humor

- El tiempo no afecta la precisión – las respuestas intuitivas rápidas funcionan igual de bien que las reflexiones prolongadas (tiempo promedio: 41,7 seg/pregunta)

Metodología y limpieza de datos

Qué descubrimos durante el análisis

Al recopilar los datos, enfrentamos problemas de calidad:

- Muchos participantes no completaron el test (menos de 11 preguntas)

- 21 casos de trampa (15% de los válidos) – usuarios que repitieron el test varias veces, memorizando las respuestas correctas

Cómo limpiamos los datos

Excluimos intentos incompletos:

- Participantes que respondieron menos de 11 preguntas

- Esto distorsionaba las estadísticas, mezclando a quienes abandonaron con quienes llegaron hasta el final

Corregimos los intentos fraudulentos:

- Detectados por coincidencia de dirección IP + User Agent

- Patrón: 0-3 respuestas → abandono → nuevo intento → 11 respuestas con alta precisión

- Para estos casos, contamos solo las respuestas correctas únicas en todos los intentos

- Si la pregunta #3 fue incorrecta en el primer intento pero correcta en el segundo – se contó como incorrecta (ya conocían la respuesta de antemano)

El peor caso de trampa:

- Un participante: 11 intentos (9 abandonados, 2 completados)

- El sistema corrigió automáticamente su resultado basándose en las respuestas correctas únicas

Muestra final

140 intentos legítimos – participantes que:

- Respondieron las 11 preguntas

- No repitieron el test O sus intentos repetidos no mejoraron el resultado por memorización

Nivel de confianza: 95% (para una muestra de 140 personas, margen de error ±8,3%)

Conclusión: La limpieza de datos mostró que las personas detectan mejor la IA (77%) de lo que parecía al incluir los intentos incompletos. Pero las trampas (15% de intentos fraudulentos) indican que el test es realmente difícil.

¿Quieres no solo detectar la IA, sino usarla de forma efectiva?

Saber distinguir un texto de IA del humano es una habilidad útil. Pero saber aplicar la IA a tus propias tareas – eso ya es una ventaja competitiva.

En mysummit.school enseñamos a los gerentes a:

- Usar ChatGPT, Claude, YandexGPT para tareas cotidianas

- Crear prompts que den el resultado deseado

- Evaluar críticamente el contenido de IA y detectar errores

- Integrar la IA en los procesos de trabajo del equipo

3 lecciones gratuitas – sin teoría, solo práctica.