La IA no te hace más tonto. El problema es cómo la usas

Hace año y medio escribí una nota en mi blog personal sobre algo que observaba en el trabajo de mis colegas y en el mío propio: cuanto más confías en la IA, con menos frecuencia te preguntas «¿esto realmente es correcto?». En aquel momento me basaba en un estudio de Microsoft que mostraba que la confianza en la IA suprime la evaluación crítica de las respuestas generadas. El argumento me parecía sólido, pero tenía un defecto evidente: correlación, no causalidad.

En febrero de 2026, los investigadores de Anthropic Judy Shen y Alex Tamkin publicaron un experimento que cerró esa brecha. Control aleatorizado. Datos concretos. Y una conclusión que, en mi opinión, la mayoría de quienes la leyeron interpretaron mal.

Porque no es una historia sobre cómo la IA nos hace más tontos. Es una historia sobre cómo exactamente la utilizamos.

Qué ocurrió en el experimento

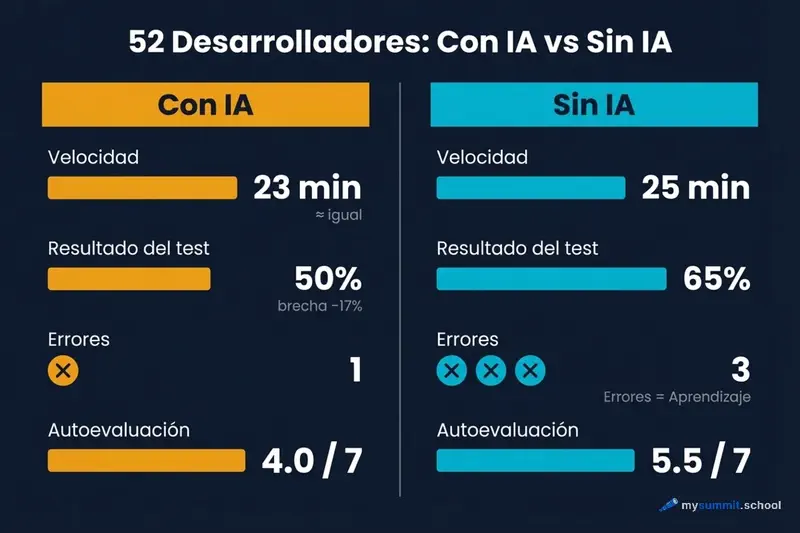

52 desarrolladores recibieron una tarea: aprender a trabajar con una biblioteca de Python para programación asíncrona llamada Trio, nueva para todos ellos. 26 personas trabajaron con un asistente de IA, 26 – sin él. Al finalizar la tarea, todos realizaron un test de comprensión del material.

El resultado del grupo con IA fue un 17% peor. La diferencia es estadísticamente significativa y, para los estándares de la investigación conductual, considerable.

Pero aquí viene lo interesante: la velocidad de ejecución de la tarea fue prácticamente idéntica en ambos grupos. La IA no ayudó a trabajar más rápido. Pero sí ayudó a comprender menos.

Los investigadores también registraron un detalle curioso: algunos participantes dedicaban hasta 11 minutos solo a formular una petición a la IA. Los costes transaccionales de trabajar con IA resultaron comparables al tiempo de búsqueda autónoma de la solución.

Y otro dato que explica por qué el grupo sin IA obtuvo mejores resultados: se encontraron con una mediana de 3 errores por participante, mientras que el grupo con IA – con una mediana de 1. Parece una ventaja. En realidad es una desventaja: es precisamente el encuentro con el error lo que obliga a entender qué está ocurriendo.

Los participantes del grupo con IA lo reconocieron ellos mismos. En la reflexión final escribieron que se sentían «perezosos» y lamentaban no haber profundizado en los detalles. La IA reducía la fricción cognitiva – y junto con ella reducía la profundidad de asimilación.

Un patrón análogo se ha registrado en educación: un estudio mostró que el 86% de los estudiantes que usan IA demuestran degradación del pensamiento crítico – precisamente porque dejaron de enfrentarse a dificultades.

Seis patrones – y por qué esto importa más que «usar o no usar»

Aquí empieza lo más interesante. Los investigadores no se detuvieron en la comparación de grupos. Estudiaron cómo exactamente los participantes interactuaban con la IA e identificaron seis patrones estables.

Tres patrones mostraron resultados bajos en el test (24–39% de respuestas correctas). Tres – altos (65–86%).

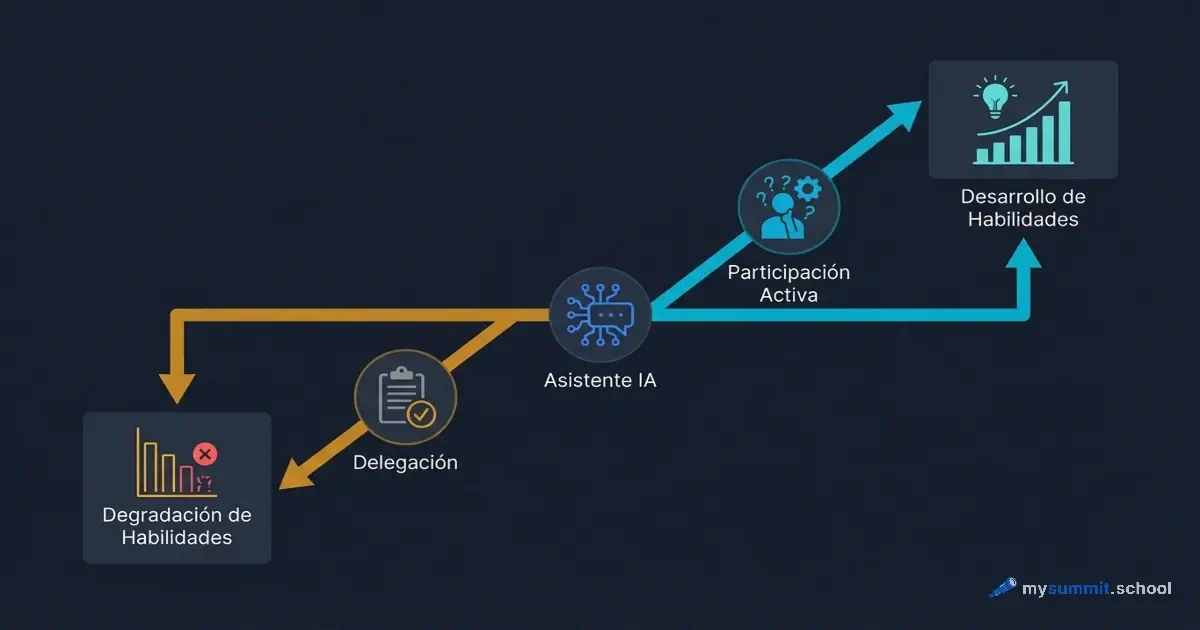

La diferencia no está en si la persona usó IA. La diferencia está en si siguió siendo un agente pensante durante el proceso.

Patrones con resultados bajos

AI Delegation – delegación total. El participante simplemente pedía a la IA que escribiera el código y aceptaba el resultado sin estudiarlo. Puntuación media: alrededor del 24%.

Una petición típica se veía así:

Escribe una función para la lectura asíncrona de archivos usando la biblioteca Trio.

El código funcionaba. No había comprensión. Ante cualquier desviación del patrón, el participante volvía a recurrir a la IA.

Progressive AI Reliance – dependencia creciente. Empezaban de forma autónoma, pero gradualmente delegaban cada vez más, hasta entregarlo todo a la IA. Puntuación media: alrededor del 28%.

Progresión típica:

¿Cómo funciona nursery en Trio? ... (varias iteraciones) ... Simplemente escríbeme un ejemplo funcional con nursery para mi tarea.

El momento clave: la transición de preguntas a «escríbelo por mí» ocurría de forma imperceptible, en cuanto aparecía la primera dificultad.

Iterative AI Debugging – depuración mediante IA sin comprensión de las causas. El participante ejecutaba el código, obtenía un error, lo enviaba a la IA y aplicaba la corrección sugerida. El ciclo se repetía. Puntuación media: alrededor del 39%.

Recibo el error: TaskGroup is not a function. ¿Cómo lo corrijo?

El código terminaba funcionando. Pero el participante nunca entendió por qué.

Patrones con resultados altos

Generation-Then-Comprehension – generación con estudio posterior. La IA escribe el código, pero el participante luego lo analiza línea por línea, haciendo preguntas de profundización. Puntuación media: alrededor del 86%.

Escribe una función para la ejecución paralela de tareas con Trio nursery. Después explícame: - ¿Por qué se usa precisamente async with y no simplemente with? - ¿Qué ocurre si una de las tareas dentro de nursery lanza una excepción? - ¿En qué se diferencia esto del asyncio estándar?

La diferencia es radical. La IA deja de ser un sustituto del pensamiento y se convierte en su herramienta.

Hybrid Code-Explanation – solicitud simultánea de código y explicación. El participante desde el principio pedía no solo la solución, sino comprensión. Puntuación media: alrededor del 75%.

Muéstrame un ejemplo de uso de trio.open_nursery() y explícame simultáneamente: 1. Qué hace cada línea 2. Qué conceptos clave debo entender para poder aplicarlo de forma autónoma 3. Qué errores típicos se cometen en el primer uso

Conceptual Inquiry – preguntas conceptuales, implementación autónoma. El participante usaba la IA solo para comprender los principios y escribía el código por sí mismo. Puntuación media: alrededor del 65%.

Explícame el concepto de structured concurrency en Trio. No muestres código – solo la idea. ¿Por qué es mejor que simplemente lanzar coroutines directamente?

Tras esa explicación, el participante implementaba la solución por su cuenta, se encontraba con errores – y los resolvía. Exactamente como hacía el grupo de control.

Qué significa esto para un manager

Aquí es importante no cometer un error de interpretación. El estudio se realizó con desarrolladores aprendiendo una herramienta técnica. Pero el mecanismo es universal – y posiblemente para los managers sea aún más significativo.

Un desarrollador puede verificar: el código funciona o no funciona. Un manager no tiene ese feedback inmediato. Un email redactado por la IA parece convincente. Un análisis de riesgos – estructurado. Un resumen de reunión – coherente. Verificar hasta qué punto esto refleja fielmente la realidad y se alinea con tus intuiciones de gestión es considerablemente más difícil.

Esto significa que la degradación de habilidades en un manager puede ocurrir de forma más silenciosa y pasar desapercibida durante más tiempo.

Observa las tareas habituales de gestión a través del prisma de los seis patrones.

Tomemos las actas de una reunión. El patrón de delegación se ve así:

Aquí tienes la transcripción de la reunión. Escribe un resumen con las decisiones clave y los próximos pasos.

El patrón con alto resultado se ve diferente:

Aquí tienes la transcripción de la reunión. Identifica tres momentos donde los participantes parecían hablar de lo mismo pero se referían a cosas diferentes. Explica por qué llegaste a esa conclusión.

En el segundo caso, la IA se convierte en una herramienta para desarrollar tu percepción, no para sustituirla.

O la preparación para una negociación. La petición delegadora:

Prepara argumentos para la negociación del presupuesto del próximo trimestre.

La petición conceptual se ve diferente:

¿Qué mecanismos psicológicos influyen en cómo las personas perciben las solicitudes de presupuesto? No me des argumentos – explícame qué ocurre en la mente de la persona que los escucha.

La diferencia no está en la eficacia en una reunión concreta. La diferencia está en lo que acumulas a lo largo de meses de trabajo.

Esto está directamente relacionado con lo que los investigadores llaman Disempowerment – la sustitución gradual del juicio propio por el algorítmico. No dramática ni perceptible en el momento. Simplemente un desplazamiento silencioso de «yo decidí» a «la IA sugirió».

40 lecciones sobre IA para managers – incluyendo un módulo sobre el uso seguro de IA sin perder habilidades

Sin pago requerido • Notificación al lanzamiento

Tres preguntas como herramienta práctica

El estudio no propone prohibir la IA, sino cambiar el patrón. Antes de enviar una petición, vale la pena hacerse tres preguntas.

Primera: ¿entiendo por qué la IA dio exactamente esta respuesta? No «¿funciona esto?», sino «¿entiendo la lógica?». Si no – es una señal para hacer una pregunta de profundización, no para aceptar la respuesta.

Segunda: si la IA se equivoca aquí – ¿lo notaría? Como muestra el estudio de Workday, el 37% del tiempo ahorrado con IA se dedica a corregir sus errores. Esto solo es posible si tienes la competencia para detectarlos. Si el patrón de delegación ha suprimido esa competencia – no ahorrarás nada.

Tercera: ¿dentro de un mes podré hacer esto sin IA? No es una pregunta sobre renunciar a la herramienta. Es una pregunta sobre si se está formando una habilidad o solo la apariencia de tenerla. Como muestra el estudio del MIT sobre gestión, la verdadera fortaleza de un profesional está en la capacidad de evaluar críticamente las opciones, no en disponer de una herramienta que las genera.

Si a las tres preguntas la respuesta es «no» – no es motivo para dejar la IA. Es motivo para cambiar de patrón.

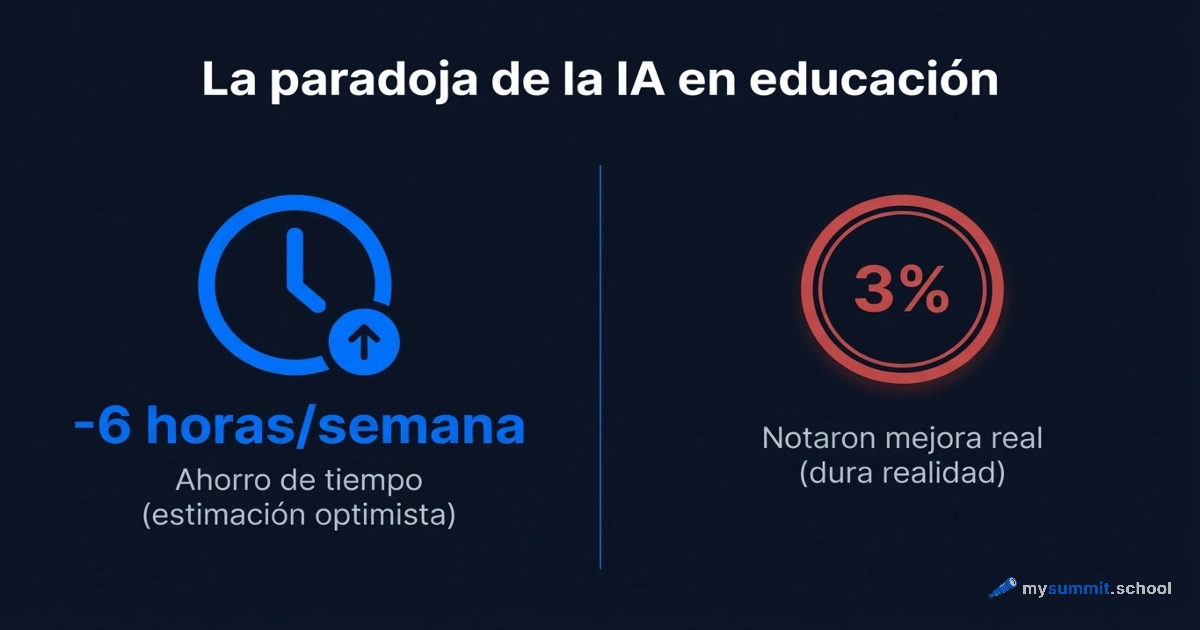

La paradoja que conviene tener presente

Hace año y medio planteé la hipótesis de que la accesibilidad de la IA reduce los estándares de evaluación de los resultados generados. Ahora esa hipótesis tiene confirmación experimental – y es más precisa de lo que pensaba.

No se trata de que la IA nos haga peores. Se trata de que la IA elimina la fricción – y la fricción era parte del proceso de aprendizaje. El grupo de control se encontró con tres veces más errores. Y precisamente eso les obligó a comprender.

Esto es importante también en el contexto de una tendencia más amplia: la IA no tanto libera tiempo como densifica la carga de trabajo, reduciendo las barreras visibles y aumentando el ritmo. La profundidad de comprensión, mientras tanto, puede ir disminuyendo silenciosamente.

El estudio registró: los participantes con alta puntuación no evitaban la IA – la usaban para entender mejor, no para dejar de pensar. La diferencia está en la intención, no en la herramienta.

La pregunta que dejo sin respuesta: ¿qué habilidad quieres conservar dentro de un año – y cómo estás trabajando exactamente con la IA en eso ahora mismo?

¿Trabajas con IA pero no estás seguro de hacerlo bien?

9 lecciones gratuitas sobre IA para managers: patrones de uso seguro, detección de alucinaciones, escenarios prácticos – sin registro ni pago.