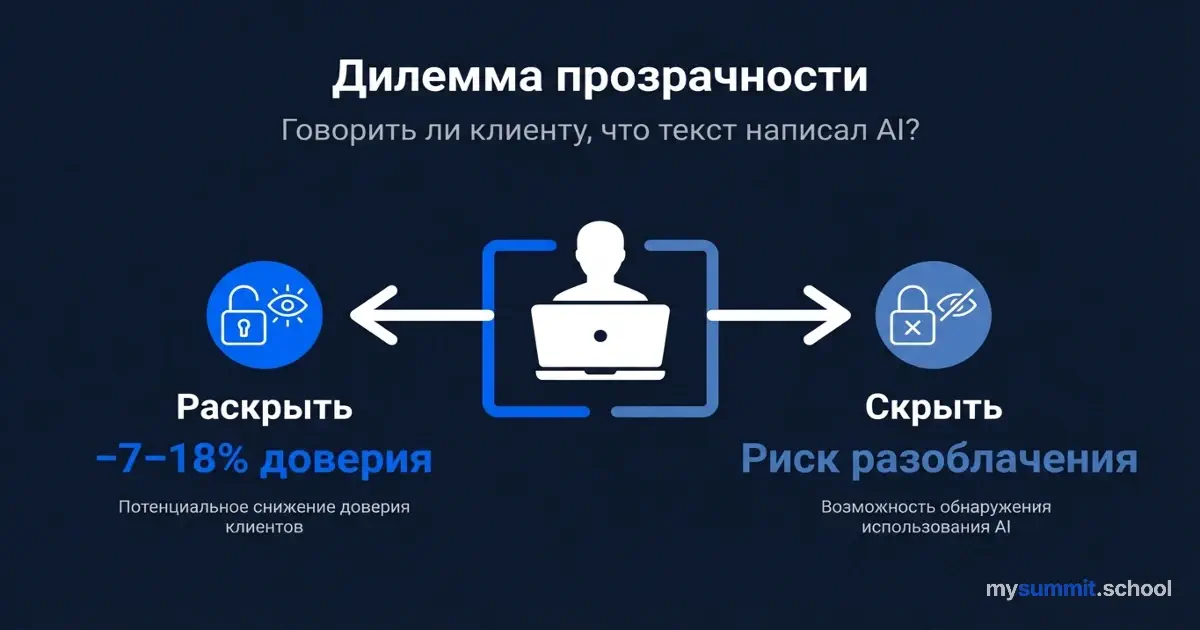

El dilema de la transparencia: ¿decirle al cliente que el texto lo escribió una IA?

Escribiste el correo perfecto para un cliente. El tono es preciso, los argumentos están bien estructurados, incluso hay un toque de humor en el momento justo. Solo hay un problema: no lo escribiste tú. Lo escribió Claude. O ChatGPT. O Gemini – da igual.

Ahora la pregunta: ¿se lo vas a decir al cliente?

La intuición dice: «Claro que no. ¿Qué importa cómo se escribió si está bien escrito?». La ética corporativa susurra: «Hay que ser transparente». Y la ciencia dice algo inesperado: ambas opciones destruyen la confianza – pero de formas distintas y con consecuencias diferentes.

El experimento que lo cambió todo

En 2025, los investigadores Oliver Schilke y Martin Reimann publicaron en Organizational Behavior and Human Decision Processes una serie de 13 experimentos prerregistrados con más de 5 000 participantes. El abanico de escenarios fue inusualmente amplio: profesores redactando cartas de recomendación, analistas preparando informes de inversión, directivos escribiendo correspondencia corporativa y creativos desarrollando conceptos.

La metodología fue elegante en su sencillez. Los participantes recibían los mismos textos. La única variable era si sabían o no que la IA había participado en su creación. El uso real de la tecnología permanecía constante; lo único que cambiaba era la revelación.

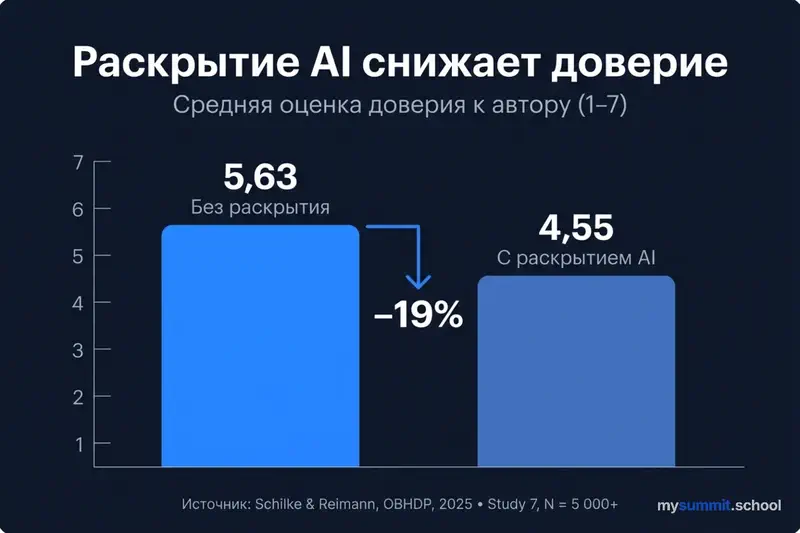

El resultado fue contraintuitivo: revelar explícitamente el uso de IA reducía sistemáticamente la confianza en el autor del mensaje. No en la calidad del texto, sino en la persona que lo envió. Cifras concretas: la confianza en profesores que usaron IA para cartas de recomendación cayó un ~16%. Para fondos de inversión que revelaron la participación de IA en informes analíticos, un ~18%. Una simple etiqueta de «creado con ayuda de IA» restaba 7–14 puntos porcentuales de confianza.

Los investigadores también probaron formulaciones «suaves»: «la IA solo se usó para revisar la ortografía», «la IA ayudó con la estructura». No funcionó. Cualquier mención de IA activaba el mismo mecanismo de devaluación.

La penalización por autenticidad

La causa es lo que los investigadores denominaron penalización por autenticidad (authenticity penalty). Schilke y Reimann identificaron tres componentes que se deterioran sucesivamente al revelar el uso de IA: tipicidad (¿es un comportamiento normal para este rol?), compromiso (¿el autor invirtió esfuerzo?) y autenticidad (¿hay una persona real detrás de las palabras?).

Cuando el receptor descubre que el texto fue creado con ayuda de IA, se produce un cambio cognitivo instantáneo. Empieza a dudar: ¿son tus ideas o el algoritmo seleccionó formulaciones estadísticamente probables? ¿La preocupación en el mensaje es sincera o es una plantilla?

El análisis lingüístico confirma la paradoja: los textos de IA obtienen objetivamente puntuaciones más altas en calidez emocional, complejidad estructural y diversidad léxica. Pero pierden sistemáticamente frente a los textos humanos en autenticidad – la sensación de que detrás de las palabras hay una persona real con intenciones genuinas.

Y el peor escenario no es tu propia revelación. Como lo formulan los investigadores: «Si un tercero revela que usaste IA, ese es el peor resultado posible». Porque a la penalización por autenticidad se suma la penalización por engaño. El mecanismo es el mismo que en la gestión algorítmica: la pérdida de sensación de control desencadena una reacción en cadena de desconfianza.

Prueba ciega: cuando la IA gana – y pierde

La magnitud de la penalización por autenticidad queda patente en la investigación de Gagan Jain, Samridhi Pareek y Per Carlbring (2024).

En la primera fase (prueba ciega), 140 participantes evaluaron respuestas a 10 escenarios de apoyo psicológico – desde conflictos interpersonales hasta manejo del estrés. La fuente estaba oculta. Las respuestas de IA (ChatGPT) obtuvieron puntuaciones iguales o superiores a las de estudiantes de máster en psicología clínica en los tres parámetros: autenticidad, profesionalismo y practicidad. Las diferencias no fueron estadísticamente significativas.

En la segunda fase (6 meses después, con revelación), 111 participantes del mismo grupo evaluaron exactamente las mismas respuestas, pero esta vez sabían quién era el autor. Resultado: las puntuaciones de autenticidad de las respuestas humanas aumentaron (de 36,33 a 37,66), mientras que las de la IA se mantuvieron igual (34,85 en ambas fases).

Las investigaciones revelan otro matiz curioso: la confianza general en la IA correlacionaba solo con la practicidad. No se encontró relación ni con la autenticidad ni con el profesionalismo.

Las personas están dispuestas a reconocer que la IA es útil. Pero no están dispuestas a reconocer que la IA pueda ser sincera. La confianza utilitaria y la confianza emocional son dos circuitos diferentes, y la revelación destruye precisamente el segundo.

Catch-22: ocultarlo es aún peor

Parecería que la solución es obvia – simplemente no decir nada. Y efectivamente, los datos de Salesforce (encuesta a 14 000 empleados) muestran que el 64% hace pasar contenido generado por IA como propio. Según WalkMe, el 78% usa herramientas de IA no aprobadas en el trabajo. Entre ejecutivos de nivel C, la cifra es aún mayor: el 93% admite usar «IA en la sombra».

Pero los investigadores Schilke y Reimann advierten: la revelación por parte de un tercero – un colega, un descubrimiento casual, un fallo técnico – causa un daño catastrófico y a menudo irreparable a la reputación.

Ya no es «usó una herramienta». Es «me engañó deliberadamente».

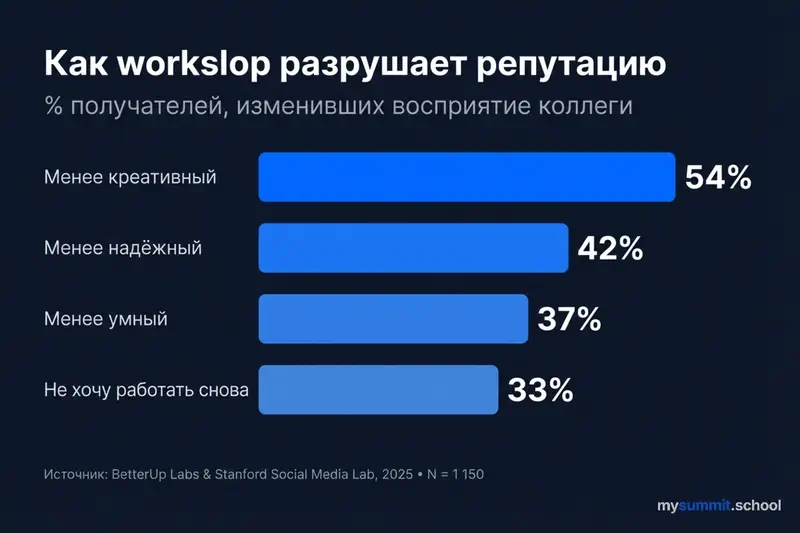

Los datos de la investigación conjunta de BetterUp Labs (Kate Niederhoffer) y Stanford Social Media Lab (Jeff Hancock), una encuesta a 1 150 empleados a tiempo completo en EE. UU., cuantifican este efecto. Cuando los receptores descubren que el trabajo de un colega es «workslop» generado por IA (contenido con un acabado superficial pero sin profundidad real):

- El 54% considera al remitente menos creativo

- El 42% lo considera menos digno de confianza

- El 37% lo considera menos inteligente

- El 33% no querría volver a trabajar con esa persona

Un solo correo con IA al descubierto puede anular meses de reputación profesional construida. Esto obliga a reflexionar: qué frágil resulta ser lo que solemos llamar «confianza profesional».

El impuesto oculto: la heurística del esfuerzo y 9 millones de dólares al año

Para entender la profundidad de esta reacción, hay que recurrir a la heurística del esfuerzo, un sesgo cognitivo. Décadas de investigación demuestran que las personas equiparan instintivamente el esfuerzo visible con la calidad del resultado. Un poema que «llevó tres años» se valora más que uno idéntico escrito «en media hora». Un traje hecho a mano cuesta más que uno de fábrica, aunque sean indistinguibles.

La IA rompió esa conexión. Un texto impecable ahora se crea en segundos – y dejó de ser una señal de competencia. Cuando un directivo descubre que el brillante informe de su subordinado es producto de un solo prompt, se activa la sensación de engaño. No porque el informe sea malo, sino porque el esfuerzo supuesto resultó ser una ilusión. La síntesis de Microsoft Research (~50 estudios) confirma: los usuarios que recibieron recomendaciones incorrectas de IA trabajan más lento que quienes realizaron la tarea sin IA alguna.

Y el daño financiero del workslop es concreto. Según BetterUp y Stanford:

| Indicador | Valor |

|---|---|

| Porcentaje de empleados que recibieron workslop en el último mes | 40% |

| Tiempo medio para resolver un incidente | 1 hora y 56 minutos |

| Coste del tiempo perdido por empleado al mes | 186 $ |

| Daño oculto para una organización de 10 000 personas | >9 millones de $/año |

El receptor del workslop dedica casi dos horas a recuperar el contexto, verificar datos y corregir errores. La IA ahorró 30 minutos al remitente – y trasladó dos horas de trabajo al colega. La «productividad» de uno se convierte en pérdidas para todos.

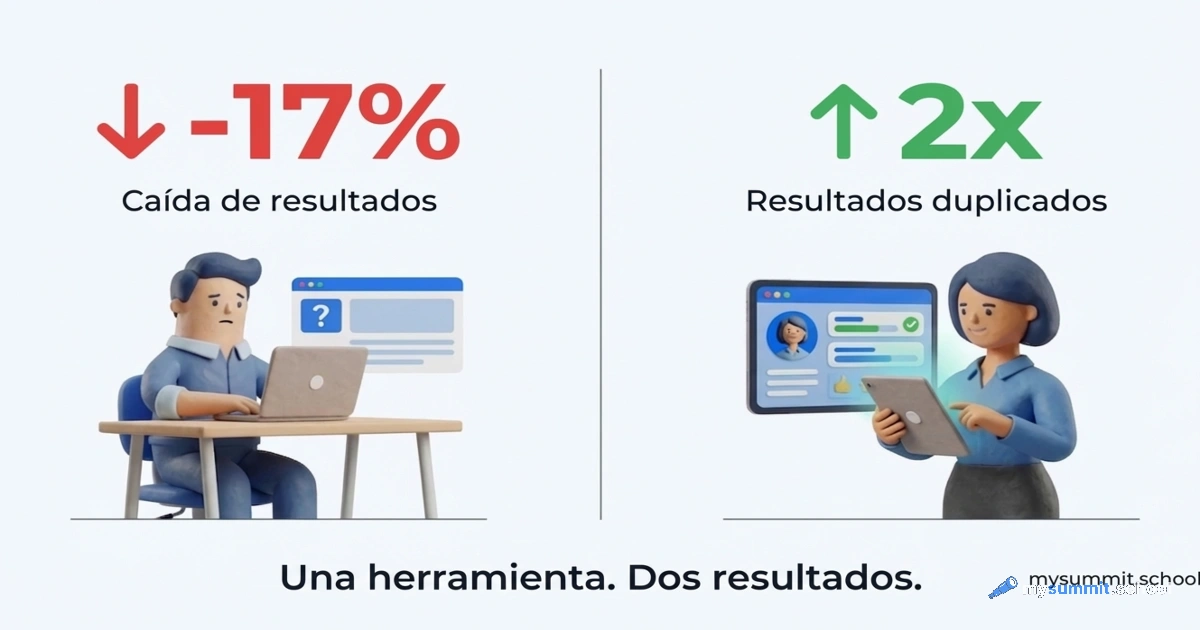

Pero BetterUp también encontró el patrón opuesto. El 28% de los empleados usa la IA como «pilotos» – editan activamente, verifican y enriquecen con su propio contexto. El 72% restante son «pasajeros» que delegan en la IA y envían el resultado sin revisión. La diferencia en resultados: los «pilotos» muestran una productividad 3,6 veces mayor y una lealtad 3,1 veces mayor hacia la empresa. Un patrón similar – la intensificación del trabajo mediante IA – está descrito en la investigación del Instituto para el Futuro del Trabajo.

Por qué las explicaciones no ayudan (pero la aprobación social sí)

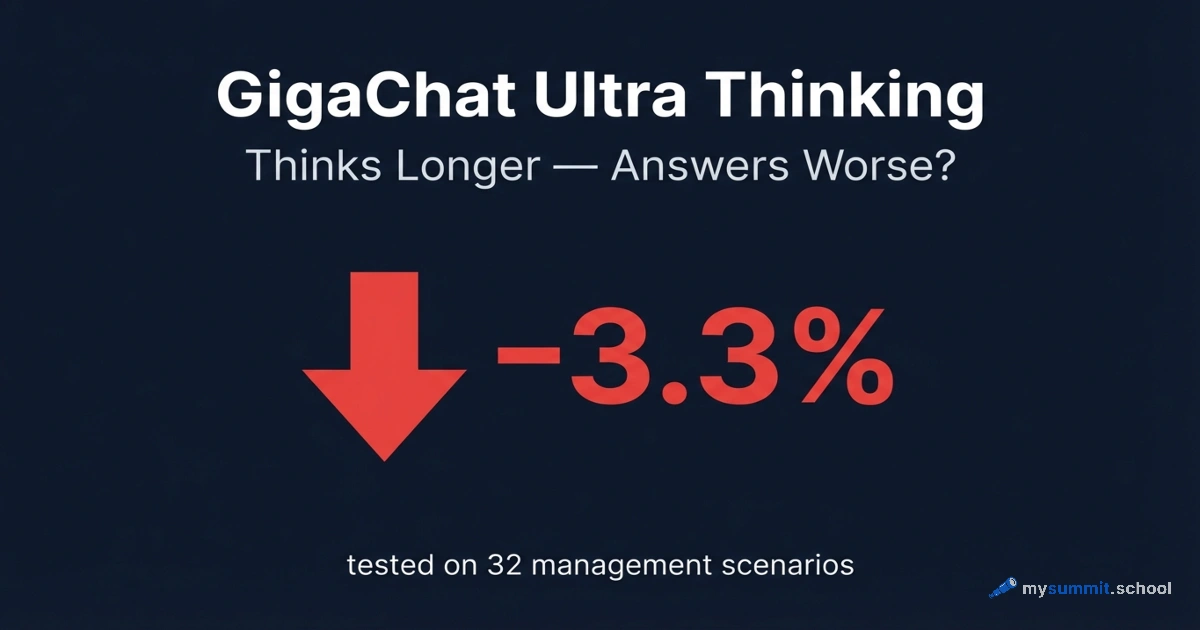

La solución intuitiva es hacer la IA más transparente: explicar cómo funciona, mostrar la lógica de las recomendaciones. Pero la investigación del Laboratorio de Ciencias de la Innovación de Harvard (LISH) descubrió el efecto contrario.

La escala del experimento: 17 245 decisiones de distribución de inventario en 425 referencias de producto en 186 tiendas. Cuando los gerentes veían la lógica del algoritmo – qué variables consideraba, qué pesos asignaba – comenzaban a ignorarlo con más frecuencia. Los investigadores llamaron a este mecanismo «depuración sobreconfiada» (overconfident troubleshooting): la transparencia creaba la ilusión de comprensión. «Veo lo que tiene en cuenta y yo lo sé mejor». La experiencia propia y la intuición vencían a los datos.

En cambio, la «caja negra» – el algoritmo sin lógica visible – obtenía significativamente más confianza. Con una condición: los empleados sabían que sus colegas habían participado en el desarrollo y prueba del sistema. Los investigadores llamaron a esto «aprobación social» (social proofing) – confianza en la tecnología a través de la confianza en las personas detrás de ella.

El efecto financiero fue medible: seguir las recomendaciones del algoritmo generaba +36,95 $ de ingresos adicionales por cada decisión de distribución en el cuarto quintil y +104,96 $ en el quintil superior. Los gerentes que ignoraban el algoritmo por su «lógica transparente» perdían dinero real.

El trabajo de Microsoft Research confirma esta paradoja: las explicaciones no reducen la confianza excesiva en la IA y, en algunos casos, la refuerzan. Los usuarios interpretan la presencia de explicaciones como una señal de que el sistema ha sido verificado – incluso si las explicaciones no son informativas. La investigación de Vasconcelos y colegas de Stanford demostró: las explicaciones reducen la confianza excesiva solo cuando son más simples que la propia tarea. Si la explicación es tan compleja como la tarea, el usuario racionalmente omite la verificación (nota: el estudio se publicó en 2023, pero abordaba un tema sensible – la vacunación).

La brecha entre la dirección y el equipo

La situación se complica por la radical divergencia en la percepción de la IA en distintos niveles de la organización – un patrón claramente visible en la implementación corporativa de la IA en general.

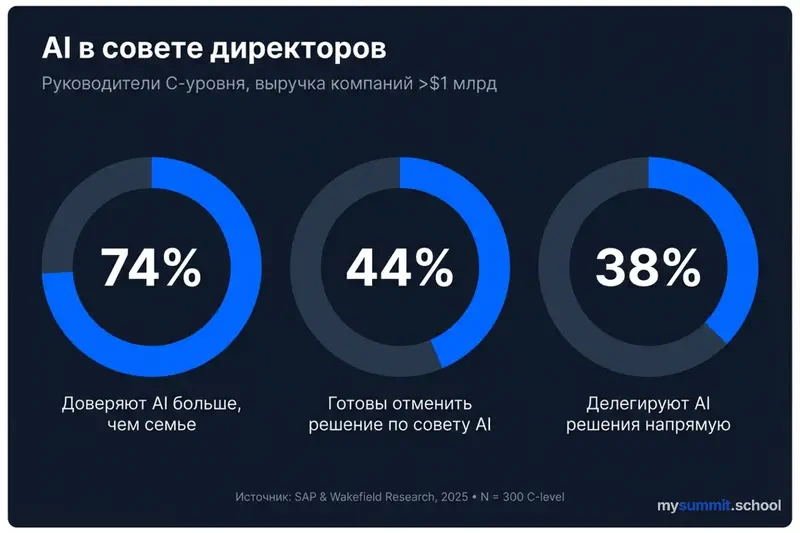

La investigación de SAP y Wakefield Research («AI Has a Seat in the C-Suite», marzo de 2025) encuestó a 300 ejecutivos de nivel C de empresas con facturación superior a 1 000 millones de dólares. Las cifras son sorprendentes:

- El 74% confía más en la IA que en familia y amigos para recomendaciones estratégicas

- El 44% está dispuesto a permitir que la IA revoque una decisión empresarial ya tomada

- El 38% delega la toma de decisiones directamente a la IA

- En empresas donde la IA ya sustituye los procesos tradicionales de toma de decisiones, esta proporción alcanza el 55%

En el nivel operativo, la dinámica es opuesta. Según los datos de BCG «AI at Work 2025» (más de 10 600 empleados, 11 países), el 72% de los trabajadores usa IA regularmente – pero es una media engañosa. El 78% de los mandos intermedios y más del 85% de los directivos trabajan con IA semanalmente, mientras que la adopción en primera línea se estancó en el 51% – una cifra que no ha cambiado desde 2023. Solo el 25% de los empleados de primera línea recibe alguna orientación de sus jefes sobre el uso de la IA, y apenas el 36% considera que su formación es suficiente.

Además, el 54% de los empleados está dispuesto a usar herramientas de IA incluso sin permiso de la empresa – la «IA en la sombra» crece. Y el 41% de los encuestados teme perder su empleo por la IA en los próximos diez años, y los directivos están más preocupados (43%) que los empleados de primera línea (36%).

La baja alfabetización en IA amplifica la brecha. Según HR Brew y Censuswide (2024), los empleados con baja alfabetización en IA experimentan 6 veces más ansiedad, 7 veces más miedo y 8 veces más abatimiento – en comparación con colegas alfabetizados en IA. Y el experimento de Jacobs y colegas (2021, 220 clínicos, prescripción de antidepresivos) demostró: los médicos con baja alfabetización en IA seguían las recomendaciones incorrectas del algoritmo 7 veces más a menudo.

Es el reflejo invertido del dilema de la transparencia: la dirección impone la IA «por eficiencia», los empleados responden con IA en la sombra «por supervivencia». La transparencia desde arriba genera opacidad desde abajo.

De la paradoja al protocolo: qué propone la ciencia

Las investigaciones no solo diagnostican el problema – proponen mecanismos concretos para salir del punto muerto. Cuatro estrategias, cada una con base empírica.

1. Normalización en lugar de revelación

Schilke y Reimann señalan un matiz clave: la penalización por autenticidad se activa cuando el uso de IA se percibe como atípico para ese rol. Un profesor usando IA para evaluar – atípico. Un analista usando IA para un informe – más cercano a la norma.

Conclusión: en lugar de decidir si revelar u ocultar, conviene hacer que el uso de IA sea normativamente esperado. Cuando todos en el equipo usan IA abiertamente, el componente de tipicidad deja de deteriorarse. Ya no es «sustituyó su trabajo con un algoritmo», sino «usó una herramienta estándar, como todos».

La experiencia de SAP SuccessFactors lo confirma: cuando la IA se integra en procesos rutinarios de asistencia – definición de objetivos, retroalimentación entre compañeros – deja de ser una excepción:

| Métrica | Cambio |

|---|---|

| Calidad de la retroalimentación (según empleados) | 80% consenso positivo |

| Frecuencia de retroalimentación (4+ veces al año) | +47% |

| Satisfacción con el proceso de definición de objetivos | +30% |

2. Aprobación social en lugar de transparencia técnica

La investigación de Harvard en Tapestry ofrece una receta concreta: involucrar a los usuarios finales en la selección, prueba y validación de las herramientas de IA. Cuando los empleados saben que colegas con experiencia similar participaron en el desarrollo del sistema, la confianza en la «caja negra» resulta mayor que en un algoritmo transparente.

Esto escala: no hace falta explicar a cada persona cómo funciona el modelo. Basta con que las personas en quienes confía el equipo digan: «Lo probamos – funciona». Los datos de BetterUp complementan: la formación en habilidades relacionales (escuchar, hacer preguntas, dar contexto) aumenta la interacción de los empleados con la IA en un 30% y mejora la calidad de los resultados.

3. Puntos de fricción cognitiva en lugar de aceptación automática

Bucinca y colegas (2021, 199 participantes, Harvard) demostraron: si se pide a una persona que primero piense por sí misma y luego vea la respuesta de la IA, confiará menos ciegamente en el modelo. Microsoft Research identifica tres mecanismos concretos:

- Señales de incertidumbre: una IA que dice «no estoy segura de esta respuesta» reduce la dependencia excesiva de forma más eficaz que indicadores numéricos como «confianza del 73%». Lo primero activa el pensamiento crítico; lo segundo crea una ilusión de precisión.

- Autocrítica de la IA: un modelo que argumenta en contra de su propia conclusión ayuda al usuario a ver los puntos débiles. Es uno de los patrones más prometedores de la síntesis de 2025.

- Juicio previo: el usuario formula su respuesta antes de ver la recomendación de la IA. Un simple cambio en el orden de las acciones lo cambia todo.

Pero hay una salvedad importante: los usuarios calificaron estas interfaces como las menos cómodas. Existe una correlación inversa entre eficacia y atractivo. Lo que funciona, molesta. Lo que gusta, no ayuda. Al implementar estos mecanismos, es necesario dar explicaciones claras de por qué se hace.

4. «Pilotos», no «pasajeros»

BetterUp y Stanford proponen un marco claro. El 28% de empleados-«pilotos» – quienes editan activamente, verifican y enriquecen el resultado de la IA con contexto – muestran una productividad 3,6 veces mayor y una lealtad 3,1 veces mayor. El 72% restante son «pasajeros» que delegan en la IA sin revisión.

La diferencia no está en la herramienta, sino en la actitud. Y esa actitud es entrenable: los empleados que recibieron formación en habilidades relacionales interactúan un 30% más activamente con la IA y producen contenido de mayor calidad. Las organizaciones que establecen reglas claras para el uso de la IA, definen escenarios concretos y refuerzan el juicio humano se enfrentan significativamente menos al workslop.

Qué hacer con todo esto: mapa de acción

Los datos señalan pasos concretos para el manager que usa IA y gestiona un equipo que la usa.

Para la comunicación personal:

- En lugar de «Esto lo escribió una IA», diga «Lo preparé con ayuda de IA y lo adapté a nuestro contexto». El foco en tu contribución, no en la herramienta – así evitas tanto la penalización por autenticidad como la penalización por engaño.

- Añade huellas de pensamiento humano: experiencia personal, ejemplos concretos de trabajo conjunto, referencias a conversaciones anteriores – todo lo que la IA no puede saber.

- Formula tu posición antes de activar la IA. Esto te convierte de «pasajero» en «piloto» – y reduce el riesgo de aceptar ciegamente la respuesta de la IA.

Para la gestión del equipo:

- Conviene implementar auditorías de proceso: evaluar no el resultado pulido, sino el camino hasta él – borradores, iteraciones, puntos donde el empleado discrepó con la IA.

- El uso de IA debería normalizarse en el equipo: cuando todos trabajan abiertamente con IA, el componente de tipicidad deja de deteriorarse.

- Construye confianza social: involucra al equipo en la selección y prueba de herramientas de IA. La investigación de Harvard en Tapestry demostró que la confianza en el sistema crece a través de la confianza en los colegas que lo aprobaron.

- Da la IA a las manos, no sobre la cabeza. La experiencia de SAP: la IA para asistir al empleado genera confianza; la IA para controlar la destruye.

- Cierra la brecha de alfabetización en IA. Los médicos con baja alfabetización en IA seguían recomendaciones incorrectas 7 veces más. La formación no es optativa, es infraestructura de confianza.

El dilema de la transparencia no tiene solución perfecta. La revelación reduce la confianza un 7–18%. Ocultarlo la destruye cuando la verdad sale a la luz. Pero entre estos dos polos hay una zona funcional: usar la IA como herramienta, no como autora. Añadir tu voz, no delegarla.

Quizás convenga distinguir dos preguntas: «¿Escribió esto una IA?» y «¿Hay detrás de este texto una persona a quien le importa?». La primera pregunta es sobre tecnología. La segunda es sobre relaciones. Y es la respuesta a la segunda la que determina si conservarás la confianza.

La IA escribe – tú decides cómo presentarlo

Módulo abierto del curso: cómo usar la IA en la comunicación profesional manteniendo la confianza de clientes y colegas.

Continúa aprendiendo

Abre el libro de texto y continúa donde lo dejaste

Cómo la IA ayudó a crear este artículo (siguiendo nuestras propias recomendaciones – lo revelamos):

- Exploración del tema. La IA ayudó a encontrar y sistematizar investigaciones, artículos y casos sobre el tema. Pero cada fuente fue leída por una persona, los datos se verificaron en las publicaciones originales y el borrador del artículo se escribió a mano.

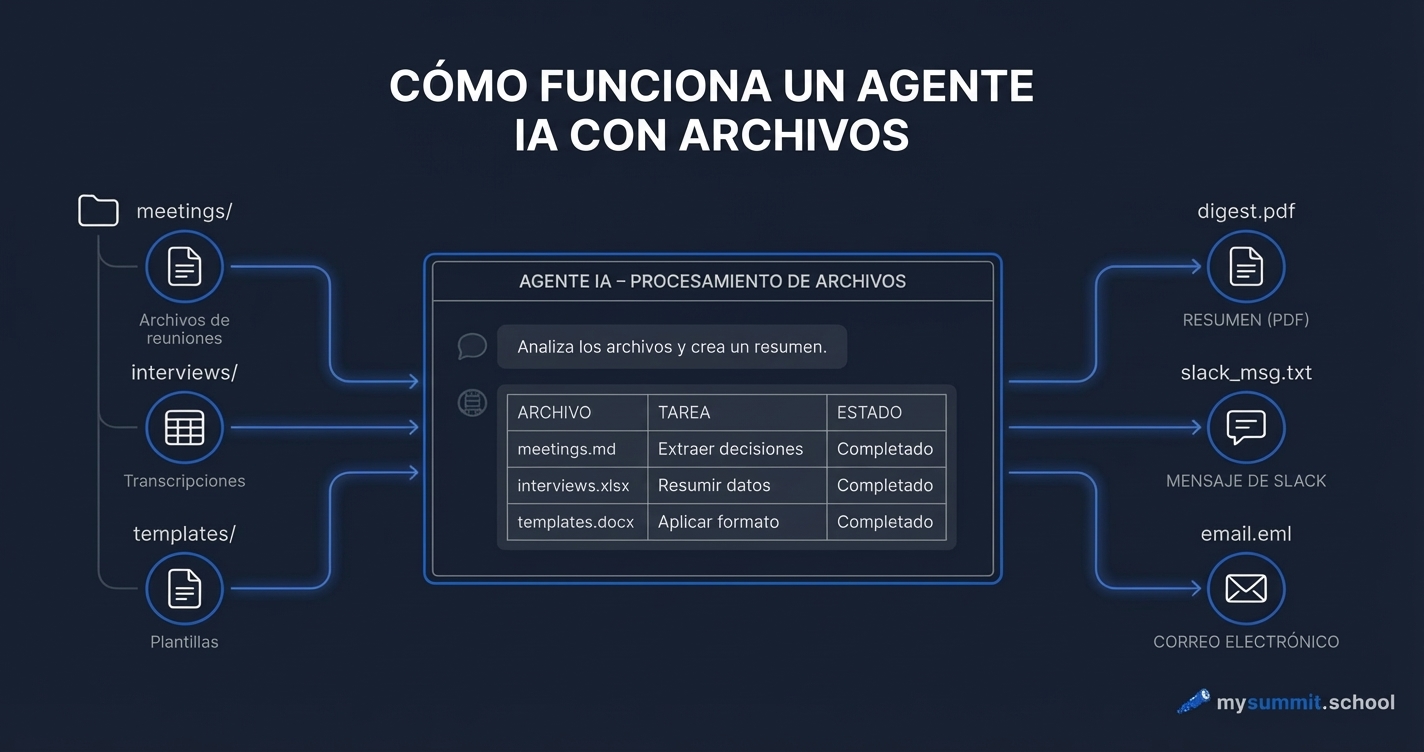

- Infografías. Todas las imágenes fueron generadas por IA. Pero los prompts – descripciones de datos, composición y fuentes – fueron escritos por una persona basándose en las investigaciones leídas.

- Edición. La IA revisó la estructura del artículo para verificar su conformidad con los estándares editoriales y el enfoque en la audiencia. Pero los propios estándares, la voz de marca y la política editorial fueron desarrollados por nosotros.

Somos «pilotos», no «pasajeros».

Fuentes

- Schilke, O. & Reimann, M. (2025). The authenticity penalty of AI disclosure. Organizational Behavior and Human Decision Processes, 188. DOI

- Niederhoffer, K. & Hancock, J. (2025). AI-generated workslop is destroying productivity. Harvard Business Review. HBR

- Jain, G., Pareek, S. & Carlbring, P. (2024). Perception of AI-generated mental health responses. Internet Interventions, 38. DOI

- BCG (2025). AI at Work 2025: Momentum Builds, but Gaps Remain. BCG

- SAP & Wakefield Research (2025). AI Has a Seat in the C-Suite. SAP

- Bucinca, Z. et al. (2021). To trust or to think: Cognitive forcing functions. Proceedings of the ACM on Human-Computer Interaction, 5(CSCW1). DOI

- Vasconcelos, H. et al. (2023). Explanations can reduce overreliance on AI systems during decision-making. Proceedings of the ACM on Human-Computer Interaction, 7(CSCW1). DOI

- Jacobs, M. et al. (2021). How machine-learning recommendations influence clinician treatment selections. Translational Psychiatry, 11, 108. DOI

- Microsoft Research (2024). Appropriate Reliance on GenAI. PDF