Cuándo la IA perjudica el aprendizaje – y cuándo duplica los resultados

En marzo de 2025, en SXSW EDU, la asesora en prospectiva estratégica Sinead Bovell presentó una conferencia sobre la IA y el futuro de la educación. Sin euforia y sin alarma. Pero con dos estudios que cambian la forma de pensar sobre el papel de la IA en el aprendizaje.

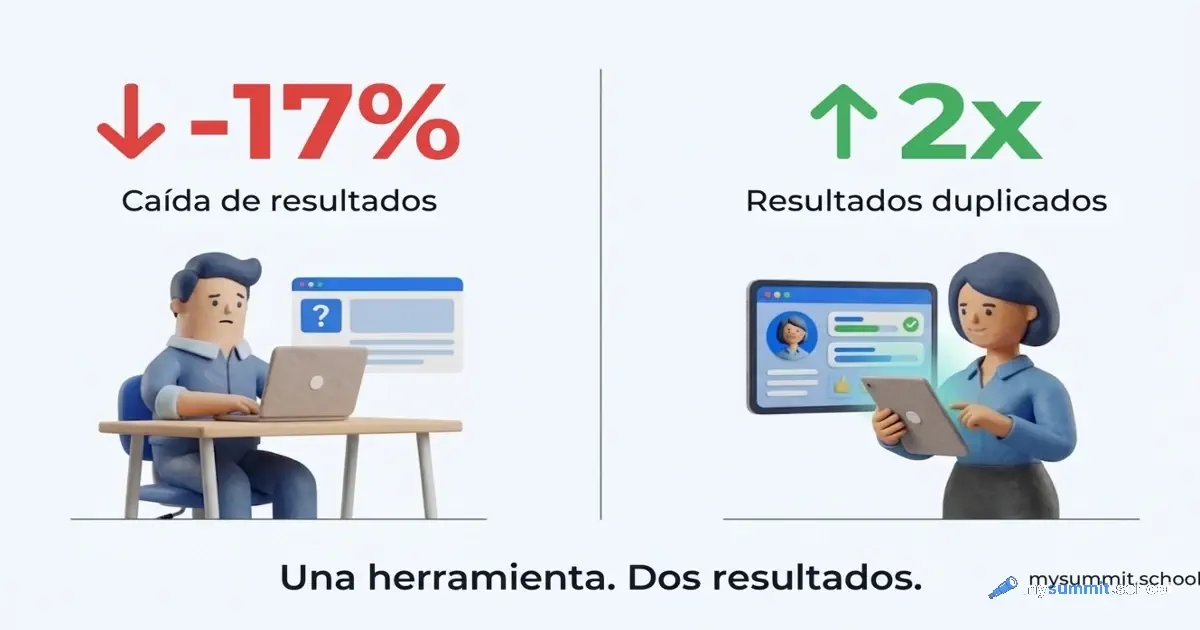

El primero: un grupo de estudiantes que usó ChatGPT sin restricciones obtuvo resultados un 17% peores que el grupo de control que trabajó con el libro de texto. El segundo: otro grupo, donde la IA se aplicó dentro de un sistema de aprendizaje completamente rediseñado, duplicó los resultados frente a la clase magistral tradicional.

La misma herramienta. Resultados opuestos. La diferencia está en el enfoque.

Попробуйте ИИ на 9 реальных задачах – бесплатно, без регистрации. Увидите, где он помогает, а где создаёт ложную уверенность.

Sin pago requerido • Notificación al lanzamiento

El experimento de Wharton: cuándo la IA es contraproducente

Investigadores de la Wharton School (Universidad de Pensilvania) junto con docentes de la Budapest British International School dividieron a los estudiantes en tres grupos. El grupo de control trabajó con el libro de texto. El grupo «GPT-base» usó ChatGPT sin restricciones. El grupo «GPT-tutor» trabajó con un tutor de IA guiado.

Durante la práctica, la brecha de rendimiento parecía una victoria clara de la IA: el grupo «GPT-base» completaba las tareas un 48% mejor, y el grupo «GPT-tutor» un 127% mejor que el grupo de control.

Pero luego retiraron la IA. Y pidieron a los estudiantes que hicieran el examen final solos.

El grupo «GPT-base» obtuvo un resultado un 17% peor que los estudiantes con libro de texto. El grupo «GPT-tutor» quedó al mismo nivel que el grupo de control, ni mejor ni peor.

No es un caso pedagógico aislado. Según Bovell, la conclusión es universal: la IA generativa sin restricciones perjudica la asimilación del contenido. Los estudiantes obtenían las respuestas correctas sin pasar por el trabajo cognitivo que genera la comprensión real. Cuando se retiró la IA, resultó que esa comprensión nunca había existido.

El estudio pasó revisión por pares y fue publicado en PNAS en junio de 2025, lo que lo eleva de «experimento interesante» a evidencia científica verificada.

El mismo patrón aparece en experimentos de menor escala. En una escuela pública estadounidense con financiamiento reducido, investigadores de la Universidad de Illinois configuraron la IA ajustándola estrictamente a la rúbrica de un docente concreto: seis criterios de evaluación de ensayos, materiales exclusivamente del programa. Resultado: 5 de 6 alumnos mejoraron sus trabajos. La diferencia clave con «GPT-base»: la IA no daba respuestas, señalaba exactamente qué debía corregirse según criterios específicos. Los alumnos describían el feedback como «direct» y «fixable»: concreto y con pasos de acción claros.

El experimento de Harvard: cuándo la IA funciona el doble de bien

La segunda parte de la conferencia de Bovell es el estudio de Harvard sobre física, que llega a una conclusión radicalmente opuesta. El grupo que trabajó con IA superó en dos veces al grupo de la clase magistral tradicional.

Lo llamativo es que aquí no hubo ningún prompt mágico ni ningún modelo especial. La diferencia estaba en otra parte: para el grupo con IA se rediseñó por completo el sistema de aprendizaje. Los estudiantes trabajaban a su propio ritmo, recibían retroalimentación inmediata en cada paso y el sistema se adaptaba a sus lagunas en tiempo real.

No fue «añadir IA a las clases». Fue rediseñar todo el proceso en torno a las nuevas capacidades de la herramienta. La muestra fue de unos 194 estudiantes, suficiente para conclusiones preliminares, aunque no definitivas.

Bovell formula la conclusión clave de forma directa: si simplemente insertas la IA en un proceso existente sin cambiar su lógica, lo más probable es que obtengas el primer escenario. Si rediseñas el sistema desde cero, aparece la posibilidad del segundo.

Alpha School: dos horas en lugar de seis

Uno de los ejemplos más provocadores de la conferencia es la escuela Alpha. Allí los niños trabajan con un tutor de IA dos horas al día en competencias académicas sólidas. El resto del tiempo se dedica a habilidades para la vida, inteligencia emocional, proyectos y comunicación.

Resultado: percentil 99 en rendimiento académico. Algunos alumnos asimilan en dos horas lo que en una escuela convencional les llevaría 5 a 10 horas.

El mecanismo es el mismo que en el estudio de Harvard: retroalimentación inmediata y adaptativa al propio ritmo. El alumno no espera a que el profesor corrija los cuadernos. El sistema detecta el error en el momento en que se produce y vuelve al punto exacto donde se necesita, no una semana después, sino en cuestión de segundos.

La pregunta escéptica surge sola: ¿qué ocurre con los conocimientos que el estudiante adquirió «con IA» pero no puede reproducir sin ella? Bovell no esquiva el tema. Su respuesta: la línea no pasa entre «usó IA» y «no usó IA», sino entre «pensó» y «no pensó». Un tutor guiado que hace preguntas y exige explicaciones mantiene el pensamiento activo durante el proceso. Una herramienta que simplemente entrega respuestas lo destruye.

La crisis del plagio y la crisis de confianza

Bovell describe dos fenómenos que a primera vista parecen opuestos, pero en realidad son dos caras de lo mismo.

El primero: los escolares escriben sus ensayos en ChatGPT después de las 3 de la tarde, y esto se ha convertido en la norma. Los datos lo confirman: el 86% de los escolares en EE.UU. usa IA en sus estudios, mientras que el 70% de los docentes observa un deterioro del pensamiento crítico. Bovell llama a esto «la suposición más segura»: si un trabajo se hizo en casa, probablemente se hizo con IA. La respuesta no es intentar atrapar a los infractores (es una carrera que los docentes inevitablemente pierden), sino invertir la lógica: el aprendizaje profundo y las evaluaciones ocurren en clase; la investigación con IA, en casa. Más controles sorpresa donde no es posible recurrir a herramientas externas.

El segundo fenómeno es más inesperado. Los estudiantes reemplazan sus ensayos escritos a mano con textos de ChatGPT, incluso cuando eso no les ahorra tiempo. No por pereza. Por falta de confianza en sí mismos. No confían en su propio pensamiento.

Esto es más grave que el problema del plagio. El estudio de Microsoft Research que cita Bovell muestra que la dependencia excesiva de la IA reduce la capacidad de pensamiento crítico. La persona deja de ejercitar el juicio y, gradualmente, pierde la fe en él.

9 уроков с реальными задачами – бесплатно. Видно, где AI помогает думать, а где заменяет мышление.

Sin pago requerido • Notificación al lanzamiento

Emprendedores y pensamiento: quién sale ganando con la IA

Uno de los datos más incómodos de la conferencia es el estudio sobre emprendedores. Los emprendedores de alto rendimiento con pensamiento crítico sólido mostraban resultados significativamente mejores al trabajar con IA. Los de bajo rendimiento, resultados peores.

La diferencia no está en el modelo. Está en qué preguntas se hacen y qué se hace con las respuestas.

El emprendedor de alto rendimiento llega a la IA con un problema estratégico ya estructurado mentalmente. Sabe exactamente qué quiere verificar, qué supuestos hay que cuestionar, qué datos faltan. La IA acelera su pensamiento. El emprendedor de bajo rendimiento llega con una consulta vaga y acepta la primera respuesta, sin saber si la pregunta fue la correcta.

Esto lleva a reflexionar sobre lo que suele llamarse «democratización de la IA». La herramienta es, en efecto, accesible para todos. Pero amplifica lo que ya existe. Si hay pensamiento crítico, se potencia. Si no lo hay, la IA crea una ilusión de competencia sin su contenido real.

Las habilidades más importantes del futuro no tienen que ver con la tecnología

Este es, quizás, el planteamiento más inesperado de Bovell. Con toda su temática de prospectiva estratégica en IA, habla de habilidades que no tienen ninguna relación con la tecnología.

Pensamiento crítico. Lectura. Juego. Pensamiento a largo plazo. Capacidad para trabajar en la intersección de disciplinas.

Este último lo argumenta con datos concretos: los niños de hoy cambiarán unas 17 veces de trabajo en 5 sectores distintos a lo largo de su carrera. La única habilidad que funciona en 17 empleos y 5 sectores es la capacidad de moverse entre dominios y ver conexiones donde el especialista estrecho no las distingue.

¿Pero por qué estas habilidades forman parte de una conferencia sobre IA? Porque son precisamente las que determinan si acabarás en la categoría «la IA potencia» o «la IA perjudica». El experimento de Wharton no trata de ChatGPT. Trata de lo que ocurre cuando una herramienta reemplaza el pensamiento en lugar de apoyarlo.

La observación más práctica: la mayoría de estas habilidades se desarrollan de forma gratuita. Leer más libros. Jugar a juegos de estrategia. Debatir decisiones en voz alta. Hacerse preguntas incómodas. No son nuevas tecnologías educativas; son prácticas antiguas que el scroll y la externalización del pensamiento a la IA están desplazando.

Tres niveles de respuesta al desafío

Bovell describe tres niveles en los que la educación debe responder a la IA.

El primer nivel es la implementación segura. Hay que explicar a los niños qué es la IA, cómo funciona, qué puede y qué no puede hacer. No «aquí tienes una herramienta», sino «esto es lo que ocurre bajo el capó y por qué no se puede confiar ciegamente en una respuesta».

El segundo nivel es la adaptación de las prácticas. Si se sabe que los niños usan IA fuera de la escuela, hay que reestructurar lo que ocurre en el aula. Definir dónde el uso de la IA es legítimo y dónde no, e integrarlo en el proceso de aprendizaje en lugar de prohibirlo por decreto.

El tercer nivel es el rediseño fundamental. No «añadir IA al programa existente», sino repensar todo el proceso desde cero. El experimento de Harvard operaba en este nivel. Y es precisamente el que produce el doble de resultados en lugar del menos 17%.

Bovell aclara específicamente que la tarea del tercer nivel no corresponde a los docentes. Es tarea de los gobiernos, los responsables de los sistemas educativos y los diseñadores curriculares. Los profesores ya desempeñan los roles de trabajador social, psicólogo y mentor en paralelo a su función principal. Añadir encima el replanteamiento sistémico de la pedagogía significa trasladar la responsabilidad institucional a alguien que no tiene ni el tiempo ni la autoridad para asumirla.

¿Es esto un problema real y no una abstracción? Los datos de Microsoft de 2025: el 67% de los directores de escuela cree que los docentes están formados para trabajar con IA. El 57% de los propios docentes dice que no ha recibido ninguna preparación. El tercer nivel de Bovell no es teoría. Es lo que ya está ocurriendo sin una respuesta sistémica.

Un problema adicional es la calidad de lo que la IA genera para los docentes. El análisis de lecciones generadas por IA mostró que el 45% se queda en el nivel «recordar» de la taxonomía de Bloom. Solo el 4% llega al análisis o la creación. La IA le ahorra tiempo al docente, pero no mejora lo que produce con ese tiempo. Sin entender los principios de funcionamiento de la IA, la lección parece atractiva pero se mantiene en la profundidad cognitiva de un libro de ejercicios.

Dónde estamos ahora: el año 1992 de internet

Bovell cierra la conferencia con una metáfora que merece reflexión aparte. La IA hoy es aproximadamente el año 1992 para internet. La tecnología la entiende un número reducido de personas, todos los demás acaban de empezar a explorarla y Google y Amazon todavía no existen.

La electricidad no desapareció. Simplemente dejó de ser objeto de conversación. Nadie piensa hoy: «¿Cómo voy a usar la electricidad en mi vida?». Simplemente está ahí: en las bombillas, los servidores, los ascensores, los teléfonos.

La IA se dirige al mismo punto. No en el sentido de «no hay nada que preparar». En el sentido de que quienes aprenden a trabajar con la herramienta ahora, cuando todavía es visible, obtienen una ventaja precisamente porque entienden los principios, no solo pulsan botones. Cuando la IA sea invisible como la electricidad, pulsar botones ya no será una ventaja competitiva.

La persona que en 1995 entendía cómo funciona HTTP y por qué PageRank contaba los enlaces como votos tenía un horizonte de posibilidades radicalmente distinto en 2005, no porque escribiera código, sino porque entendía la lógica. El experimento de Wharton muestra que lo mismo vale para la IA. Entender por qué la herramienta perjudica en un escenario y ayuda en otro es más importante que saber pulsar «generar» con rapidez.

Попробуйте ИИ на реальных задачах – и увидьте, где ошибаетесь

Полная программа курса: от основ промпт-инжиниринга и критического мышления до специализаций по проектному управлению и аналитике. Практические задания на реальных управленческих кейсах – галлюцинации, утечки данных, ложная эффективность.

Qué implica esto para el docente

Si se condensan la conferencia de Bovell y los datos de los estudios en acciones concretas, se obtiene una lista corta.

Ahora mismo:

- Partir del supuesto de que los deberes se hacen con IA. No combatirlo, sino trasladar el aprendizaje profundo y la evaluación al aula.

- Incorporar controles breves y sorpresa sin acceso a dispositivos, no para calificar, sino para tener visibilidad del conocimiento real.

- Explicar a los alumnos cómo funciona la IA: qué son las alucinaciones, por qué no se puede confiar en una respuesta sin verificarla, que la IA es una herramienta y no un amigo.

A medio plazo:

- Si la escuela implementa un tutor de IA, exigir retroalimentación inmediata y adaptación al ritmo del alumno. Sin estos dos elementos, la IA probablemente perjudica más de lo que ayuda.

- Invertir la lógica de los deberes: la investigación con IA va a casa; el debate, el análisis crítico y la defensa de conclusiones ocurren en clase.

Lo que no es tarea del docente:

- El rediseño fundamental del programa es trabajo de ministerios, diseñadores curriculares y responsables de los sistemas educativos. El docente ya acumula una decena de roles simultáneos.