LLMs locales para managers: qué se puede ejecutar en casa de verdad

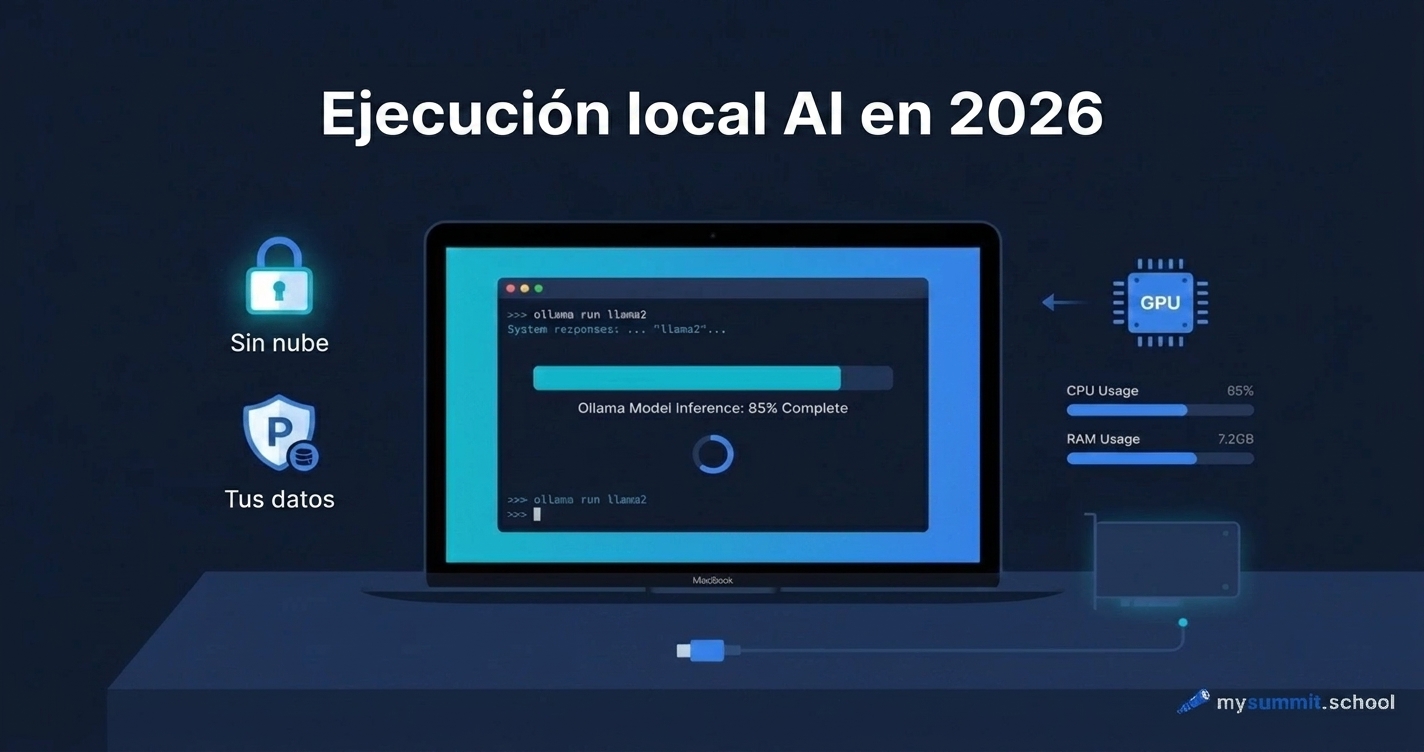

Cualquiera que lleve el tiempo suficiente trabajando con ChatGPT o Claude termina haciéndose la misma pregunta: ¿se puede ejecutar algo parecido directamente en el portátil, sin suscripción, sin que los datos salgan de casa y sin depender de servidores remotos?

La respuesta, en 2026, es que sí – pero con matices que importan más que la propia respuesta.

Este artículo es para quienes ya usan LLMs en la nube y quieren entender qué aporta realmente ejecutar una modelo en local, qué hardware hace falta y dónde terminan las expectativas razonables. Sin inmersión técnica profunda, pero con cifras concretas.

Leer más