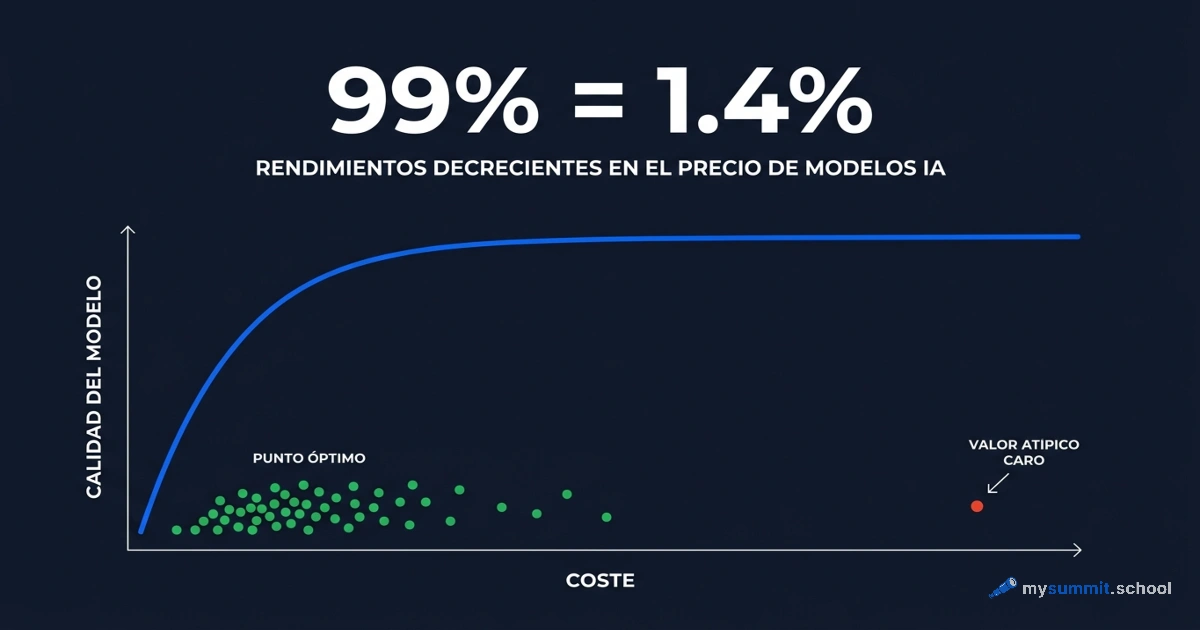

99% de calidad por 1,4% del precio: qué falla en el mercado de modelos de IA

La mayoría de los managers eligen un modelo de IA así: cogen el más caro disponible. La lógica es comprensible – más caro significa mejor. Así ha funcionado con el software empresarial durante los últimos veinte años.

El mercado de modelos de IA en 2026 funciona de otra manera. El coste de una sola consulta varía de $0,0001 a $0,17 – tres órdenes de magnitud. ¿Y la diferencia real de calidad entre los diez mejores modelos? 0,24 puntos en una escala de cinco. Mientras tanto, Wharton / GBK Collective constata que un tercio de los proyectos corporativos de IA no pasan de la fase piloto. Y Epoch AI muestra que solo el 5,6% de los usuarios aplica la IA de forma realmente profunda.

Quizás la pregunta no es qué modelo es mejor, sino si pagar de más por el premium produce un resultado proporcionalmente mejor en tareas de gestión típicas.

Lo comprobamos. La respuesta fue más dura de lo esperado.

Leer más