La IA no te hace más tonto. El problema es cómo la usas

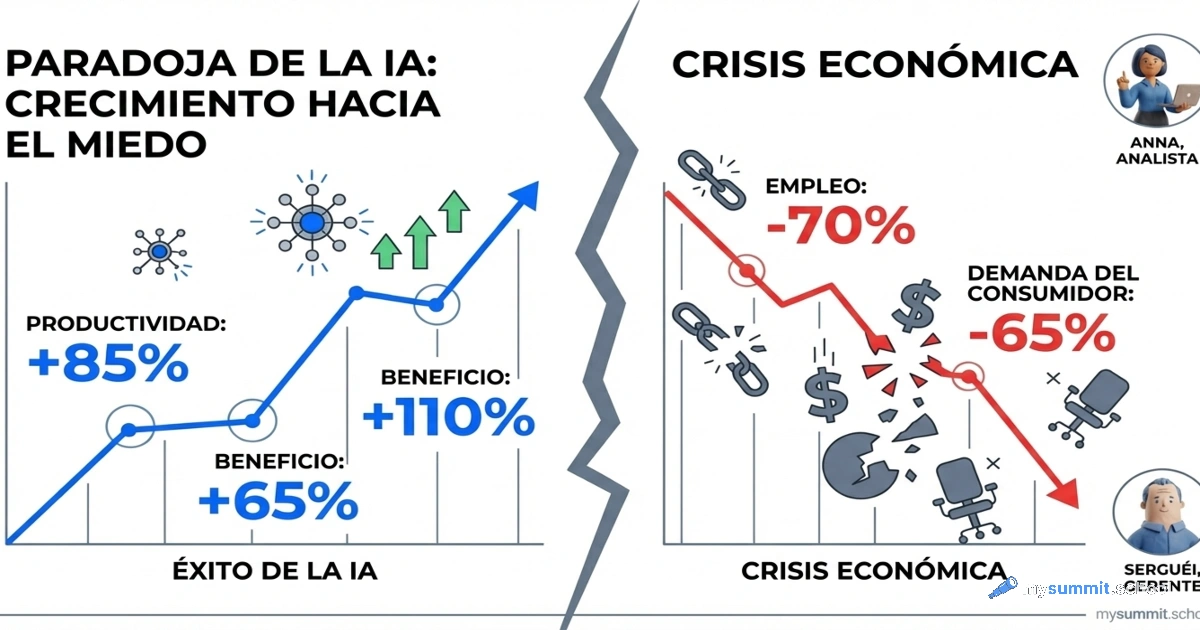

Hace año y medio escribí una nota en mi blog personal sobre algo que observaba en el trabajo de mis colegas y en el mío propio: cuanto más confías en la IA, con menos frecuencia te preguntas «¿esto realmente es correcto?». En aquel momento me basaba en un estudio de Microsoft que mostraba que la confianza en la IA suprime la evaluación crítica de las respuestas generadas. El argumento me parecía sólido, pero tenía un defecto evidente: correlación, no causalidad.

En febrero de 2026, los investigadores de Anthropic Judy Shen y Alex Tamkin publicaron un experimento que cerró esa brecha. Control aleatorizado. Datos concretos. Y una conclusión que, en mi opinión, la mayoría de quienes la leyeron interpretaron mal.

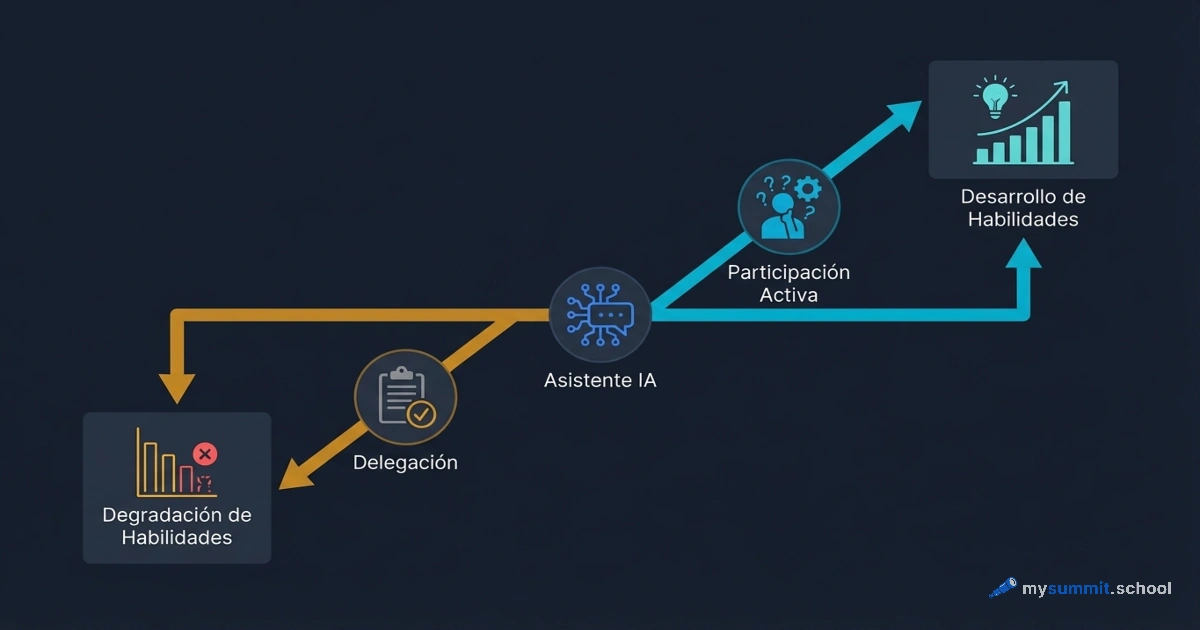

Porque no es una historia sobre cómo la IA nos hace más tontos. Es una historia sobre cómo exactamente la utilizamos.

Leer más