Para qué aprender AI en cursos si todo está en ChatGPT: análisis basado en ciencia

“¿Para qué necesito sus cursos si puedo simplemente preguntarle a ChatGPT?”

Esta pregunta aparece en los comentarios de cada publicación sobre formación en AI. La lógica es impecable: internet es gratis, ChatGPT explica lo que sea, YouTube está lleno de tutoriales. ¿Para qué pagar por un curso si toda la información ya está disponible?

La pregunta es excelente. La respuesta – no es la que esperan escuchar.

Porque entre “tener acceso a la información” y “saber trabajar con ella” – hay un abismo. El acceso a manuales médicos no te convierte en médico. Tener un cuchillo de cocina no te convierte en chef. Y la posibilidad de hacerle una pregunta a ChatGPT no te convierte en especialista en AI. Como demuestra la investigación del MIT sobre la toma de decisiones, la verdadera fortaleza de un especialista no está en tener la herramienta, sino en la capacidad de evaluar críticamente lo que la herramienta propone.

Y esto no es solo una metáfora bonita – es un hecho respaldado por investigaciones.

La ilusión de profundidad de comprensión: tu cerebro te engaña

Empecemos por lo incómodo. Existe un sesgo cognitivo llamado Illusion of Explanatory Depth (IOED) – la ilusión de profundidad explicativa. En esencia: las personas sobreestiman sistemáticamente cuán profundamente entienden las cosas complejas. Creen que dominan un tema mucho mejor de lo que realmente lo hacen – hasta que les piden explicarlo sin ayuda.

Investigadores de Cambridge University Press descubrieron que la ilusión solo se disipa cuando se obliga a la persona a explicar el concepto por sí misma, sin fuentes externas. Hasta ese momento, está genuinamente convencida de que entiende.

La IA generativa hace este problema significativamente peor.

Cuando le haces a ChatGPT una pregunta sobre machine learning, recibes una respuesta perfectamente estructurada, gramaticalmente impecable, sintácticamente impecable. La respuesta se lee con facilidad. Es lógica. “Tiene sentido”. Y tu cerebro en ese momento comete un error crítico: confunde la fluidez de consumo de información con comprensión real.

No estudiaste el tema. Leíste un texto bonito sobre el tema. Son cosas fundamentalmente distintas.

Una investigación publicada en PubMed lo confirma: cuando los estudiantes usan LLMs como fuente principal de conocimiento, sustituyen inconscientemente la comprensión profunda por la capacidad de obtener la respuesta correcta de la máquina. Su sensación de competencia crece, mientras sus habilidades reales de pensamiento crítico – se atrofian. Una investigación del MIT documentó el mismo patrón: el 86% de los estudiantes usa AI, pero la mitad pierde la conexión con el profesor.

La formación estructurada combate esto de frente. A través de tareas iterativas, evaluaciones orales, trabajo en grupo y situaciones donde no se puede “preguntarle a la AI” – se obliga a los estudiantes a enfrentarse a los límites reales de su comprensión. Es incómodo. Pero es exactamente lo que funciona.

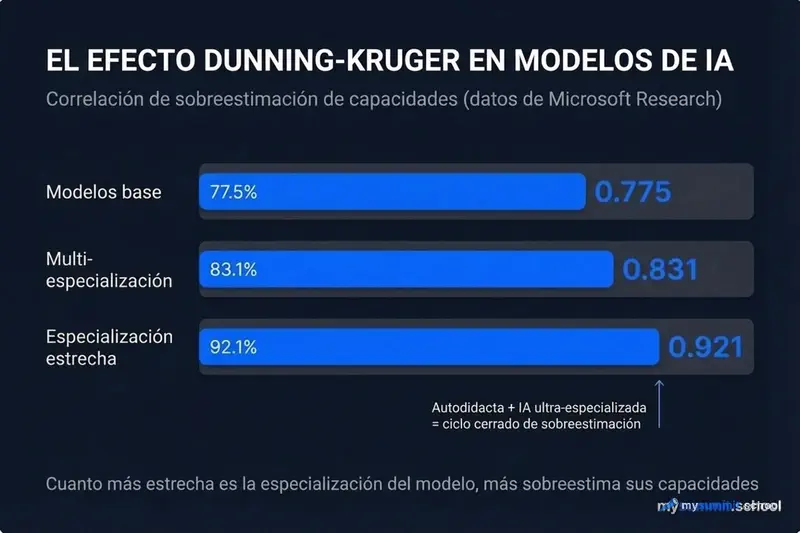

El efecto Dunning-Kruger: versión AI

Si la ilusión de profundidad trata sobre la sobreestimación de la comprensión, el efecto Dunning-Kruger trata sobre la sobreestimación de las habilidades. Las personas con competencia mínima en un área sobreestiman sistemáticamente sus capacidades, porque les falta la experiencia para reconocer sus propios errores.

En el contexto de AI, esto funciona así. Una persona aprendió a generar código con ChatGPT. El código compila, funciona, resuelve la tarea. La persona decide que domina la programación. Mientras tanto, no detecta errores de arquitectura, vulnerabilidades de seguridad, problemas de escalabilidad e ineficiencias – porque para detectarlos se necesita una experticia que no tiene.

Una investigación de Microsoft Research lo confirmó: los propios modelos de AI exhiben patrones análogos al efecto Dunning-Kruger. Generan respuestas seguras en áreas donde su competencia es mínima. El autodidacta que se apoya en un modelo así como única fuente de conocimiento cae en un ciclo cerrado: estudiante sobreconfiado + AI sobreconfiada = ilusión sostenida de competencia. Sorprendentemente, una investigación de Anthropic demostró: los sistemas de AI no solo cometen errores – se comportan de manera inconsistente, lo que hace la detección de errores sin experticia aún más difícil.

Un profesor o mentor rompe este ciclo. Un experto real ve errores que tú no puedes ver. Hace preguntas que a ChatGPT no se le ocurriría hacer. Crea situaciones donde tu desconocimiento se hace evidente – y precisamente desde ese momento comienza el aprendizaje real.

La cascada de aprendizaje superficial

Los investigadores describieron un fenómeno que llamaron “From Superficial Outputs to Superficial Learning” – la cascada de degradación desde respuestas superficiales de la AI hacia un aprendizaje superficial del estudiante. Una revisión sistemática de los riesgos de los LLM en la educación reveló el modelo “LLM-Risk Adapted Learning”, que demuestra cómo las limitaciones técnicas de la AI se transforman directamente en pérdidas cognitivas del estudiante.

Cuando un autodidacta depende de internet y la IA generativa como método principal de aprendizaje, se produce una degradación documentada de los procesos cognitivos:

Primer efecto – reducción de la actividad neuronal: la carga cognitiva asociada con la recopilación y síntesis de información es asumida por la máquina. Pero esa misma carga es la lucha neurológica productiva necesaria para la codificación profunda en la memoria y la plasticidad estructural del cerebro.

Segundo – pérdida de habilidades de aprendizaje autónomo: el estudiante pierde la capacidad de buscar, verificar, comparar y sintetizar información contradictoria, confiando completamente en los algoritmos opacos de sumarización de la AI.

Tercero – pérdida de agencia de aprendizaje: el proceso de aprendizaje se vuelve reactivo, el estudiante sigue las conclusiones de la máquina en lugar de generar hipótesis, hacer preguntas y realizar su propio análisis.

Los LLMs reducen la carga cognitiva para completar la tarea – pero no contribuyen a esa inmersión profunda en el material que es necesaria para un aprendizaje de calidad a largo plazo. Los cursos formales resuelven este problema creando zonas “AI-free”: tareas donde la máquina está prohibida y el estudiante se ve obligado a pensar por sí mismo.

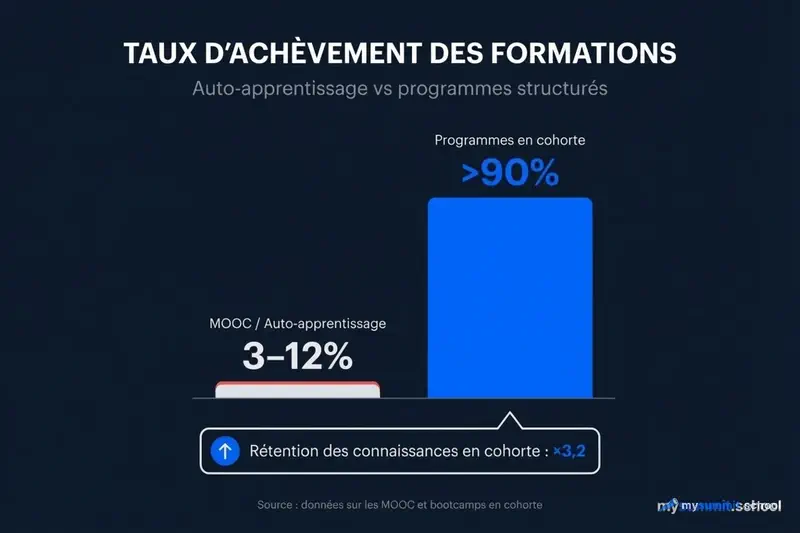

Por qué el 3–12% llegará al final, y el 90% – no

Aquí van las estadísticas que los defensores del autoaprendizaje prefieren no mencionar.

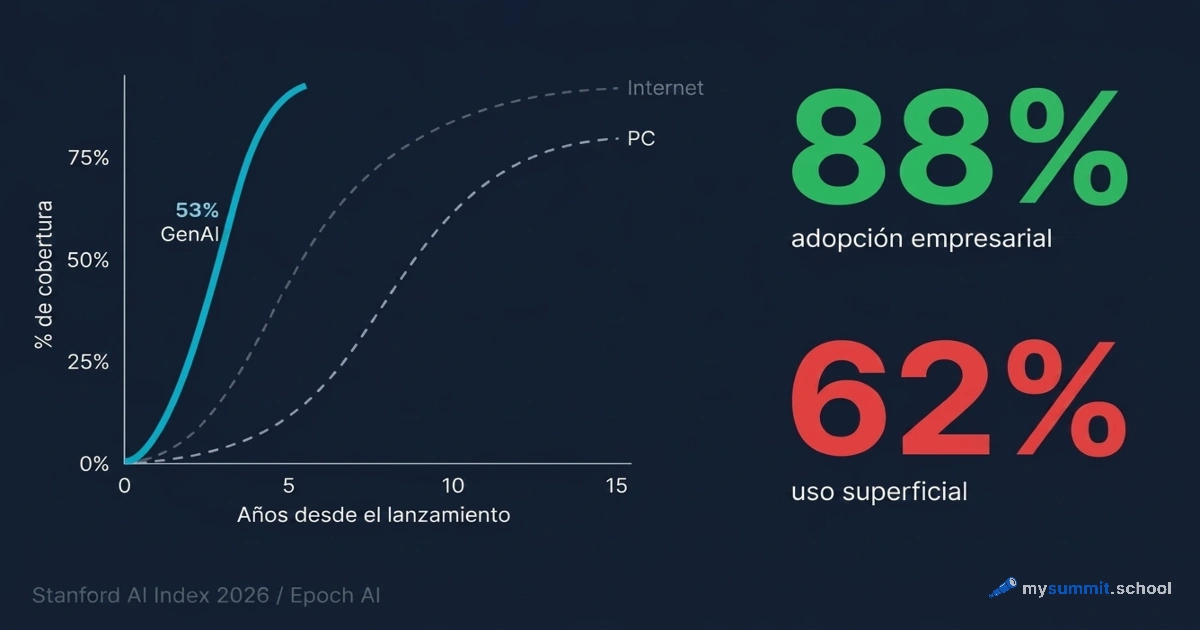

El porcentaje de finalización de cursos online autodidactas (MOOC) es del 3% al 12%. Esto no es un bug – es una feature del autoaprendizaje. Sin estructura externa, fechas límite y presión social, la mayoría de las personas abandona. Es revelador que incluso en el contexto corporativo, el 37% del tiempo ahorrado se pierde corrigiendo errores de AI – y estamos hablando de quienes ya superaron la etapa de adopción.

Los programas de cohorte – bootcamps, cursos con calendario fijo y grupo – muestran porcentajes de finalización superiores al 90%.

La razón – la teoría del aprendizaje social de Bandura y el concepto de Communities of Practice de Lave y Wenger. El aprendizaje no es un proceso aislado de transferencia de datos. Es un acto social, observacional, comunitario. La identidad profesional y la comprensión profunda se forman a través de la interacción, la observación y la participación en una comunidad de expertos y colegas.

Un estudiante solitario, leyendo documentación en la pantalla de su laptop, recibe exactamente cero aprendizaje social. No ve cómo otras personas resuelven los mismos problemas. No recibe retroalimentación de quienes ya recorrieron ese camino. No está en un entorno donde sus errores son detectados y corregidos.

Los datos señalan la magnitud de la diferencia: el aprendizaje activo en formatos de cohorte demuestra una retención de conocimiento 3,2 veces mayor que la de los estudiantes pasivos y aislados.

Mentoría: lo que la AI no puede falsificar

La IA generativa imita excelentemente el tono conversacional de un mentor. Ofrece retroalimentación rápida, corrige la sintaxis del código, explica conceptos. A primera vista – un mentor ideal.

Pero una investigación publicada en ACL Anthology muestra lo contrario. La AI es buena estructurando planes de estudio y generando documentos estándar. Pero cuando se trata de consejos contextualmente precisos en situaciones impredecibles y dinámicas – es fundamentalmente inadecuada. Es la misma conclusión a la que llegaron 885 gerentes en la investigación de Microsoft sobre los límites de la delegación: la responsabilidad no se puede transferir a un actor no humano.

En una investigación donde futuros docentes usaron AI para obtener consejos sobre gestión del aula, las recomendaciones de la AI resultaron “fundamentalmente erróneas e inaplicables en la práctica”. Fue necesario un mentor real para intervenir y corregir las decisiones matizadas que la AI no es capaz de generar.

La mentoría real requiere lo que la AI fundamentalmente no tiene: confianza, empatía y una comprensión profunda del contexto de la persona. Un mentor comparte no solo conocimiento – comparte experiencias de fracasos, normas no escritas de la industria y conexiones profesionales. Cuando los estudiantes empiezan a atribuirle a la AI cualidades humanas como “preocupación” o “comprensión”, eso no es mentoría – es un sesgo cognitivo que los deja sin apoyo profesional real.

El currículo oculto: la ética que no obtendrás de YouTube

En la educación formal existe el llamado “hidden curriculum” – un conjunto implícito de valores, normas y perspectivas que los estudiantes absorben en paralelo al material principal. Para la formación en AI esto significa: ética de los algoritmos, sesgos de los modelos, transparencia de datos, responsabilidad por las consecuencias.

Un programa de AI moderno obliga a los estudiantes a pasar de la pregunta “¿funciona este modelo?” a la pregunta “¿deberíamos desplegar este modelo y a quién podría perjudicar?”

Los autodidactas, enfocados en la adquisición rápida de habilidades para emplearse, evitan sistemáticamente estas preguntas. Los bootcamps corporativos también son frecuentemente criticados por priorizar el rápido desarrollo de capital humano a costa del análisis crítico de datos y la responsabilidad social.

Pero es precisamente la comprensión de las limitaciones, los sesgos y las implicaciones éticas lo que distingue al especialista en quien se confía para tomar decisiones, del operador que sabe presionar botones.

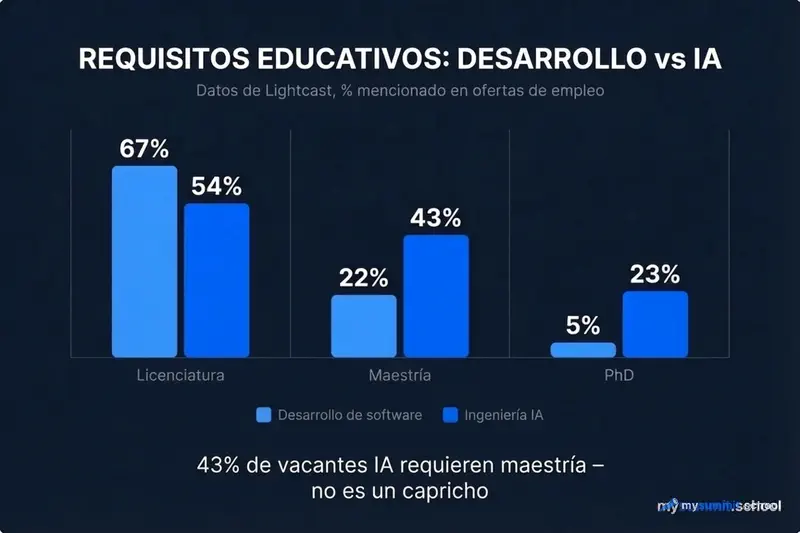

Mercado laboral: qué dicen las cifras

Planteemos la pregunta de forma pragmática: ¿qué pasa con la carrera profesional?

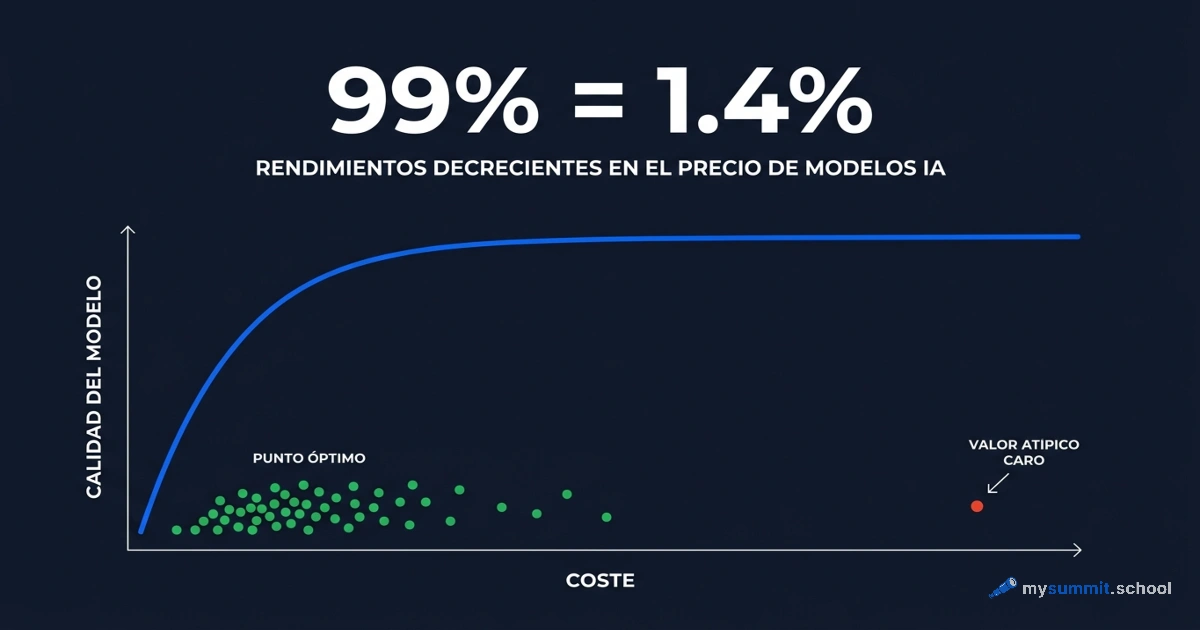

Los datos muestran: el 78–79% de los egresados de bootcamps encuentran trabajo relevante en un plazo de seis meses, con un incremento salarial mediano de alrededor del 51%. Los autodidactas pueden alcanzar un nivel técnico comparable, pero el camino al primer empleo es significativamente más difícil – por la ausencia de credenciales formales y conexiones profesionales. El 82% de los ejecutivos usa AI semanalmente, según la investigación de Wharton 2025, – pero la penetración es desigual por industria, y los requisitos educativos crecen más rápido que la experticia promedio de los usuarios.

Según datos de Lightcast, los requisitos educativos para roles en AI son sustancialmente más altos que para el desarrollo de software estándar:

| Nivel educativo | Desarrollo de software | Ingeniería de AI |

|---|---|---|

| Licenciatura | 67% de vacantes | 54% de vacantes |

| Maestría | 22% de vacantes | 43% de vacantes |

| Doctorado | 5% de vacantes | 23% de vacantes |

Nota: el 43% de las vacantes de AI requieren maestría, y el 23% – doctorado. No es un capricho de los empleadores. Es un reflejo de la complejidad real del campo.

Y hay otro aspecto. En una era donde la AI puede generar un portafolio, escribir código y aprobar un examen remoto – los empleadores pierden la capacidad de distinguir el portafolio de un autodidacta del trabajo de un prompt engineer que simplemente formula bien las instrucciones. La educación formal con exámenes controlados sigue siendo la única garantía confiable de que los conocimientos realmente pertenecen a la persona.

Formación estructurada en AI con mentoría, cohorte y práctica – un curso para managers que priorizan resultados, no ilusiones

Sin pago requerido • Notificación al lanzamiento

Entonces, ¿para qué tomar un curso?

Volvamos a la pregunta original. “¿Para qué pagar por formación si todo está en internet?”

Porque internet da datos, no habilidades. ChatGPT genera respuestas, no comprensión. YouTube muestra soluciones ajenas, no forma tu pensamiento.

La formación estructurada ofrece cuatro cosas que es imposible obtener por cuenta propia:

Andamiaje cognitivo – una estructura secuencial que gestiona la complejidad del material, obliga a pasar por la lucha productiva y no permite saltarse los fundamentos en busca de herramientas de moda.

Aprendizaje social – un entorno donde aprendes no solo del instructor, sino del grupo: a través de la retroalimentación, la comparación de enfoques y la observación de cómo otras personas piensan sobre los mismos problemas.

Calibración externa – personas reales que te muestran el nivel real de tu comprensión sin el filtro de cortesía característico de la AI. Es doloroso, pero es la única forma de escapar de la ilusión de competencia.

Validación de conocimientos – en un mundo donde la AI puede generar cualquier resultado, la validación formal de una organización que verificó tus conocimientos en condiciones controladas se vuelve no menos, sino más valiosa.

El acceso a la información no es educación. Es simplemente acceso a la información. La diferencia está en lo que le sucede a tu cerebro en el proceso.

Y aquí va algo curioso: si el autoaprendizaje con ChatGPT realmente funciona tan bien como los cursos estructurados – ¿por qué las personas que lo afirman siguen afirmándolo en los comentarios, en lugar de demostrar resultados en su trabajo?

Este problema es especialmente agudo en la educación. En Kazajistán, 252 000 docentes recibieron certificados de AI – pero no adquirieron competencias disciplinares. En Rusia, el 87% de los alumnos usa IA, frente al 12% de los docentes. Un análisis detallado de 5 problemas en la implementación de AI en escuelas de la CEI – con datos y pasos concretos para directivos.

¿Quieres dominar la IA de forma sistemática?

Módulo abierto del curso – gratis, sin registro. Siente la diferencia entre leer sobre AI y aprender de verdad.

Continúa aprendiendo

Abre el libro de texto y continúa donde lo dejaste

Fuentes

- Broad effects of shallow understanding: Explaining an unrelated phenomenon exposes the illusion of explanatory depth – Cambridge University Press, investigación sobre IOED

- Embracing the illusion of explanatory depth: A strategic framework for using iterative prompting for integrating large language models in healthcare education – PubMed, IOED y LLMs en educación

- ChatGPT and the Illusion of Explanatory Depth – eScholarship, impacto de ChatGPT en la profundidad de comprensión

- Do Code Models Suffer from the Dunning-Kruger Effect? – Microsoft Research, efecto Dunning-Kruger en modelos de AI

- From Superficial Outputs to Superficial Learning: Risks of Large Language Models in Education – arXiv, cascada de aprendizaje superficial

- Applications of social theories of learning in health professions education programs: A scoping review – PMC, teoría del aprendizaje social de Bandura

- Evaluating Generative AI as a Mentor Resource: Bias and Implementation Challenges – ACL Anthology, limitaciones de la mentoría con AI

- Mentorship in the Age of Generative AI: ChatGPT to Support Self-Regulated Learning of Pre-Service Teachers – MDPI, mentoría con AI en formación docente

- Bootcamp, College, or Self-Taught? Comparing Learning Paths for Career Changers in Tech – SynergisticIT, comparación de caminos hacia carreras tech

- Artificial Intelligence and the Sustainability of the Signaling and Human Capital Theories – MDPI, requisitos educativos en AI según datos de Lightcast

Stanislav Belyaev

Engineering Leader en Microsoft18 anos liderando equipos de ingenieria. Fundador de mysummit.school. 700+ graduados en Yandex Practicum y Stratoplan.