Miks õppida AI-d kursustel, kui kõik on ChatGPT-s olemas: teaduspõhine analüüs

«Milleks mulle teie kursused, kui ma saan lihtsalt ChatGPT-lt küsida?»

See küsimus kõlab kommentaarides iga AI-koolitust puudutava postituse all. Loogika on raudne: internet on tasuta, ChatGPT selgitab kõike, YouTube on õpetusi täis. Miks maksta kursuse eest, kui kogu informatsioon on juba kättesaadav?

Suurepärane küsimus. Vastus sellele – mitte see, mida oodatakse kuulda.

Sest «informatsioonile ligipääsu omamise» ja «sellega töötada oskamise» vahel – on kuristik. Ligipääs meditsiinilistele teatmeteostele ei tee sinust arsti. Kööginoa olemasolu ei tee sinust tippkokka. Ja võimalus esitada ChatGPT-le küsimus ei tee sinust AI-spetsialisti. Nagu näitab MIT uuring valikuarhitektuuride kohta, seisneb spetsialisti tegelik jõud mitte tööriista olemasolus, vaid võimes kriitiliselt hinnata seda, mida tööriist pakub.

Ja see pole lihtsalt kaunis metafoor – see on uuringutega kinnitatud fakt.

Mõistmise sügavuse illusioon: sinu aju petab sind

Alustame ebameeldivast. On olemas kognitiivne moonutus nimega Illusion of Explanatory Depth (IOED) – selgituse sügavuse illusioon. Olemus: inimesed hindavad süstemaatiliselt üle, kui sügavalt nad keerulisi asju mõistavad. Nad usuvad, et tunnevad teemat palju paremini, kui tegelikult – seni, kuni neilt ei paluta seda teemat ilma vihjeteta selgitada.

Cambridge University Pressi teadlased avastasid: illusioon hajub alles siis, kui inimest sunnitakse kontseptsiooni iseseisvalt, ilma väliste allikateta selgitama. Kuni selle hetkeni on ta siiralt veendunud, et mõistab.

Generatiivne AI teeb selle probleemi oluliselt hullemaks.

Kui esitad ChatGPT-le küsimuse masinõppe kohta, saad ideaalselt struktureeritud, grammatiliselt laitmatu, süntaktiliselt täiusliku vastuse. Vastust on lihtne lugeda. See on loogiline. See «on mõistlik». Ja sinu aju teeb sel hetkel kriitilise vea: ta ajab segi informatsiooni tarbimise ladususe tegeliku mõistmisega.

Sa ei õppinud teemat selgeks. Sa lugesid teema kohta ilusa teksti. Need on põhimõtteliselt erinevad asjad.

PubMed-is avaldatud uuring kinnitab: kui õppijad kasutavad LLM-e peamise teadmiste allikana, asendavad nad alateadlikult sügava mõistmise suutlikkusega saada masinalt õige vastus. Nende kompetentsuse tunne kasvab, aga tegelikud kriitilise mõtlemise oskused – atrofeeruvad. MIT uuring tuvastas sama mustri: 86% üliõpilastest kasutab AI-d, kuid pool neist kaotab sideme õppejõuga.

Struktureeritud õpe võitleb selle vastu otse. Iteratiivsete ülesannete, suuliste kontrollide, grupitöö ja olukordade kaudu, kus ei saa «AI-lt küsida» – sunnitakse üliõpilasi silmitsi seisma oma mõistmise tegelike piiridega. See on ebameeldiv. Kuid just see toimib.

Dunning-Krugeri efekt: AI-versioon

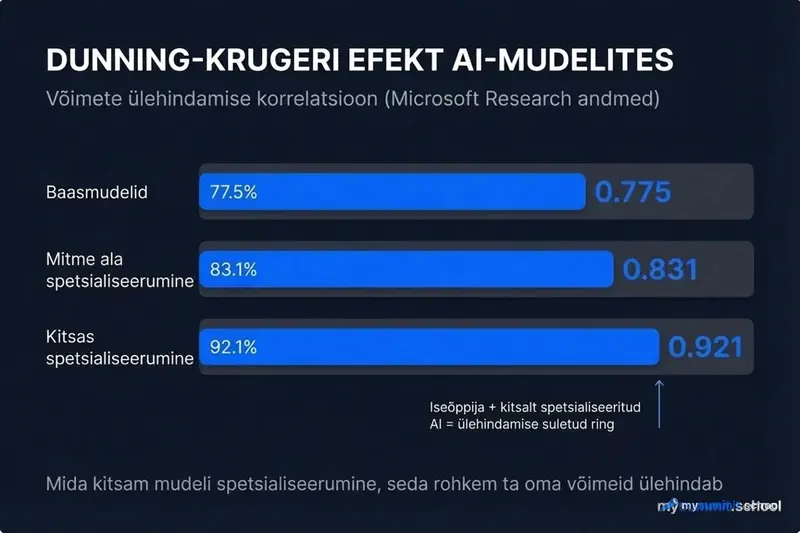

Kui sügavuse illusioon puudutab mõistmise ülehindamist, siis Dunning-Krugeri efekt puudutab oskuste ülehindamist. Minimaalse kompetentsiga inimesed valdkonnas hindavad süstemaatiliselt oma võimeid üle, sest neil puudub ekspertiis oma vigu ära tunda.

AI kontekstis toimib see nii. Inimene õppis ChatGPT kaudu koodi genereerima. Kood kompileerub, töötab, lahendab ülesande. Inimene otsustab, et on programmeerimise omandanud. Seejuures ei märka ta arhitektuurivigu, turvanõrkusi, skaleeritavuse probleeme ja ebaefektiivsust – sest nende avastamiseks on vaja ekspertiisi, mida tal pole.

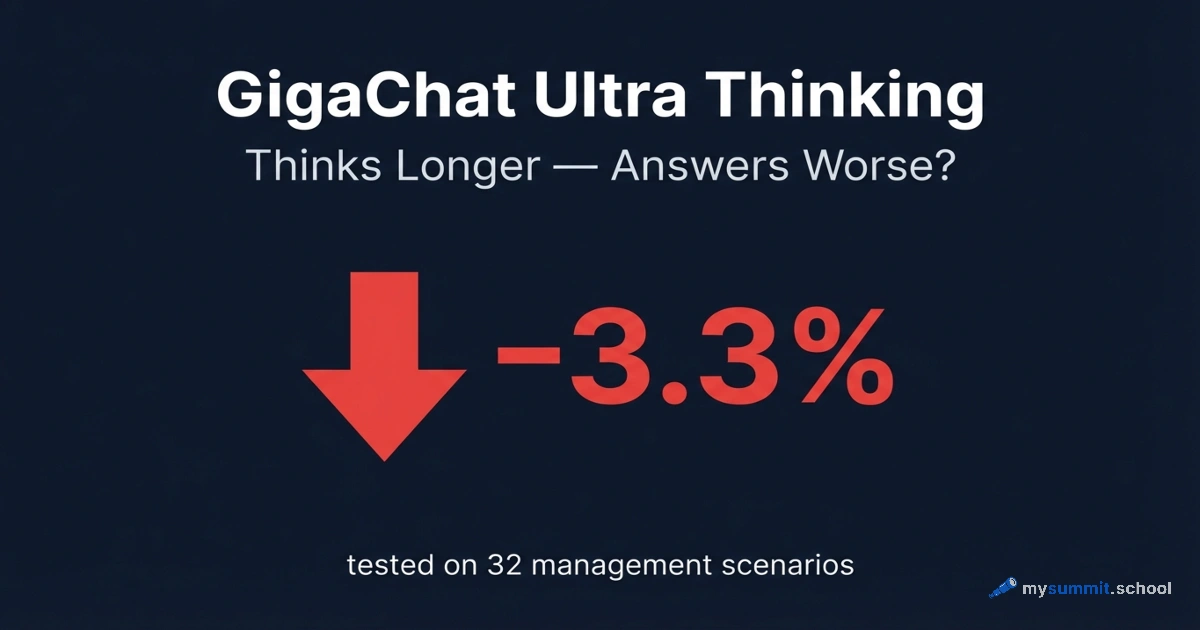

Microsoft Researchi uuring kinnitas: AI-mudelid ise demonstreerivad Dunning-Krugeri efektiga analoogseid mustreid. Nad genereerivad enesekindlaid vastuseid valdkondades, kus nende kompetents on minimaalne. Iseõppija, kes toetub sellisele mudelile kui ainsale teadmiste allikale, satub suletud ringi: ülemäärase enesekindlusega üliõpilane + ülemäärase enesekindlusega AI = püsiv kompetentsuse illusioon. Üllatavalt näitas Anthropicu uuring: AI-süsteemid mitte ainult ei eksi – nad käituvad ebajärjekindlalt, mis teeb vigade avastamise ilma ekspertiisita veelgi keerulisemaks.

Õppejõud või mentor lõhub selle tsükli. Elav ekspert näeb vigu, mida sa ise ei suuda näha. Ta esitab küsimusi, mille peale ChatGPT ei tuleks. Ta loob olukordi, kus sinu teadmatus muutub ilmseks – ja just sellest hetkest algab tõeline õppimine.

Pindmise õppimise kaskaad

Teadlased kirjeldasid fenomeni, mille nad nimetasid «From Superficial Outputs to Superficial Learning» – degradatsiooni kaskaad AI pindmistest vastustest üliõpilase pindmise õppimiseni. Süstemaatiline LLM-ide riskide ülevaade hariduses tuvastas mudeli «LLM-Risk Adapted Learning», mis demonstreerib, kuidas AI tehnilised piirangud muunduvad otseselt õppija kognitiivseteks kaotusteks.

Kui iseõppija toetub internetile ja generatiivsele AI-le kui peamisele õppimismeetodile, toimub dokumenteeritud kognitiivsete protsesside degradatsioon:

Esimene efekt – neuroaktiivsuse langus: informatsiooni kogumise ja sünteesimisega seotud kognitiivne koormus eemaldatakse masina poolt. Kuid sama koormus on produktiivne neuroloogiline pingutus, mis on vajalik sügavaks kodeerimiseks mällu ja aju struktuurse plastilisuse jaoks.

Teine – iseseisva õppimise oskuste kadu: üliõpilane kaotab suutlikkuse otsida, verifitseerida, kõrvutada ja sünteesida vastuolulist informatsiooni, toetudes täielikult AI läbipaistmatutele kokkuvõtmisalgoritmidele.

Kolmas – õppeagentsuse kaotus: õppimisprotsess muutub reaktiivseks, üliõpilane järgib masina järeldusi selle asemel, et genereerida hüpoteese, esitada küsimusi ja viia läbi oma analüüsi.

LLM-id vähendavad kognitiivset koormust ülesande täitmiseks – kuid ei soodusta seda sügavat kaasatust materjali, mis on vajalik kvaliteetseks pikaajaliseks õppimiseks. Formaalsed kursused lahendavad selle probleemi, luues «AI-vabu» tsoone: ülesandeid, kus masin on keelatud ja üliõpilane on sunnitud ise mõtlema.

Miks 3–12% jõuab lõpuni, aga 90% – mitte

Siin on statistika, mida iseõppimise pooldajad eelistavad mitte mainida.

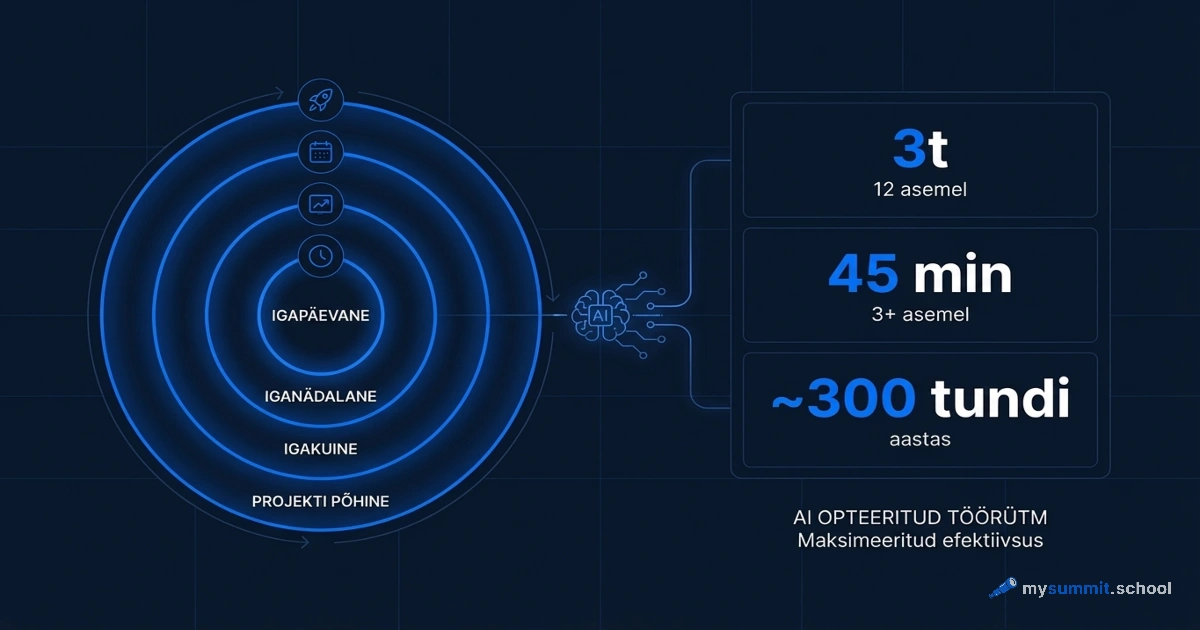

Iseseisvate veebikursuste (MOOC) lõpetamismäär on 3% kuni 12%. See pole viga – see on iseõppimise omadus. Ilma välise struktuuri, tähtaegade ja sotsiaalse surveta enamik inimesi loobub. Iseloomulik, et isegi korporatiivses kontekstis kaob 37% säästetud ajast AI vigade parandamisele – ja need on andmed nende kohta, kes on omandamisetapi juba ületanud.

Kohortprogrammid – bootcamp-id, fikseeritud ajakava ja grupiga kursused – näitavad lõpetamismäära üle 90%.

Põhjus – Bandura sotsiaalse õppimise teooria ja Lave’i ning Wengeri praktikakogukondade kontseptsioon. Õppimine ei ole isoleeritud andmete edastamise protsess. See on sotsiaalne, vaatluslik, kogukondlik tegevus. Professionaalne identiteet ja sügav mõistmine kujunevad suhtlemise, vaatluse ja ekspertide ning kolleegide kogukonnas osalemise kaudu.

Üksik üliõpilane, kes loeb dokumentatsiooni sülearvuti ekraanilt, saab täpselt null sotsiaalset õppimist. Ta ei näe, kuidas teised inimesed lahendavad samu probleeme. Ei saa tagasisidet neilt, kes on seda teed juba käinud. Ei viibi keskkonnas, kus tema vigu märgatakse ja korrigeeritakse.

Andmed osutavad erinevuse ulatusele: aktiivne õppimine kohortformaatides demonstreerib teadmiste kinnistamist 3,2 korda kõrgemal tasemel kui passiivsetel, isoleeritud õppijatel.

Mentorlus: see, mida AI ei suuda võltsida

Generatiivne AI imiteerib suurepäraselt mentori vestluslikku tooni. Ta annab kiiret tagasisidet, korrigeerib koodi süntaksit, selgitab kontseptsioone. Esmapilgul – ideaalne mentor.

Kuid ACL Anthology-s avaldatud uuring näitab vastupidist. AI on hea õppeplaanide struktureerimises ja šabloondokumentide genereerimises. Kuid kui jutt läheb kontekstuaalselt täpsete nõuannete andmisele ettearvamatutes, dünaamilistes olukordades – on ta fundamentaalselt ebaadekvaatne. See on sama järeldus, milleni jõudis 885 juhti Microsofti uuringus delegeerimise piiride kohta: vastutust ei saa üle anda mittehumaansele toimijale.

Uuringus, kus tulevased õpetajad kasutasid AI-d klassijuhtimise nõuannete saamiseks, osutusid AI soovitused «fundamentaalselt vigaseks ja praktikas kasutamatuks». Vaja läks elavat mentorit, et sekkuda ja korrigeerida nüansirikkaid otsuseid, mida AI ei suuda genereerida.

Tõeline mentorlus nõuab seda, mida AI-l põhimõtteliselt pole: usaldust, empaatiat ja inimese konteksti sügavat mõistmist. Mentor jagab mitte ainult teadmisi – ta jagab ebaõnnestumiste kogemust, valdkonna mitteilmseid norme ja professionaalseid sidemeid. Kui üliõpilased hakkavad omistama AI-le inimlikke omadusi nagu «hoolivus» või «mõistmine», pole see mentorlus – see on kognitiivne moonutus, mis jätab nad ilma tegelikust professionaalsest toest.

Varjatud õppekava: eetika, mida YouTube-ist ei saa

Formaalses hariduses on niinimetatud «hidden curriculum» – väärtuste, normide ja perspektiivide varjatud kogum, mille üliõpilased omandavad paralleelselt põhimaterjaliga. AI-koolituse jaoks tähendab see: algoritmide eetika, mudelite kallutatus, andmete läbipaistvus, vastutus tagajärgede eest.

Kaasaegne AI-programm sunnib üliõpilasi minema küsimuselt «kas see mudel töötab?» küsimusele «kas seda mudelit tasub juurutada ja kellele see võib kahju tekitada?»

Iseõppijad, kes on keskendunud kiirele oskuste omandamisele tööhõive eesmärgil, väldivad süstemaatiliselt neid küsimusi. Ka korporatiivseid bootcamp-e kritiseeritakse sageli inimkapitali kiire kasvatamise eelistamise eest andmete kriitilise analüüsi ja sotsiaalse vastutuse arvelt.

Kuid just piirangute, kallutatuse ja eetiliste mõjude mõistmine eristab spetsialisti, keda usaldatakse otsuseid tegema, operaatorist, kes oskab nuppe vajutada.

Tööturg: mida näitavad arvud

Esitame küsimuse pragmaatiliselt: mis toimub karjääriga?

Andmed näitavad: 78–79% bootcamp-ide lõpetajatest leiab asjakohase töö kuue kuu jooksul, palga mediaankasv on umbes 51%. Iseõppijad võivad saavutada võrreldava tehnilise taseme, kuid tee esimese tööni on oluliselt keerulisem – formaalsete kvalifikatsioonitõendite ja professionaalsete sidemete puudumise tõttu. 82% juhtidest kasutab AI-d iganädalaselt, näitas Whartoni 2025. aasta uuring – kuid levik on valdkondade lõikes ebaühtlane ja haridusnõuded kasvavad kiiremini kui kasutajate keskmine ekspertiis.

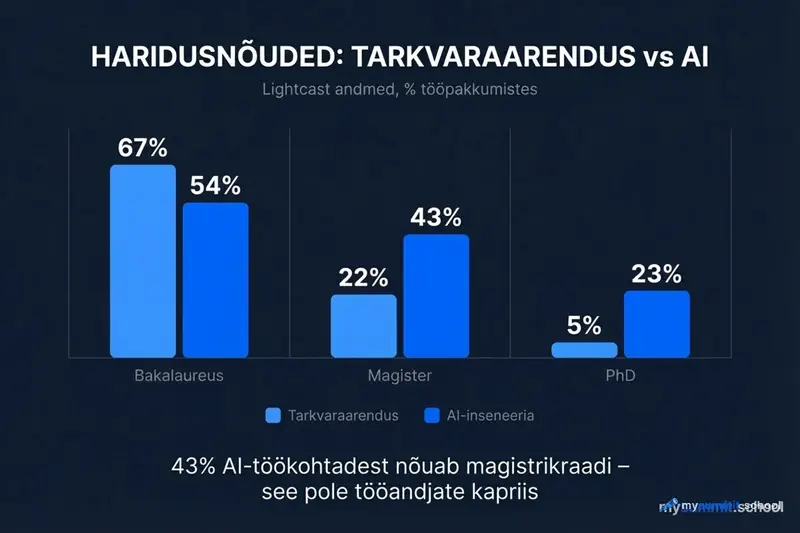

Lightcasti andmetel on haridusnõuded AI-rollidele oluliselt kõrgemad kui tavapärasele tarkvaraarendusele:

| Haridustase | Tarkvaraarendus | AI-inseneeria |

|---|---|---|

| Bakalaureus | 67% tööpakkumistest | 54% tööpakkumistest |

| Magister | 22% tööpakkumistest | 43% tööpakkumistest |

| PhD | 5% tööpakkumistest | 23% tööpakkumistest |

Pange tähele: 43% AI-tööpakkumistest nõuab magistrikraadi ja 23% – doktorikraadi. See pole tööandjate kapriis. See peegeldab valdkonna tegelikku keerukust.

Ja on veel üks aspekt. Ajastul, mil AI suudab genereerida portfoolio, kirjutada koodi ja läbida kaugtesti – kaotavad tööandjad suutlikkuse eristada iseõppija portfooliot prompt-inseneri tööst, kes lihtsalt formuleerib päringuid hästi. Formaalne haridus kontrollitud eksamitega jääb ainsaks usaldusväärseks garantiiks, et teadmised kuuluvad tõepoolest inimesele.

Struktureeritud AI-koolitus mentorluse, kohordi ja praktikaga – kursus juhtidele, kellele on oluline tulemus, mitte illusioon

Makset ei nõuta • Teavitus käivitumisel

Miks siis kursusele minna?

Pöördume tagasi algse küsimuse juurde. «Miks maksta õppimise eest, kui kõik on internetis olemas?»

Sest internet annab andmeid, mitte oskusi. ChatGPT genereerib vastuseid, mitte mõistmist. YouTube näitab teiste lahendusi, mitte ei kujunda sinu mõtlemist.

Struktureeritud õpe annab neli asja, mida on võimatu iseseisvalt saada:

Kognitiivne raamistik – järjekindel struktuur, mis juhib materjali keerukust, sunnib läbima produktiivse pingutuse ega lase aluste üle hüpata moodsate tööriistade nimel.

Sotsiaalne õppimine – keskkond, kus sa õpid mitte ainult õppejõult, vaid ka grupilt: tagasiside, lähenemisviiside võrdlemise ja selle vaatlemise kaudu, kuidas teised inimesed mõtlevad samadest probleemidest.

Väline kalibreerimine – elavad inimesed, kes näitavad sulle sinu mõistmise tegelikku taset ilma AI-le omase viisakusfiltrita. See on valulik, kuid see on ainus viis pääseda kompetentsuse illusioonist.

Teadmiste kinnitamine – maailmas, kus AI suudab genereerida ükskõik millise tulemuse, muutub formaalne kinnitus organisatsioonilt, kes kontrollis sinu teadmisi kontrollitud tingimustes, mitte vähem, vaid rohkem väärtuslikuks.

Ligipääs informatsioonile – see pole haridus. See on lihtsalt ligipääs informatsioonile. Erinevus – on selles, mis toimub sinu ajuga protsessi käigus.

Ja üks huvitav asi: kui iseõppimine ChatGPT-ga tõesti töötab sama hästi nagu struktureeritud kursused – miks inimesed, kes seda väidavad, jätkavad selle väitmist kommentaarides, selle asemel et demonstreerida tulemusi tööl?

See probleem on eriti terav hariduses. Kasahstanis said 252 000 õpetajat AI-sertifikaadid – kuid ainealaseid oskusi ei omandanud. Venemaal kasutab 87% õpilastest AI-d, aga vaid 12% õpetajatest. Põhjalik analüüs 5 AI juurutamise probleemist SRÜ koolides – andmete ja konkreetsete sammudega juhtidele.

Tahad TI-d süstemaatiliselt omandada?

Kursuse avatud moodul – tasuta, ilma registreerimiseta. Tunne vahet AI-st lugemise ja tõelise õppimise vahel.

Jätka õppimist

Ava õpik ja jätka sealt, kus pooleli jäid

Allikad

- Broad effects of shallow understanding: Explaining an unrelated phenomenon exposes the illusion of explanatory depth – Cambridge University Press, IOED uuring

- Embracing the illusion of explanatory depth: A strategic framework for using iterative prompting for integrating large language models in healthcare education – PubMed, IOED ja LLM-id hariduses

- ChatGPT and the Illusion of Explanatory Depth – eScholarship, ChatGPT mõju mõistmise sügavusele

- Do Code Models Suffer from the Dunning-Kruger Effect? – Microsoft Research, Dunning-Krugeri efekt AI-mudelites

- From Superficial Outputs to Superficial Learning: Risks of Large Language Models in Education – arXiv, pindmise õppimise kaskaad

- Applications of social theories of learning in health professions education programs: A scoping review – PMC, Bandura sotsiaalse õppimise teooria

- Evaluating Generative AI as a Mentor Resource: Bias and Implementation Challenges – ACL Anthology, AI-mentorluse piirangud

- Mentorship in the Age of Generative AI: ChatGPT to Support Self-Regulated Learning of Pre-Service Teachers – MDPI, AI-mentorlus pedagoogilises hariduses

- Bootcamp, College, or Self-Taught? Comparing Learning Paths for Career Changers in Tech – SynergisticIT, tech-karjääri teede võrdlus

- Artificial Intelligence and the Sustainability of the Signaling and Human Capital Theories – MDPI, haridusnõuded AI-s Lightcasti andmetel