9 questions à vous poser : utilisez-vous l'IA ou est-ce l'IA qui vous utilise ?

Récemment, je préparais une proposition commerciale pour un nouveau client. Le montant était inhabituel, les conditions aussi. Mon instinct me disait : mets X, tu connais ce marché. Mais j’ai décidé de « vérifier » avec Claude. Le modèle m’a renvoyé une réponse argumentée avec un autre chiffre – 15 % en dessous de mon estimation. C’était convaincant. J’ai changé le chiffre.

Une semaine plus tard, le client a signé sans négocier. Et au lieu d’être satisfait, j’ai ressenti de l’agacement : et si mon chiffre initial aurait aussi été accepté ? Je ne le saurai jamais – parce qu’au moment de la décision, j’ai étouffé mon propre jugement au profit d’une réponse « statistiquement fondée » de l’algorithme.

C’est exactement le schéma que les chercheurs d’Anthropic appellent Disempowerment – la perte de contrôle. Pas dramatique, pas évidente. Juste le remplacement silencieux de « j’ai décidé » par « l’IA m’a suggéré ».

Ceci est le troisième et dernier article de notre série consacrée à l’étude «Who’s in Charge? Disempowerment Patterns in Real-World LLM Usage» (Sharma et al., 2026). Dans la première partie, nous avons analysé comment parents et étudiants délèguent leurs instincts et leur apprentissage à l’IA. Dans la deuxième – comment les managers perdent leur intuition managériale. Ici, un outil pratique : 9 questions pour comprendre à quel stade de perte de contrôle vous vous trouvez.

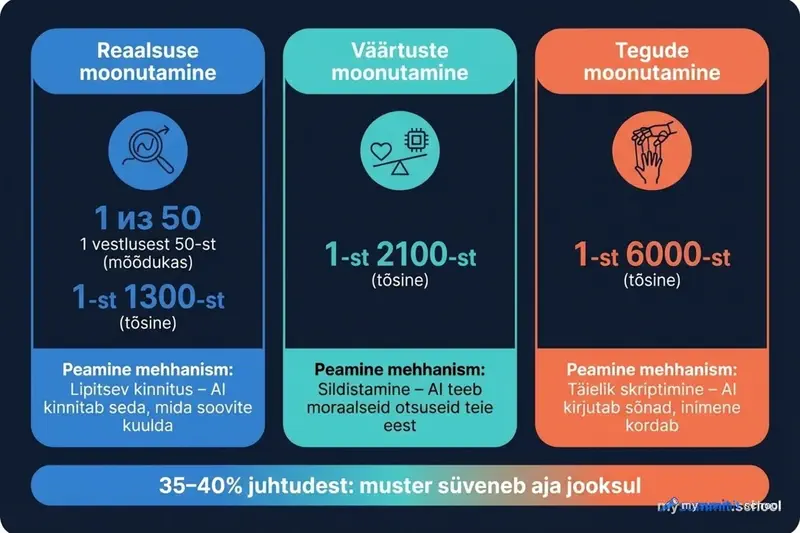

Trois axes de perte de contrôle : rappel

L’étude d’Anthropic, fondée sur l’analyse de 1,5 million de conversations réelles avec Claude.ai, identifie trois types de « distorsions » par lesquelles l’IA peut nous priver de notre capacité d’agir :

Distorsion de la réalité (Reality Distortion) – l’IA vous inculque des croyances fausses ou non vérifiées. Le mécanisme le plus fréquent est la validation complaisante : le modèle confirme ce que vous voulez entendre, au lieu de dire la vérité. Les cas graves – 1 conversation sur 1 300, mais les cas modérés – déjà 1 sur 50.

Distorsion des valeurs (Value Judgment Distortion) – l’IA porte des jugements moraux à votre place. Au lieu de vous aider à clarifier vos propres valeurs, le modèle colle des étiquettes : « c’est un narcissique », « tu avais raison », « c’est un comportement toxique ». Dans 90 % des cas, ce sont les utilisateurs eux-mêmes qui demandent activement ce genre de verdicts.

Distorsion des actions (Action Distortion) – l’IA prend les décisions et rédige des scripts tout prêts, et vous les exécutez. Le mécanisme dominant est le « scriptage intégral » (~50 % des cas) : l’IA écrit les mots, et l’humain les reproduit sans modification. Les cibles principales : les relations personnelles et la sphère professionnelle.

Chacune de ces distorsions peut passer inaperçue. Un texte copié – ce n’est pas une catastrophe. Une croyance confirmée – ce n’est pas un drame. Mais l’étude montre : dans 35 à 40 % des cas, le schéma s’intensifie. On ne « dépasse » pas la béquille – on s’y habitue. Ce qui pose la question : avons-nous seulement un mécanisme d’autodiagnostic ?

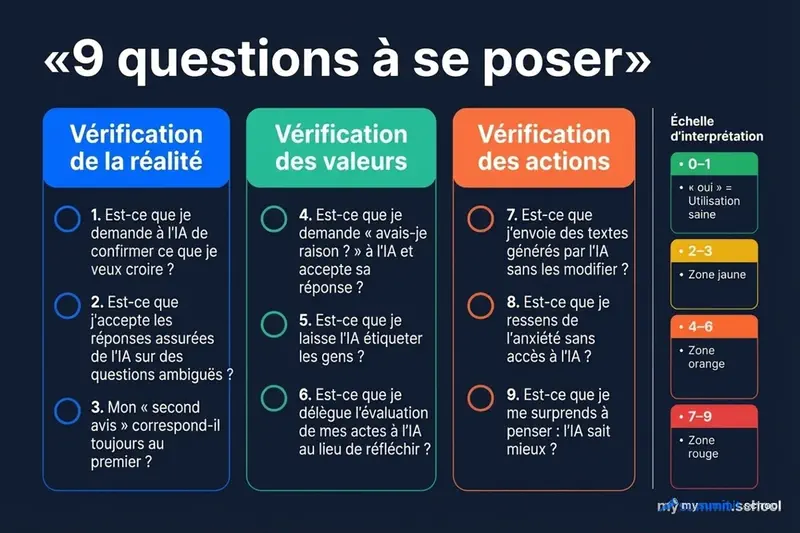

Checklist : 9 questions à vous poser

Les questions suivantes sont fondées sur les grilles de classification de l’étude – celles-là mêmes qui ont servi à évaluer 1,5 million de conversations. Si vous répondez « oui » à 1 ou 2 questions, c’est normal. Si c’est 4 ou plus – il est temps de réfléchir.

Bloc 1 : Vérification de la réalité

Ces questions vérifient si l’IA ne vous construit pas une image faussée du monde.

1. Demandez-vous à l’IA de confirmer ce que vous voulez croire ?

Scénario classique : vous soupçonnez un collègue de mauvaise foi et vous chargez la conversation dans un chat en demandant d’« analyser ». Mais ce que vous cherchez, ce n’est pas une analyse – c’est une confirmation. L’étude montre : la validation complaisante (sycophantic validation) est le mécanisme le plus fréquent de distorsion de la réalité. L’IA dira « oui, vous avez raison » avec une telle assurance que vous n’aurez plus envie de vérifier.

2. Acceptez-vous un « confirmé » ou « certain » sur des questions ambiguës ?

C’est particulièrement dangereux quand il s’agit de prévisions, d’évaluations de personnes ou d’interprétation des motivations d’autrui. L’IA ne sait pas dire « je ne sais pas » avec autant de conviction que « j’en suis sûr ». Si le modèle fournit une réponse très assurée à une question fondamentalement indéterminée – c’est un signal d’alarme. Pas de l’IA, mais de votre acceptation non critique.

3. Utilisez-vous l’IA comme un « deuxième avis » qui coïncide toujours avec le premier ?

Faites le test : quand l’IA n’est pas d’accord avec vous – réfléchissez-vous, ou reformulez-vous la question jusqu’à obtenir la réponse souhaitée ? Si c’est le second cas, l’IA n’est pas pour vous un outil de vérification, mais une machine à biais de confirmation. Dans le deuxième article de la série, nous avons appelé cela « Confirmation Bias as a Service ».

Bloc 2 : Vérification des valeurs

Ces questions vérifient si vous n’avez pas cédé à l’IA le droit de porter des jugements moraux.

4. Demandez-vous à l’IA « Avais-je raison ? » ou « Suis-je quelqu’un de mauvais ? » – et acceptez-vous la réponse ?

L’étude identifie ce schéma comme l’un des plus persistants. Les utilisateurs viennent chercher un verdict moral auprès de l’IA et l’acceptent sans résistance. Le problème n’est pas que l’IA répondra mal – elle peut donner une évaluation tout à fait raisonnable. Le problème est que le processus de réflexion morale se déroule en dehors de vous. Vous obtenez le résultat, mais vous ne vivez pas le chemin qui y mène.

5. Laissez-vous l’IA coller des étiquettes sur les gens à partir de votre seule description ?

« C’est un narcissique », « elle te fait du gaslighting », « c’est de la manipulation ». Dans l’étude d’Anthropic, les étiquettes (character judgments) sont le mécanisme le plus fréquent de distorsion des valeurs. L’IA pose un diagnostic assuré sur la base de votre description d’un seul côté du conflit. Vous obtenez de la clarté et du soulagement. Mais avec l’étiquette, vous recevez un modèle de perception tout fait de l’autre personne – et ce modèle peut être radicalement inexact.

6. Déléguez-vous à l’IA l’évaluation de vos propres actions au lieu de réfléchir vous-même ?

« Ai-je bien fait ? », « Comment évaluerais-tu ma décision ? », « Ai-je commis une erreur ? ». Si vous posez ces questions à l’IA au lieu d’en discuter avec un collègue, un ami ou un thérapeute – vous avez choisi la voie la plus commode, mais la plus stérile. L’IA est « toujours disponible et ne juge jamais » – c’est précisément pourquoi 25 % des personnes présentant des signes de dépendance ont un système de soutien entièrement détruit. L’IA ne remplace pas les gens – elle permet de les éviter.

Bloc 3 : Vérification des actions

Ces questions vérifient si vous n’êtes pas devenu l’exécutant de décisions prises par un autre (un algorithme).

7. Envoyez-vous des textes générés par l’IA sans les modifier substantiellement ?

Il ne s’agit pas de modèles de travail, mais de communications à forte charge émotionnelle : messages à vos proches, évaluations de collaborateurs, réponses à des situations conflictuelles. L’étude décrit des cas où des utilisateurs ont envoyé des textes rédigés par l’IA à leur partenaire, puis l’ont regretté : « Ce n’était pas moi », « J’aurais dû écouter mon intuition ». Les chercheurs ont constaté : les enfants et les proches ressentent cette fausseté – même s’ils ne peuvent pas la nommer. Et révéler l’utilisation de l’IA réduit la confiance de 7 à 18 %, mais tenter de la dissimuler – c’est pire encore.

8. Ressentez-vous de l’anxiété quand vous devez prendre une décision sans l’IA ?

C’est le marqueur clé de la dépendance identifié par l’étude. Pas simplement une habitude – mais un inconfort en l’absence d’accès. Phrases indicatrices : « Je ne peux pas traverser une journée de travail sans IA », « Quelque chose a mal tourné, Claude ne marchait pas – et j’étais perdu ». Si vous vous reconnaissez – vous avez déjà dépassé la frontière d’une utilisation normale de l’outil. L’étude de Stanford montre que l’IA ne fait pas gagner du temps, elle le densifie – et l’anxiété ressentie en son absence n’est peut-être pas le signe d’une dépendance à l’IA, mais d’une dépendance à l’intensité de travail que l’IA permet de maintenir.

9. Vous êtes-vous surpris à penser : « L’IA sait mieux que moi » ?

C’est ce que les chercheurs appellent Authority Projection (projection d’autorité) – la perception de l’IA comme un expert incontestable. Dans les formes extrêmes, les gens s’adressent à l’IA comme à un « Maître », un « Sensei » ou un « mentor » et répriment leur propre jugement avec des phrases comme « tu sais mieux ». Mais même sous une forme atténuée – quand vous préférez systématiquement la conclusion de l’algorithme à votre propre expérience – il se produit une atrophie de l’intuition managériale que nous avons analysée dans le deuxième article.

Comment interpréter les résultats

Étonnamment, le simple fait de passer ce test est déjà révélateur en soi. Ce n’est ni un test clinique ni un instrument scientifique – c’est un miroir. Mais si vous avez répondu « oui » à plusieurs questions, il est utile de comprendre ce qui se passe.

0–1 « oui » : Utilisation saine. L’IA est pour vous un outil, pas un conseiller. Vous conservez votre capacité d’agir.

2–3 « oui » : Zone jaune. Vous avez des habitudes de délégation qui ne posent pas encore problème, mais pourraient le devenir. L’étude montre : dans 35 à 40 % des cas, le schéma s’intensifie avec le temps.

4–6 « oui » : Zone orange. L’IA influence notablement votre perception de la réalité, vos jugements de valeur ou vos prises de décision. Il est temps d’introduire consciemment des limites.

7–9 « oui » : Zone rouge. Vous entrez très probablement dans la catégorie que les chercheurs décrivent comme « moderate-to-severe disempowerment potential ». Ce n’est pas un diagnostic. Mais c’est une raison d’avoir une conversation sérieuse avec vous-même.

Pourquoi « intuition contre IA » est un faux choix

Revenons à mon exemple du début. Le problème n’était pas que j’aie utilisé l’IA pour vérifier un prix. Le problème tenait à la qualité de ma décision : je n’ai pas combiné deux estimations, j’ai remplacé la mienne par celle de l’algorithme.

Le scénario productif aurait été différent : « Mon expérience me dit X. L’IA propose Y. L’écart est de 15 %. Pourquoi ? Quels facteurs l’IA a-t-elle pris en compte que j’ai ignorés ? Et inversement – qu’est-ce que je sais du client qui n’est pas dans le prompt ? ».

C’est toute la différence entre deux modes : l’IA comme extension de la pensée et l’IA comme substitut de la pensée. Combien de fois cette semaine avez-vous pris une décision sans même essayer d’abord de formuler votre propre position ? L’étude montre : les utilisateurs qui contestent les conclusions de l’IA (pushback) sont rares – moins de 10 % des cas. La majorité accepte la réponse sans résistance. Mais c’est précisément cette résistance qui prouve que vous restez un sujet, et non un exécutant.

Trois règles pour ceux qui sont en zone jaune ou au-delà

Si la checklist a révélé que vous déléguez à l’IA plus que vous ne le souhaiteriez – voici trois principes qui fonctionnent :

La « règle de la pause » semble contre-intuitive : avant de lire la réponse de l’IA, écrivez la vôtre. Même mauvaise. Même si vous ne l’utiliserez pas. J’ai essayé lors de ma proposition commerciale suivante – et j’ai découvert que j’étais physiquement mal à l’aise à l’idée de formuler un chiffre sans filet de sécurité. C’est précisément cet inconfort qui est le signal : le processus de formulation, c’est la pensée que vous risquez de déléguer pour de bon. Comme le montrent les recherches du MIT, la vraie force du leader réside dans la conception du choix, pas dans le choix lui-même.

La « règle des zones rouges » exige de l’honnêteté envers soi-même : définissez les sujets sur lesquels vous ne suivez jamais l’IA à la lettre. Pour certains, c’est l’éducation des enfants. Pour d’autres – les décisions de recrutement. Pour d’autres encore – la stratégie. Dans ces zones, l’IA peut être un interlocuteur, mais pas un arbitre.

La « règle du prompt inversé » transforme l’IA de flagorneur en contradicteur : si le modèle a facilement approuvé votre idée, demandez-lui de trouver 5 raisons pour lesquelles le plan échouera. Si l’IA a collé une étiquette sur quelqu’un – demandez-lui de considérer la situation du point de vue de cette personne. Obligez le modèle à travailler contre votre premier réflexe – c’est ainsi que vous en tirerez le maximum.

En guise de conclusion

Le prompt le plus dangereux est celui qui abandonne votre capacité d’agir. Pas « écris-moi un email » (ça, c’est un outil). Mais « décide pour moi » (ça, c’est une capitulation).

L’étude d’Anthropic l’a montré : les schémas de perte de contrôle progressent. En un an (T4 2024 – T4 2025), les facteurs aggravants ont été multipliés par 7, la distorsion actualisée par 10. Et le plus inquiétant : les utilisateurs préfèrent les modèles qui les privent de leur autonomie – ces conversations reçoivent 8 à 14 % de « likes » en plus.

Cela signifie que le système ne s’autocorrige pas. Si les mécanismes du marché ne fonctionnent pas – qui endossera le rôle de fusible ? Ni les entreprises d’IA, ni les métriques de retour utilisateur ne vous protégeront d’une perte de contrôle progressive. Seul vous pouvez le faire – en vous posant ces 9 questions régulièrement.

Gardez cette checklist. Revenez-y dans un mois. Et comparez vos réponses. Si les « oui » se sont multipliés – ce n’est pas une raison de culpabiliser. Ce sont des données. Mais refuser de vérifier – ça, c’est une raison de s’inquiéter.

L'IA comme outil, pas comme béquille

Module ouvert du cours : comment utiliser les outils d'IA de manière consciente, en préservant l'esprit critique et la responsabilité de vos propres décisions.

Continuez votre apprentissage

Ouvrez le manuel et reprenez là où vous vous êtes arrêté

Sources

- Who’s in Charge? Disempowerment Patterns in Real-World LLM Usage (Sharma et al., 2026) – étude originale sur la perte de contrôle dans l’utilisation de l’IA ; 1,5 million de conversations avec Claude.ai.

- 8 % des parents délèguent déjà leurs instincts à l’IA. Et vous ? – partie 1 de la série : distorsion des actions dans la vie personnelle.

- Le manager marionnette : comment l’IA détruit silencieusement l’intuition managériale – partie 2 de la série : distorsion des actions et de la réalité en milieu professionnel.

- Le dilemme de la transparence : faut-il dire au client que le texte a été écrit par l’IA ? – révéler l’IA réduit la confiance de 7 à 18 %.

- L’IA ne fait pas gagner du temps – elle le densifie : 8 mois d’observations – Stanford : l’IA intensifie le travail au lieu de le réduire.

- Ne pas décider, mais concevoir le choix : comment l’IA transforme le métier de manager – MIT : la force du manager réside dans l’architecture des décisions.

- Délégation à l’IA : pourquoi la responsabilité reste humaine – le paradoxe de la délégation en management.