86% des eleves utilisent l'IA, mais leurs resultats se degradent. Une experience a tout change

Les approches traditionnelles de l’education ne fonctionnent plus. L’IA redige des dissertations en quelques minutes – et cela a definitivement change le sens des travaux creatifs a l’ecole. Interdire les reseaux de neurones ne fonctionne pas, isoler les eleves de la technologie non plus. La question n’est pas de savoir s’il faut utiliser l’IA ou non. La question est de savoir comment l’utiliser pour que la technologie developpe les competences des eleves au lieu de remplacer leur reflexion.

Obtenez des scénarios IA pour votre cours

Entrez votre matière et le sujet du cours – obtenez des scénarios d'utilisation de l'IA en classe, des prompts prêts à l'emploi et des exercices que les élèves ne peuvent pas déléguer à une IA (actuellement en russe).

Sans inscription · Résultat en 30 secondes

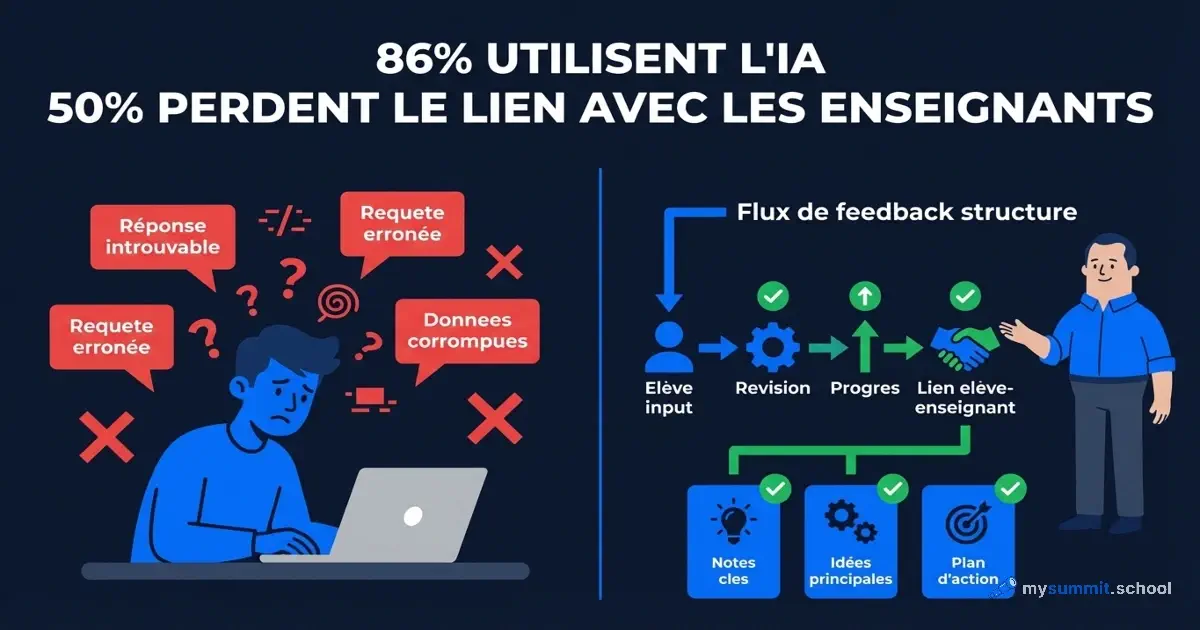

Deux etudes de 2025 revelent un paradoxe : 86% des eleves utilisent l’IA dans leurs etudes, mais la moitie d’entre eux sentent qu’ils perdent le lien avec leurs enseignants. On pourrait penser que la technologie devrait aider – mais quelque chose ne tourne pas rond.

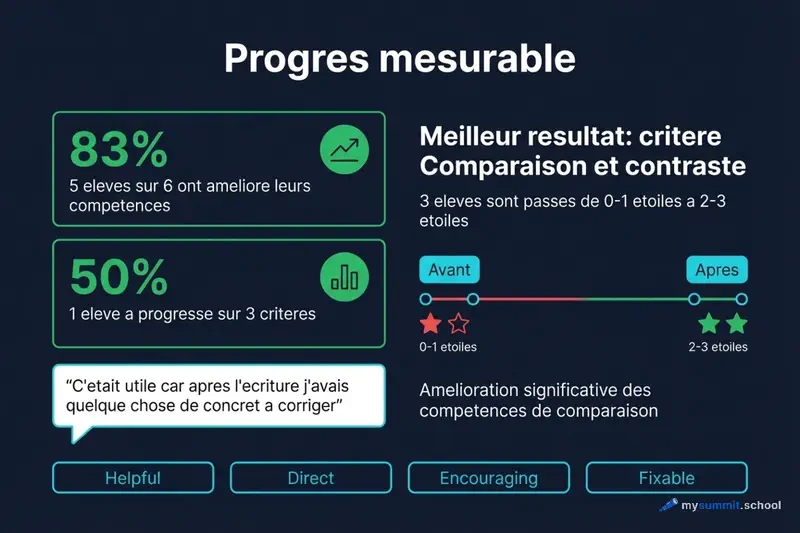

Ce qui est interessant, c’est que le probleme ne vient pas de l’IA elle-meme. L’Universite de l’Illinois a obtenu le resultat inverse – quand l’IA est correctement calibree, 5 eleves sur 6 ameliorent leurs competences redactionnelles. Decryptons ce qui fait la difference entre echec et reussite. Et ce que peuvent faire les ecoles qui ne veulent ni prendre du retard sur la technologie, ni sacrifier la qualite de l’enseignement.

Ce qui se passe dans les ecoles en ce moment

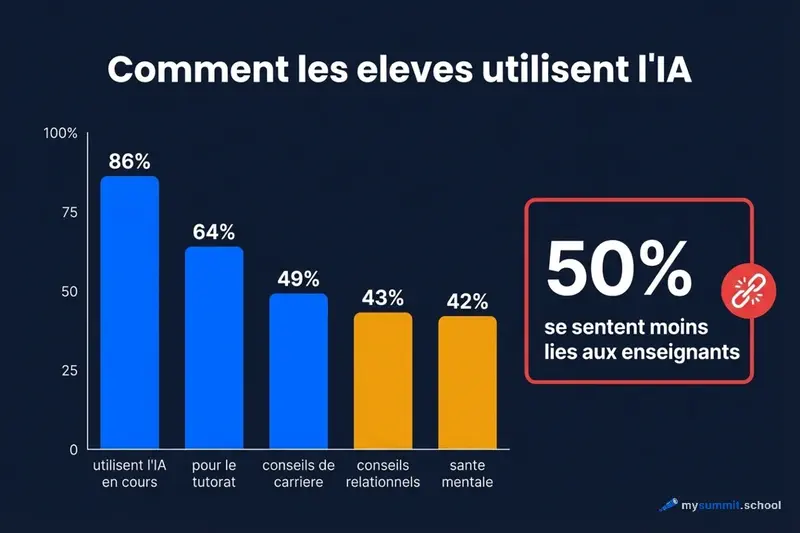

Les chiffres du rapport Education Week sont saisissants. 86% des eleves aux Etats-Unis utilisent l’IA – c’est pratiquement chaque eleve. Deux tiers l’utilisent pour du tutorat, pres de la moitie pour des conseils d’orientation professionnelle. On pourrait croire a une revolution educative. Une technologie qui aide a apprendre.

Mais il y a un hic. La moitie de ces memes eleves admettent qu’ils se sentent moins connectes a leurs enseignants lorsqu’ils travaillent avec l’IA. 70% des enseignants observent une atrophie de la pensee critique. Les eleves cessent de reflechir – ils se contentent de copier les reponses toutes faites de ChatGPT.

Et c’est la que cela devient vraiment preoccupant. 43% des eleves utilisent l’IA pour des conseils relationnels. 42% la consultent pour des questions de sante mentale. Un adolescent en depression demande a ChatGPT quoi faire. Le bot repond quelque chose de generique – et au lieu d’une aide reelle, on cree une illusion de soutien. L’isolement ne fait que s’aggraver.

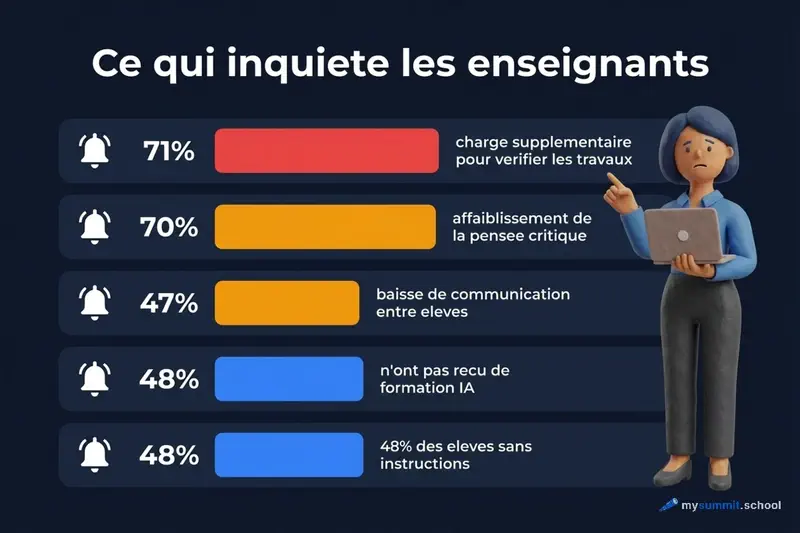

Les enseignants, pendant ce temps, sont surcharges. 71% parlent d’une charge de travail supplementaire – il faut desormais verifier chaque copie pour detecter si elle a ete « generee par un bot ». L’eleve a-t-il vraiment ecrit cela lui-meme ? Ou a-t-il simplement copie depuis ChatGPT en reformulant legerement ? Et le plus absurde – seuls 48% des enseignants ont recu une quelconque formation sur l’IA. Et exactement le meme pourcentage d’eleves ont recu des instructions sur la bonne utilisation de l’IA.

On se retrouve face a un paradoxe : les ecoles deploient massivement une technologie que ni les enseignants, ni les eleves ne savent utiliser. Et au lieu d’une aide, on recolte des problemes – isolement, degradation des competences, surcharge des enseignants.

Peut-on faire autrement ?

Pendant que certaines ecoles luttent contre le chaos, une equipe de l’Universite de l’Illinois (Zheldibayeva et al., 2025) a tente une approche differente. Ni interdire l’IA. Ni laisser faire. Mais calibrer – configurer l’IA specifiquement pour un enseignant donne, ses exercices, ses criteres d’evaluation.

La conclusion principale de leur etude est simple : « L’IA generative n’est pas adaptee a l’education sans calibration. Il faut la recalibrer en fonction de l’enseignant, de ses grilles d’evaluation et de ses supports pedagogiques ». Logique. Mais est-ce que ca marche ?

L’experience a ete menee dans une ecole ordinaire a faible budget dans le Midwest americain. Six eleves de Terminale, un professeur d’anglais titulaire de deux masters. L’exercice etait simple – ecrire une dissertation de 200 mots comparant deux textes.

Les chercheurs ont fait les choses serieusement : protocole IRB (approbation ethique), sources de donnees multiples (brouillons, versions finales, groupes de discussion, questionnaires enseignant). Tous ont donne leur consentement, l’anonymat a ete preserve. Ce n’est pas un simple « on a essaye et on raconte » – c’est une etude methodologiquement rigoureuse.

La cle residait dans deux aspects de la calibration. Premierement – l’IA a ete configuree pour l’exercice specifique de l’enseignant. Elle ne travaillait qu’avec les supports charges dans le systeme (c’est ce qu’on appelle le RAG – Retrieval-Augmented Generation). Aucune donnee aleatoire provenant d’internet.

Deuxiemement – l’IA evaluait les travaux strictement selon la grille de l’enseignant. Six criteres : comparaison et contraste, grammaire, presence d’une these, preuves textuelles, niveau de detail, analyse. Pas un feedback generique « c’est bien ecrit », mais une evaluation precise sur chaque point.

Et quel a ete le resultat ?

Cinq eleves sur six ont ameliore leurs travaux sur au moins un critere. Un eleve a progresse sur trois criteres a la fois. La progression la plus significative – le critere « comparaison et contraste ». Trois eleves sont passes de 0-1 etoile a 2-3 etoiles.

Mais les chiffres, c’est une chose. Ce que disent les eleves eux-memes est plus revelateur. Voici une citation d’un groupe de discussion :

« C’etait utile parce qu’apres avoir ecrit, j’avais quelque chose de concret a corriger. L’outil m’a dit exactement ce qu’il fallait changer. »

Un autre eleve ajoute : « Je peux revenir dessus et voir ce que je peux ameliorer pour ensuite le corriger. »

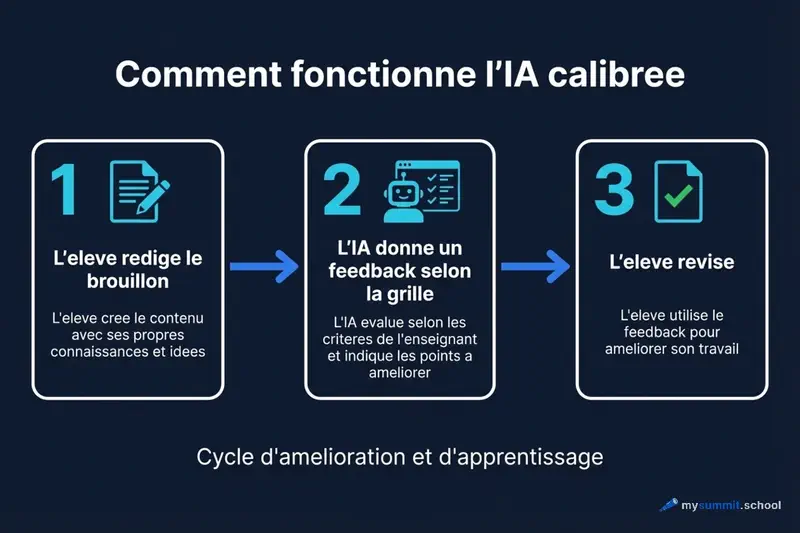

L’enseignant a egalement note la difference : « L’outil a motive les eleves a reviser leurs travaux. C’etait difficile a obtenir avant. » D’habitude, les eleves rendent leur dissertation et passent a autre chose. Ici, une motivation est apparue pour peaufiner le travail – parce que le feedback etait concret et comprehensible.

Quand les chercheurs ont analyse l’ensemble des retours, quatre mots-cles se sont degages : Helpful (utile), Direct (concret), Encouraging (motivant), Fixable (clair sur ce qu’il faut corriger). L’IA ne se contentait pas de critiquer – elle fournissait une feuille de route claire pour s’ameliorer.

Peut-on vraiment se fier a cette etude ?

Honnetement, quand j’ai vu ces resultats pour la premiere fois, ma premiere reaction a ete : « Seulement 6 eleves ? Serieusement ? »

Mais regardons de plus pres. C’est une etude pilote – une preuve de concept, pas un verdict final. Pour une etude pilote, six participants, c’est normal. De plus, la methodologie est transparente : plusieurs sources de donnees (brouillons, versions finales, groupes de discussion, questionnaires), protocole IRB (standards ethiques stricts), publication dans une revue a comite de lecture.

Et surtout – les auteurs reconnaissent eux-memes les limites. C’est toujours bon signe. Ils ecrivent clairement : oui, l’echantillon est petit. Oui, une seule ecole a faible budget – les resultats ne sont peut-etre pas transposables aux ecoles privees bien dotees. Oui, experience a court terme – on ignore l’effet au bout de six mois. Oui, donnees incompletes – tous les eleves n’ont pas rempli les questionnaires pre/post.

Cela signifie-t-il que l’etude ne prouve rien ? Non. Cela signifie que nous avons une preuve de concept. Pas une reponse definitive, mais un convaincant « oui, l’IA calibree fonctionne mieux que ChatGPT livre a lui-meme ». Suffisant pour essayer. Insuffisant pour decreter une revolution.

Quelle est la difference entre echec et reussite ?

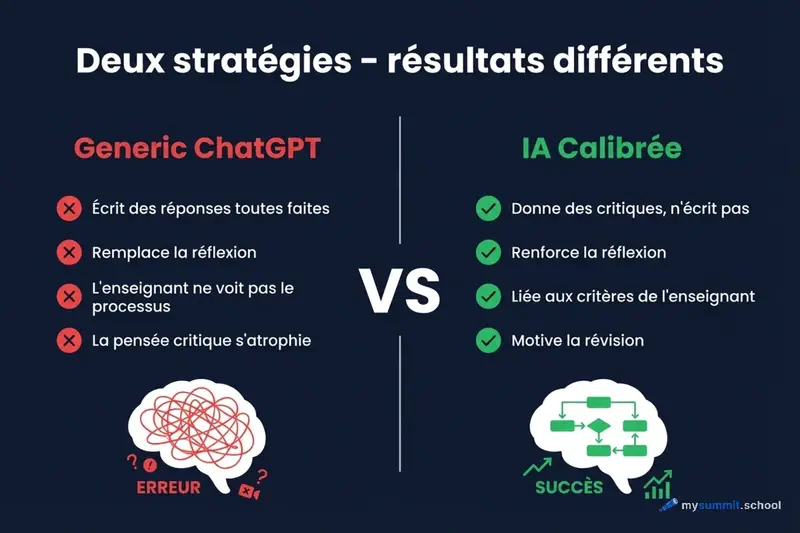

La meme technologie. ChatGPT d’un cote, un LLM de l’autre. Mais des resultats opposes. Pourquoi ?

Quand les ecoles autorisent simplement ChatGPT sans methodologie, les eleves copient les reponses toutes faites. Les enseignants ne savent pas distinguer le travail d’un eleve de celui d’un bot. La pensee critique s’atrophie – ce n’est pas mon hypothese, c’est ce que disent 70% des enseignants. L’isolement social s’accentue. Pourquoi discuter avec ses camarades quand ChatGPT repond toujours ?

En revanche, quand l’IA est correctement configuree – c’est une tout autre histoire. L’IA joue le role de critique, pas d’auteur. Le feedback est precis et lie aux criteres de l’enseignant. L’eleve ecrit lui-meme, l’IA pointe les faiblesses. La motivation a retravailler augmente – l’enseignant de l’Illinois le confirme.

Paradoxal, n’est-ce pas ? L’IA generique remplace la reflexion. L’IA calibree renforce la reflexion. Meme technologie, resultats opposes. Tout depend de comment on l’utilise, pas de ce qu’elle sait faire.

Calibrez l'IA pour vos programmes educatifs – la methode issue de l'etude de l'Universite de l'Illinois

Sans paiement requis • Notification au lancement

Et dans les ecoles francophones ?

L’etude de l’Illinois est impressionnante. Mais les chercheurs ont utilise CGScholar AI Helper – un outil specialise qui n’est pas forcement accessible partout. Nous disposons de ChatGPT, Claude, et selon les regions, de modeles locaux comme YandexGPT ou GigaChat. La calibration fonctionne-t-elle avec ces outils ?

En bref – oui. Le principe de calibration est universel, il n’est pas lie a un modele specifique. Que peut-on utiliser ?

ChatGPT – l’outil le plus repandu. Supporte les instructions personnalisees, les Custom GPTs, et la possibilite de charger des documents. On peut creer un assistant dedie a une matiere specifique avec des consignes pedagogiques precises.

Claude – excellent pour l’analyse de textes longs et le feedback structure. La fonctionnalite Projects permet de charger des documents de reference. Tres bon en francais et dans l’application de grilles d’evaluation detaillees.

La question est : que faire sans outil specialise ? Peut-on appliquer la methode de calibration « a la main » avec un LLM classique ? Oui, c’est possible.

Premiere etape – creez un prompt systeme avec votre grille d’evaluation. Par exemple, pour ChatGPT ou Claude :

Tu es un assistant pedagogique. Ta mission est d'evaluer la dissertation d'un eleve selon les criteres suivants : 1. Comparaison et contraste (0-3 etoiles) 2. Grammaire et orthographe (0-3 etoiles) 3. Presence d'une these (0-3 etoiles) 4. Preuves textuelles (0-3 etoiles) 5. Niveau de detail (0-3 etoiles) 6. Analyse (0-3 etoiles) N'ecris pas la dissertation a la place de l'eleve. Indique uniquement les points faibles specifiques et comment les ameliorer.

Deuxieme etape – chargez les supports dans le contexte. Dans ChatGPT, ajoutez les textes directement dans la conversation ou utilisez un Custom GPT. Avec Claude, chargez les documents dans un Project. Si vous avez acces a d’autres outils comme YandexGPT ou GigaChat – le principe reste le meme.

Troisieme etape – verifiez que l’IA n’ecrit pas a la place de l’eleve. Demandez uniquement une critique : « Evalue cette dissertation, mais NE propose PAS de texte tout fait ». Si l’IA commence a reecrire – ajustez le prompt.

Voici un exemple complet pour ChatGPT ou Claude :

Instruction systeme : "Tu es un correcteur exigeant de dissertations. Evalue le travail de l'eleve selon les criteres de l'enseignant. Indique uniquement les points faibles. Ne reecris pas le texte a la place de l'eleve." Requete utilisateur : "Voici la grille d'evaluation : [inserer les criteres]. Voici la dissertation de l'eleve : [texte]. Evalue chaque critere et indique concretement ce qui doit etre ameliore."

Ce n’est pas un remplacement identique de CGScholar, mais le principe est le meme – l’IA comme critique, pas comme auteur.

Que doivent faire les enseignants et les ecoles ?

Premierement – n’autorisez pas « l’IA en roue libre ». Permettre simplement l’utilisation de ChatGPT ou d’un autre LLM sans methodologie conduit a une degradation des competences. Il faut des protocoles clairs. Pas « vous pouvez utiliser l’IA », mais « voici comment utiliser correctement l’IA ».

Deuxiemement – calibrez l’IA pour vos exercices. Meme sans logiciel specialise. Creez un prompt systeme avec votre grille d’evaluation. Chargez les supports pedagogiques dans le contexte. L’IA doit fonctionner comme un critique, pas comme un auteur.

Troisiemement – utilisez la methode du « Sandwich » (Humain-IA-Humain). Etape 1 : l’eleve redige son brouillon seul. Etape 2 : l’IA fournit une critique basee sur des criteres precis. Etape 3 : l’eleve revise son travail en s’appuyant sur la critique. L’humain au debut, l’humain a la fin. L’IA au milieu, comme un correcteur.

Implementez la methode Humain-IA-Humain dans la formation de vos collaborateurs – sans perte de qualite ni de motivation

Sans paiement requis • Notification au lancement

Quatriemement – evaluez le processus, pas seulement le resultat. Soutenance orale du travail – l’eleve doit pouvoir expliquer chaque argument. Historique des versions dans Google Docs – tout le processus de redaction est visible. Evaluation de la qualite des prompts – un bon prompt demontre une comprehension approfondie du sujet.

Cinquiemement – preservez le contact humain. L’IA pour les devoirs a la maison, les echanges en direct pour la classe. Des debats et discussions obligatoires sans appareils numeriques. Des entretiens de 5 minutes apres chaque travail ecrit. La technologie ne doit pas remplacer la communication.

Pour les managers et les parents

Si vous choisissez une ecole ou evaluez un programme de formation existant, il convient de poser quelques questions essentielles. Les enseignants ont-ils ete formes a l’IA ? Actuellement, seuls 48% ont recu une telle formation, et c’est un point critique. L’ecole a-t-elle une politique claire d’utilisation de l’IA, ou est-ce simplement « vous pouvez utiliser ChatGPT » ? L’IA est-elle configuree pour un programme specifique, ou l’ecole utilise-t-elle des solutions generiques ? Comment l’ecole previent-elle concretement l’isolement social des eleves ? Et enfin – existe-t-il un code ethique d’utilisation de l’IA ?

Les bons signes sont les suivants : l’eleve peut expliquer comment il a utilise l’IA pour un travail precis. Les enseignants disposent de grilles d’evaluation qui prennent en compte l’utilisation de l’IA. L’IA est utilisee pour le feedback et la critique, pas pour la simple generation de contenu tout fait. Et surtout – suffisamment de temps est consacre aux echanges directs avec l’enseignant, car sans cela, l’education perd son sens.

Les signaux d’alerte, en revanche : l’eleve fait un simple copier-coller depuis ChatGPT et ne peut pas expliquer le contenu. Les enseignants ne savent pas comment evaluer les travaux a l’ere de l’IA et sont completement desempares. L’ecole n’a pas de politique coherente d’utilisation de l’IA – chacun fait ce qu’il veut. Et le plus dangereux – l’enfant a visiblement perdu sa motivation d’apprendre, parce que « on peut tout demander au bot ».

Pour la formation en entreprise et les formateurs

Il est interessant de noter que ces memes principes fonctionnent parfaitement pour la formation des collaborateurs en entreprise. Calibrez votre IA d’entreprise selon vos standards et processus – exactement comme un enseignant configure l’IA selon sa grille d’evaluation. La methode du « Sandwich » convient parfaitement a la preparation de presentations, rapports et strategies – le collaborateur redige un brouillon, l’IA critique, le collaborateur finalise.

Evaluez la qualite des prompts de vos collaborateurs – c’est un indicateur direct de leur comprehension de la tache. Si une personne sait formuler un bon prompt, c’est qu’elle comprend en profondeur le probleme. Et la soutenance orale des idees compte toujours plus que de belles presentations generees par l’IA.

Voici un exemple concret. Au lieu de « Demandez a ChatGPT de rediger une strategie », essayez ceci : « Redigez vous-meme les grandes lignes de la strategie, demandez a l’IA d’identifier les failles logiques, retravaillez sur la base de cette critique, puis presentez oralement devant l’equipe ». Vous voyez la difference ? Dans le premier cas, l’humain est exclu du processus. Dans le second, il est au centre, et l’IA le renforce.

Code ethique de l’IA dans l’education

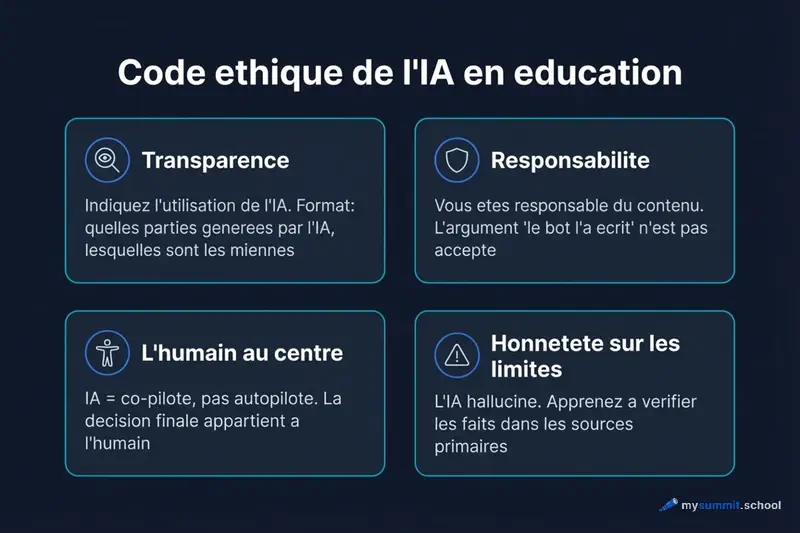

A partir de ces deux etudes, on peut degager quatre principes cles qui devraient figurer dans chaque etablissement.

La transparence – premier principe. Si un eleve a utilise l’IA, il doit le signaler. Et pas simplement « oui, j’ai utilise ChatGPT », mais concretement : « L’introduction a ete generee par ChatGPT, le corps du texte a ete ecrit par moi, les conclusions ont ete formulees conjointement ». Ce niveau de detail enseigne l’honnetete et aide l’enseignant a evaluer la contribution reelle de l’eleve.

La responsabilite – deuxieme principe. Pour tout texte remis a l’enseignant, la responsabilite incombe a l’eleve. Point final. L’argument « c’est le bot qui a ecrit ca » n’est pas recevable et ne doit jamais l’etre. Si vous rendez un travail avec des erreurs ou des inexactitudes factuelles – c’est votre probleme, meme si ChatGPT vous a induit en erreur.

L’humain reste au centre – troisieme principe. L’IA fonctionne comme un co-pilote, pas un pilote automatique. La decision finale appartient toujours a l’humain. Ce ne sont pas de belles paroles – c’est la difference cruciale entre le renforcement des capacites et leur degradation.

L’honnetete sur les limites – quatrieme principe. L’IA hallucine – apprenons a verifier les faits dans les sources primaires. L’IA peut etre biaisee – apprenons a evaluer ses conseils de maniere critique. L’IA ne comprend pas le contexte de votre situation specifique – apprenons a y ajouter notre experience et notre bon sens. La technologie est puissante, mais pas magique.

Conclusions : et maintenant ?

Rassemblons le tout. Les etudes de 2025 font emerger trois enseignements cles.

Premier enseignement – le deploiement massif et non controle de l’IA detruit l’education. Les chiffres parlent d’eux-memes : 86% des eleves utilisent l’IA, mais la moitie d’entre eux sentent qu’ils perdent le lien avec leurs enseignants. 70% des professeurs constatent une degradation de la pensee critique chez leurs eleves. L’isolement social s’accentue – pourquoi discuter avec ses camarades quand ChatGPT est toujours disponible ?

Deuxieme enseignement – l’IA calibree produit l’effet inverse. Cinq eleves sur six ont ameliore leurs competences redactionnelles en travaillant avec une IA correctement configuree. Les eleves eux-memes decrivent le feedback comme « helpful, direct, encouraging, fixable » – utile, concret, motivant, clair sur ce qu’il faut corriger. Les enseignants notent un regain de motivation pour la revision des travaux, ce qui etait impossible a obtenir auparavant.

Troisieme enseignement – la cle du succes ne reside pas dans les interdictions, mais dans la methodologie. Calibration de l’IA pour un enseignant specifique via le RAG et les grilles d’evaluation. Methode du « Sandwich » avec le cycle Humain-IA-Humain. Evaluation du processus de travail, pas seulement du resultat final. Et preservation du contact humain – sans cela, l’education perd son sens, aussi performante que soit l’IA.

Que faire des maintenant

Voici les etapes concretes selon votre role.

Si vous etes enseignant – commencez modestement, mais commencez maintenant. Suivez une formation sur l’IA, meme s’il ne s’agit que d’un webinaire d'1 a 2 heures – une comprehension de base est indispensable. Creez une grille d’evaluation claire qui integre l’utilisation de l’IA – sans cela, vous evaluerez a l’aveugle. Essayez la methode du « Sandwich » sur au moins un exercice et observez les resultats par vous-meme.

Si vous etes responsable d’un projet educatif – c’est la qu’il faut investir. Investissez dans la formation des enseignants, car actuellement seuls 48% ont ete formes, et c’est dramatiquement insuffisant. Deployez des solutions calibrees plutot que de simplement dire « utilisez ChatGPT ». L’IA generique sans methodologie est la voie de la degradation. Elaborez un code ethique d’utilisation de l’IA pour que tout le monde joue selon les memes regles.

Si vous etes parent – posez les questions qui derangent. Interrogez l’ecole sur sa politique d’utilisation de l’IA. Discutez avec votre enfant de la facon dont il utilise l’IA – pour obtenir du feedback ou simplement pour copier ? Insistez sur le maintien du contact humain avec les enseignants, car sans cela, l’education devient une formalite.

Si vous etes formateur en entreprise – adaptez la methode du « Sandwich » a la formation professionnelle, elle fonctionne tout aussi bien qu’a l’ecole. Evaluez la qualite des prompts de vos collaborateurs – c’est le meilleur indicateur de la comprehension d’une tache. Mettez en place des soutenances orales au lieu de vous contenter de belles presentations generees par l’IA.

Maitrisez la calibration de l'IA pour vos programmes educatifs

Apprenez a appliquer les principes de cette etude : configuration de l'IA selon vos criteres, methode du Sandwich, evaluation de la qualite des prompts. Pour les formateurs, les RH et les responsables de programmes de formation.

L’avenir de l’education : un modele hybride

Les etudes de 2025 montrent la voie a suivre – et elle ne se situe pas dans les extremes. Ni interdiction totale de l’IA, ni immersion complete dans la technologie. Un modele hybride.

A la maison, seul face a l’ecran et a une IA calibree – collecte de materiaux, structuration des idees, obtention d’une critique precise selon les criteres de l’enseignant. Ici, la technologie aide l’eleve a reflechir plus en profondeur, a identifier les points faibles, a ameliorer son argumentation.

En classe, sans appareils ni IA – les conclusions finales sont redigees a la main. Debats et discussions avec des personnes reelles, ou il faut reagir rapidement et defendre sa position. Soutenance orale devant l’enseignant, ou il est impossible de se cacher derriere un texte ecrit par quelqu’un d’autre.

Paradoxalement, le meilleur resultat ne vient pas de « l’IA contre l’humain », mais de « l’IA + l’humain » – chacun a sa place. L’IA comme co-pilote, pas comme pilote automatique. Ca vous rappelle quelque chose ? En formation professionnelle, c’est exactement le meme principe qui s’applique – la technologie renforce l’humain, mais ne le remplace pas.

Sources et ressources complementaires

Etudes principales :

Zheldibayeva, R., Nascimento, A. K. de O., Castro, V., Kalantzis, M., & Cope, B. (2025). The impact of AI-driven tools on student writing development: A case study. Online Journal of Communication and Media Technologies, 15(3), e202526. Texte integral sur arXiv

Vilcarino, J., & Langreo, L. (2025, October 8). Rising use of AI in schools comes with big downsides for students. Education Week. Article sur Education Week