L'IA fait gagner 6 heures par semaine aux enseignants. Mais 97 % ne le remarquent pas

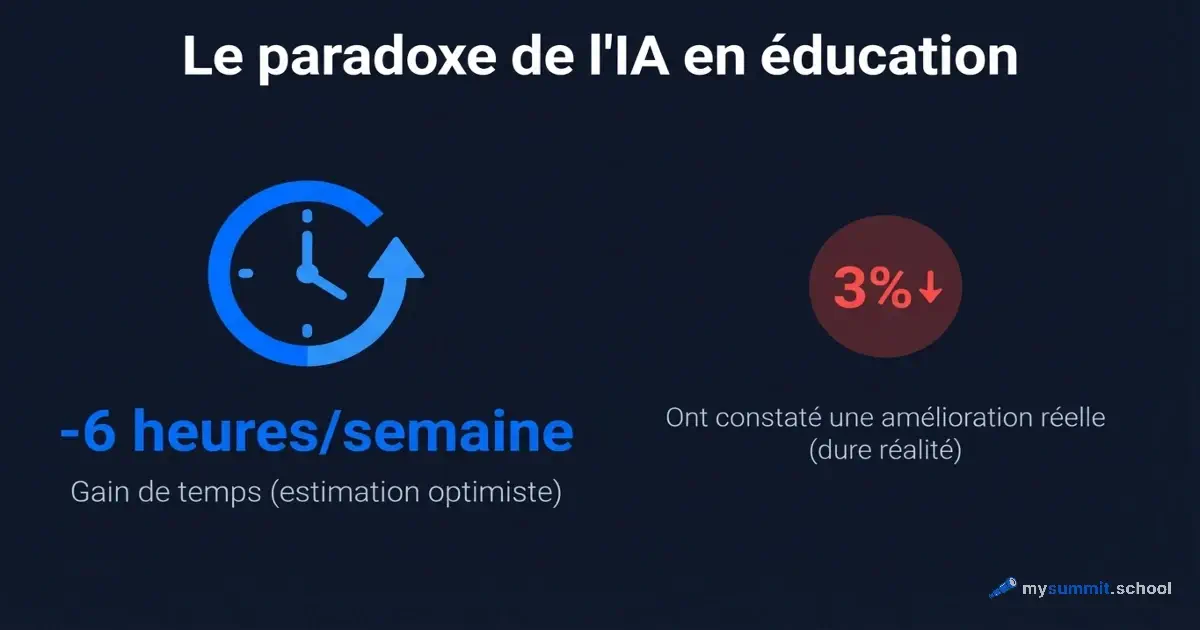

L’enquête Gallup et Walton Family Foundation (2024–2025, échantillon représentatif d’enseignants américains) a livré un chiffre saisissant : les enseignants qui utilisent régulièrement l’IA économisent en moyenne 5,9 heures par semaine – l’équivalent de six semaines de travail complètes sur une année scolaire. On pourrait croire le problème résolu.

Mais une enquête parallèle de la Royal Society of Chemistry (2024, Royaume-Uni) dresse un tout autre tableau : 44 % des enseignants ont essayé l’IA, mais seulement 3 % déclarent une réduction réelle de leur charge de travail. Un professeur de mathématiques irlandais a résumé cet écart mieux que n’importe quelle statistique : « L’IA génère des fiches rapidement, mais il faut les vérifier soigneusement – et le gain de temps s’avère moindre qu’espéré ».

Qui a raison ? Nous avons déjà analysé la crise de l’IA dans l’éducation du côté des élèves – 86 % des élèves utilisent l’IA, mais la pensée critique se dégrade. Maintenant – le côté enseignant. En deux ans, suffisamment de données expérimentales se sont accumulées pour répondre à cette question par des chiffres, pas par des opinions.

Ce que montrent les expériences

Tâches structurées : l’IA fonctionne

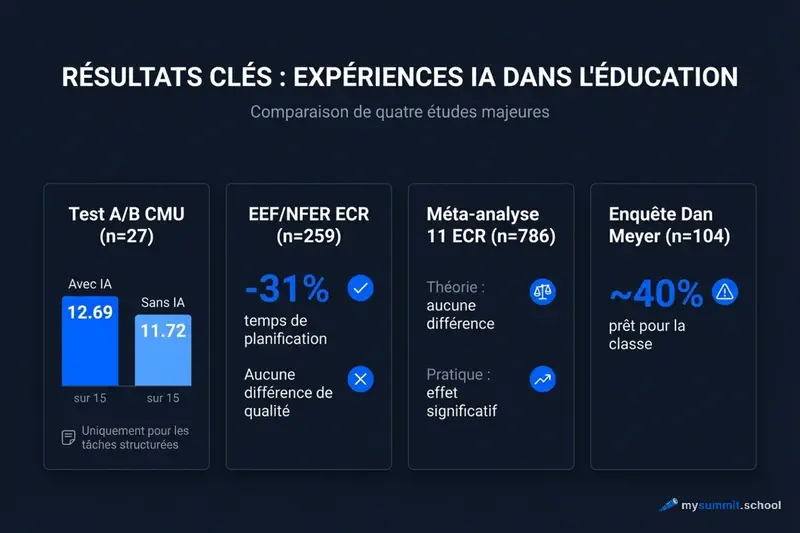

Une étude de Carnegie Mellon University (Moore et al., AIED 2025) a mené un test A/B : 27 étudiants en master ont créé 8 micro-leçons chacun – quatre avec ChatGPT (GPT-4), quatre sans. L’évaluation a été réalisée en aveugle selon une grille à 5 critères (maximum 15 points).

Résultat : les micro-leçons assistées par l’IA ont obtenu 12,69/15 contre 11,72/15 sans IA. La différence est statistiquement significative. Mais – et c’est essentiel – l’effet ne s’est manifesté que pour les tâches structurées : conception universelle de l’apprentissage, découverte guidée, « explique–pratique ». Pour les tâches exigeant de la créativité ou une sensibilité sociale – apprentissage collaboratif, tutorat par les pairs – aucune différence.

Le même schéma a été observé par Philippa Hardman dans son étude : pour les tâches « structurées et bien connues », l’IA a amélioré la qualité ; pour les tâches originales et socialement nuancées, elle l’a dégradée de 19 points de pourcentage.

La conclusion des deux études est identique : l’IA renforce ce qui est déjà bien formalisé. Là où il faut une solution pédagogique originale, elle est inutile – voire nuisible.

En classe réelle : du temps gagné, pas de qualité en plus

L’essai randomisé contrôlé le plus important dans ce domaine a été mené par l’Education Endowment Foundation (EEF) avec le NFER : 259 enseignants dans 68 écoles britanniques. Les enseignants ont reçu ChatGPT et un guide détaillé d’utilisation.

Résultat sur le temps : 25,3 minutes économisées par semaine – une réduction de 31 % du temps de préparation. Mais le panel d’experts indépendants chargé d’évaluer la qualité des leçons n’a détecté aucune différence notable entre les cours préparés avec l’IA et le groupe témoin.

C’est la conclusion la plus inconfortable de tout le corpus de recherche. L’IA fait gagner du temps – mais n’améliore pas ce que l’enseignant produit pendant ce temps.

Méta-analyse : compétences pratiques – oui, théorie – non

Une méta-analyse de 11 essais randomisés contrôlés (PMC, 2025, 786 étudiants en médecine) a confirmé la tendance : les connaissances théoriques ne différaient pas entre les groupes avec et sans IA. Mais les compétences pratiques étaient significativement plus élevées dans le groupe IA – avec une taille d’effet notable.

L’IA aide à apprendre le « comment faire ». Elle n’aide pas à comprendre le « pourquoi ça marche ».

Là où l’IA échoue : trois problèmes systémiques

45 % des leçons restent au niveau « se souvenir »

Une étude de UMass-Amherst (2025, 310+ leçons d’éducation civique, 3 systèmes d’IA) a révélé l’ampleur du problème. Parmi toutes les leçons générées par l’IA :

- 45 % restaient au niveau « se souvenir » – le plus bas de la taxonomie de Bloom (hiérarchie des tâches cognitives : de la mémorisation de faits à l’analyse, l’évaluation et la synthèse créative)

- Seulement 4 % proposaient de l’analyse ou de la création

- Seulement 2 % demandaient aux élèves d’évaluer l’information

- À peine 11–16 % intégraient un usage pertinent des technologies éducatives

L’IA produit des leçons qui ont l’air structurées, mais dont la profondeur cognitive équivaut à un cahier d’exercices des années 1990. Ce n’est pas un défaut d’un modèle en particulier. C’est la conséquence de la façon dont les modèles de langage sont entraînés : sur des corpus où les explications simples et les questions de vérification sont bien plus fréquentes que les exercices de pensée critique.

Les enseignants surestiment le degré de finition des leçons IA

L’enquête de Dan Meyer (104 professeurs de mathématiques, 2024) a donné une évaluation concrète : les supports générés par l’IA sont prêts à l’emploi à environ 40 %. Le mythe de la « règle 80/20 » – l’IA fait 80 % du travail, l’enseignant peaufine les 20 % restants – s’est avéré plus proche du ratio inverse. Citation d’un répondant : « Il m’est plus facile de créer les diapositives à partir de zéro que d’extraire quelque chose de ce que l’IA a produit ».

L’étude de SUNY Geneseo (étudiants en formation enseignante, 2024) l’a confirmé sous un autre angle : lorsque de futurs enseignants ont reçu la consigne d’analyser attentivement des plans de cours générés par l’IA, leur confiance envers l’outil a diminué significativement. Ils ont relevé des incohérences entre objectifs et exercices, des erreurs factuelles, l’absence d’étayage pour les élèves de niveaux différents.

La conclusion est paradoxale : plus un enseignant examine un cours généré par l’IA en profondeur, moins il l’évalue favorablement. Un contrôle superficiel crée une illusion de qualité.

La « taxe de vérification » annule les économies

Voilà qui explique l’écart entre Gallup (5,9 heures d’économie) et la RSC UK (3 % ont réellement perçu une différence). Les enseignants qui déclarent des gains de temps ne comptent souvent pas le temps de vérification et de retouche. Ceux qui le comptent constatent que l’économie disparaît en partie ou en totalité.

Pourquoi des prompts structurés changent le résultat

Les études montrent qu’environ 50 % de l’amélioration de la qualité des leçons IA dépend non pas du modèle, mais de la manière dont la requête est formulée.

Données concrètes :

- Les prompts structurés produisent un contenu éducatif environ 60 % plus précis et pertinent que les prompts non structurés

- Spécifier le niveau de Bloom a fait passer la répartition de 78 % de questions de mémorisation à une majorité au niveau analyse et application

- Intégrer le principe de conception inversée (du résultat attendu vers les activités) a amélioré la cohérence entre objectifs, exercices et évaluation de 40 à 60 %

- Préciser les critères d’évaluation a réduit le volume de retouches post-génération d’environ 35 %

La différence entre « Crée un cours sur les équations du second degré pour la 3e » et un prompt structuré précisant le niveau de Bloom, le format de travail, le résultat attendu et les critères d’évaluation – c’est la différence entre un cours prêt à 40 % et un cours prêt à 75 %.

Cela explique aussi pourquoi la structure du prompt compte – pas seulement pour les managers, mais de manière critique pour les enseignants.

Autre piste de preuves : les outils éducatifs spécialisés (Curipod, MagicSchool AI, Diffit, SchoolAI) affichent une satisfaction enseignante nettement supérieure à celle de ChatGPT brut. La raison ne tient pas au modèle, mais au fait que le prompt contient déjà des contraintes pédagogiques : référentiels, filtre d’âge, gabarit de cours. Les enseignants qui utilisent ChatGPT directement doivent formuler eux-mêmes ces contraintes. La plupart ne le font pas.

Obtenez des scénarios IA pour votre cours

Entrez votre matière et le sujet du cours – obtenez des scénarios d'utilisation de l'IA en classe, des prompts prêts à l'emploi et des exercices que les élèves ne peuvent pas déléguer à une IA (actuellement en russe).

Sans inscription · Résultat en 30 secondes

Le fossé mondial de la formation

Les données expérimentales convergent : l’IA fonctionne quand l’enseignant sait s’en servir. Mais l’écart entre « essayer l’IA » et « l’utiliser de façon soutenue » est un phénomène mondial – pas un problème propre à un seul pays.

États-Unis : beaucoup d’essais, peu d’usage régulier

Selon Gallup, plus de 50 % des enseignants américains ont essayé l’IA. Mais les données EdWeek/RAND révèlent que seuls environ 20 % l’utilisent régulièrement. L’écart entre essai ponctuel et adoption durable est considérable – et se retrouve partout dans le monde.

Le problème n’est pas le manque de curiosité. C’est le manque d’accompagnement structuré pour passer de l’expérimentation à l’intégration dans la pratique quotidienne.

Royaume-Uni : gains de temps sans gains de qualité

Les données de la RSC (citées plus haut) montrent que 44 % des enseignants ont essayé l’IA, mais seulement 3 % ont constaté une réduction réelle de leur charge de travail. L’étude de l’EEF a confirmé la même dynamique à plus grande échelle : le temps de préparation a diminué de 31 %, mais la qualité des leçons n’a pas bougé.

C’est le paradoxe central : l’IA accélère la production sans en améliorer le résultat – sauf quand l’enseignant sait exactement quoi vérifier et quoi réécrire.

Certification de masse vs. formation approfondie : deux études de cas internationales

Le contraste le plus frappant se trouve entre deux programmes de formation aux antipodes par leur approche.

Kazakhstan : le programme Orleu/UNESCO (2025) a délivré 252 000 certifications en IA-literacy à des enseignants. Le programme était obligatoire et gratuit. Mais son contenu portait sur la culture IA générale, pas sur l’application disciplinaire. Résultat : 252 000 enseignants certifiés « IA-literate » – et aucun rapport public ne documente combien d’entre eux utilisent effectivement l’IA dans leurs cours. Un certificat n’est pas une compétence.

Bélarus : le BGPU a formé 97 enseignants dans un programme approfondi d’IA appliquée à l’enseignement. Résultat : plus de 70 % ont développé leurs propres méthodologies IA et les ont mises en pratique. C’est le taux de conversion « formation → pratique » le plus élevé de toutes les données disponibles.

La leçon est limpide : la profondeur de la formation compte infiniment plus que l’ampleur de la certification. 97 enseignants dotés de compétences réelles produisent un impact supérieur à 252 000 certificats sans application concrète.

Ce constat rejoint directement ce que les recherches montrent sur « l’illusion de profondeur » dans la formation IA : les programmes de masse sans ancrage pratique créent un sentiment de compétence qui ne repose sur aucun savoir-faire réel.

Recommandations pratiques : comment utiliser l’IA pour préparer un cours

L’ensemble des recherches fournit un cadre de référence concret.

Principe : l’IA est un premier brouillon, pas un cours fini

Aucune étude n’a montré qu’un cours généré par l’IA pouvait être utilisé tel quel. Les données de Dan Meyer (40 % de finition), de l’EEF (aucune différence de qualité), de UMass (45 % au niveau « se souvenir ») concordent : l’IA produit un point de départ, pas un produit final.

Sa valeur réside dans l’élimination du syndrome de la page blanche. L’IA permet d’obtenir rapidement une structure que l’on peut retravailler de manière critique. C’est plus rapide que de partir de zéro – mais uniquement si l’enseignant sait exactement ce qu’il doit retravailler.

Ce qu’il faut préciser dans le prompt lors de la génération d’un cours

Le niveau de Bloom doit être indiqué explicitement pour chaque section – sinon 45 % du contenu restera au niveau « se souvenir » (données UMass). Exemple : « Introduction – compréhension, pratique – application/analyse, réflexion – évaluation ».

Un livrable concret pour les élèves doit être formulé directement : non pas « discutez en groupes », mais « les élèves produisent X, démontrant la compréhension de Y ». C’est ce qui distingue un cours efficace d’un cours formel.

L’anticipation des erreurs fréquentes mérite d’être demandée dans le prompt : « Quelles sont les idées reçues typiques des élèves sur ce sujet ? » C’est ce qui distingue un plan de cours expert d’un plan générique – et que l’IA ne fait pas sans demande explicite.

La conception inversée renverse l’ordre : commencez par les critères d’évaluation, puis déduisez-en les activités. Par défaut, l’IA fait l’inverse – elle génère d’abord les activités, puis ajuste l’évaluation.

La « taxe de vérification » doit être prévue en amont : un cours généré par l’IA nécessitera 30 à 60 % du temps pour vérifier les faits, adapter au groupe classe et corriger le niveau cognitif. Si vous n’avez pas prévu ce temps, vous n’avez pas économisé – vous avez déplacé la charge.

Ce qu’il faut vérifier dans un cours généré par l’IA

- La cohérence entre les activités et les objectifs annoncés – principale faiblesse identifiée dans l’étude de SUNY Geneseo

- L’exactitude factuelle – l’IA hallucine dans 3 à 9 % des cas sur les sujets généraux, et jusqu’à 30 % sur les sujets spécialisés

- Le niveau cognitif de chaque activité – à étiqueter manuellement selon Bloom

- La présence d’étayages et d’indices pour les élèves de niveaux différents

- Le lien avec les cours précédents et suivants (l’IA traite chaque leçon comme un objet isolé)

L’IA fonctionne le mieux pour ceux qui en ont le moins besoin

La conclusion la plus inconfortable des sept expériences : les outils IA de préparation de cours produisent le meilleur effet entre les mains d’enseignants qui savent déjà à quoi ressemble un bon cours. Pour eux, l’IA est un accélérateur : un brouillon rapide qu’ils savent retravailler.

Pour les enseignants qui n’ont pas ce socle, l’IA crée un autre risque. SUNY Geneseo l’a montré : sans vérification critique, les cours générés par l’IA semblent convaincants mais contiennent des faiblesses systémiques. Si l’enseignant ne les voit pas, il les reproduit en classe.

C’est exactement le mécanisme que l’étude d’Anthropic a observé chez les développeurs : l’IA réduit la friction cognitive – et avec elle, la profondeur de compréhension. Pour un enseignant qui construit encore sa pensée pédagogique, ce n’est pas une accélération. C’est un raccourci.

Les données mondiales le confirment : 252 000 enseignants kazakhs certifiés en IA-literacy ne savent pas comment l’appliquer en cours. Plus de 50 % des enseignants américains ont essayé l’IA, mais seuls 20 % l’utilisent de façon régulière. Au Royaume-Uni, 44 % ont essayé, 3 % ont vu une différence. Le problème n’est pas dans les outils IA. Il est dans l’écart entre « je sais que l’IA existe » et « je sais utiliser l’IA pour améliorer mon cours de mardi ».

Les 97 enseignants biélorusses du programme BGPU ont comblé cet écart – et 70 % d’entre eux ont créé leurs propres méthodologies. La différence : non pas le volume de la formation, mais sa profondeur et son ancrage disciplinaire. J’observe le même schéma dans mes échanges avec des managers et des enseignants : savoir que l’IA existe et savoir l’appliquer mardi – ce sont deux compétences distinctes, avec des parcours de développement différents.

Une question pour chaque enseignant qui lit ces lignes : votre dernier plan de cours généré par l’IA – l’avez-vous vérifié selon Bloom ? Ou l’avez-vous accepté parce qu’il avait l’air structuré ?

Vous utilisez l'IA – mais repérez-vous les erreurs cachées ?

9 leçons diagnostiques : essayez d'appliquer l'IA à des tâches réelles – et découvrez les erreurs que la plupart ne voient pas. Gratuit, sans inscription.