L'IA ne vous rend pas plus bête. Tout dépend de comment vous l'utilisez

Il y a un an et demi, j’ai publié un billet sur mon blog personnel à propos d’un phénomène que j’observais chez mes collègues et dans mon propre travail : plus on fait confiance à l’IA, moins on se pose la question « est-ce que c’est vraiment juste ? ». Je m’appuyais alors sur une étude de Microsoft qui montrait que la confiance envers l’IA inhibe l’évaluation critique des réponses fournies. L’argument me semblait solide, mais il avait un défaut évident : corrélation, pas causalité.

En février 2026, les chercheurs d’Anthropic Judy Shen et Alex Tamkin ont publié une expérience qui a comblé cette lacune. Un essai randomisé contrôlé. Des données concrètes. Et une conclusion que, je crois, la plupart des gens qui l’ont lue comprennent mal.

Parce que ce n’est pas une histoire sur le fait que l’IA nous rend plus bêtes. C’est une histoire sur la manière dont nous l’utilisons.

Ce qui s’est passé dans l’expérience

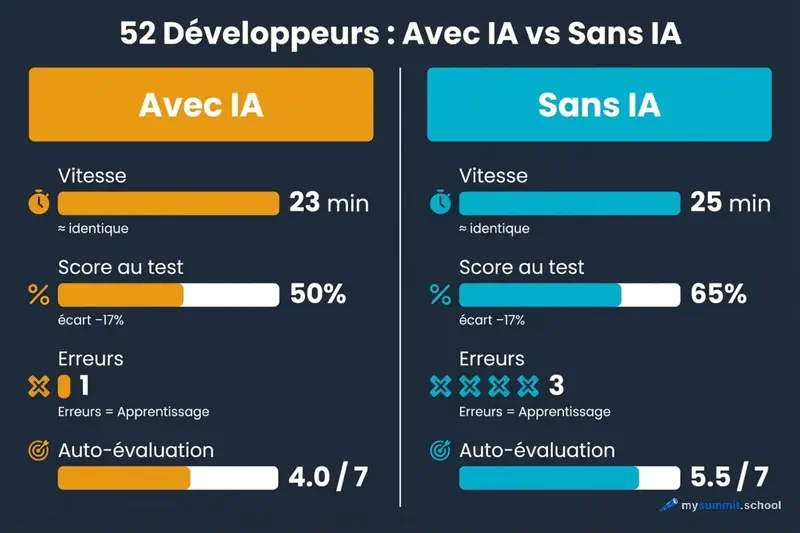

52 développeurs ont reçu une mission : apprendre à travailler avec Trio, une bibliothèque Python d’asynchronisme qu’ils ne connaissaient pas. 26 ont travaillé avec un assistant IA, 26 – sans. Après avoir terminé la tâche, tous ont passé un test de compréhension.

Le groupe avec IA a obtenu un score inférieur de 17 %. Un écart statistiquement significatif et, à l’échelle des études comportementales, substantiel.

Mais voici ce qui est intéressant : la vitesse d’exécution de la tâche était pratiquement identique dans les deux groupes. L’IA n’a pas aidé à travailler plus vite. En revanche, elle a aidé à moins comprendre.

Les chercheurs ont également relevé un détail révélateur : certains participants passaient jusqu’à 11 minutes rien que pour formuler une seule requête à l’IA. Les coûts transactionnels du travail avec l’IA se sont avérés comparables au temps nécessaire pour trouver la solution par soi-même.

Et un autre fait qui explique pourquoi le groupe sans IA a mieux réussi : ils ont rencontré une médiane de 3 erreurs par participant, contre une médiane de 1 pour le groupe avec IA. Cela ressemble à un avantage. En réalité, c’est un inconvénient : c’est précisément la confrontation à l’erreur qui oblige à comprendre ce qui se passe.

Les participants du groupe avec IA l’ont eux-mêmes reconnu. Dans leurs retours réflexifs, ils écrivaient qu’ils s’étaient sentis « paresseux » et regrettaient de ne pas avoir creusé les détails. L’IA a réduit la friction cognitive – et avec elle, la profondeur d’apprentissage.

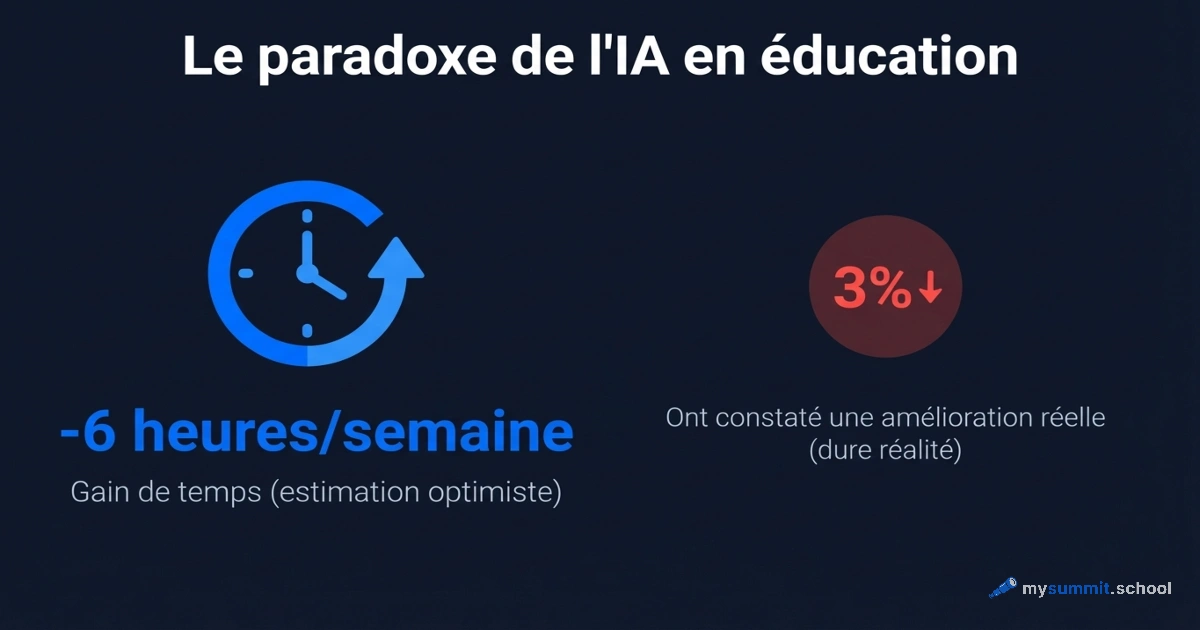

Un schéma similaire a été observé dans l’éducation : une étude a montré que 86 % des élèves utilisant l’IA présentent une dégradation de la pensée critique – précisément parce qu’ils ont cessé de rencontrer des difficultés.

Six modes d’utilisation – et pourquoi c’est plus important que « utiliser ou pas »

C’est ici que ça devient vraiment intéressant. Les chercheurs ne se sont pas arrêtés à la comparaison entre groupes. Ils ont étudié comment exactement les participants interagissaient avec l’IA, et ont identifié six modes d’utilisation récurrents.

Trois modes ont donné des résultats faibles au test (24–39 % de bonnes réponses). Trois – des résultats élevés (65–86 %).

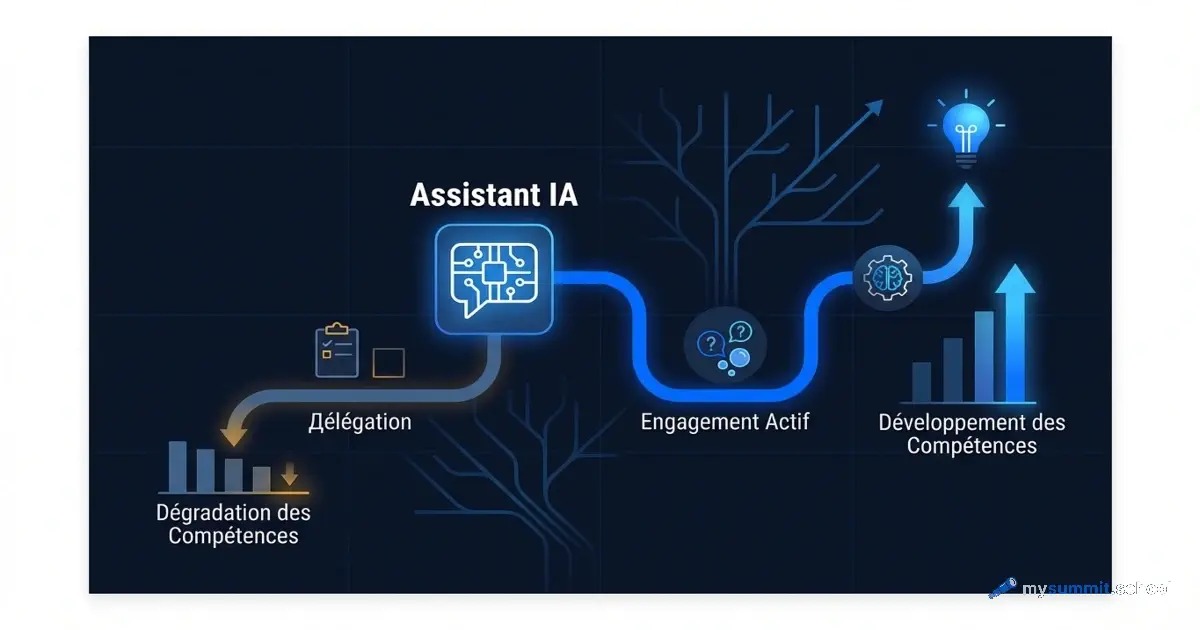

La différence ne tient pas au fait d’avoir utilisé ou non l’IA. La différence tient au fait que la personne restait ou non un agent pensant dans le processus.

Modes à faibles résultats

AI Delegation – délégation totale. Le participant demandait simplement à l’IA d’écrire le code et acceptait le résultat sans l’étudier. Score moyen : environ 24 %.

La requête typique ressemblait à ceci :

Écris une fonction pour la lecture asynchrone de fichiers avec la bibliothèque Trio.

Le code fonctionnait. La compréhension, non. Dès qu’un écart au modèle apparaissait, le participant retournait vers l’IA.

Progressive AI Reliance – dépendance croissante. Les participants commençaient de manière autonome, puis déléguaient progressivement de plus en plus, jusqu’à tout confier à l’IA. Score moyen : environ 28 %.

La progression typique :

Comment fonctionne nursery dans Trio ? ... (plusieurs itérations) ... Écris-moi simplement un exemple fonctionnel avec nursery pour ma tâche.

Le point clé : le passage des questions au « écris-le pour moi » se faisait insensiblement, dès la première difficulté rencontrée.

Iterative AI Debugging – débogage via l’IA sans compréhension des causes. Le participant lançait le code, obtenait une erreur, l’envoyait à l’IA et appliquait la correction proposée. Le cycle se répétait. Score moyen : environ 39 %.

J'obtiens l'erreur : TaskGroup is not a function. Comment corriger ?

Le code finissait par fonctionner. Mais le participant n’a jamais compris pourquoi.

Modes à résultats élevés

Generation-Then-Comprehension – génération puis étude. L’IA écrit le code, mais le participant le décortique ensuite ligne par ligne en posant des questions de précision. Score moyen : environ 86 %.

Écris une fonction pour l'exécution parallèle de tâches avec Trio nursery. Ensuite, explique-moi : - Pourquoi utiliser async with et pas simplement with ? - Que se passe-t-il si l'une des tâches dans la nursery lève une exception ? - En quoi est-ce différent du asyncio standard ?

La différence est radicale. L’IA ne remplace plus la réflexion – elle en devient l’instrument.

Hybrid Code-Explanation – demande simultanée de code et d’explication. Le participant demandait dès le départ non pas une simple solution, mais une compréhension. Score moyen : environ 75 %.

Montre un exemple d'utilisation de trio.open_nursery() et explique en même temps : 1. Ce que fait chaque ligne 2. Quels concepts clés je dois comprendre pour savoir l'appliquer par moi-même 3. Quelles erreurs typiques sont commises lors de la première utilisation

Conceptual Inquiry – questions conceptuelles, implémentation autonome. Le participant utilisait l’IA uniquement pour comprendre les principes et écrivait le code lui-même. Score moyen : environ 65 %.

Explique le concept de structured concurrency dans Trio. Ne montre pas de code – seulement l'idée. Pourquoi est-ce mieux que de simplement lancer des coroutines directement ?

Après une telle explication, le participant implémentait la solution lui-même, rencontrait des erreurs – et les résolvait. Exactement comme le faisait le groupe témoin.

Ce que cela signifie pour un manager

Il est important ici de ne pas commettre d’erreur d’interprétation. L’étude a été menée sur des développeurs apprenant un outil technique. Mais le mécanisme est universel – et, peut-être, encore plus significatif pour les managers.

Un développeur peut vérifier : le code fonctionne ou non. Un manager n’a pas ce retour immédiat. Un e-mail rédigé par l’IA a l’air convaincant. Une analyse des risques – bien structurée. Un compte rendu de réunion – cohérent. Vérifier dans quelle mesure tout cela reflète fidèlement la réalité et correspond à vos intuitions managériales est nettement plus difficile.

Cela signifie que la dégradation des compétences chez un manager peut se produire plus silencieusement et rester inaperçue plus longtemps.

Regardons les tâches managériales typiques à travers le prisme des six modes d’utilisation.

Prenons les comptes rendus de réunion. Le mode délégation ressemble à ceci :

Voici la transcription de la réunion. Rédige un résumé avec les décisions clés et les prochaines étapes.

Le mode à résultat élevé, lui, ressemble à ceci :

Voici la transcription de la réunion. Identifie trois moments où les participants semblaient parler de la même chose mais pensaient en réalité à des choses différentes. Explique pourquoi tu penses cela.

Dans le second cas, l’IA devient un outil de développement de votre perception, et non son remplacement.

Ou encore la préparation d’une négociation. La requête délégatrice :

Prépare les arguments pour une négociation budgétaire du prochain trimestre.

La requête conceptuelle, elle, est différente :

Quels mécanismes psychologiques influencent la façon dont les gens perçoivent les demandes de budget ? Ne me donne pas d'arguments – explique ce qui se passe dans la tête de la personne qui les écoute.

La différence ne se mesure pas en efficacité sur une réunion donnée. La différence se mesure à ce que vous accumulez au fil des mois de travail.

Cela rejoint directement ce que les chercheurs appellent le Disempowerment – le remplacement progressif de votre propre jugement par le jugement algorithmique. Pas de manière dramatique ni visible sur le moment. Juste un glissement silencieux de « j’ai décidé » vers « l’IA m’a suggéré ».

40 leçons sur l'IA pour les managers – y compris un module sur l'utilisation sûre de l'IA sans perte de compétences

Sans paiement requis • Notification au lancement

Trois questions comme outil pratique

L’étude ne propose pas d’interdire l’IA, mais de changer le mode d’utilisation. Avant d’envoyer une requête, il vaut la peine de se poser trois questions.

Première : est-ce que je comprends pourquoi l’IA a donné exactement cette réponse ? Pas « est-ce que ça marche », mais « est-ce que j’en comprends la logique ». Si la réponse est non – c’est le signal pour poser une question complémentaire, pas pour accepter la réponse.

Deuxième : si l’IA se trompe ici – est-ce que je m’en rendrais compte ? Comme le montre l’étude Workday, 37 % du temps économisé grâce à l’IA est consacré à corriger ses erreurs. Cela n’est possible que si vous avez la compétence pour les détecter. Si le mode délégation a étouffé cette compétence – vous n’économiserez rien.

Troisième : dans un mois, serai-je capable de faire cela sans l’IA ? Ce n’est pas une question sur l’abandon de l’outil. C’est une question sur le fait de savoir si une compétence se forme réellement ou s’il ne s’agit que d’une apparence de compétence. Comme le montre l’étude du MIT sur le management, la véritable force d’un professionnel réside dans sa capacité à évaluer les options de manière critique, et non dans le fait de disposer d’un outil qui les génère.

Si la réponse aux trois questions est « non » – ce n’est pas une raison d’abandonner l’IA. C’est une raison de passer à un autre mode d’utilisation.

Le paradoxe à garder en tête

Il y a un an et demi, j’avançais l’hypothèse que l’accessibilité de l’IA abaisse les standards d’évaluation des résultats produits. Aujourd’hui, cette hypothèse dispose d’une confirmation expérimentale – et elle est plus précise que ce que j’imaginais.

Le problème n’est pas que l’IA nous rend moins bons. Le problème est que l’IA supprime la friction – et la friction faisait partie du processus d’apprentissage. Le groupe témoin a rencontré trois fois plus d’erreurs. Et c’est précisément ce qui l’a poussé à comprendre.

C’est aussi important dans le contexte d’une tendance plus large : l’IA ne libère pas tant du temps qu’elle n’intensifie la charge de travail, en abaissant les barrières visibles et en accélérant le rythme. La profondeur de compréhension, elle, peut silencieusement décliner.

L’étude a établi que les participants ayant obtenu les meilleurs scores n’évitaient pas l’IA – ils l’utilisaient pour mieux comprendre, et non pour éviter de réfléchir. La différence tient à l’intention, pas à l’outil.

La question que je laisse sans réponse : quelle compétence souhaitez-vous conserver dans un an – et comment travaillez-vous actuellement avec l’IA pour y parvenir ?

Vous utilisez l'IA, mais vous n'êtes pas sûr de bien faire ?

40 leçons gratuites sur l'IA pour les managers : modes d'utilisation sûrs, détection des hallucinations, scénarios pratiques – sans inscription ni paiement.