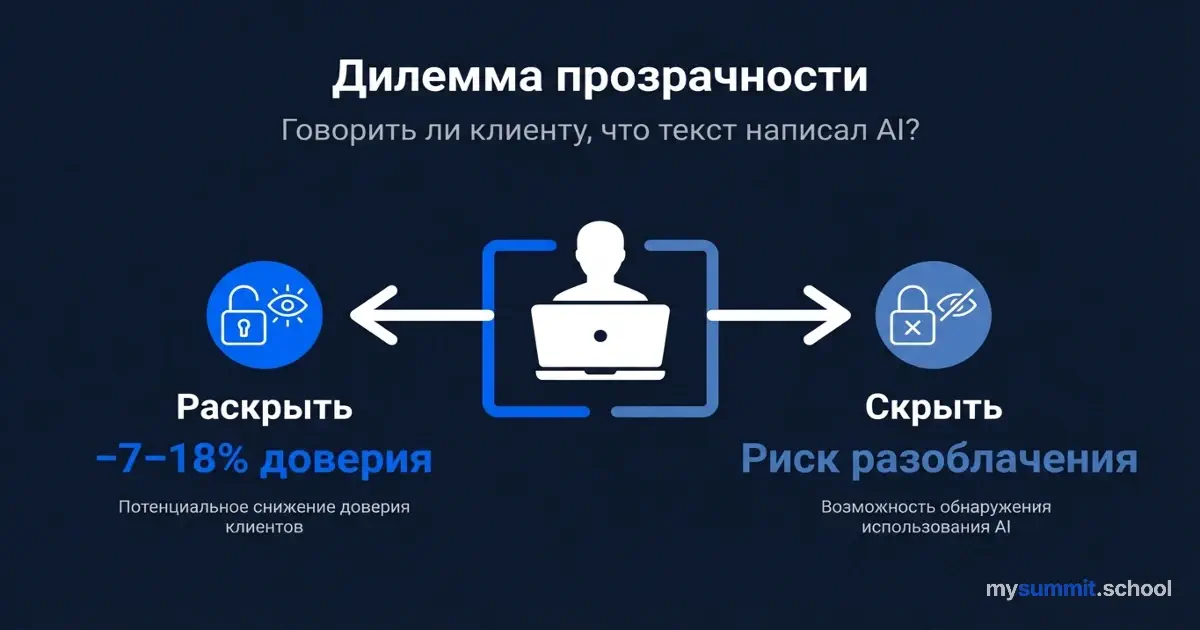

Le dilemme de la transparence : faut-il dire au client que le texte a été écrit par une IA ?

Vous venez de rédiger l’e-mail parfait pour votre client. Le ton est juste, les arguments bien construits, la pointe d’humour parfaitement dosée. Un seul problème : ce n’est pas vous qui l’avez écrit. C’est Claude. Ou ChatGPT. Ou Gemini – peu importe.

Maintenant la question : allez-vous le dire à votre client ?

L’instinct souffle : « Bien sûr que non. Quelle importance, comment c’est écrit, si c’est bien écrit ? ». L’éthique professionnelle murmure : « Il faut être transparent ». Et la science révèle quelque chose d’inattendu : les deux options détruisent la confiance – mais de manières différentes et avec des conséquences distinctes.

L’expérience qui a tout changé

En 2025, les chercheurs Oliver Schilke et Martin Reimann ont publié dans Organizational Behavior and Human Decision Processes une série de 13 expériences pré-enregistrées portant sur plus de 5 000 participants. L’éventail des scénarios était remarquablement large : professeurs rédigeant des lettres de recommandation, analystes préparant des notes d’investissement, dirigeants composant des courriers professionnels, créatifs développant des concepts.

La méthodologie était d’une élégante simplicité. Les participants recevaient les mêmes textes. Seule variable : savaient-ils ou non que l’IA avait participé à la rédaction. Le recours effectif à la technologie restait constant ; seule la divulgation changeait.

Le résultat s’est avéré contre-intuitif : la divulgation explicite de l’utilisation de l’IA réduisait systématiquement la confiance envers l’auteur du message. Non pas envers la qualité du texte – envers la personne qui l’avait envoyé. Chiffres concrets : la confiance envers les professeurs ayant utilisé l’IA pour leurs lettres de recommandation chutait d’environ 16 %. Pour les fonds d’investissement révélant la participation de l’IA dans leurs analyses – d’environ 18 %. Le simple étiquetage « créé avec l’aide de l’IA » faisait perdre 7 à 14 points de pourcentage de confiance.

Les chercheurs ont aussi testé des formulations « douces » : « L’IA n’a servi qu’à vérifier l’orthographe », « L’IA a aidé à structurer le texte ». Sans effet. Toute mention de l’IA déclenchait le même mécanisme de dévalorisation.

La pénalité d’authenticité

La cause réside dans ce que les chercheurs ont nommé la pénalité d’authenticité (authenticity penalty). Schilke et Reimann ont identifié trois composantes qui se dégradent successivement lors de la divulgation : la typicité (ce comportement est-il normal pour ce rôle ?), l’engagement (l’auteur y a-t-il mis des efforts ?) et l’authenticité (y a-t-il un être humain derrière ces mots ?).

Lorsque le destinataire apprend qu’un texte a été rédigé avec l’aide de l’IA, un glissement cognitif instantané se produit. Il se met à douter : sont-ce vos pensées, ou l’algorithme a-t-il assemblé des formulations statistiquement probables ? La bienveillance de l’e-mail – sincère ou simple modèle ?

L’analyse linguistique confirme le paradoxe : les textes générés par l’IA obtiennent objectivement de meilleures notes en chaleur émotionnelle, complexité structurelle et richesse lexicale. Mais ils perdent systématiquement face aux textes humains sur l’authenticité – le sentiment qu’un être vivant, porteur d’intentions réelles, se trouve derrière les mots.

Et le pire scénario n’est pas votre propre divulgation. Comme le formulent les chercheurs : « Si un tiers révèle que vous avez utilisé l’IA, c’est le pire résultat possible ». Parce que la pénalité d’authenticité s’ajoute alors à une pénalité de tromperie. Le mécanisme est le même que dans le management algorithmique : la perte du sentiment de contrôle déclenche une réaction en chaîne de méfiance.

Le test en aveugle : quand l’IA gagne – et perd

L’ampleur de la pénalité d’authenticité est illustrée de façon saisissante par l’étude de Gagan Jain, Samridhi Pareek et Per Carlbring (2024).

Lors de la première phase (test en aveugle), 140 participants évaluaient des réponses à 10 scénarios de soutien psychologique – des conflits interpersonnels à la gestion du stress. La source était masquée. Les réponses de l’IA (ChatGPT) ont obtenu des scores égaux ou supérieurs à ceux des étudiants en master de psychologie clinique sur les trois paramètres – authenticité, professionnalisme et utilité pratique. Les différences n’étaient pas statistiquement significatives.

Lors de la deuxième phase (six mois plus tard, avec divulgation), 111 participants du même groupe évaluaient exactement les mêmes réponses, mais en connaissant désormais leur auteur. Résultat : les scores d’authenticité des réponses humaines ont augmenté (de 36,33 à 37,66), tandis que ceux de l’IA sont restés stables (34,85 dans les deux phases).

Les recherches révèlent une autre nuance intéressante : la confiance générale envers l’IA ne corrélait qu’avec l’utilité pratique. Aucun lien n’a été trouvé avec l’authenticité ni avec le professionnalisme.

Les gens sont prêts à reconnaître que l’IA est utile. Mais pas qu’elle puisse être sincère. Confiance utilitaire et confiance émotionnelle sont deux circuits distincts – et la divulgation détruit précisément le second.

L’impasse : dissimuler est encore pire

La solution semble évidente – ne rien dire. Et de fait, les données de Salesforce (enquête auprès de 14 000 employés) montrent que 64 % font passer du contenu généré par l’IA pour le leur. Selon WalkMe, 78 % utilisent des outils d’IA non approuvés au travail. Parmi les dirigeants de niveau C, le chiffre est plus élevé encore – 93 % admettent recourir à une « IA fantôme ».

Mais les chercheurs Schilke et Reimann préviennent : une divulgation par un tiers – un collègue, une découverte fortuite, un incident technique – inflige un coup catastrophique et souvent irréparable à la réputation.

Ce n’est plus « il a utilisé un outil ». C’est « il m’a délibérément induit en erreur ».

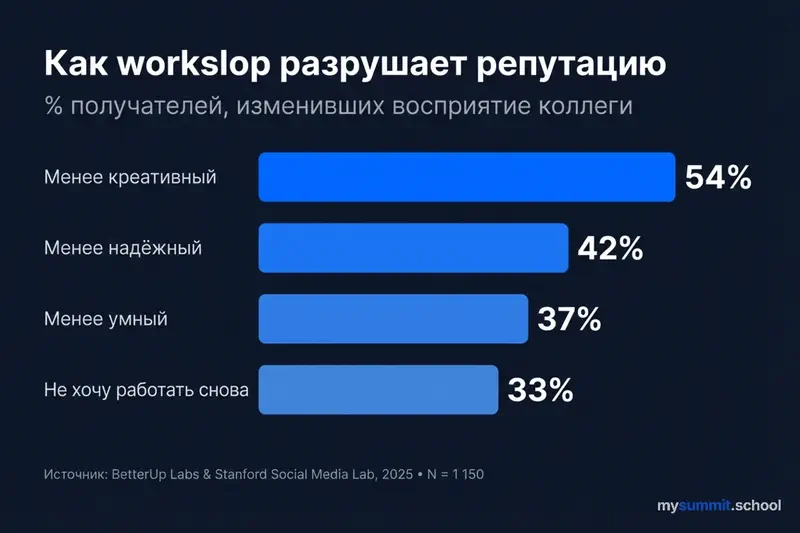

Les données de l’étude conjointe de BetterUp Labs (Kate Niederhoffer) et du Stanford Social Media Lab (Jeff Hancock), une enquête auprès de 1 150 salariés à temps plein aux États-Unis, quantifient cet effet. Lorsque les destinataires découvrent que le travail d’un collègue est du « workslop » généré par l’IA (un contenu au vernis soigné mais sans profondeur réelle) :

- 54 % jugent l’expéditeur moins créatif

- 42 % – moins digne de confiance

- 37 % – moins intelligent

- 33 % ne voudraient plus travailler avec cette personne

Un seul e-mail révélé comme étant généré par l’IA peut anéantir des mois de réputation professionnelle soigneusement construite. De quoi s’interroger : la « confiance professionnelle » que nous tenons pour acquise serait-elle si fragile ?

La taxe cachée : l’heuristique de l’effort et 9 M$ par an

Pour comprendre la profondeur de cette réaction, il faut se tourner vers l’heuristique de l’effort, un biais cognitif. Des décennies de recherche le montrent : les gens assimilent instinctivement l’effort visible à la qualité du résultat. Un poème ayant nécessité « trois ans de travail » est jugé supérieur à un texte identique écrit « en une demi-heure ». Un costume fait main coûte plus cher qu’un costume industriel, même s’ils sont indiscernables.

L’IA a rompu ce lien. Un texte impeccable se crée désormais en quelques secondes – et cesse d’être un signal de compétence. Quand un dirigeant découvre que le rapport brillant de son subordonné est le produit d’un seul prompt, le sentiment de tromperie s’enclenche. Non pas parce que le rapport est mauvais, mais parce que l’effort présumé s’avère illusoire. La synthèse de Microsoft Research (~50 études) le confirme : les utilisateurs ayant reçu des recommandations incorrectes de l’IA travaillent plus lentement que ceux qui exécutaient la tâche sans IA du tout.

Quant au coût financier du workslop, il est très concret. Selon BetterUp et Stanford :

| Indicateur | Valeur |

|---|---|

| Part des employés ayant reçu du workslop le mois précédent | 40 % |

| Temps moyen pour traiter un incident | 1 heure 56 minutes |

| Coût du temps perdu par employé et par mois | 186 $ |

| Coût caché pour une organisation de 10 000 personnes | > 9 M$ / an |

Le destinataire du workslop consacre près de deux heures à reconstituer le contexte, vérifier les faits et corriger les erreurs. L’IA a fait gagner 30 minutes à l’expéditeur – et reporté deux heures de travail sur son collègue. La « productivité » de l’un se transforme en pertes pour tous.

Mais BetterUp a aussi identifié un schéma inverse. 28 % des employés utilisent l’IA en « pilotes » – éditant activement, vérifiant, enrichissant de leur propre contexte. Les 72 % restants sont des « passagers » qui délèguent à l’IA et envoient le résultat sans retouche. La différence de résultats : les « pilotes » affichent une productivité 3,6 fois supérieure et une loyauté envers l’entreprise 3,1 fois plus élevée. Un schéma similaire – l’intensification du travail par l’IA – a été décrit dans une étude de l’Institut pour l’avenir du travail.

Pourquoi les explications ne fonctionnent pas (mais la validation sociale, si)

La solution intuitive – rendre l’IA plus transparente : expliquer son fonctionnement, montrer la logique de ses recommandations. Mais une étude du Laboratory for Innovation Science de Harvard (LISH) a révélé un effet inverse.

Ampleur de l’expérience : 17 245 décisions d’allocation de stocks pour 425 références dans 186 magasins. Quand les managers voyaient la logique de l’algorithme – quelles variables il prenait en compte, quels poids il leur attribuait – ils se mettaient à l’ignorer plus souvent. Les chercheurs ont nommé ce mécanisme « débogage présomptueux » (overconfident troubleshooting) : la transparence créait une illusion de compréhension. « Je vois ce qu’il prend en compte, et je sais mieux ». L’expérience personnelle et l’intuition l’emportaient sur les données.

En revanche, la « boîte noire » – un algorithme sans logique visible – obtenait significativement plus de confiance. À une condition : les employés savaient que leurs collègues avaient participé au développement et aux tests du système. Les chercheurs ont baptisé cela la « validation sociale» (social proofing) – la confiance dans la technologie via la confiance dans les personnes qui la soutiennent.

L’impact financier était mesurable : suivre les recommandations de l’algorithme rapportait +36,95 $ de chiffre d’affaires supplémentaire par décision d’allocation dans le quatrième quintile et +104,96 $ dans le quintile supérieur. Les managers qui ignoraient l’algorithme en raison de sa « logique transparente » perdaient de l’argent réel.

Les travaux de Microsoft Research confirment ce paradoxe : les explications ne réduisent pas la confiance excessive envers l’IA et, dans certains cas, la renforcent. Les utilisateurs interprètent la présence d’explications comme un signal de fiabilité du système – même quand ces explications sont peu informatives. L’étude de Vasconcelos et collègues à Stanford a montré que les explications ne réduisent la confiance excessive que lorsqu’elles sont plus simples que la tâche elle-même. Si l’explication est aussi complexe que la tâche, l’utilisateur renonce rationnellement à la vérification (note : cette étude, publiée en 2023, abordait un sujet sensible – la vaccination).

Le fossé entre direction et équipes

La situation se complique par une divergence radicale dans la perception de l’IA aux différents niveaux de l’organisation – un schéma bien visible dans le déploiement de l’IA en entreprise de manière générale.

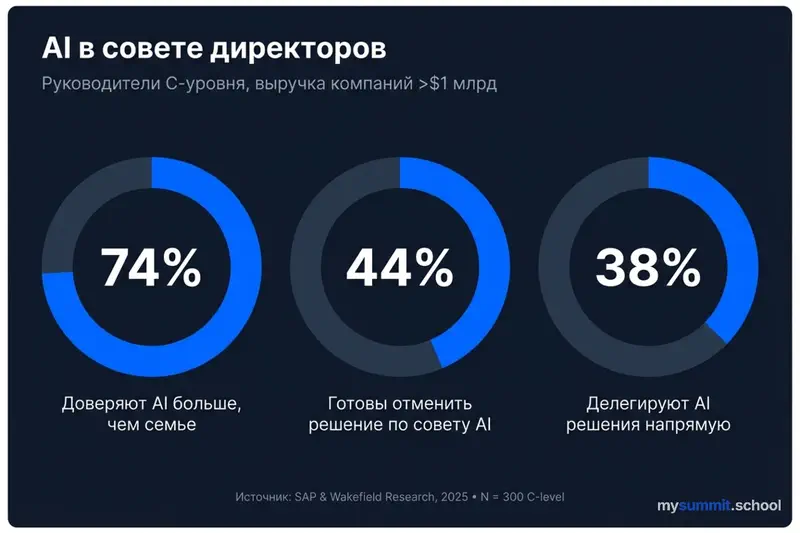

L’étude de SAP et Wakefield Research (« AI Has a Seat in the C-Suite », mars 2025) a interrogé 300 dirigeants de niveau C d’entreprises dont le chiffre d’affaires dépasse 1 milliard de dollars. Les chiffres sont saisissants :

- 74 % font davantage confiance à l’IA qu’à leur famille ou leurs amis pour les recommandations stratégiques

- 44 % sont prêts à laisser l’IA annuler une décision commerciale déjà prise

- 38 % délèguent directement la prise de décision à l’IA

- Dans les entreprises où l’IA remplace déjà les processus décisionnels traditionnels, cette proportion atteint 55 %

Au niveau opérationnel, la dynamique est inverse. Selon les données de BCG « AI at Work 2025 » (plus de 10 600 employés, 11 pays), 72 % des travailleurs utilisent régulièrement l’IA – mais c’est une moyenne trompeuse. 78 % des managers et plus de 85 % des dirigeants travaillent avec l’IA chaque semaine, tandis que l’adoption au niveau opérationnel stagne à 51 % – un chiffre inchangé depuis 2023. Seulement 25 % des employés de terrain reçoivent des consignes de leurs managers sur l’utilisation de l’IA, et à peine 36 % jugent leur formation suffisante.

Par ailleurs, 54 % des employés sont prêts à utiliser des outils d’IA même sans l’accord de leur entreprise – l’« IA fantôme » progresse. Et 41 % des personnes interrogées craignent de perdre leur emploi à cause de l’IA dans les dix prochaines années, les dirigeants étant plus inquiets (43 %) que les employés de terrain (36 %).

Le faible niveau de culture IA amplifie le fossé. Selon HR Brew et Censuswide (2024), les employés peu formés à l’IA ressentent 6 fois plus d’anxiété, 7 fois plus de peur et 8 fois plus d’abattement – par rapport à leurs collègues maîtrisant l’IA. Et l’expérience de Jacobs et collègues (2021, 220 cliniciens, prescription d’antidépresseurs) a montré que les médecins ayant une faible culture IA suivaient 7 fois plus souvent des recommandations algorithmiques incorrectes.

C’est le miroir du dilemme de transparence : la direction impose l’IA « pour l’efficacité », les employés répondent par une IA fantôme « pour survivre ». La transparence venue d’en haut engendre l’opacité en bas.

Du paradoxe au protocole : ce que propose la science

Les recherches ne se contentent pas de diagnostiquer le problème – elles proposent des mécanismes concrets pour sortir de l’impasse. Quatre stratégies, chacune appuyée par des données probantes.

1. Normaliser plutôt que divulguer

Schilke et Reimann soulignent une nuance clé : la pénalité d’authenticité se déclenche lorsque l’utilisation de l’IA est perçue comme atypique pour le rôle concerné. Un professeur utilisant l’IA pour évaluer – atypique. Un analyste utilisant l’IA pour une note d’investissement – déjà plus proche de la norme.

Conclusion : plutôt que de choisir entre divulguer et dissimuler, il vaut mieux rendre l’utilisation de l’IA normativement attendue. Quand tout le monde dans l’équipe utilise ouvertement l’IA, la composante de typicité cesse de se dégrader. Ce n’est plus « il a remplacé son travail par un algorithme », mais « il a utilisé un outil standard, comme tout le monde ».

L’expérience de SAP SuccessFactors le confirme : quand l’IA est intégrée dans les processus courants d’accompagnement – fixation d’objectifs, feedback entre collègues – elle cesse d’être une exception :

| Métrique | Évolution |

|---|---|

| Qualité du feedback (évaluation par les employés) | 80 % de consensus positif |

| Fréquence du feedback (4+ fois par an) | +47 % |

| Satisfaction du processus de fixation d’objectifs | +30 % |

2. Validation sociale plutôt que transparence technique

L’étude de Harvard menée chez Tapestry fournit une recette concrète : impliquez les utilisateurs finaux dans le choix, le test et la validation des outils d’IA. Quand les employés savent que des collègues ayant une expérience similaire ont participé au développement du système, la confiance envers la « boîte noire » dépasse celle envers un algorithme transparent.

C’est une approche qui passe à l’échelle : inutile d’expliquer à chacun le fonctionnement du modèle. Il suffit que des personnes en qui l’équipe a confiance disent : « Nous l’avons testé – ça fonctionne ». Les données de BetterUp complètent le tableau : la formation aux compétences relationnelles (écoute active, questionnement, contextualisation) augmente l’interaction des employés avec l’IA de 30 % et améliore la qualité des résultats.

3. Des frictions cognitives plutôt qu’une acceptation automatique

Bucinca et collègues (2021, 199 répondants, Harvard) ont montré que demander à une personne de réfléchir par elle-même avant de lui montrer la réponse de l’IA réduit la confiance aveugle envers le modèle. Microsoft Research identifie trois mécanismes concrets :

- Signaux d’incertitude : une IA qui dit « je ne suis pas sûre de cette réponse » réduit la dépendance excessive plus efficacement que des indicateurs numériques du type « confiance à 73 % ». Le premier déclenche l’esprit critique, le second crée une illusion de précision.

- Autocritique de l’IA : un modèle qui argumente contre sa propre conclusion aide l’utilisateur à en percevoir les failles. C’est l’un des schémas les plus prometteurs identifiés dans la synthèse de 2025.

- Jugement préalable : l’utilisateur formule sa propre réponse avant de voir la recommandation de l’IA. Un simple changement d’ordre transforme tout.

Mais il y a une réserve importante : les utilisateurs ont jugé ces interfaces comme les moins agréables. Il existe une corrélation inverse entre efficacité et attractivité. Ce qui fonctionne – irrite. Ce qui plaît – n’aide pas. En déployant de tels mécanismes, il est indispensable de fournir des explications claires – pourquoi vous faites cela.

4. Des « pilotes », pas des « passagers »

BetterUp et Stanford proposent un cadre clair. Les 28 % d’employés « pilotes » – ceux qui éditent activement, vérifient et enrichissent le résultat de l’IA avec leur propre contexte – affichent une productivité 3,6 fois supérieure et une loyauté 3,1 fois plus élevée. Les 72 % restants sont des « passagers » qui délèguent à l’IA sans retouche.

La différence ne tient pas à l’outil, mais à la posture. Et cette posture peut s’entraîner : les employés formés aux compétences relationnelles interagissent 30 % plus activement avec l’IA et produisent un contenu de meilleure qualité. Les organisations qui établissent des règles claires d’utilisation de l’IA, définissent des scénarios précis et renforcent le jugement humain – rencontrent nettement moins de workslop.

Que faire concrètement : feuille de route

Les données dessinent des actions concrètes pour le manager qui utilise l’IA et dirige une équipe qui l’utilise.

Pour votre communication personnelle :

- Au lieu de « C’est l’IA qui a écrit ça », dites « J’ai préparé ceci avec l’aide de l’IA et l’ai adapté à notre contexte ». Mettez l’accent sur votre contribution, pas sur l’outil – vous évitez ainsi à la fois la pénalité d’authenticité et la pénalité de tromperie.

- Ajoutez des traces de réflexion humaine : expérience personnelle, exemples concrets tirés de votre collaboration, références à des échanges précédents – tout ce que l’IA ne peut pas connaître.

- Formulez votre position avant de lancer l’IA. Cela vous transforme de « passager » en « pilote » – et réduit le risque d’accepter aveuglément la réponse de l’IA.

Pour le management d’équipe :

- Instaurez un audit du processus : évaluez non pas le résultat poli, mais le chemin pour y parvenir – brouillons, itérations, moments où le collaborateur n’a pas été d’accord avec l’IA.

- Normalisez l’utilisation de l’IA dans l’équipe : quand tout le monde travaille ouvertement avec l’IA, la composante de typicité cesse de se dégrader.

- Construisez la confiance sociale : impliquez l’équipe dans le choix et le test des outils d’IA. L’étude de Harvard chez Tapestry l’a prouvé : la confiance dans le système grandit par la confiance envers les collègues qui l’ont validé.

- Donnez l’IA dans les mains, pas sur la tête. L’expérience de SAP : l’IA au service de l’employé construit la confiance ; l’IA pour le contrôle la détruit.

- Comblez le fossé de culture IA. Les médecins peu formés à l’IA suivent 7 fois plus souvent des recommandations incorrectes. La formation n’est pas un supplément optionnel, c’est une infrastructure de confiance.

Le dilemme de la transparence n’a pas de solution parfaite. La divulgation réduit la confiance de 7 à 18 %. La dissimulation la détruit quand la vérité éclate. Mais entre ces deux pôles existe une zone praticable : utiliser l’IA comme un outil, non comme un auteur. Ajouter sa propre voix, plutôt que la déléguer.

Il vaut peut-être la peine de distinguer deux questions : « Est-ce que l’IA a écrit cela ? » et « Y a-t-il derrière ce texte un être humain pour qui cela compte ? ». La première question porte sur la technologie. La seconde – sur la relation. Et c’est la réponse à la seconde qui détermine si vous préserverez la confiance.

L'IA écrit – c'est à vous de décider comment présenter

Module ouvert du cours : comment utiliser l'IA dans la communication professionnelle tout en préservant la confiance des clients et des collègues.

Continuez votre apprentissage

Ouvrez le manuel et reprenez là où vous vous êtes arrêté

Comment l’IA a contribué à cet article (en suivant nos propres recommandations – nous divulguons) :

- Exploration du sujet. L’IA nous a aidés à identifier et organiser les études, articles et cas sur le sujet. Mais chaque source a été lue par un humain, les données ont été vérifiées dans les publications originales, et le brouillon a été rédigé manuellement.

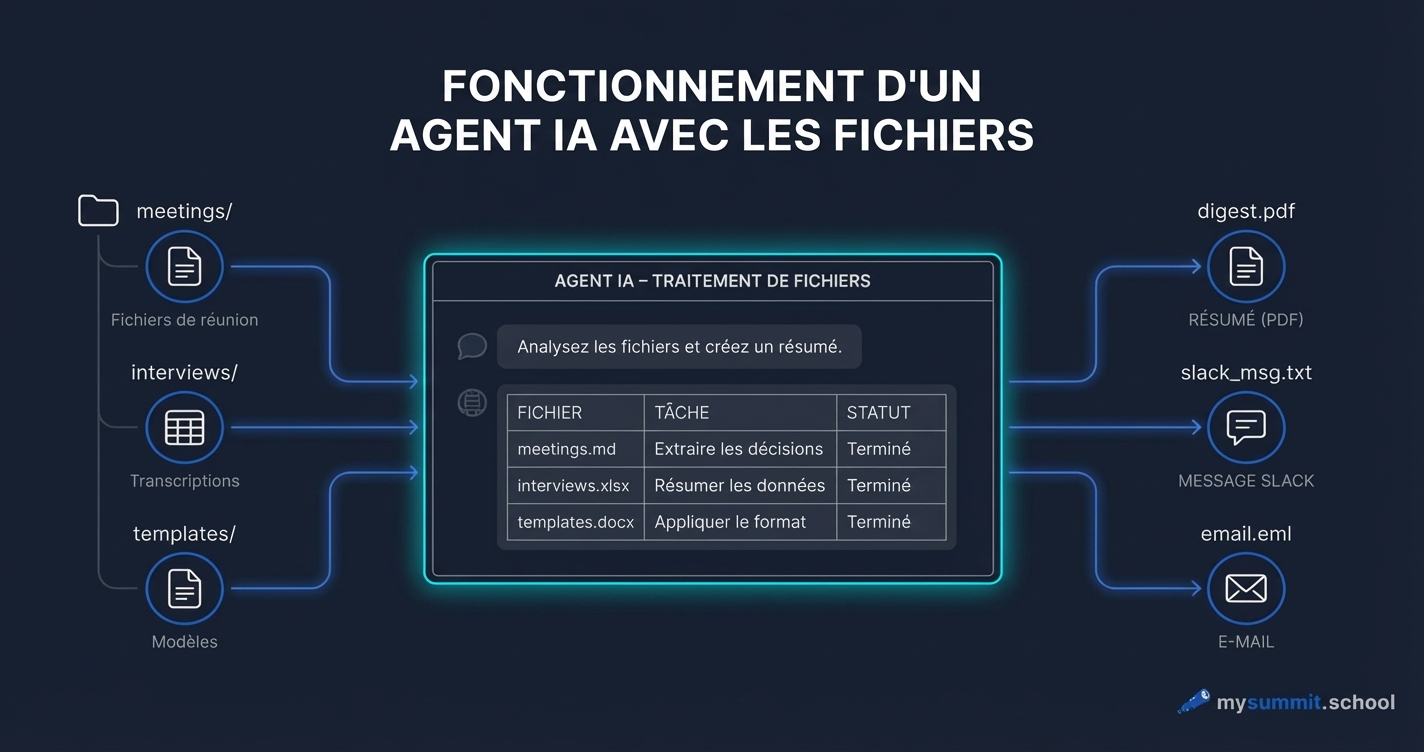

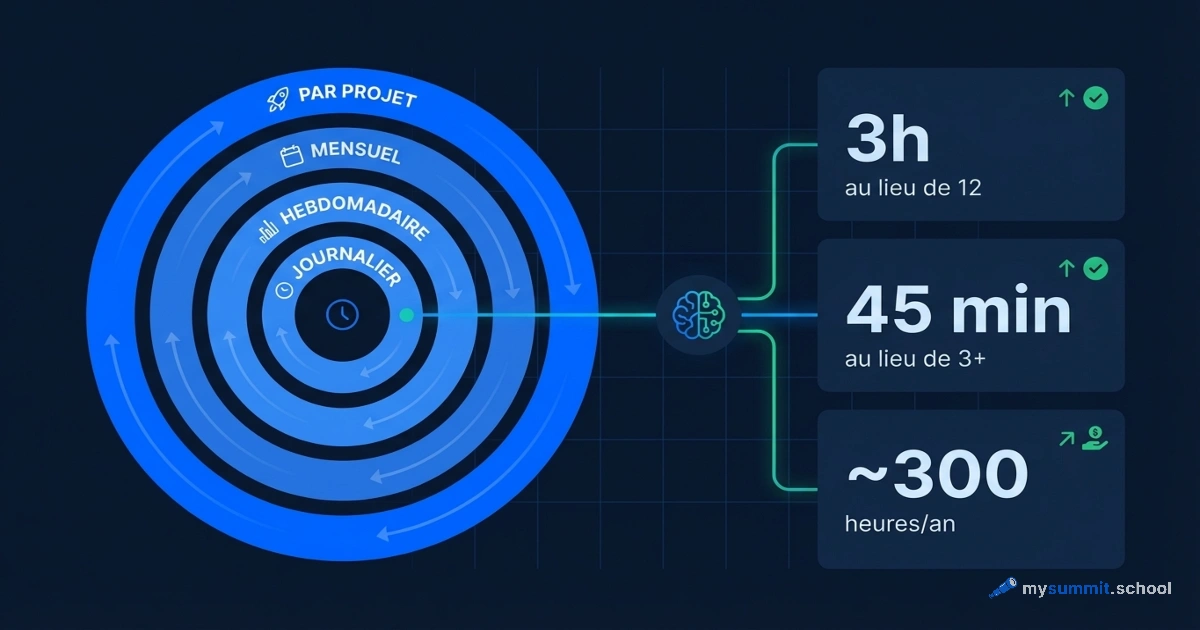

- Infographies. Toutes les images ont été générées par l’IA. Mais les prompts – descriptions des données, de la composition et des sources – ont été écrits par un humain à partir des études lues.

- Relecture. L’IA a vérifié la structure de l’article par rapport à nos standards éditoriaux et au ciblage de l’audience. Mais ces standards, la voix de la marque et la politique éditoriale – c’est nous qui les avons définis.

Nous sommes des « pilotes », pas des « passagers ».

Sources

- Schilke, O. & Reimann, M. (2025). The authenticity penalty of AI disclosure. Organizational Behavior and Human Decision Processes, 188. DOI

- Niederhoffer, K. & Hancock, J. (2025). AI-generated workslop is destroying productivity. Harvard Business Review. HBR

- Jain, G., Pareek, S. & Carlbring, P. (2024). Perception of AI-generated mental health responses. Internet Interventions, 38. DOI

- BCG (2025). AI at Work 2025: Momentum Builds, but Gaps Remain. BCG

- SAP & Wakefield Research (2025). AI Has a Seat in the C-Suite. SAP

- Bucinca, Z. et al. (2021). To trust or to think: Cognitive forcing functions. Proceedings of the ACM on Human-Computer Interaction, 5(CSCW1). DOI

- Vasconcelos, H. et al. (2023). Explanations can reduce overreliance on AI systems during decision-making. Proceedings of the ACM on Human-Computer Interaction, 7(CSCW1). DOI

- Jacobs, M. et al. (2021). How machine-learning recommendations influence clinician treatment selections. Translational Psychiatry, 11, 108. DOI

- Microsoft Research (2024). Appropriate Reliance on GenAI. PDF