Make Weak Model Great Again : le prompting peut-il sauver un modèle faible ?

En mars 2026, le ministère russe du Numérique a publié un projet de loi sur les « modèles d’IA de confiance ». S’il est adopté – l’entrée en vigueur est prévue pour septembre 2027 – les administrations publiques et les infrastructures critiques ne pourront utiliser que des modèles inscrits dans un registre spécial. ChatGPT, Claude et Gemini, qui transmettent des données à l’étranger, pourraient être restreints. L’installation obligatoire de réseaux neuronaux russes sur les appareils est également envisagée.

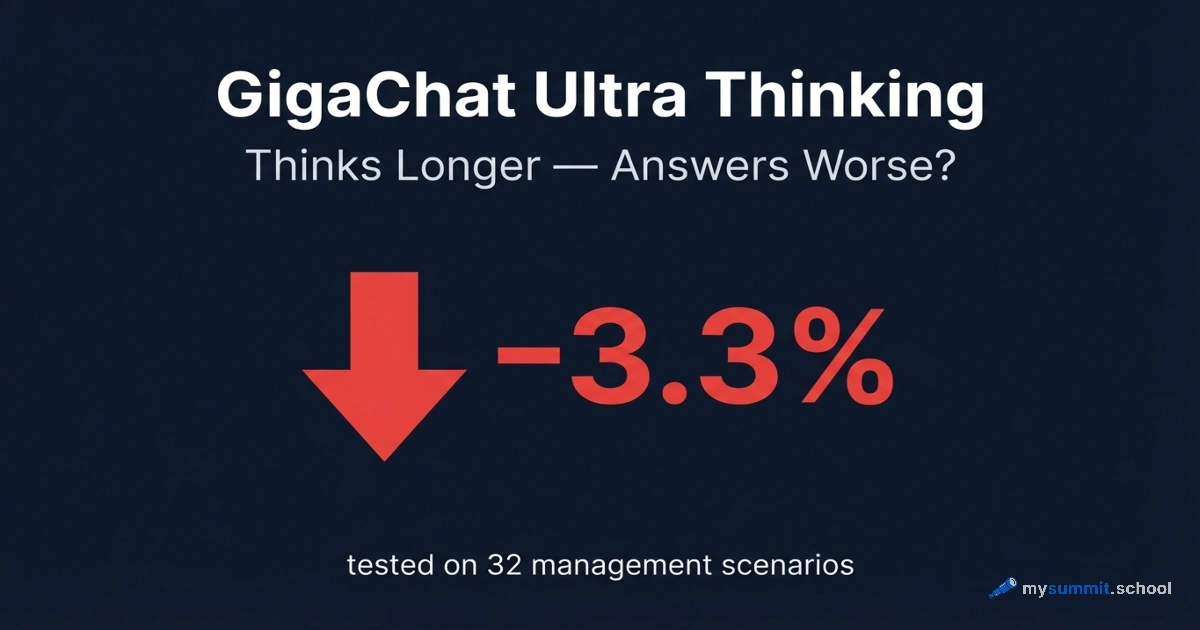

Le problème, c’est que les modèles russes sont en retard. Dans notre étude portant sur 54 modèles, GigaChat a obtenu 3,26 sur 5, GPT-5.4 – 4,80. Un écart de 32 %.

Si GigaChat est tout ce que les managers russes auront, peut-on en tirer une qualité acceptable grâce à un prompting bien construit ?

Mais cette question dépasse largement la Russie.

Au-delà de la Russie : un problème universel

La réglementation russe offre un cas d’école, mais la question sous-jacente est universelle : l’ingénierie de prompts peut-elle combler l’écart entre un modèle faible et un modèle premium ?

Tout manager qui déploie Mistral ou Llama en local pour des raisons de souveraineté des données fait face au même dilemme. Une entreprise européenne soumise au RGPD qui refuse d’envoyer des données confidentielles à OpenAI se retrouve avec un modèle local – souvent plus faible. Un hôpital qui exécute Phi-4 sur site pour protéger les dossiers patients a exactement le même problème : le modèle est là, il est conforme, mais il est moins performant.

GigaChat et Alice (YandexGPT) dans cette étude ne sont pas seulement des « modèles russes » – ce sont des représentants d’une catégorie entière : les modèles faibles que l’on utilise par contrainte, pas par choix. Nos résultats s’appliqueront à quiconque se demande si un bon prompt peut compenser un modèle médiocre.

Ce que nous faisons et pourquoi

L’expérience « Make Weak Model Great Again » prend quatre modèles accessibles en Russie – GigaChat-Ultra, GigaChat-2-Max, Alice AI (YandexGPT) et Qwen3 Max – et fait passer chacun à travers dix techniques de prompting sur six tâches managériales : de l’analyse de métriques e-commerce au droit du travail russe. En parallèle, les mêmes tâches sont résolues par GPT-5.4 et Claude Sonnet 4.6 avec des prompts naïfs – pour fixer le plafond vers lequel les modèles faibles tentent de s’élever.

Les techniques sont variées – des plus simples, qu’un manager peut maîtriser en une minute (rôle assigné, modèle structuré), jusqu’aux dialogues en plusieurs étapes où le modèle analyse d’abord, se critique ensuite, puis reformule sa réponse. Entre les deux : Chain-of-Thought (« raisonne étape par étape »), Few-Shot (on montre un exemple de bonne réponse) et la structuration XML du prompt, habituellement réservée aux développeurs.

Mais deux techniques rendent cette expérience véritablement originale : CAPS EMPHASIS et le ton agressif. Internet regorge de conseils du type « écris en MAJUSCULES et le modèle obéira » ou « engueule-le, il répondra mieux ». Certains citent une étude Microsoft de 2024, d’autres se contentent de leur expérience personnelle. Il n’y a quasiment aucun fondement scientifique, encore moins pour les modèles russes ou les modèles faibles en général. Nous avons inclus les deux techniques pour trancher une bonne fois pour toutes : est-ce que ça marche – ou est-ce une légende urbaine du prompt engineering ?

Pourquoi la réponse n’est pas évidente

On pourrait croire que meilleur prompt = meilleur résultat. Mais avec les petits modèles, tout se complique – et la recherche existante le confirme.

Wei et al. (Google Brain, 2022) ont montré que le Chain-of-Thought – la technique qui force le modèle à « raisonner étape par étape » – fonctionne très bien sur les grands modèles. Mais chez les petits, elle provoque des raisonnements « confiants mais erronés ». Le modèle produit cinq étapes qui semblent logiques – et arrive à une conclusion fausse. Pire que s’il avait répondu directement. GigaChat tombe-t-il dans ce piège ? Nous ne le savons pas encore.

Zhang et al. (ACL 2024) ont établi un constat encore plus gênant : les petits modèles sont physiquement incapables de détecter leurs propres erreurs. Quand on leur demande « trouve les faiblesses de ta réponse et améliore-la », le modèle ne se critique pas – il s’« auto-confirme ». Il reformule légèrement sans changer le fond. Si nos données confirment cela sur les modèles russes – et potentiellement sur d’autres modèles faibles comme Phi ou de petites versions de Llama – c’est un verdict concret : ne perdez pas de temps avec « améliore ta réponse » sur GigaChat.

Et puis il y a le plafond architectural. Les prompts réorganisent ce que le modèle sait déjà. Ils ne peuvent pas créer des connaissances absentes des poids du modèle. Si GigaChat n’a pas « lu » le Code du travail russe pendant son entraînement – aucun prompt « tu es un juriste expérimenté en droit du travail » ne lui fera citer le code correctement. Le mieux qu’on puisse espérer, c’est que le modèle dise « je ne sais pas » au lieu de produire une hallucination confiante. Ce principe vaut pour n’importe quel modèle – russe, chinois, ou un Mistral déployé localement sans accès au bon corpus.

D’ailleurs, notre benchmark a révélé un résultat contre-intuitif : GigaChat et Alice – des modèles entraînés sur le russe – ont obtenu des scores inférieurs à GPT-5.4 sur les tâches liées à la réalité russe. Droit du travail, marchés régionaux, spécificités commerciales locales – sur tous ces sujets, le modèle étranger s’est avéré plus performant que le modèle natif. Probablement parce que GPT-5.4 a simplement « lu » davantage de documents sur le droit du travail russe grâce à son échelle. C’est l’une des questions clés de l’expérience : où se situe la frontière au-delà de laquelle aucun prompt ne compense l’écart de connaissances ?

Les techniques de prompting de cette étude deviendront la base des supports de cours. Essayez 9 cas pratiques de manager dans le module ouvert – gratuit, sans inscription.

Sans paiement requis • Notification au lancement

Ce que le manager obtiendra

Nous faisons délibérément de ceci une recherche appliquée, pas académique. Les travaux scientifiques sur les petits modèles se concentrent généralement sur l’optimisation automatisée – fine-tuning, DSPy, amélioration algorithmique des prompts. Ce qui nous intéresse est différent : que peut faire un manager ordinaire qui dispose de GigaChat – ou d’un Llama local, ou d’un Mistral auto-hébergé – et de cinq minutes pour formuler sa requête ?

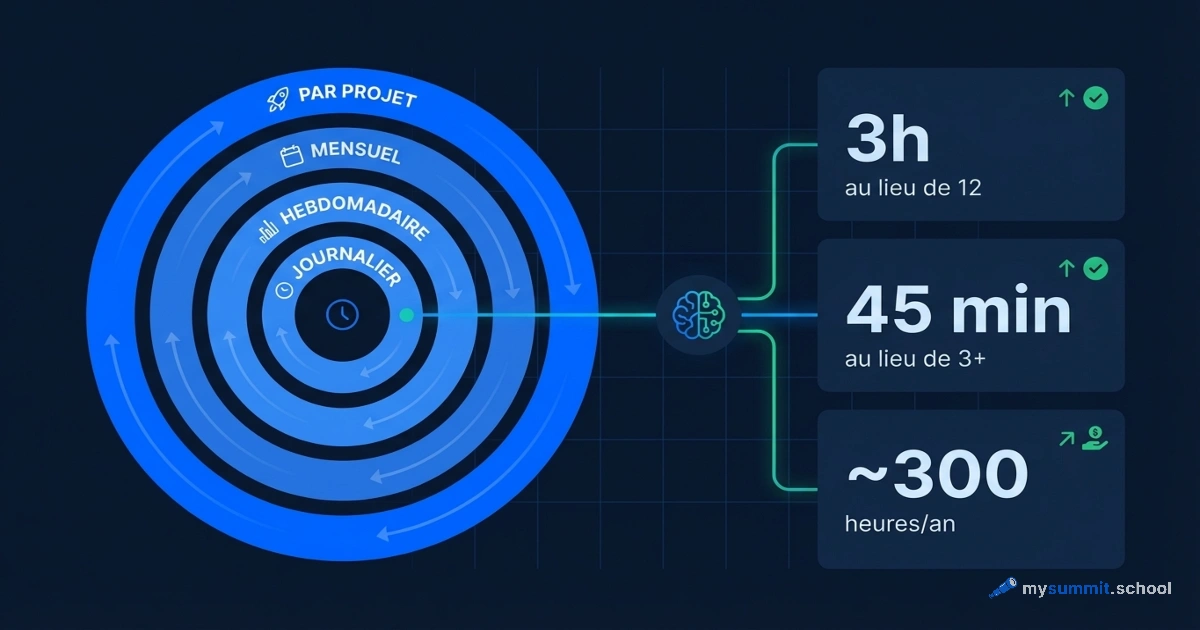

Pour chaque technique, nous évaluons non seulement la qualité du résultat, mais aussi l’effort – combien de temps faut-il pour reformuler le prompt. Parce qu’une technique qui améliore la réponse de 15 % mais nécessite 20 minutes de préparation, un manager n’en a pas besoin.

Au final, trois livrables. Premier : une carte « technique -> modèle -> tâche » – si vous avez GigaChat pour l’analyse de documents, quelle approche utiliser ? Si Alice pour rédiger un e-mail ? Deuxième : des modèles de prompts prêts à l’emploi pour des tâches managériales concrètes. Et troisième : une frontière honnête – dans quels scénarios le prompting n’aide pas et il vaut mieux changer de modèle.

Tout cela intégrera le cours – dans la section où la théorie du prompt engineering rencontre les données. Pas « qu’est-ce qu’un prompt », mais « qu’est-ce qui fonctionne réellement, sur quel outil, pour quelle tâche ».

Qwen3 Max, Alice, GigaChat – accessibles sans VPN. Testez votre approche du prompting sur des cas réels de manager dans le module gratuit du cours.

Sans paiement requis • Notification au lancement

Quand attendre les résultats

L’expérience est en phase de lancement. Le rapport complet sera publié ici, sur le blog – avec l’analyse de chaque technique, des modèles de prompts concrets et une conclusion honnête sur les limites. Si vous travaillez quotidiennement avec GigaChat, Alice – ou n’importe quel modèle « faible » que vous utilisez par nécessité plutôt que par choix – la réponse à votre question est en préparation.

L'outil est là. Maintenant – la compétence

Le module Fondation du cours décortique le prompt engineering sur des tâches managériales réelles : structure, rôles, décomposition, CoT. La spécialisation pour managers approfondit l'application en planification, analytique et travail d'équipe.