P5.express et l'IA agentique : où elle aide, où elle casse tout

Dans l’univers PMI, la gestion de portefeuille est souvent perçue comme un édifice monumental : comités, Tableau, des centaines de champs dans Jira, des réunions de suivi hebdomadaires avec des dizaines de slides. P5.express propose une autre voie. Trois cycles, cinq documents, deux rôles. Le système tient sur une seule page.

C’est précisément à ce type de système qu’il est pertinent d’associer une IA agentique : l’architecture minimaliste est compréhensible, les rôles sont clairs, les données sont structurées. Mais « pertinent » ne veut pas dire « partout ». Certaines parties de P5.express cessent de fonctionner lorsqu’on les automatise – non pas parce que l’IA est mauvaise, mais parce que le sens même de ces parties réside dans le processus humain.

Ci-dessous – une analyse cycle par cycle. Ce qu’il vaut la peine de déléguer à un agent, ce qu’il vaut mieux laisser aux humains, et quel modèle choisir en pratique.

Qu’est-ce que P5.express

P5.express est une méthodologie de gestion de portefeuille développée par OMIMO. Elle se situe un niveau au-dessus des outils habituels comme Scrum ou PRINCE2 et répond non pas à la question « comment mener les projets », mais à « quels projets mener en priorité ».

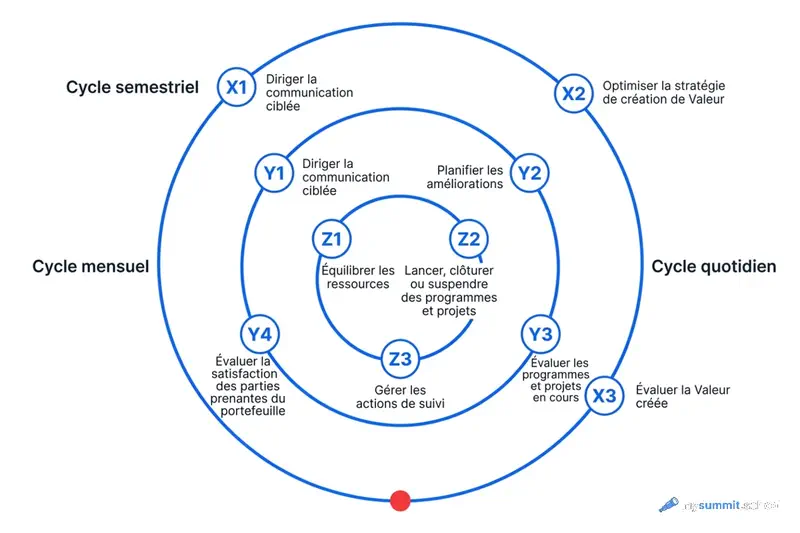

La structure repose sur trois cycles imbriqués.

X – semestriel (stratégique) : évaluer la valeur créée (X1), optimiser la stratégie de création de valeur (X2), mener une communication ciblée (X3). L’événement clé est un atelier d’une journée – X2 – où le comité de portefeuille réajuste les priorités.

Y – mensuel (santé et amélioration) : évaluer la satisfaction des parties prenantes (Y1), évaluer les programmes et projets en cours (Y2), planifier les améliorations (Y3), communiquer (Y4).

Z – quotidien (exécution) : suivi des actions (Z1), démarrage/arrêt/suspension des programmes et projets (Z2), équilibrage des ressources (Z3).

Cinq documents : le Résumé du portefeuille (Portfolio Description), la Value Generation Matrix, le Global Follow-Up Register, le Global Health Register et les Business Cases.

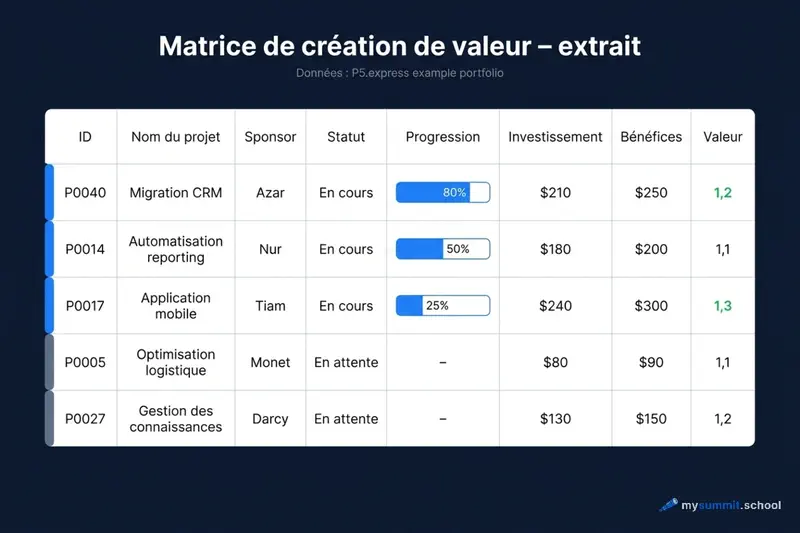

Le plus important est la Value Generation Matrix. C’est un tableau de tous les programmes et projets avec les colonnes : nom, sponsor, statut, avancement, investissements, bénéfices, Value. La Value se calcule comme bénéfices ÷ investissements. Les lignes sont ordonnées : terminés – en cours – en attente – annulés – rejetés. Les projets en attente sont équilibrés au sein de l’« horizon de balancement » par catégories de valeur.

Deux rôles : le Comité de portefeuille (dirigeants de départements, décisions collégiales) et le Gestionnaire de portefeuille (facilitateur, analyste, sans rôle direct dans aucun projet – sous peine de conflit d’intérêts).

Voilà l’ensemble du système. Le reste est une question d’application.

Où l’agent apporte une vraie aide

Y2 (évaluation mensuelle des projets) – un travail taillé pour l’agent

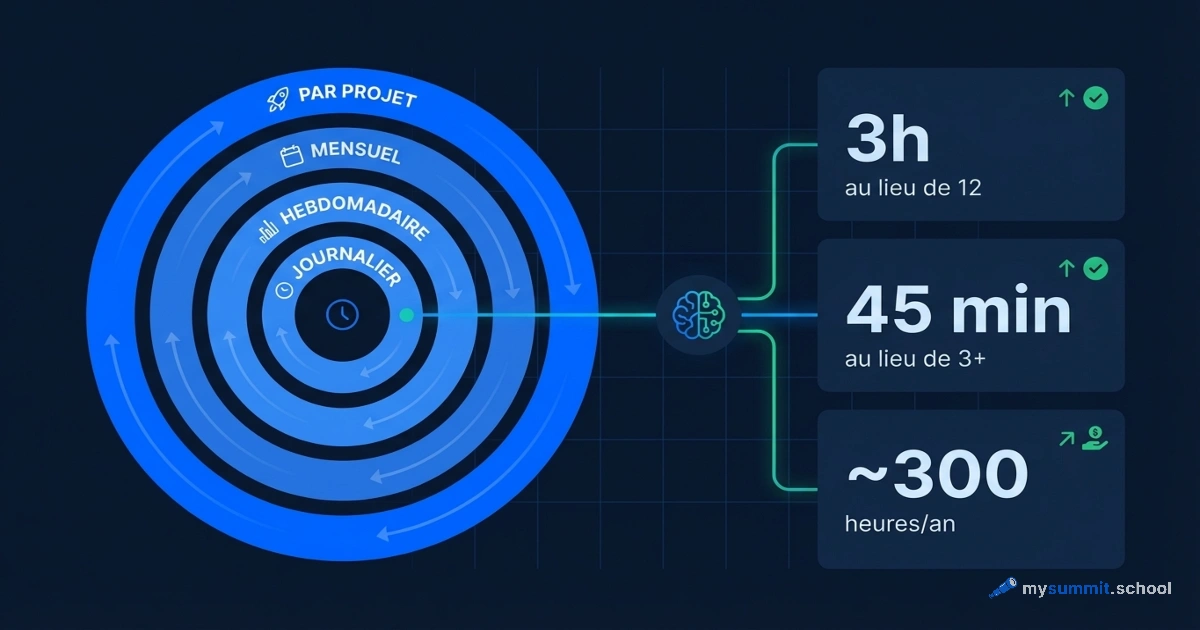

Le rituel le plus coûteux de P5.express est Y2, l’évaluation mensuelle des programmes et projets en cours. Le gestionnaire de portefeuille doit collecter chaque mois les données de tous les programmes et projets actifs : avancement, prévision d’achèvement, réévaluation des bénéfices attendus. Puis mettre à jour la Value Generation Matrix.

Voici un extrait d’une matrice réelle tirée de l’exemple P5.express – uniquement les projets en cours :

En pratique, mettre à jour ce tableau signifie : ouvrir Jira (ou Monday, ou trois fichiers Excel de trois chefs de projet différents), extraire l’avancement actuel de P0040, P0014, P0017, comparer avec le mois précédent – la prévision d’achèvement a-t-elle glissé, les estimations d’investissements ou de bénéfices ont-elles changé – et recalculer la Value. Une à deux heures de travail manuel, reproductible chaque mois.

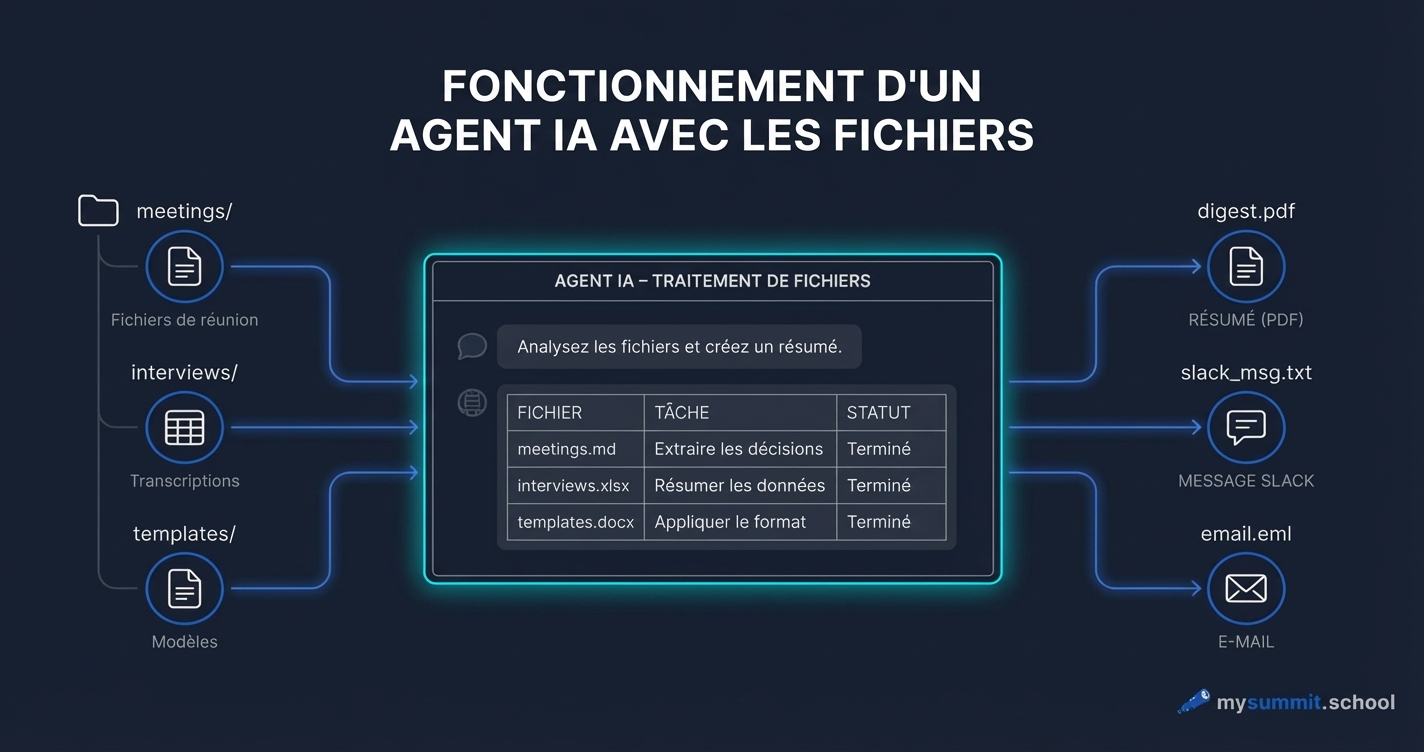

L’agent fait cela plus vite. L’instruction ressemble à ceci :

Condition essentielle : l’agent propose des modifications – c’est l’humain qui valide. La matrice ne se met pas à jour automatiquement. Le gestionnaire de portefeuille examine le diff et clique « accepter » ou « corriger ». Un brouillon à vérifier, pas une mise à jour autonome – exactement le format qui réduit les pertes liées aux hallucinations. Vérifiez l’arithmétique séparément : l’agent affiche avec assurance Value = 1,2, même lorsque les données d’investissement et de bénéfices se contredisent.

Z1 (suivi quotidien des actions) – pattern matching à travers N registres

Le Follow-Up Register dans P5.express ne se limite pas aux risques. C’est une liste de risques, problèmes, demandes de changement, plans d’amélioration et leçons apprises. En terminologie RAID (Risks, Assumptions, Issues, Dependencies) ou RICs – le risque n’est qu’une catégorie parmi d’autres. Le manuel P5.express le dit explicitement : le gestionnaire de portefeuille doit surveiller en continu les registres locaux pour identifier les patterns nécessitant une attention au niveau du portefeuille.

« Surveiller en continu N registres dans toutes les catégories » – c’est exactement le travail pour lequel le mode agentique a été conçu. L’agent parcourt une fois par semaine les registres d’actions de tous les projets actifs – risques, problèmes, demandes de changement, leçons – regroupe les éléments similaires par thème et propose des candidats pour le Global Follow-Up Register avec une suggestion de responsable. Le gestionnaire de portefeuille voit une liste prête et décide quoi transférer.

La nature de la tache change : au lieu de « je parcours 8 registres manuellement » – « je verifie la proposition de l’agent et je prends une decision ». La seconde option passe a l’echelle, la premiere non. En termes d’etudes sur l’intensification du travail – l’agent ici n’accelere pas le travail existant, il redistribue la charge cognitive : le balayage des donnees revient a la machine, la prise de decision reste a l’humain.

X3/Y4 (communication aux parties prenantes) – brouillons de communication

La communication ciblée – focused communication – est la partie de P5.express la moins souvent réalisée en pratique. La raison est banale : rédiger des mises à jour mensuelles pour des parties prenantes, qui se ressemblent toutes, est ennuyeux.

L’agent résout le problème de motivation. Après la mise à jour de la Value Generation Matrix, il produit un brouillon : ce qui a changé dans le mois, ce qui attire l’attention, quels projets ont changé de statut. Le brouillon demande 5 minutes de relecture – contre 40 minutes de rédaction à partir de zéro.

Le résultat est de manière prévisible similaire chaque mois – ce qui est précisément ce qu’on attend d’une mise à jour standard.

Une tâche distincte consiste à veiller à ce que les cycles aient effectivement lieu. Les systèmes minimalistes meurent par omission : une matrice non mise à jour est une matrice obsolète ; deux omissions et elle cesse d’être la source de vérité. Le watchdog le plus simple – une tâche hebdomadaire dans le calendrier ou un script cron qui vérifie les dates de modification des fichiers du portefeuille et envoie un rappel si un document n’a pas été mis à jour dans le délai attendu.

La gestion de portefeuille fait partie du programme. Testez 9 exercices pratiques de management avec l'IA – gratuitement, sans inscription.

Sans paiement requis • Notification au lancement

Zone grise : utile, mais avec des réserves

X2 (atelier semestriel) – préparation de l’atelier

X2 est l’atelier semestriel de réévaluation du portefeuille. C’est l’événement clé du système, et il ne peut pas être automatisé. Mais sa préparation – si.

Une semaine avant l’atelier, l’agent peut préparer : une simulation d’opportunity cost, une analyse des lacunes par catégories de valeur (quelles catégories sont sous-représentées dans le portefeuille actuel), le delta des bénéfices réalisés (ce qui était prévu vs ce qui a été obtenu sur les projets terminés), une clusterisation des idées remontées du terrain.

La simulation d’opportunity cost est la plus précieuse de ces tâches et en même temps la plus fastidieuse à faire manuellement. Voici le prompt :

Le comité arrive à l’atelier avec des scénarios prêts au lieu de les modéliser à la volée. La qualité de la discussion change : on débat des trade-offs au lieu de calculer mentalement.

Réserve : l’agent prépare la note analytique, pas l’ordre du jour. Les décisions de priorisation sont collégiales et politiques au bon sens du terme. On ne peut pas les automatiser, et il ne faut pas essayer.

Red team pour les Business Cases

P5.express exige un Business Case avant chaque nouveau projet dans le portefeuille : pourquoi / alternatives / bénéfices attendus / méthode de mesure / estimation des investissements / principaux risques.

L’agent peut jouer le rôle d’avocat du diable. Le sponsor décrit le projet en quelques phrases – l’agent développe un scaffold de Business Case avec tous les champs obligatoires P5.express, où chaque chiffre est marqué [à vérifier], et lance simultanément un pré-mortem sur ce même cas.

L’agent ne fournit pas les chiffres – il aide le sponsor à les vérifier lui-même. En pratique, le stress-test d’un Business Case est une chaîne de plusieurs techniques : le pré-mortem identifie les scénarios d’échec, l’audit WBS repère les tâches manquantes et les dépendances, le simulateur de parties prenantes prépare aux questions difficiles lors de la soutenance. Toute la chaîne – des scénarios d’échec à la répétition de la soutenance devant le CFO – est détaillée étape par étape dans la spécialisation « Gestion de projets » sur la plateforme.

Le danger clé, qu’il convient d’énoncer explicitement : si l’agent propose lui-même des chiffres et que le sponsor les accepte sans vérification – des bénéfices hallucinés entrent dans la matrice. Le classement se fausse insidieusement. L’agent comme red team – c’est précieux. L’agent comme source d’indicateurs prévisionnels – c’est dangereux.

Dans le même registre – Z2/Z3 (démarrage/arrêt de projets et équilibrage des ressources) : l’agent peut steelmanner les arguments contre une demande spécifique d’un sponsor en se référant aux seuils du Résumé du portefeuille. Cela dépersonnalise les conversations politiquement sensibles.

Où l’IA casse le système

Un chapitre honnête, car P5.express est l’une des méthodologies où l’automatisation peut nuire sur le plan méthodologique, et pas seulement technique.

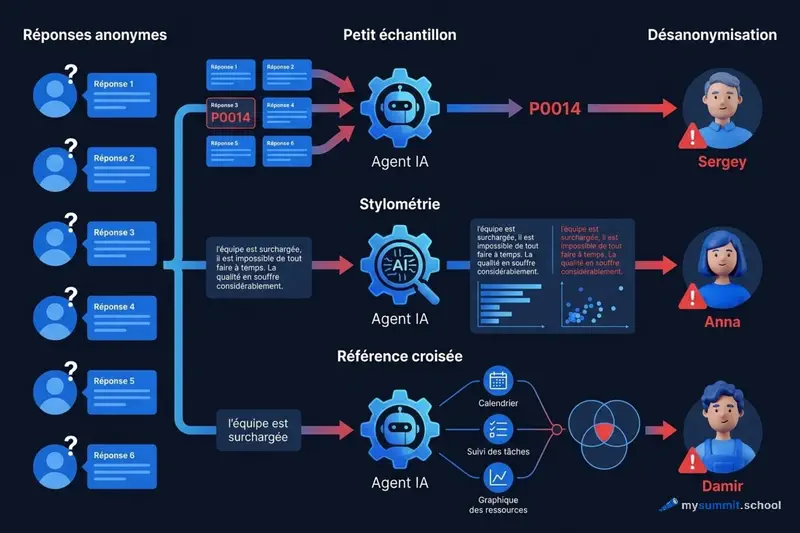

Y1 (enquêtes de satisfaction) via IA détruit les données. Y1 – ce sont des enquêtes anonymes de satisfaction des parties prenantes. L’anonymat est la condition de l’honnêteté. Le problème est que l’agent compromet l’anonymat de plusieurs façons, même si ce n’est pas votre intention.

La première – la désanonymisation par petit échantillon. Un portefeuille compte généralement 5 à 8 parties prenantes. Si un répondant mentionne des retards sur le projet P0014, et que l’agent sait que le sponsor de P0014 est Nour, la réponse cesse d’être anonyme. Un analyste humain pourrait aussi le remarquer, mais l’agent le fait systématiquement et sur toutes les réponses simultanément.

La deuxième – la stylométrie. Les LLM reconnaissent les patterns d’écriture individuels : longueur des phrases, mots caractéristiques, structure de l’argumentation. Dans un groupe de six personnes dont l’agent a lu la correspondance professionnelle, associer un avis anonyme à son auteur est une tâche triviale. Le répondant n’a même pas besoin de nommer le projet – il suffit qu’il écrive comme il le fait habituellement.

La troisième – le croisement contextuel. L’agent du gestionnaire de portefeuille a accès aux registres, à la correspondance, aux comptes rendus de réunions. Une réponse anonyme « les délais sont irréalistes, l’équipe est surchargée », combinée aux données de charge des ressources issues de Z3, pointe vers un responsable précis. L’agent n’est pas malveillant – il relie simplement les points, parce que c’est ce pour quoi il a été conçu.

Résultat : les parties prenantes comprendront vite que l’anonymat est de façade et commenceront à donner des réponses socialement acceptables. Les données Y1 deviendront inutiles. Les enquêtes de satisfaction sont l’une des parties de P5.express qui doivent rester entièrement humaines : collecte, agrégation, analyse.

Optimisation mécanique de la Value Generation Matrix. Le manuel P5.express le dit explicitement : « la matrice ne peut jamais être suffisamment précise pour être optimisée mécaniquement ». Value = bénéfices / investissements – c’est une construction estimative, pas un nombre exact. Si l’agent trie la matrice par Value et propose « lancer les projets du haut, rejeter ceux du bas » – il crée une fausse précision. Le comité commencera à faire confiance au classement au lieu de le discuter. Cela détruit le sens même de la décision collégiale.

Nouveaux champs de données pour l’agent. P5.express contient un principe anti-bloat explicite : ne collectez pas de données que vous n’utilisez pas. Si, pour une meilleure analytique, vous ajoutez 15 nouveaux champs à la matrice – le système devient plus complexe, sa maintenance plus coûteuse, et le minimalisme – la raison pour laquelle vous l’avez choisi – disparaît. L’agent doit travailler avec les données qui existent déjà.

Liste pratique : que tester cette semaine

Si vous gérez un portefeuille avec P5.express ou envisagez de commencer – voici un premier pas concret pour chaque cycle.

Cycle Z (quotidien) : Essayez de donner à l’agent deux ou trois registres d’actions (risques, problèmes, demandes de changement) de projets actifs et demandez-lui de trouver les thèmes récurrents. C’est un premier contact avec Z1 (suivi des actions) – et un bon test pour vérifier si vos registres sont lisibles par une machine.

Cycle Y (mensuel) : Avant la prochaine évaluation mensuelle des projets (Y2), exportez les données d’avancement depuis votre outil de gestion dans un fichier et demandez à l’agent de proposer des lignes mises à jour pour la matrice. Observez où il se trompe – cela révélera les lacunes dans vos données.

Cycle X (semestriel) : Avant le prochain atelier semestriel (X2), demandez à l’agent de formuler 10 arguments contre votre portefeuille actuel – quels projets pourraient ne pas être menés, pourquoi l’opportunity cost est élevé. Ce n’est pas un ordre du jour, c’est un outil pour une meilleure discussion.

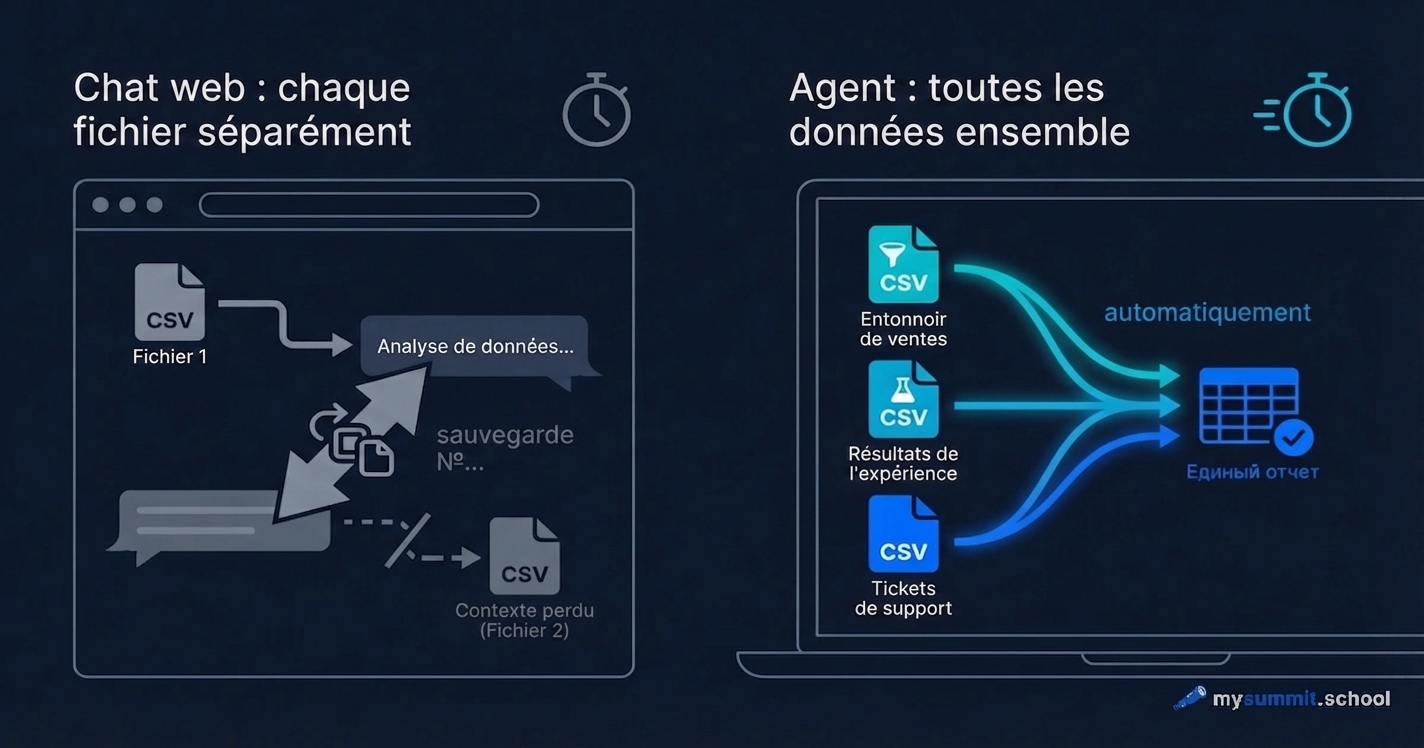

Les trois tâches peuvent être lancées dans n’importe quel chat – ChatGPT, Kimi, DeepSeek – en copiant les données depuis votre système. Un agent sur votre machine (OpenCode ou équivalent) devient nécessaire quand vous voulez automatiser le cycle : l’agent lit les fichiers lui-même, se lance sur un planning et propose des mises à jour sans copier-coller manuel. L’article sur OpenCode propose trois tâches pour le premier jour. L’approche agentique de l’analyse de données est détaillée dans un cas pratique avec trois fichiers.

Pour approfondir le rythme opérationnel du manager avec l’IA, c’est pertinent si P5.express vous semble trop haut niveau – on y détaille les tâches hebdomadaires concrètes.

Travailler avec plusieurs outils simultanément semble simple. La complexité apparaît quand on a besoin non pas d’une analyse ponctuelle, mais d’un processus reproductible – un agent qui se lance sur un planning, connaît la structure de vos fichiers et propose un format cohérent. La différence entre « j’ai joué avec un agent » et « j’ai intégré un agent dans mon travail » est une compétence de formulation de la tâche et une connaissance des limites de l’autonomie.

Tâches de portefeuille, Business Cases, rythme des cycles – testez votre approche de l'IA sur 9 cas de management réels dans le module ouvert. Gratuit, sans inscription.

Sans paiement requis • Notification au lancement

Quel modèle choisir pour ces tâches

Les tâches agentiques P5.express relèvent principalement d’un travail structuré : lire des fichiers, comparer des données, rédiger des brouillons, poser des questions selon un modèle. Cela ne requiert pas l’intelligence maximale, mais exige de la fiabilité et une bonne maîtrise des tableaux et documents.

Selon notre benchmark de 54 modèles pour les tâches managériales, voici le tableau.

Le haut du classement : Claude Sonnet 4.5 domine les catégories « Analyse et prise de décision » et « Planification » avec un score de 4,84. Pour les tâches de red team sur les Business Cases et la préparation de l’atelier X2, c’est un choix solide. L’API Anthropic est accessible en France sans restriction particulière.

Alternatives performantes et accessibles : Kimi K2.5 obtient un score de 4,67 et offre un excellent rapport qualité-prix. Qwen3.5 Plus avec un score de 4,57 est encore plus abordable (0,26 $ par million de tokens d’entrée contre 0,45 $ pour Kimi). DeepSeek V3.2 au même tarif gère bien les tâches de travail sur tableaux.

Conclusion pratique : pour le suivi quotidien (Z1) et l’évaluation mensuelle des projets (Y2) – brouillon à vérifier, travail sur tableaux – Qwen3.5 Plus ou DeepSeek suffisent. Pour l’atelier semestriel (X2), le red team et l’analyse complexe – Kimi K2.5 ou Claude Sonnet 4.5. OpenCode comme outil convient aux deux scénarios : il est vendor-neutral et se connecte à n’importe quel fournisseur.

Conclusion

P5.express est conçu de telle sorte que l’automatisation y fonctionne de manière asymétrique. Là où il faut traiter des données et reproduire un processus – l’agent réduit la friction et rend les cycles réalistes. Là où le processus collégial et le contact humain comptent – l’automatisation détruit précisément ce pour quoi la méthodologie existe.

Étonnamment, un système minimaliste s’avère être un bon filtre pour évaluer les outils agentiques : si la tâche se formule comme « collecte les données, compare avec le passé, propose un brouillon » – l’agent convient. Si la tâche se formule comme « parle avec les gens et aide-les à prendre une décision » – non.

C’est une bonne question à poser pour n’importe quelle autre méthodologie aussi.

De l'expérimentation au système

Les tâches agentiques comme celles analysées ici demandent une compétence – pas seulement un outil. Le socle du cours couvre le prompt engineering et la pensée critique avec l'IA. La spécialisation « Gestion de projets » détaille l'IA dans le rythme opérationnel du manager : des Business Cases aux cycles mensuels.

Stanislav Belyaev

Engineering Leader chez Microsoft18 ans a diriger des equipes d'ingenieurs. Fondateur de mysummit.school. 700+ diplomes chez Yandex Practicum et Stratoplan.