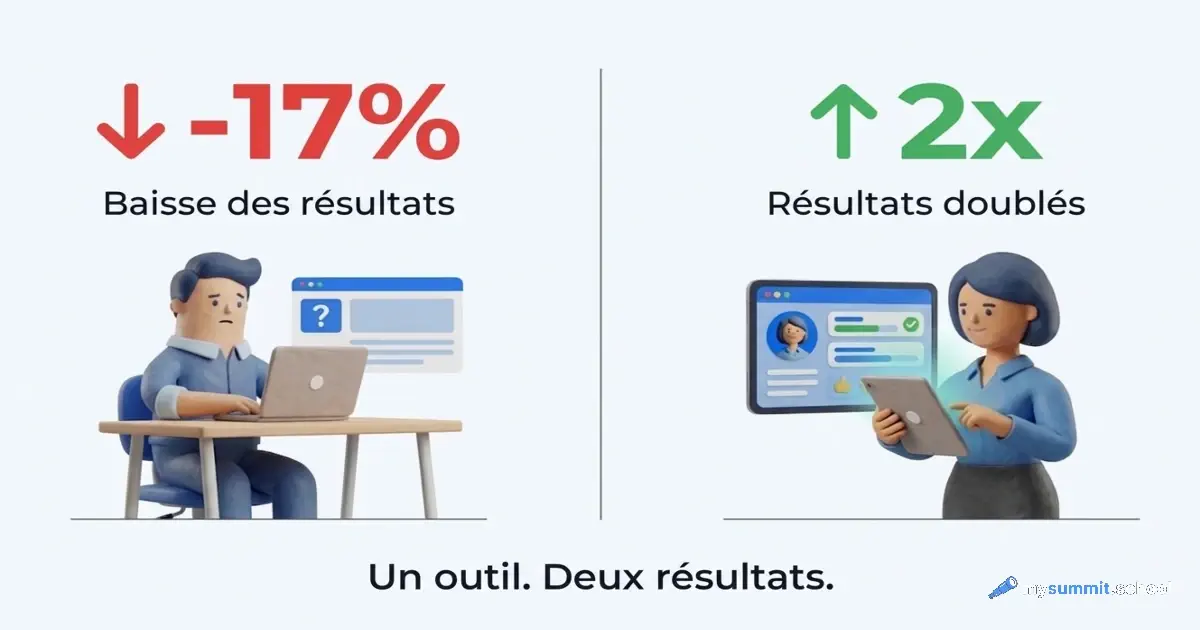

Quand l'IA nuit à l'apprentissage – et quand elle double les résultats

En mars 2025, lors de SXSW EDU, la conseillère en prospective stratégique Sinead Bovell a présenté une conférence sur l’IA et l’avenir de l’éducation. Sans hype, sans panique. Mais avec deux études qui changent la façon dont on devrait penser le rôle de l’IA dans l’apprentissage.

Première étude : un groupe d’étudiants ayant utilisé ChatGPT sans restrictions a obtenu des résultats 17 % inférieurs à ceux du groupe témoin qui travaillait avec un manuel. Deuxième étude : un autre groupe, où l’IA était intégrée dans un système pédagogique entièrement repensé, a surpassé le cours magistral traditionnel du double.

Le même outil. Des résultats opposés. La différence tient à l’approche.

Попробуйте ИИ на 9 реальных задачах – бесплатно, без регистрации. Увидите, где он помогает, а где создаёт ложную уверенность.

Sans paiement requis • Notification au lancement

L’expérience de Wharton : quand l’IA est nuisible

Des chercheurs de la Wharton School of Business (Université de Pennsylvanie), en collaboration avec des enseignants de la British International School de Budapest, ont réparti des étudiants en trois groupes. Le groupe témoin travaillait avec un manuel. Le groupe « GPT-base » utilisait ChatGPT sans restrictions. Le groupe « GPT-tutor » travaillait avec un tuteur IA guidé.

Pendant les exercices, l’écart de performance semblait consacrer la victoire de l’IA : le groupe « GPT-base » réalisait les tâches 48 % mieux que le groupe témoin, et le groupe « GPT-tutor » 127 % mieux.

Puis on a retiré l’IA. Et on a demandé aux étudiants de passer un examen final en autonomie.

Le groupe « GPT-base » a obtenu un score 17 % inférieur à celui des étudiants qui avaient utilisé le manuel. Le groupe « GPT-tutor » s’est aligné sur le niveau du groupe témoin – ni mieux, ni moins bien.

Ce n’est pas un incident pédagogique isolé. Selon Bovell, la conclusion est universelle : l’IA générative sans encadrement nuit à l’assimilation des connaissances. Les étudiants obtenaient les bonnes réponses en contournant le travail cognitif qui crée la compréhension. Une fois l’IA retirée, il s’avérait que la compréhension n’était pas là.

L’étude a été soumise à l’évaluation par les pairs et publiée dans PNAS en juin 2025 – ce qui la fait passer de la catégorie « expérience intéressante » à celle des données scientifiques validées.

Ce même schéma se reproduit dans des expériences à plus petite échelle. Dans une école américaine ordinaire avec peu de moyens, des chercheurs de l’Université de l’Illinois ont configuré l’IA selon les critères précis d’un enseignant – six critères d’évaluation des rédactions, uniquement les documents du programme. Résultat : 5 élèves sur 6 ont amélioré leurs travaux. La différence clé avec le groupe « GPT-base » : l’IA ne donnait pas les réponses – elle indiquait précisément ce qu’il fallait corriger, selon des critères définis. Les élèves qualifiaient ce retour de « direct » et « actionnable » – concret et clair sur ce qu’il fallait faire.

L’expérience Harvard : quand l’IA est doublement efficace

La seconde moitié de la conférence de Bovell porte sur une étude Harvard en physique, qui aboutit à la conclusion exactement inverse. Le groupe ayant travaillé avec l’IA a surpassé le groupe en cours magistral traditionnel du double.

Étonnamment, il n’y avait ni prompt magique ni modèle spécial. La différence était ailleurs : pour le groupe avec IA, tout le système pédagogique avait été entièrement reconfiguré. Les étudiants avançaient à leur propre rythme, recevaient un retour immédiat à chaque étape, et le système s’adaptait à leurs lacunes en temps réel.

Il ne s’agissait pas d’« ajouter l’IA aux cours ». Tout le processus avait été repensé en fonction des nouvelles capacités de l’outil. L’échantillon comptait environ 194 étudiants – suffisant pour des conclusions préliminaires, mais pas définitives.

Bovell formule la conclusion principale directement : si vous intégrez simplement l’IA dans un processus existant sans en changer la logique, vous obtiendrez probablement le premier scénario. Si vous reconceveez le système, le second scénario devient possible.

Alpha School : deux heures au lieu de six

L’un des exemples les plus provocateurs de la conférence est l’école Alpha. Là, les enfants travaillent deux heures par jour avec un tuteur IA sur les compétences académiques fondamentales. Le reste du temps est consacré aux compétences de vie, à l’intelligence émotionnelle, aux projets, aux échanges.

Résultat : 99e percentile en performance scolaire. Certains élèves assimilent en deux heures ce qui prendrait 5 à 10 heures dans une école ordinaire.

Le mécanisme est le même que dans l’étude Harvard : retour adaptatif immédiat à son propre rythme. L’élève n’attend pas que l’enseignant corrige les cahiers. Le système détecte l’erreur au moment où elle se produit et ramène l’élève au bon endroit – pas dans une semaine, mais en quelques secondes.

La question sceptique s’impose d’elle-même : que faire des connaissances acquises « avec l’IA » mais que l’étudiant ne pourra pas reproduire sans elle ? Bovell ne l’esquive pas. Sa réponse : la frontière ne passe pas entre « a utilisé l’IA » et « n’a pas utilisé l’IA », mais entre « a pensé » et « n’a pas pensé ». Un tuteur guidé qui pose des questions et exige des explications préserve le raisonnement dans le processus. Un outil qui se contente de fournir des réponses le supprime.

La crise de la triche et la crise de confiance

Bovell décrit deux phénomènes qui semblent opposés à première vue, mais constituent en réalité les deux faces d’un même problème.

Premier phénomène : les lycéens rédigent leurs dissertations dans ChatGPT après 15 h – et c’est devenu la norme. Les chiffres le confirment : 86 % des lycéens américains utilisent l’IA dans leurs études, tandis que 70 % des enseignants constatent une dégradation de la pensée critique. Bovell appelle cela « l’hypothèse la plus sûre » : si un travail est fait à la maison, il a probablement été réalisé avec l’IA. La réponse n’est pas d’essayer de piéger les tricheurs (une course que les enseignants perdent inévitablement), mais de renverser la logique : apprentissage approfondi et évaluation en classe, recherche avec l’IA à la maison. Davantage de contrôles surprises où aucun outil externe n’est utilisable.

Le second phénomène est plus inattendu. Des étudiants remplacent leurs dissertations rédigées à la main par des textes de ChatGPT – même quand cela ne leur fait pas gagner de temps. Non par paresse. Par manque de confiance en eux. Ils ne font pas confiance à leur propre raisonnement.

C’est plus grave que le problème de la triche. Une étude de Microsoft Research à laquelle Bovell se réfère montre que la dépendance excessive à l’IA réduit la capacité à penser de façon critique. L’individu cesse d’exercer son jugement – et perd progressivement confiance en lui.

9 уроков с реальными задачами – бесплатно. Видно, где AI помогает думать, а где заменяет мышление.

Sans paiement requis • Notification au lancement

Entrepreneurs et pensée critique : qui tire profit de l’IA

L’un des faits les plus inconfortables de la conférence concerne une étude sur les entrepreneurs. Les entrepreneurs très performants dotés d’une pensée critique solide obtenaient, en travaillant avec l’IA, des résultats significativement améliorés. Les entrepreneurs moins performants – des résultats dégradés.

La différence ne tenait pas au modèle utilisé. Elle tenait aux questions posées et à ce qu’on faisait des réponses.

Un entrepreneur très performant arrive à l’IA avec un problème stratégique déjà structuré mentalement. Il sait précisément ce qu’il veut vérifier, quelles hypothèses contester, quelles données manquent. L’IA accélère sa réflexion. L’entrepreneur moins performant arrive avec une demande floue – et accepte la première réponse sans savoir si la bonne question a été posée.

Cela amène à s’interroger sur ce qu’on appelle communément la « démocratisation de l’IA ». L’outil est effectivement accessible à tous. Mais il amplifie ce qui est déjà là. S’il y a de la pensée critique, elle est amplifiée. S’il n’y en a pas, l’IA crée l’illusion de compétence sans son contenu.

Les compétences les plus importantes de demain n’ont rien à voir avec la technologie

C’est peut-être la thèse la plus surprenante de Bovell. Malgré son sujet – la prospective stratégique en matière d’IA – elle parle de compétences qui n’ont aucun rapport avec la technologie.

La pensée critique. La lecture. Le jeu. La réflexion à long terme. La capacité à travailler à l’intersection des disciplines.

Cette dernière, elle l’étaye de façon concrète : les enfants d’aujourd’hui changeront environ 17 fois d’emploi dans 5 secteurs différents au cours de leur carrière. La seule compétence qui fonctionne pour 17 emplois dans 5 secteurs, c’est la capacité à changer de domaine et à percevoir des liens là où un spécialiste ne les voit pas.

Mais pourquoi ces compétences font-elles partie d’une conférence sur l’IA ? Parce qu’elles déterminent précisément si vous tomberez dans la catégorie « l’IA vous amplifie » ou « l’IA vous nuit ». L’expérience de Wharton ne parle pas de ChatGPT. Elle parle de ce qui se passe quand un outil remplace la pensée au lieu de la soutenir.

L’observation la plus pragmatique : la plupart de ces compétences se développent gratuitement. Lire davantage de livres. Jouer à des jeux de stratégie. Discuter des décisions à voix haute. Se poser des questions inconfortables. Ce ne sont pas de nouvelles technologies éducatives – ce sont de vieilles pratiques que le scrolling et l’externalisation de la réflexion à l’IA sont en train de supplanter.

Trois niveaux de réponse au défi

Bovell identifie trois niveaux auxquels l’éducation doit répondre à l’IA.

Premier niveau – une intégration éclairée. Il faut expliquer aux enfants ce qu’est l’IA, comment elle fonctionne, ce qu’elle peut et ne peut pas faire. Non pas « voilà un outil », mais « voilà ce qui se passe sous le capot et pourquoi on ne peut pas faire confiance aveuglément à une réponse ».

Deuxième niveau – l’adaptation des pratiques. Si l’on sait que les enfants utilisent l’IA après l’école, il faut reconfigurer ce qui se passe en classe. Définir où l’utilisation de l’IA est normale et où elle ne l’est pas – et l’intégrer dans le processus pédagogique plutôt que de l’interdire par directive.

Troisième niveau – la refonte fondamentale. Non pas « ajouter l’IA au programme existant », mais repenser l’ensemble du processus depuis zéro. L’expérience Harvard relevait de ce niveau. Et c’est précisément lui qui donne un résultat double plutôt que moins 17 %.

Bovell prend soin de préciser : la tâche du troisième niveau n’incombe pas aux enseignants. C’est une tâche pour les gouvernements, les responsables des systèmes éducatifs, les concepteurs pédagogiques. Les enseignants assument déjà en parallèle les rôles d’assistant social, de psychologue et de mentor. Y ajouter une refonte systémique de la pédagogie, c’est reporter une responsabilité institutionnelle sur quelqu’un qui n’en a ni le temps ni les attributions.

Dans quelle mesure est-ce un vrai problème et non une abstraction ? Les données Microsoft pour 2025 : 67 % des directeurs d’école estiment que les enseignants sont formés à l’IA. 57 % des enseignants eux-mêmes déclarent n’avoir reçu aucune formation. En Russie, l’écart est encore plus marqué : 87 % des étudiants utilisent l’IA, mais seulement 12 % des enseignants le font régulièrement. Le troisième niveau de Bovell n’est pas une théorie. C’est ce qui se passe déjà, sans réponse systémique.

Autre problème : la qualité de ce que l’IA produit pour les enseignants. Une analyse des cours générés par l’IA a montré que 45 % restent au niveau « mémoriser » de la taxonomie de Bloom. Seulement 4 % atteignent l’analyse ou la création. L’IA fait gagner du temps à l’enseignant – mais n’améliore pas ce qu’il produit avec ce temps. Sans comprendre les principes de fonctionnement de l’IA, le cours semble soigné, mais reste au niveau d’un cahier d’exercices sur le plan de la profondeur cognitive.

Où en sommes-nous : l’année 1992 d’Internet

Bovell conclut sa conférence par une métaphore qui mérite d’être méditée séparément. L’IA aujourd’hui, c’est à peu près l’équivalent de 1992 pour Internet. La technologie est comprise par un petit nombre de personnes, tous les autres commencent tout juste à se l’approprier, et Google et Amazon n’ont pas encore été inventés.

L’électricité n’a pas disparu. Elle a simplement cessé d’être un sujet de conversation à part. Personne aujourd’hui ne se demande : « Comment utiliser l’électricité dans ma vie ? » Elle est là, simplement – dans les ampoules, les serveurs, les ascenseurs, les téléphones.

L’IA se dirige vers ce même point. Non pas au sens de « on ne peut pas s’y préparer ». Au sens de : ceux qui apprennent à travailler avec l’outil maintenant, pendant qu’il est encore visible, obtiennent un avantage précisément parce qu’ils en comprennent les principes – et pas seulement parce qu’ils appuient sur des boutons. Quand l’IA deviendra invisible comme l’électricité, appuyer sur des boutons ne sera plus un avantage concurrentiel.

Quelqu’un qui, en 1995, comprenait comment fonctionnait HTTP et pourquoi PageRank comptait les liens comme des votes, avait un horizon de possibilités fondamentalement différent en 2005 – non pas parce qu’il écrivait du code, mais parce qu’il en comprenait la logique. L’expérience de Wharton le montre : il en va de même pour l’IA. Comprendre pourquoi l’outil nuit dans un scénario et aide dans un autre est plus important que savoir appuyer rapidement sur « générer ».

Попробуйте ИИ на реальных задачах – и увидьте, где ошибаетесь

Полная программа курса: от основ промпт-инжиниринга и критического мышления до специализаций по проектному управлению и аналитике. Практические задания на реальных управленческих кейсах – галлюцинации, утечки данных, ложная эффективность.

Ce que cela implique pour un enseignant

Si l’on résume la conférence de Bovell et les données des études en actions concrètes, on obtient une courte liste.

Immédiatement :

- Partir du principe que les devoirs à la maison sont faits avec l’IA. Ne pas le combattre – transférer l’apprentissage en profondeur et l’évaluation en classe.

- Ajouter de courts contrôles surprises sans accès aux appareils – non pour les notes, mais pour rendre visibles les connaissances réelles.

- Expliquer aux élèves comment fonctionne l’IA : ce que sont les hallucinations, pourquoi on ne peut pas faire confiance à une réponse sans vérification, que l’IA est un outil et non un ami.

À moyen terme :

- Si l’école déploie un tuteur IA, exiger un retour immédiat et une adaptation au rythme de l’élève. Sans ces deux éléments, l’IA nuit plus qu’elle n’aide.

- Renverser la logique des devoirs à la maison : recherche avec l’IA à la maison, discussion, analyse critique et défense des conclusions en classe.

Ce qui n’incombe pas à l’enseignant :

- La refonte fondamentale du programme – c’est le travail des ministères, des concepteurs pédagogiques et des architectes des systèmes éducatifs. L’enseignant assume déjà une dizaine de rôles en même temps.