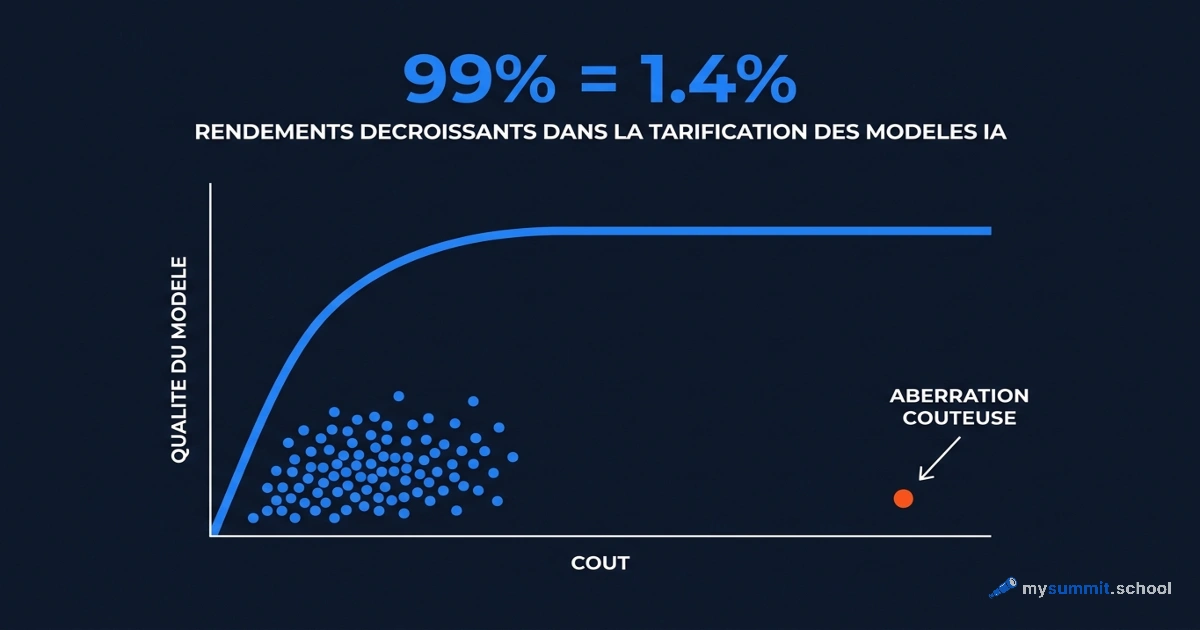

99 % de la qualité pour 1,4 % du prix : ce qui ne va pas sur le marché des modèles IA

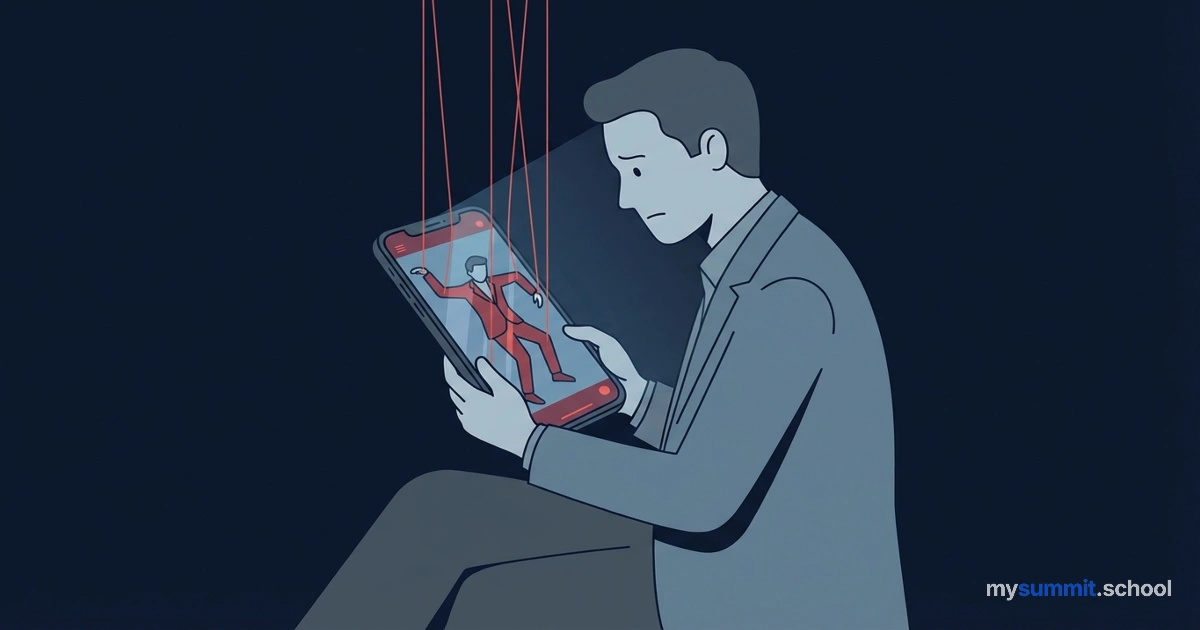

La plupart des managers choisissent un modèle IA de la même manière : ils prennent le plus cher disponible. La logique est limpide – plus cher, c’est mieux. C’est ainsi que fonctionnait le logiciel d’entreprise depuis vingt ans.

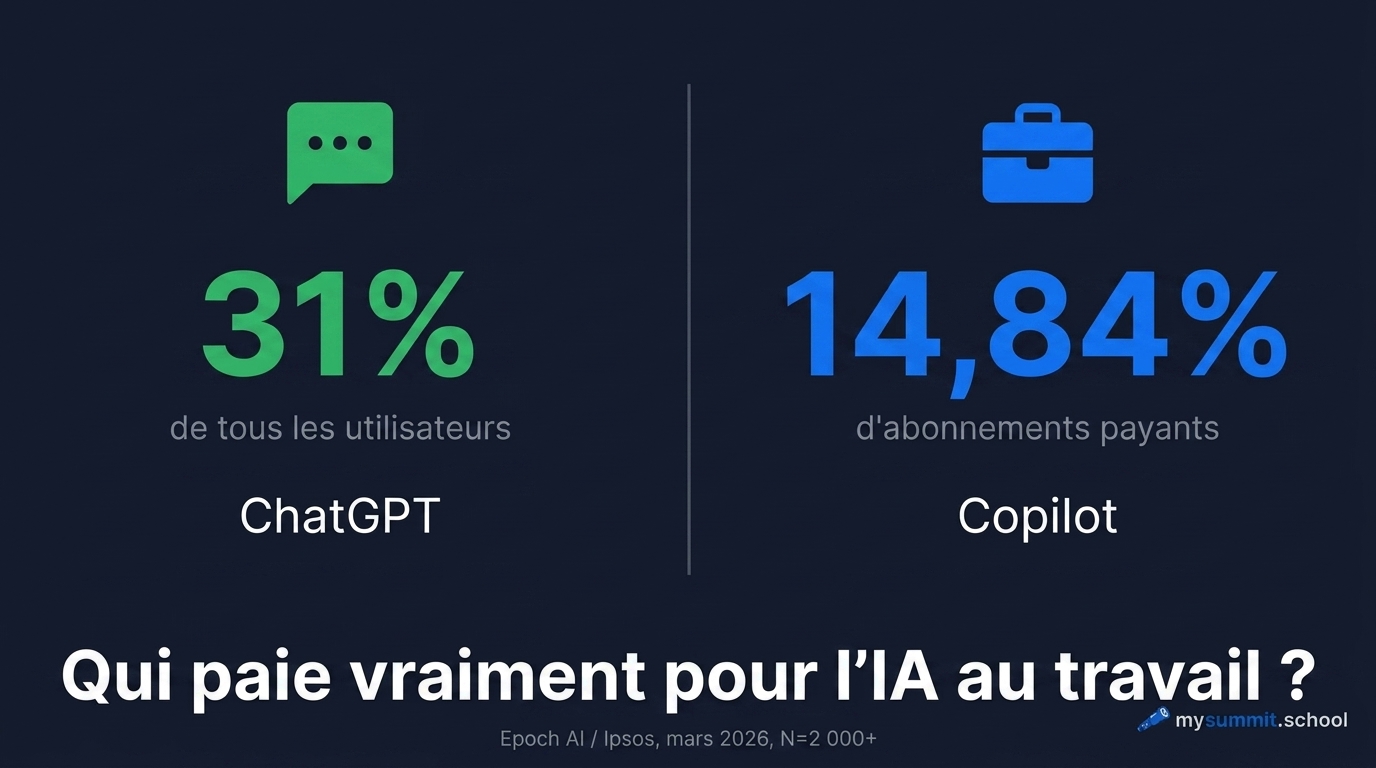

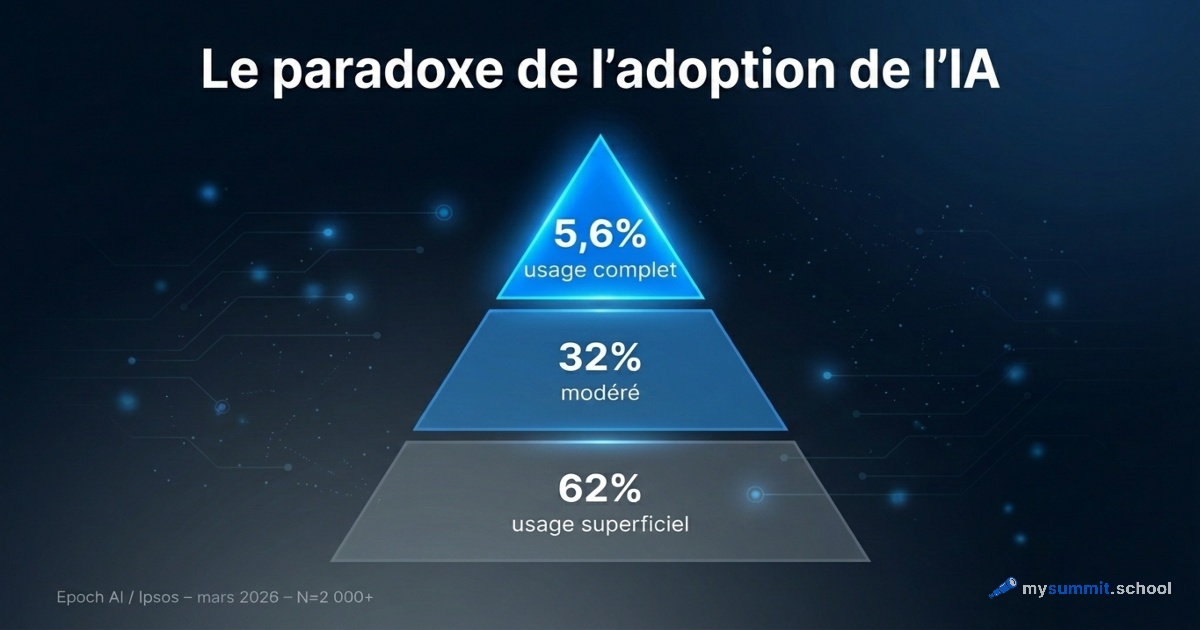

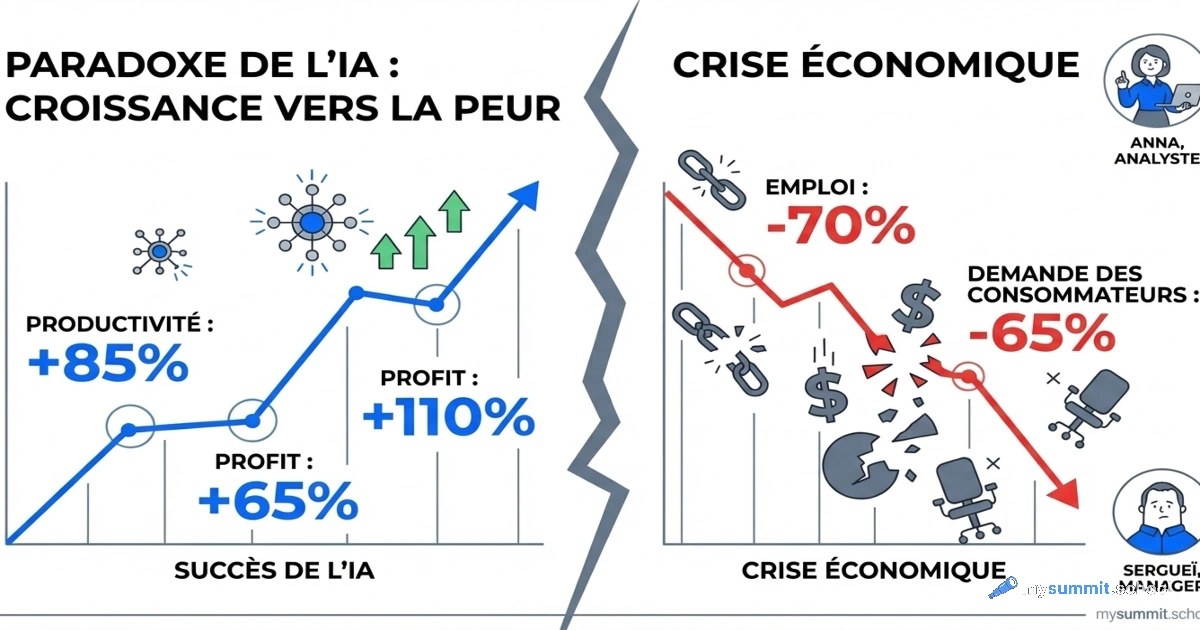

Le marché des modèles IA en 2026 fonctionne différemment. Le coût d’une requête varie de 0,0001 $ à 0,17 $ – trois ordres de grandeur. Et la différence réelle de qualité entre les dix meilleurs modèles ? 0,24 point sur une échelle de cinq. Pendant ce temps, Wharton / GBK Collective constate qu’un tiers des projets IA en entreprise ne dépasse pas le stade du pilote. Et Epoch AI montre que seuls 5,6 % des utilisateurs exploitent réellement l’IA en profondeur.

La question n’est peut-être pas de savoir quel modèle est le meilleur, mais plutôt si payer le prix fort pour un modèle premium produit un résultat proportionnellement meilleur pour les tâches managériales courantes.

Nous avons vérifié. La réponse s’est avérée plus brutale que prévu.

Lire la suite