Quand l'IA nuit à l'apprentissage – et quand elle double les résultats

En mars 2025, lors de SXSW EDU, la conseillère en prospective stratégique Sinead Bovell a présenté une conférence sur l’IA et l’avenir de l’éducation. Sans hype, sans panique. Mais avec deux études qui changent la façon dont on devrait penser le rôle de l’IA dans l’apprentissage.

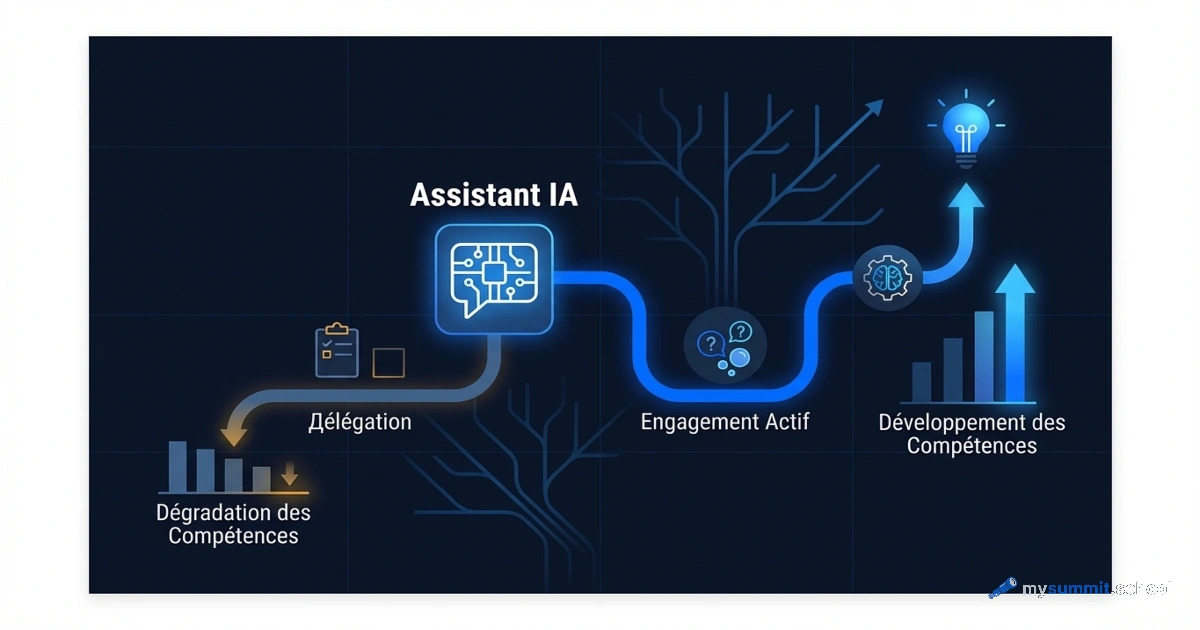

Première étude : un groupe d’étudiants ayant utilisé ChatGPT sans restrictions a obtenu des résultats 17 % inférieurs à ceux du groupe témoin qui travaillait avec un manuel. Deuxième étude : un autre groupe, où l’IA était intégrée dans un système pédagogique entièrement repensé, a surpassé le cours magistral traditionnel du double.

Le même outil. Des résultats opposés. La différence tient à l’approche.

Lire la suite