Pourquoi suivre une formation AI quand tout est dans ChatGPT : analyse scientifique

« Pourquoi suivre vos cours si je peux simplement demander à ChatGPT ? »

Cette question revient dans les commentaires sous chaque publication sur la formation en AI. La logique est imparable : internet est gratuit, ChatGPT explique tout, YouTube regorge de tutoriels. Pourquoi payer une formation si toute l’information est déjà accessible ?

Excellente question. La réponse n’est pas celle qu’on attend.

Parce qu’entre « avoir accès à l’information » et « savoir l’exploiter » – il y a un gouffre. Avoir accès à des manuels médicaux ne fait pas de vous un médecin. Posséder un couteau de cuisine ne fait pas de vous un chef étoilé. Et pouvoir poser une question à ChatGPT ne fait pas de vous un spécialiste en AI. Comme le montre l’étude du MIT sur les architectures de choix, la véritable force d’un spécialiste ne réside pas dans la possession de l’outil, mais dans sa capacité à évaluer de manière critique ce que l’outil propose.

Et ce n’est pas une simple métaphore – c’est un fait confirmé par la recherche.

L’illusion de profondeur de compréhension : votre cerveau vous trompe

Commençons par ce qui dérange. Il existe un biais cognitif appelé Illusion of Explanatory Depth (IOED) – l’illusion de profondeur explicative. En substance : les gens surévaluent systématiquement la profondeur de leur compréhension des choses complexes. Ils croient maîtriser un sujet bien mieux qu’en réalité – jusqu’au moment où on leur demande de l’expliquer sans aide.

Des chercheurs de Cambridge University Press ont découvert que l’illusion ne se dissipe que lorsqu’on oblige la personne à expliquer un concept par elle-même, sans sources externes. Avant ce moment, elle est sincèrement convaincue de comprendre.

L’AI générative aggrave considérablement ce problème.

Quand vous posez à ChatGPT une question sur le machine learning, vous obtenez une réponse parfaitement structurée, grammaticalement impeccable, syntaxiquement irréprochable. La réponse se lit facilement. Elle est logique. Elle « fait sens ». Et votre cerveau commet alors une erreur critique : il confond la fluidité de consommation de l’information avec une véritable compréhension.

Vous n’avez pas étudié le sujet. Vous avez lu un beau texte sur le sujet. Ce sont deux choses fondamentalement différentes.

Une étude publiée dans PubMed le confirme : lorsque les apprenants utilisent les LLM comme source principale de connaissances, ils substituent inconsciemment la compréhension profonde par la capacité à obtenir la bonne réponse de la machine. Leur sentiment de compétence augmente, tandis que leurs compétences réelles en pensée critique – s’atrophient. L’étude du MIT a identifié le même schéma : 86 % des étudiants utilisent l’AI, mais la moitié perd le lien avec l’enseignant.

La formation structurée combat ce phénomène frontalement. À travers des exercices itératifs, des évaluations orales, du travail en groupe et des situations où il est impossible de « demander à l’AI » – les étudiants sont contraints de se confronter aux limites réelles de leur compréhension. C’est inconfortable. Mais c’est précisément ce qui fonctionne.

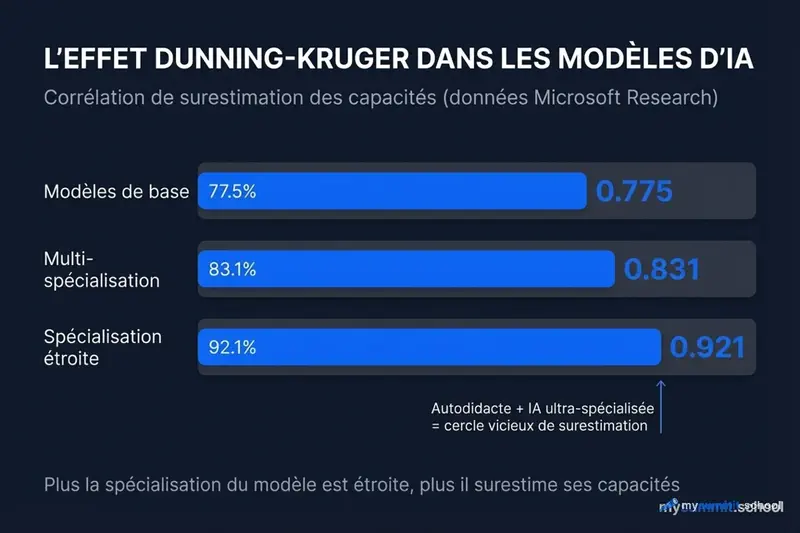

L’effet Dunning-Kruger : version AI

Si l’illusion de profondeur concerne la surévaluation de la compréhension, l’effet Dunning-Kruger concerne la surévaluation des compétences. Les personnes ayant une compétence minimale dans un domaine surévaluent systématiquement leurs capacités, parce qu’elles n’ont pas l’expertise nécessaire pour reconnaître leurs propres erreurs.

Dans le contexte de l’AI, cela fonctionne ainsi. Une personne a appris à générer du code via ChatGPT. Le code compile, fonctionne, résout le problème. La personne conclut qu’elle maîtrise la programmation. Or elle ne détecte pas les erreurs architecturales, les failles de sécurité, les problèmes de scalabilité et les inefficiences – parce que leur détection exige une expertise qu’elle ne possède pas.

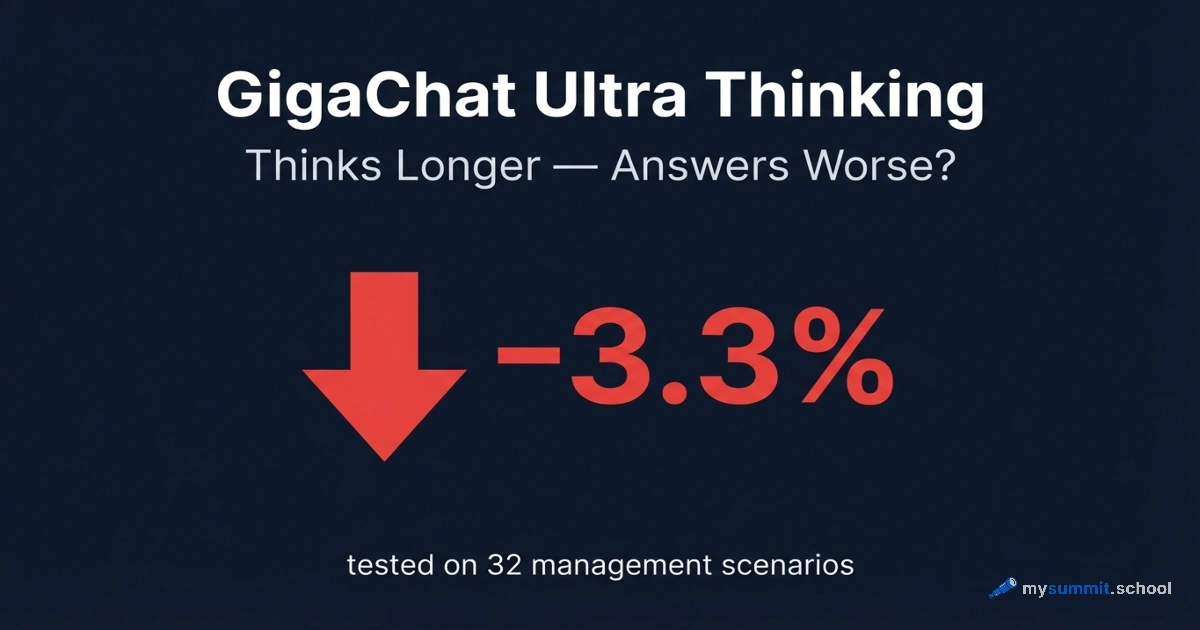

L’étude de Microsoft Research l’a confirmé : les modèles d’AI eux-mêmes présentent des schémas analogues à l’effet Dunning-Kruger. Ils génèrent des réponses confiantes dans des domaines où leur compétence est minimale. L’autodidacte qui s’appuie sur un tel modèle comme unique source de savoir tombe dans un cercle vicieux : étudiant trop confiant + AI trop confiante = illusion de compétence persistante. Fait remarquable, l’étude d’Anthropic a montré que les systèmes d’AI ne se trompent pas simplement – ils se comportent de manière incohérente, ce qui rend la détection des erreurs sans expertise encore plus difficile.

Un enseignant ou un mentor brise ce cycle. Un expert vivant voit les erreurs que vous êtes incapable de voir vous-même. Il pose les questions auxquelles ChatGPT ne penserait jamais. Il crée des situations où votre ignorance devient évidente – et c’est précisément à ce moment que commence l’apprentissage véritable.

La cascade de l’apprentissage superficiel

Des chercheurs ont décrit un phénomène qu’ils ont nommé “From Superficial Outputs to Superficial Learning” – une cascade de dégradation allant des réponses superficielles de l’AI à l’apprentissage superficiel de l’étudiant. Une revue systématique des risques des LLM en éducation a identifié le modèle “LLM-Risk Adapted Learning”, démontrant comment les limitations techniques de l’AI se transforment directement en pertes cognitives pour l’apprenant.

Quand un autodidacte s’appuie sur internet et l’AI générative comme méthode principale d’apprentissage, une dégradation documentée des processus cognitifs se produit :

Premier effet – réduction de l’activité neuronale : la charge cognitive liée à la collecte et à la synthèse de l’information est transférée à la machine. Or cette même charge constitue une lutte neurologique productive, nécessaire à l’encodage profond en mémoire et à la plasticité structurelle du cerveau.

Deuxième – perte des compétences d’apprentissage autonome : l’étudiant perd la capacité de chercher, vérifier, comparer et synthétiser des informations contradictoires, en s’en remettant entièrement aux algorithmes opaques de résumé de l’AI.

Troisième – perte de l’agentivité d’apprentissage : le processus d’apprentissage devient réactif, l’étudiant suit les conclusions de la machine au lieu de générer des hypothèses, poser des questions et mener sa propre analyse.

Les LLM réduisent la charge cognitive pour l’exécution de la tâche – mais ne favorisent pas cet engagement profond dans la matière qui est indispensable à un apprentissage durable et de qualité. Les formations formelles résolvent ce problème en créant des zones « AI-free » : des exercices où la machine est interdite, et où l’étudiant est obligé de penser par lui-même.

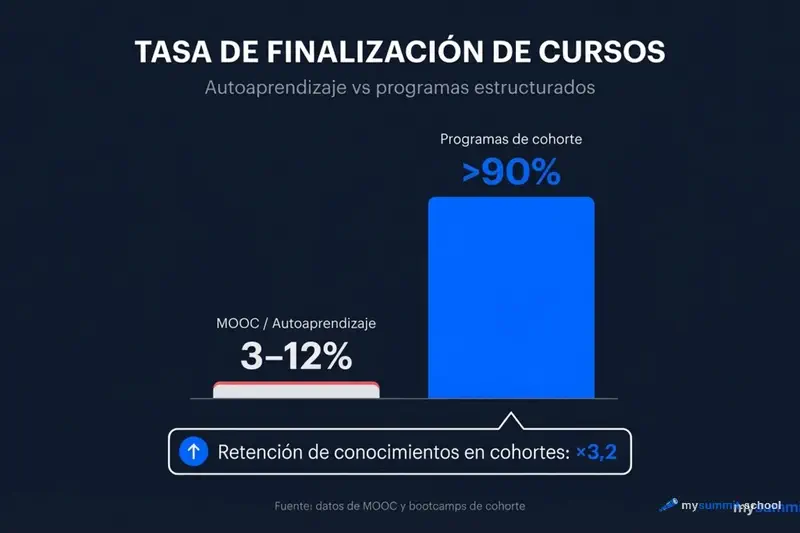

Pourquoi 3 à 12 % iront au bout, et 90 % non

Voici une statistique que les partisans de l’autoformation préfèrent ne pas mentionner.

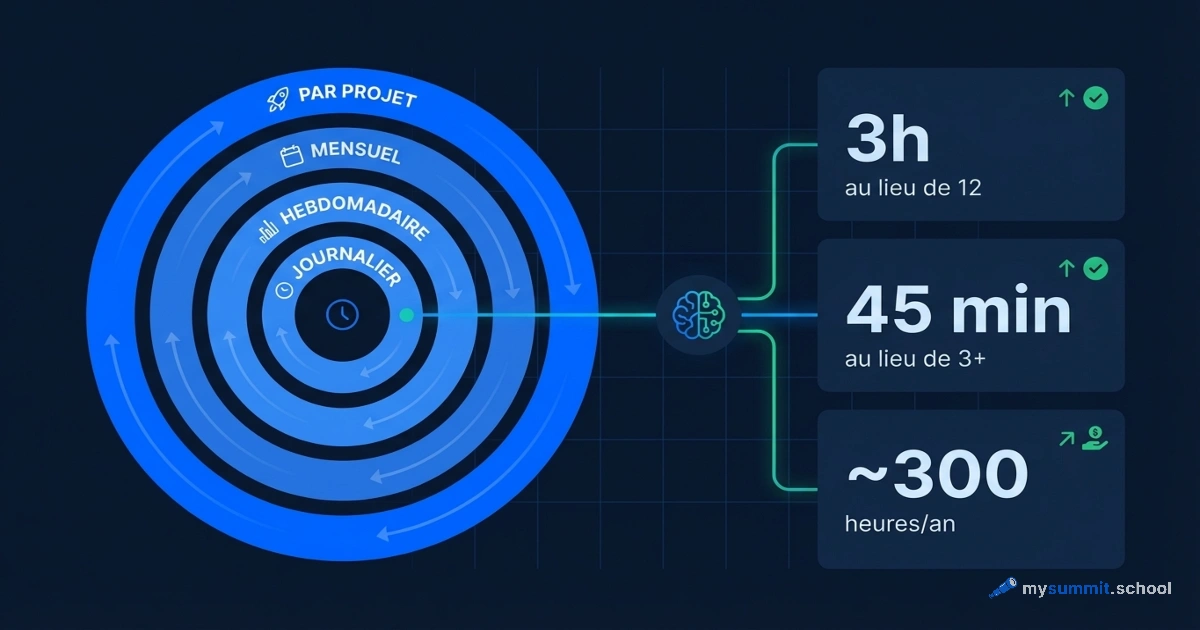

Le taux de complétion des cours en ligne autonomes (MOOC) se situe entre 3 % et 12 %. Ce n’est pas un bug – c’est une « feature » de l’autoformation. Sans structure externe, sans échéances et sans pression sociale, la majorité des gens abandonne. Il est révélateur que même en contexte professionnel, 37 % du temps économisé est perdu à corriger les erreurs de l’AI – et ce sont des données concernant ceux qui ont déjà dépassé le stade de la prise en main.

Les programmes en cohorte – bootcamps, cours avec calendrier fixe et groupe – affichent un taux de complétion supérieur à 90 %.

La raison tient à la théorie de l’apprentissage social de Bandura et au concept de Communities of Practice de Lave et Wenger. L’apprentissage n’est pas un processus isolé de transmission de données. C’est un acte social, observationnel, communautaire. L’identité professionnelle et la compréhension profonde se construisent par l’interaction, l’observation et la participation à une communauté d’experts et de pairs.

L’étudiant solitaire, lisant la documentation sur l’écran de son ordinateur, reçoit exactement zéro apprentissage social. Il ne voit pas comment d’autres personnes résolvent les mêmes problèmes. Il ne reçoit aucun retour de ceux qui ont déjà parcouru ce chemin. Il n’évolue pas dans un environnement où ses erreurs sont détectées et corrigées.

Les données indiquent l’ampleur de la différence : l’apprentissage actif en format cohorte présente une rétention des connaissances 3,2 fois supérieure à celle des apprenants passifs et isolés.

Le mentorat : ce que l’AI ne peut pas simuler

L’AI générative imite remarquablement bien le ton conversationnel d’un mentor. Elle donne un retour rapide, corrige la syntaxe du code, explique les concepts. À première vue – le mentor idéal.

Mais une étude publiée dans ACL Anthology montre l’inverse. L’AI excelle dans la structuration de plans d’études et la génération de documents types. Mais lorsqu’il s’agit de conseils contextuellement précis dans des situations imprévisibles et dynamiques – elle est fondamentalement inadéquate. C’est la même conclusion à laquelle sont parvenus 885 managers dans l’étude de Microsoft sur les limites de la délégation : la responsabilité ne peut pas être transférée à un acteur non humain.

Dans une étude où de futurs enseignants utilisaient l’AI pour obtenir des conseils en gestion de classe, les recommandations de l’AI se sont avérées « fondamentalement erronées et inapplicables en pratique ». Un mentor humain a dû intervenir pour corriger les décisions nuancées que l’AI est incapable de générer.

Le véritable mentorat exige ce que l’AI ne possède fondamentalement pas : la confiance, l’empathie et une compréhension profonde du contexte de la personne. Un mentor ne partage pas seulement des connaissances – il partage l’expérience de ses échecs, les normes implicites de l’industrie et ses contacts professionnels. Quand les étudiants commencent à attribuer à l’AI des qualités humaines comme « l’attention » ou « la compréhension », ce n’est pas du mentorat – c’est un biais cognitif qui les prive d’un véritable soutien professionnel.

Le curriculum caché : l’éthique que YouTube ne vous enseignera pas

L’éducation formelle comporte ce qu’on appelle le « hidden curriculum » – un ensemble implicite de valeurs, de normes et de perspectives que les étudiants assimilent en parallèle du contenu principal. Pour la formation en AI, cela signifie : l’éthique des algorithmes, les biais des modèles, la transparence des données, la responsabilité des conséquences.

Un programme AI moderne amène les étudiants à passer de la question « ce modèle fonctionne-t-il ? » à la question « faut-il déployer ce modèle, et à qui peut-il nuire ? »

Les autodidactes, focalisés sur l’acquisition rapide de compétences en vue d’un emploi, contournent systématiquement ces questions. Les bootcamps professionnels sont eux aussi régulièrement critiqués pour leur priorisation du capital humain rapide au détriment de l’analyse critique des données et de la responsabilité sociale.

Mais c’est précisément la compréhension des limites, des biais et des implications éthiques qui distingue le spécialiste à qui l’on confie des décisions de l’opérateur qui sait appuyer sur des boutons.

Le marché de l’emploi : ce que disent les chiffres

Posons la question de manière pragmatique : qu’en est-il des carrières ?

Les données montrent que 78 à 79 % des diplômés de bootcamps trouvent un emploi pertinent dans les six mois, avec une croissance médiane du salaire d’environ 51 %. Les autodidactes peuvent atteindre un niveau technique comparable, mais le chemin vers le premier emploi est nettement plus difficile – en raison de l’absence de certifications formelles et de réseau professionnel. 82 % des dirigeants utilisent l’AI chaque semaine, selon l’étude Wharton 2025 – mais la pénétration est inégale selon les secteurs, et les exigences en matière de formation augmentent plus vite que l’expertise moyenne des utilisateurs.

Selon les données de Lightcast, les exigences de formation pour les postes en AI sont significativement plus élevées que pour le développement logiciel standard :

| Niveau de formation | Développement logiciel | Ingénierie AI |

|---|---|---|

| Licence | 67 % des offres | 54 % des offres |

| Master | 22 % des offres | 43 % des offres |

| Doctorat | 5 % des offres | 23 % des offres |

Notez bien : 43 % des offres en AI exigent un master, et 23 % un doctorat. Ce n’est pas un caprice des employeurs. C’est le reflet de la complexité réelle du domaine.

Et il y a un autre aspect. À une époque où l’AI peut générer un portfolio, écrire du code et passer un test à distance – les employeurs perdent la capacité de distinguer le portfolio d’un autodidacte du travail d’un prompt engineer qui formule simplement bien ses requêtes. La formation formelle avec des examens contrôlés reste la seule garantie fiable que les connaissances appartiennent réellement à la personne.

Formation structurée en AI avec mentorat, cohorte et pratique – un cours pour les managers qui veulent des résultats, pas des illusions

Sans paiement requis • Notification au lancement

Alors, pourquoi suivre une formation ?

Revenons à la question initiale. « Pourquoi payer une formation si tout est sur internet ? »

Parce qu’internet fournit des données, pas des compétences. ChatGPT génère des réponses, pas de la compréhension. YouTube montre les solutions des autres, pas la structuration de votre propre pensée.

La formation structurée apporte quatre choses qu’il est impossible d’obtenir seul :

Un cadre cognitif – une structure séquentielle qui gère la complexité du matériel, oblige à traverser la lutte productive et ne permet pas de sauter les fondamentaux au profit des outils à la mode.

L’apprentissage social – un environnement où l’on apprend non seulement de l’enseignant, mais aussi du groupe : par le retour d’expérience, la comparaison des approches et l’observation de la façon dont d’autres personnes réfléchissent aux mêmes problèmes.

La calibration externe – des personnes réelles qui vous montrent le niveau véritable de votre compréhension sans le filtre de politesse caractéristique de l’AI. C’est douloureux, mais c’est le seul moyen de s’extraire de l’illusion de compétence.

La validation des connaissances – dans un monde où l’AI peut générer n’importe quel résultat, la validation formelle par un organisme qui a vérifié vos connaissances en conditions contrôlées devient non pas moins, mais plus précieuse.

L’accès à l’information n’est pas une éducation. C’est simplement l’accès à l’information. La différence – c’est ce qui se passe dans votre cerveau au cours du processus.

Et voici ce qui est curieux : si l’autoformation avec ChatGPT fonctionne réellement aussi bien que les cours structurés – pourquoi ceux qui l’affirment continuent-ils à l’affirmer dans les commentaires, au lieu de démontrer des résultats dans leur travail ?

Ce problème est particulièrement aigu dans l’éducation. Au Kazakhstan, 252 000 enseignants ont obtenu des certifications AI – sans acquérir de compétences disciplinaires. En Russie, 87 % des élèves utilisent l’IA, contre 12 % des enseignants. Une analyse détaillée des 5 problèmes de déploiement de l’AI dans les écoles de la CEI – avec des données et des étapes concrètes pour les dirigeants.

Vous voulez maîtriser l'IA de façon systématique ?

Module ouvert du cours – gratuit, sans inscription. Ressentez la différence entre lire sur l'AI et apprendre réellement.

Continuez votre apprentissage

Ouvrez le manuel et reprenez là où vous vous êtes arrêté

Sources

- Broad effects of shallow understanding: Explaining an unrelated phenomenon exposes the illusion of explanatory depth – Cambridge University Press, étude sur l’IOED

- Embracing the illusion of explanatory depth: A strategic framework for using iterative prompting for integrating large language models in healthcare education – PubMed, IOED et LLM en éducation

- ChatGPT and the Illusion of Explanatory Depth – eScholarship, impact de ChatGPT sur la profondeur de compréhension

- Do Code Models Suffer from the Dunning-Kruger Effect? – Microsoft Research, effet Dunning-Kruger dans les modèles d’AI

- From Superficial Outputs to Superficial Learning: Risks of Large Language Models in Education – arXiv, cascade d’apprentissage superficiel

- Applications of social theories of learning in health professions education programs: A scoping review – PMC, théorie de l’apprentissage social de Bandura

- Evaluating Generative AI as a Mentor Resource: Bias and Implementation Challenges – ACL Anthology, limites du mentorat par AI

- Mentorship in the Age of Generative AI: ChatGPT to Support Self-Regulated Learning of Pre-Service Teachers – MDPI, mentorat par AI en formation des enseignants

- Bootcamp, College, or Self-Taught? Comparing Learning Paths for Career Changers in Tech – SynergisticIT, comparaison des parcours vers une carrière tech

- Artificial Intelligence and the Sustainability of the Signaling and Human Capital Theories – MDPI, exigences de formation en AI selon les données Lightcast