Когда ИИ вредит обучению – и когда удваивает результат

В марте 2025 года на SXSW EDU советник по стратегическому форсайту Синид Бовелл сделала доклад об ИИ и будущем образования. Без хайпа и без паники. Но с двумя исследованиями, которые меняют то, как стоит думать о роли ИИ в обучении.

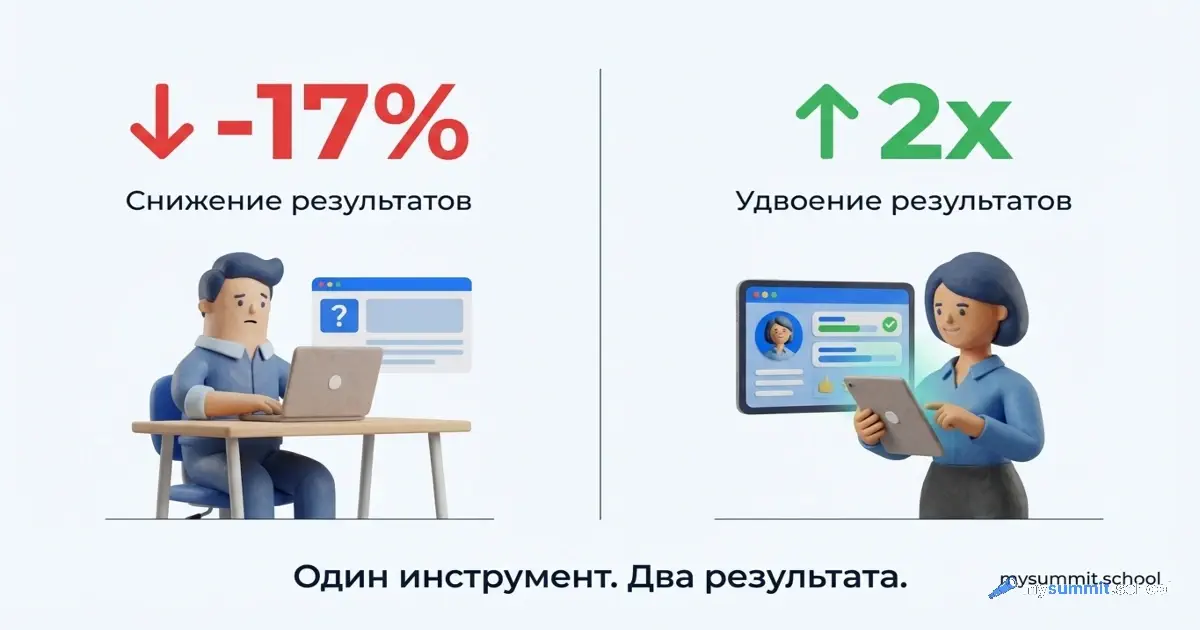

Первое: группа студентов, использовавших ChatGPT без ограничений, показала результаты на 17% хуже контрольной группы, работавшей по учебнику. Второе: другая группа, где ИИ применялся в рамках полностью переработанной учебной системы, опередила традиционную лекцию вдвое.

Один и тот же инструмент. Противоположные результаты. Разница – в подходе.

Попробуйте ИИ на 9 реальных задачах – бесплатно, без регистрации. Увидите, где он помогает, а где создаёт ложную уверенность.

Доступ сразу после регистрации

Продолжите обучение

Откройте учебник и продолжите с того места, где остановились

Эксперимент Уортонской школы: когда ИИ вредит

Исследователи из Уортонской школы бизнеса (Пенсильванский университет) совместно с педагогами Будапештской британской международной школы разделили студентов на три группы. Контрольная группа работала с учебником. Группа «GPT-base» использовала ChatGPT без ограничений. Группа «GPT-tutor» работала с направляемым ИИ-тьютором.

Во время практики разрыв в производительности казался очевидной победой ИИ: группа «GPT-base» выполняла задания на 48% лучше, группа «GPT-tutor» – на 127% лучше контрольной.

Но потом убрали ИИ. И попросили написать финальный тест самостоятельно.

Группа «GPT-base» показала результат на 17% хуже, чем студенты с учебником. Группа «GPT-tutor» вышла на уровень контрольной – ни хуже, ни лучше.

Это не частный педагогический казус. По словам Бовелл, вывод универсален: генеративный ИИ без ограничений вредит усвоению материала. Студенты получали правильные ответы, минуя когнитивную работу, которая и создаёт понимание. Когда ИИ убирали, оказывалось, что понимания нет.

Исследование прошло рецензирование и опубликовано в PNAS в июне 2025 года – что переводит его из категории «интересный эксперимент» в категорию проверенных научных данных.

Этот же паттерн воспроизводится в менее масштабных экспериментах. В обычной американской школе с низким финансированием исследователи Университета Иллинойса настроили AI строго под рубрику конкретного учителя – шесть критериев оценки эссе, материалы только из программы. Результат: 5 из 6 учеников улучшили работы. Ключевое отличие от «GPT-base»: AI не давал ответов – он указывал, что именно нужно исправить, по конкретным критериям. Ученики называли обратную связь «direct» и «fixable» – конкретная и понятно, что делать.

Гарвардский эксперимент: когда ИИ работает вдвое лучше

Вторая половина доклада Бовелл – гарвардское исследование по физике, которое даёт прямо противоположный вывод. Группа, работавшая с ИИ, опередила традиционную лекционную группу в два раза.

Удивительно, но здесь не было никакого волшебного промпта или особой модели. Дело в другом: для группы с ИИ полностью перестроили учебную систему. Студенты занимались в своём темпе, получали немедленную обратную связь по каждому шагу, система адаптировалась под их пробелы в реальном времени.

Это не «добавили ИИ к урокам». Это переработали весь процесс под новые возможности инструмента. Выборка составила около 194 студентов – достаточно для предварительных выводов, но не окончательных.

Бовелл формулирует ключевой вывод напрямую: если вы просто встраиваете ИИ в существующий процесс, не меняя его логику, вы, скорее всего, получите первый сценарий. Если вы перепроектируете систему – появляется шанс на второй.

Alpha School: два часа вместо шести

Один из самых провокационных примеров в докладе – школа Alpha. Там дети занимаются с ИИ-тьютором два часа в день на твёрдых академических навыках. Остальное время – жизненные навыки, эмоциональный интеллект, проекты, общение.

Результат: 99-й процентиль по успеваемости. Некоторые ученики усваивают за два часа объём, на который в обычной школе ушли бы 5–10 часов.

Механизм тот же, что в гарвардском исследовании: адаптивная немедленная обратная связь в своём темпе. Ученик не ждёт, пока учитель проверит тетради. Система замечает ошибку в момент её возникновения и возвращает к нужному месту – не через неделю, а через секунду.

Скептический вопрос напрашивается сам: а как быть с теми знаниями, которые студент приобрёл «с ИИ», но не сможет воспроизвести без него? Бовелл не уходит от этого. Её ответ: граница пролегает не между «использовал ИИ» и «не использовал», а между «думал» и «не думал». Направляемый тьютор, который задаёт вопросы и требует объяснений, сохраняет мышление в процессе. Инструмент, который просто выдаёт ответы, – убивает его.

Кризис списывания и кризис уверенности

Бовелл описывает два явления, которые на первый взгляд кажутся противоположными, но на самом деле – две стороны одного.

Первое: школьники пишут эссе в ChatGPT после 15:00 – и это стало нормой. Цифры подтверждают: 86% школьников в США используют ИИ в учёбе, при этом 70% учителей видят деградацию критического мышления. Бовелл называет это «самым безопасным допущением»: если работа выполнена дома, она, скорее всего, сделана с AI. Ответ – не попытки ловить нарушителей (это гонка, которую учителя неизбежно проигрывают), а переворот логики: глубокое изучение и проверки – в классе, исследование с AI – дома. Больше внезапных проверок знаний, где невозможно воспользоваться внешним инструментом.

Второе явление неожиданнее. Студенты заменяют свои написанные от руки эссе текстами ChatGPT – даже когда это не экономит времени. Не из лени. Из неуверенности в себе. Они не доверяют собственному мышлению.

Это острее, чем проблема списывания. Исследование Microsoft Research, на которое ссылается Бовелл, показывает: чрезмерная зависимость от AI снижает способность к критическому мышлению. Человек перестаёт тренировать суждение – и постепенно теряет в него веру.

9 уроков с реальными задачами – бесплатно. Видно, где AI помогает думать, а где заменяет мышление.

Доступ сразу после регистрации

Продолжите обучение

Откройте учебник и продолжите с того места, где остановились

Предприниматели и мышление: кто выигрывает от ИИ

Один из самых неудобных фактов доклада – исследование предпринимателей. Высокоэффективные предприниматели с сильным критическим мышлением при работе с ИИ показывали значительно улучшенные результаты. Низкоэффективные предприниматели – ухудшенные.

Разница не в модели. Разница в том, какие вопросы задаются и что делается с ответами.

Высокоэффективный предприниматель приходит к ИИ со стратегической проблемой, уже структурированной в голове. Он знает, что именно он хочет проверить, какие допущения нужно оспорить, каких данных не хватает. ИИ ускоряет его мышление. Низкоэффективный предприниматель приходит с размытым запросом – и принимает первый же ответ, не зная, правильный ли вопрос был задан.

Это заставляет задуматься о том, что принято называть «демократизацией ИИ». Инструмент действительно доступен всем. Но инструмент усиливает то, что есть. Если есть критическое мышление – оно усиливается. Если его нет – AI создаёт иллюзию компетентности без её содержания.

Самые важные навыки будущего не связаны с технологиями

Это, пожалуй, самый неожиданный тезис Бовелл. При всей своей теме – стратегический форсайт в области AI – она говорит о навыках, которые не имеют к технологиям никакого отношения.

Критическое мышление. Чтение. Игра. Долгосрочное мышление. Умение работать на стыке дисциплин.

Последнее она обосновывает конкретно: сегодняшние дети за карьеру сменят около 17 работ в 5 разных отраслях. Единственный навык, который работает в 17 работах и 5 отраслях, – способность переключаться между доменами и видеть связи там, где узкий специалист их не замечает.

Но почему эти навыки – часть доклада об AI? Потому что именно они определяют, попадёте ли вы в категорию «ИИ усиливает» или «ИИ вредит». Уортонский эксперимент не о ChatGPT. Он о том, что происходит, когда инструмент заменяет мышление, а не поддерживает его.

Самое практичное наблюдение: большинство этих навыков развиваются бесплатно. Читать больше книг. Играть в стратегические игры. Обсуждать решения вслух. Задавать себе неудобные вопросы. Это не новые образовательные технологии – это старые практики, которые вытесняются скроллингом и AI-аутсорсингом мышления.

Три уровня ответа на вызов

Бовелл описывает три уровня, на которых образование должно реагировать на ИИ.

Первый уровень – безопасное внедрение. Детям нужно объяснять, что такое AI, как он работает, что он может и чего не может. Не «вот вам инструмент», а «вот что происходит под капотом и почему нельзя слепо доверять ответу».

Второй уровень – адаптация практик. Если известно, что дети используют AI после школы, нужно перестроить то, что происходит в классе. Где именно использование AI нормально, а где нет – и как это встраивается в учебный процесс, а не запрещается директивой.

Третий уровень – фундаментальный редизайн. Не «добавить AI к существующей программе», а переосмыслить весь процесс с нуля. Гарвардский эксперимент был об этом уровне. И именно он даёт двукратный результат вместо минус 17%.

Бовелл при этом специально оговаривается: задача третьего уровня – не для учителей. Это задача для правительств, руководителей систем образования, методистов. Учителя уже выполняют роли социального работника, психолога и ментора параллельно с основной функцией. Добавлять к этому ещё и системное переосмысление педагогики – значит перекладывать институциональную ответственность на человека, у которого нет на это ни времени, ни полномочий.

Насколько это реальная проблема, а не абстракция? Данные Microsoft за 2025 год: 67% директоров школ считают, что учителя обучены работе с AI. 57% самих учителей говорят: никакой подготовки не было. В России разрыв ещё острее: 87% студентов используют AI, но лишь 12% учителей делают это регулярно. Третий уровень Бовелл – это не теория. Это то, что уже происходит без системного ответа.

Отдельная проблема – качество того, что AI генерирует для учителей. Анализ AI-сгенерированных уроков показал: 45% застревают на уровне «запомни» по таксономии Блума. Только 4% поднимаются до анализа или создания. AI экономит учителю время – но не улучшает то, что учитель за это время производит. Без понимания принципов работы AI урок выглядит красиво, но по когнитивной глубине остаётся на уровне рабочей тетради.

Где мы сейчас: 1992 год интернета

Бовелл заканчивает доклад метафорой, которую стоит обдумать отдельно. ИИ сегодня – это примерно 1992 год для интернета. Технология понятна небольшому числу людей, все остальные только начинают её осваивать, и Google с Amazon ещё не изобретены.

Электричество не исчезло. Оно просто перестало быть предметом отдельного разговора. Ни один человек сейчас не думает: «Как мне использовать электричество в своей жизни?». Оно просто есть – в лампочках, серверах, лифтах, телефонах.

ИИ двигается к той же точке. Не в смысле «к этому нельзя готовиться». В смысле: те, кто учится работать с инструментом сейчас, когда он ещё виден, получают преимущество именно потому, что понимают принципы – а не только нажимают кнопки. Когда ИИ станет невидимым, как электричество, нажатие кнопок уже не будет конкурентным преимуществом.

Человек, который в 1995 году понимал, как работает HTTP и почему PageRank считает ссылки голосами, имел принципиально другой горизонт возможностей в 2005-м – не потому что писал код, а потому что понимал логику. Уортонский эксперимент показывает: то же самое верно для ИИ. Понимание того, почему инструмент вредит в одном сценарии и помогает в другом, важнее, чем умение быстро нажать «сгенерировать».

Попробуйте ИИ на реальных задачах – и увидьте, где ошибаетесь

9 уроков открытого модуля: вы применяете AI на практических задачах и обнаруживаете скрытые ошибки – галлюцинации в протоколах, утечку данных, ложную эффективность. Бесплатно, без регистрации.

Продолжите обучение

Откройте учебник и продолжите с того места, где остановились

Что из этого следует для учителя

Если свести доклад Бовелл и данные исследований к конкретным действиям, получается короткий список.

Прямо сейчас:

- Исходить из того, что домашняя работа делается с AI. Не бороться с этим – перенести глубокое обучение и оценку в класс.

- Добавить короткие внезапные проверки знаний без доступа к устройствам – не ради оценок, а для видимости реальных знаний.

- Объяснять ученикам, как работает AI: что такое галлюцинации, почему нельзя доверять ответу без проверки, что AI – инструмент, а не друг.

В среднесрочной перспективе:

- Если школа внедряет AI-тьютора – требовать немедленную обратную связь и адаптацию к темпу ученика. Без этих двух элементов AI скорее вредит, чем помогает.

- Перевернуть логику домашней работы: исследование с AI – дома, обсуждение, критический анализ и защита выводов – в классе.

Не задача учителя:

- Фундаментальный редизайн программы – это работа для министерств, методистов и проектировщиков образовательных систем. Учитель и без того совмещает десяток ролей.