Claude Code недоступен? OpenCode работает в России – бесплатно

В марте 2026 года Lenny Rachitsky опубликовал статью с говорящим заголовком: «Everyone should be using Claude Code». Материал разлетелся по LinkedIn и Telegram-каналам, набрал сотни тысяч просмотров, и теперь каждую неделю кто-то из менеджеров спрашивает: как это попробовать?

Ответ неудобный. Claude Code официально недоступен в России и большинстве стран СНГ. Подписка Anthropic Max, которая его открывает, стоит $100 в месяц и требует карту, которую не всегда легко получить. Это создаёт странную ситуацию: один из самых обсуждаемых AI-инструментов года – физически за барьером для значительной части аудитории, которая о нём читает.

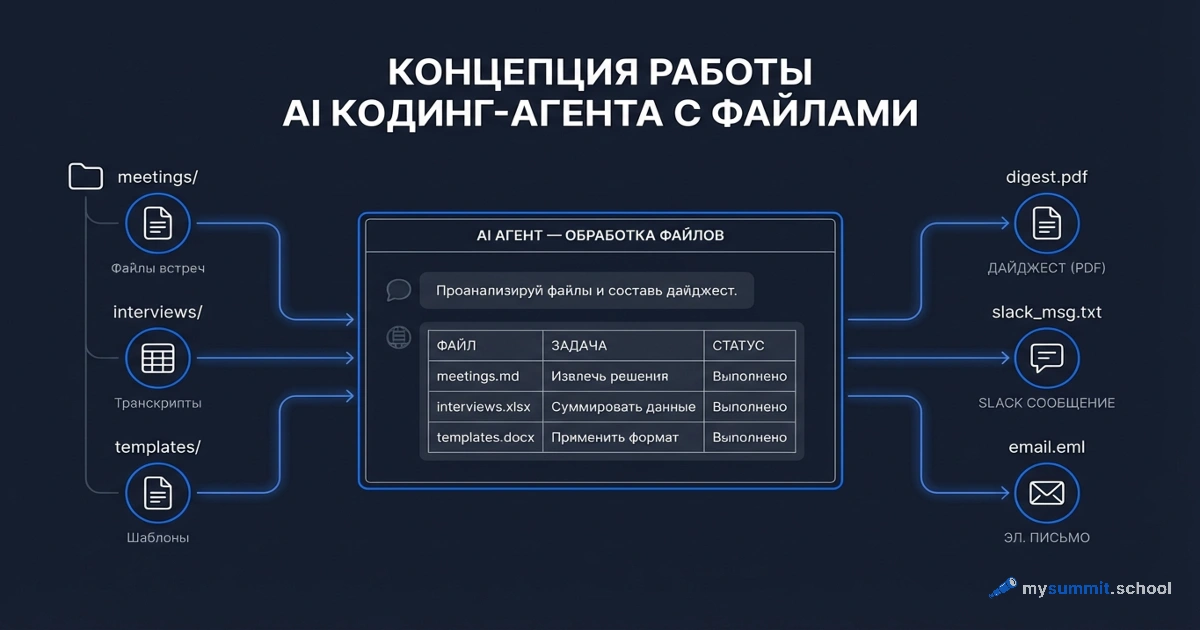

Есть прямая альтернатива. OpenCode – open-source проект, который делает ровно то же самое, работает с любыми моделями (включая доступные в России), и ставится за 15 минут.

Читать полностью