Когда ИИ вредит обучению – и когда удваивает результат

В марте 2025 года на SXSW EDU советник по стратегическому форсайту Синид Бовелл сделала доклад об ИИ и будущем образования. Без хайпа и без паники. Но с двумя исследованиями, которые меняют то, как стоит думать о роли ИИ в обучении.

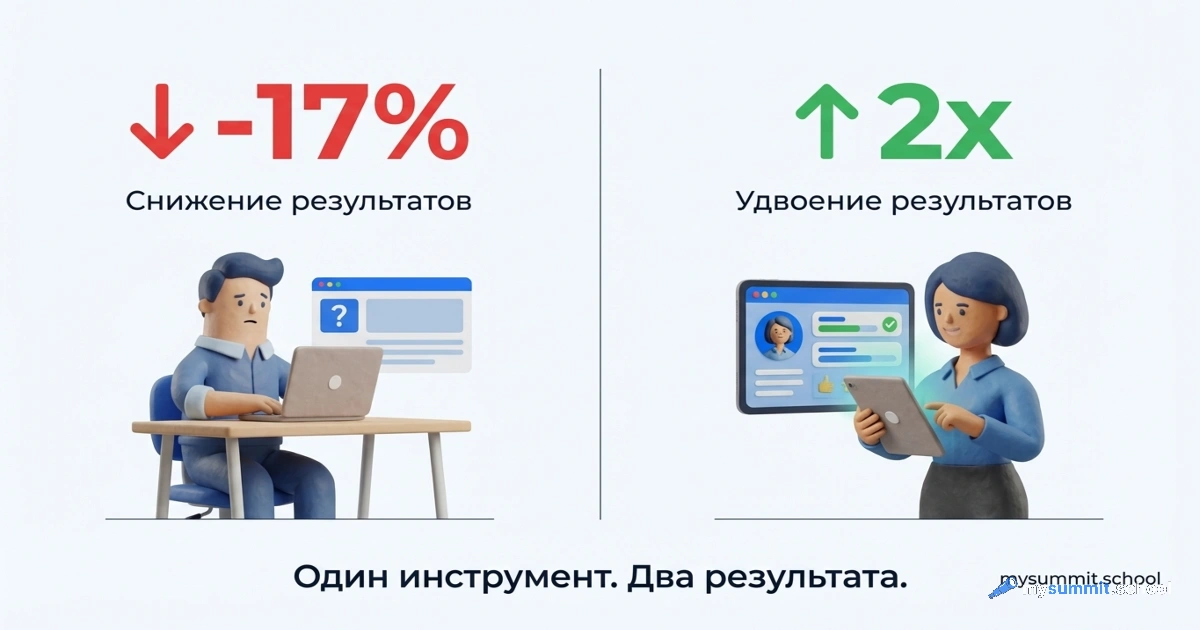

Первое: группа студентов, использовавших ChatGPT без ограничений, показала результаты на 17% хуже контрольной группы, работавшей по учебнику. Второе: другая группа, где ИИ применялся в рамках полностью переработанной учебной системы, опередила традиционную лекцию вдвое.

Один и тот же инструмент. Противоположные результаты. Разница – в подходе.

Читать полностью