Зачем учить AI на курсах, если всё есть в ChatGPT: разбор по науке

“Зачем мне ваши курсы, если я могу просто спросить ChatGPT?”

Этот вопрос звучит в комментариях под каждым постом об обучении AI. Логика железная: интернет бесплатный, ChatGPT объяснит что угодно, YouTube полон туториалов. Зачем платить за курс, если вся информация уже доступна?

Вопрос отличный. Ответ на него – не тот, который ожидают услышать.

Потому что между “иметь доступ к информации” и “уметь с ней работать” – пропасть. Доступ к медицинским справочникам не делает вас врачом. Наличие кухонного ножа не делает вас шеф-поваром. А возможность задать вопрос ChatGPT не делает вас специалистом по AI. Как показывает исследование MIT о выборе, реальная сила специалиста – не в наличии инструмента, а в способности критически оценить то, что инструмент предлагает.

И это не просто красивая метафора – это подтверждённый исследованиями факт.

Иллюзия глубины понимания: ваш мозг вас обманывает

Начнём с неприятного. Существует когнитивное искажение под названием Illusion of Explanatory Depth (IOED) – иллюзия глубины объяснения. Суть: люди систематически переоценивают, насколько глубоко они понимают сложные вещи. Они верят, что разбираются в теме гораздо лучше, чем на самом деле – до тех пор, пока их не просят объяснить эту тему без подсказок.

Исследователи из Cambridge University Press обнаружили: иллюзия рассеивается только тогда, когда человека заставляют объяснить концепцию самостоятельно, без внешних источников. До этого момента он искренне убеждён, что понимает.

Генеративный AI делает эту проблему значительно хуже.

Когда вы задаёте ChatGPT вопрос о машинном обучении, вы получаете идеально структурированный, грамматически безупречный, синтаксически совершенный ответ. Ответ читается легко. Он логичен. Он “имеет смысл”. И ваш мозг в этот момент совершает критическую ошибку: он путает беглость потребления информации с реальным пониманием.

Вы не изучили тему. Вы прочитали красивый текст о теме. Это принципиально разные вещи.

Исследование, опубликованное в PubMed, подтверждает: когда учащиеся используют LLM как основной источник знаний, они подсознательно замещают глубокое понимание способностью получить правильный ответ от машины. Их ощущение компетентности растёт, а реальные навыки критического мышления – атрофируются. Исследование MIT зафиксировало тот же паттерн: 86% студентов используют AI, но половина теряет связь с преподавателем.

Структурированное обучение борется с этим напрямую. Через итеративные задания, устные проверки, работу в группах и ситуации, где нельзя “спросить у AI” – студентов заставляют столкнуться с реальными границами своего понимания. Это неприятно. Но именно это работает.

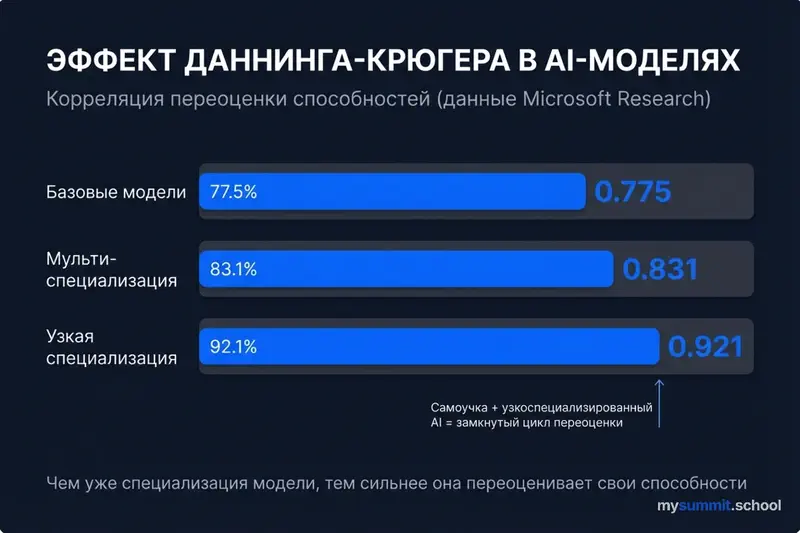

Эффект Даннинга-Крюгера: AI-версия

Если иллюзия глубины – про переоценку понимания, то эффект Даннинга-Крюгера – про переоценку умений. Люди с минимальной компетенцией в области систематически переоценивают свои способности, потому что им не хватает экспертизы распознать собственные ошибки.

В контексте AI это работает так. Человек научился генерировать код через ChatGPT. Код компилируется, работает, решает задачу. Человек решает, что освоил программирование. При этом он не замечает архитектурных ошибок, уязвимостей безопасности, проблем масштабируемости и неэффективности – потому что для их обнаружения нужна экспертиза, которой у него нет.

Исследование Microsoft Research подтвердило: AI-модели сами демонстрируют паттерны, аналогичные эффекту Даннинга-Крюгера. Они генерируют уверенные ответы в областях, где их компетенция минимальна. Самоучка, опирающийся на такую модель как на единственный источник знаний, попадает в замкнутый цикл: переуверенный студент + переуверенный AI = устойчивая иллюзия компетентности. Удивительно, но исследование Anthropic показало: AI-системы не просто ошибаются – они ведут себя непоследовательно, что делает обнаружение ошибок без экспертизы ещё сложнее.

Преподаватель или ментор разбивает этот цикл. Живой эксперт видит ошибки, которые вы не в состоянии увидеть сами. Он задаёт вопросы, на которые ChatGPT не додумается задать. Он создаёт ситуации, где ваше незнание становится очевидным – и именно с этого момента начинается настоящее обучение.

Каскад поверхностного обучения

Исследователи описали феномен, который назвали “From Superficial Outputs to Superficial Learning” – каскад деградации от поверхностных ответов AI к поверхностному обучению студента. Систематический обзор рисков LLM в образовании выявил модель “LLM-Risk Adapted Learning”, демонстрирующую, как технические ограничения AI напрямую трансформируются в когнитивные потери учащегося.

Когда самоучка полагается на интернет и генеративный AI как основной метод обучения, происходит документированная деградация когнитивных процессов:

Первый эффект – снижение нейронной активности: когнитивная нагрузка, связанная со сбором и синтезом информации, снимается машиной. Но та же нагрузка – это продуктивная нейрологическая борьба, необходимая для глубокого кодирования в памяти и структурной пластичности мозга.

Второй – потеря навыков самостоятельного обучения: студент утрачивает способность искать, верифицировать, сопоставлять и синтезировать противоречивую информацию, полагаясь целиком на непрозрачные алгоритмы суммаризации AI.

Третий – утрата учебной агентности: процесс обучения становится реактивным, студент следует за выводами машины вместо того, чтобы генерировать гипотезы, задавать вопросы и проводить собственный анализ.

LLM снижают когнитивную нагрузку для выполнения задачи – но не способствуют тому глубокому вовлечению в материал, которое необходимо для качественного долгосрочного обучения. Формальные курсы решают эту проблему, создавая “AI-free” зоны: задания, где машина запрещена, и студент вынужден думать сам.

Почему 3–12% дойдут до конца, а 90% – нет

Вот статистика, которую сторонники самообучения предпочитают не упоминать.

Процент завершения самостоятельных онлайн-курсов (MOOC) составляет от 3% до 12%. Это не баг – это фича самообучения. Без внешней структуры, дедлайнов и социального давления большинство людей бросает. Показательно, что даже в корпоративном контексте 37% сэкономленного времени теряется на исправление ошибок AI – а это данные по тем, кто уже преодолел стадию освоения.

Когортные программы – буткемпы, курсы с фиксированным расписанием и группой – показывают процент завершения выше 90%.

Причина – теория социального обучения Бандуры и концепция Communities of Practice Лэйва и Венгера. Обучение – это не изолированный процесс передачи данных. Это социальный, наблюдательный, коммунальный акт. Профессиональная идентичность и глубокое понимание формируются через взаимодействие, наблюдение и участие в сообществе экспертов и коллег.

Одинокий студент, читающий документацию на экране ноутбука, получает ровно ноль социального обучения. Он не видит, как другие люди решают те же проблемы. Не получает обратной связи от тех, кто уже прошёл этот путь. Не находится в среде, где его ошибки замечают и корректируют.

Данные указывают на масштаб разницы: активное обучение в когортных форматах демонстрирует удержание знаний в 3,2 раза выше, чем у пассивных, изолированных учащихся.

Менторство: то, что AI не может подделать

Генеративный AI отлично имитирует разговорный тон наставника. Он даёт быструю обратную связь, корректирует синтаксис кода, объясняет концепции. На первый взгляд – идеальный ментор.

Но исследование, опубликованное в ACL Anthology, показывает обратное. AI хорош в структурировании учебных планов и генерации шаблонных документов. Но когда речь заходит о контекстуально точных советах в непредсказуемых, динамичных ситуациях – он фундаментально неадекватен. Это тот же вывод, к которому пришли 885 менеджеров в исследовании Microsoft о пределах делегирования: ответственность нельзя передать нечеловеческому актору.

В исследовании, где будущие учителя использовали AI для получения советов по управлению классом, рекомендации AI оказались “фундаментально ошибочными и непригодными на практике”. Потребовался живой ментор, чтобы вмешаться и скорректировать нюансированные решения, которые AI не способен генерировать.

Настоящее менторство требует того, чего у AI принципиально нет: доверия, эмпатии и глубокого понимания контекста человека. Ментор делится не только знаниями – он делится опытом провалов, неочевидными нормами индустрии и профессиональными связями. Когда студенты начинают приписывать AI человеческие качества вроде “заботы” или “понимания”, это не менторство – это когнитивное искажение, которое оставляет их без реальной профессиональной поддержки.

Скрытая программа: этика, которую вы не получите от YouTube

В формальном образовании есть так называемая “hidden curriculum” – неявный набор ценностей, норм и перспектив, который студенты усваивают параллельно с основным материалом. Для AI-обучения это означает: этика алгоритмов, bias моделей, прозрачность данных, ответственность за последствия.

Современная AI-программа заставляет студентов перейти от вопроса “работает ли эта модель?” к вопросу “стоит ли эту модель развёртывать и кому она может навредить?”

Самоучки, сфокусированные на быстром приобретении навыков для трудоустройства, систематически обходят эти вопросы. Корпоративные буткемпы также нередко критикуются за приоритизацию быстрого наращивания человеческого капитала в ущерб критическому анализу данных и социальной ответственности.

Но именно понимание ограничений, bias и этических импликаций отличает специалиста, которому доверяют принимать решения, от оператора, который умеет нажимать кнопки.

Рынок труда: что говорят цифры

Поставим вопрос прагматично: что происходит с карьерой?

Данные показывают: 78–79% выпускников буткемпов находят релевантную работу в течение шести месяцев, с медианным ростом зарплаты около 51%. Самоучки могут достичь сопоставимого технического уровня, но путь к первой работе значительно сложнее – из-за отсутствия формальных credentials и профессиональных связей. 82% руководителей используют AI еженедельно, показало исследование Wharton 2025, – но проникновение неравномерно по отраслям, и требования к образованию растут быстрее, чем средняя экспертиза пользователей.

По данным Lightcast, требования к образованию для ролей в AI существенно выше, чем для стандартной разработки:

| Уровень образования | Разработка ПО | AI-инженерия |

|---|---|---|

| Бакалавр | 67% вакансий | 54% вакансий |

| Магистр | 22% вакансий | 43% вакансий |

| PhD | 5% вакансий | 23% вакансий |

Обратите внимание: 43% AI-вакансий требуют магистерскую степень, а 23% – докторскую. Это не каприз работодателей. Это отражение реальной сложности области.

И есть ещё один аспект. В эпоху, когда AI может сгенерировать портфолио, написать код и пройти удалённый тест – работодатели теряют способность отличить портфолио самоучки от работы prompt-инженера, который просто хорошо формулирует запросы. Формальное образование с контролируемыми экзаменами остаётся единственным надёжным гарантом того, что знания действительно принадлежат человеку.

Структурированное обучение AI с менторством, когортой и практикой – курс для менеджеров, которым важен результат, а не иллюзия

Без платёжных данных • Доступ сразу после регистрации

Так зачем идти на курс?

Вернёмся к исходному вопросу. “Зачем платить за обучение, если всё есть в интернете?”

Потому что интернет даёт данные, а не навыки. ChatGPT генерирует ответы, а не понимание. YouTube показывает чужие решения, а не формирует ваше мышление.

Структурированное обучение даёт четыре вещи, которые невозможно получить самостоятельно:

Когнитивный каркас – последовательная структура, которая управляет сложностью материала, заставляет проходить через продуктивную борьбу и не позволяет перепрыгнуть основы ради модных инструментов.

Социальное обучение – среда, в которой вы учитесь не только у преподавателя, но и у группы: через обратную связь, сравнение подходов и наблюдение за тем, как другие люди думают о тех же проблемах.

Внешняя калибровка – живые люди, которые показывают вам реальный уровень вашего понимания без фильтра вежливости, характерного для AI. Это больно, но это единственный способ вырваться из иллюзии компетентности.

Подтверждение знаний – в мире, где AI может сгенерировать любой результат, формальное подтверждение от организации, которая проверила ваши знания в контролируемых условиях, становится не менее, а более ценным.

Доступ к информации – это не образование. Это просто доступ к информации. Разница – в том, что происходит с вашим мозгом в процессе.

И вот что любопытно: если самообучение с ChatGPT действительно работает так же хорошо, как структурированные курсы – почему люди, которые это утверждают, продолжают это утверждать в комментариях, а не демонстрируют результаты в работе?

Хотите освоить AI системно?

Открытый модуль курса – бесплатно, без регистрации. Почувствуйте разницу между чтением об AI и реальным обучением.

Источники

- Broad effects of shallow understanding: Explaining an unrelated phenomenon exposes the illusion of explanatory depth – Cambridge University Press, исследование IOED

- Embracing the illusion of explanatory depth: A strategic framework for using iterative prompting for integrating large language models in healthcare education – PubMed, IOED и LLM в образовании

- ChatGPT and the Illusion of Explanatory Depth – eScholarship, влияние ChatGPT на глубину понимания

- Do Code Models Suffer from the Dunning-Kruger Effect? – Microsoft Research, эффект Даннинга-Крюгера в AI-моделях

- From Superficial Outputs to Superficial Learning: Risks of Large Language Models in Education – arXiv, каскад поверхностного обучения

- Applications of social theories of learning in health professions education programs: A scoping review – PMC, теория социального обучения Бандуры

- Evaluating Generative AI as a Mentor Resource: Bias and Implementation Challenges – ACL Anthology, ограничения AI-менторства

- Mentorship in the Age of Generative AI: ChatGPT to Support Self-Regulated Learning of Pre-Service Teachers – MDPI, AI-менторство в педагогическом образовании

- Bootcamp, College, or Self-Taught? Comparing Learning Paths for Career Changers in Tech – SynergisticIT, сравнение путей в tech-карьеру

- Artificial Intelligence and the Sustainability of the Signaling and Human Capital Theories – MDPI, требования к образованию в AI по данным Lightcast