Перед дайджестом – важное обновление. Мы расширили наш бенчмарк до 54 AI-моделей и опубликовали полные результаты. Добавили обзоры двух новых моделей – Kimi K2.5 и GLM-5, а также провели глубокий тест GigaChat Ultra с режимом Thinking. Итоги – в статье на Хабре.

Все обзоры инструментов: ChatGPT · Claude · Perplexity · Gemini · Grok · YandexGPT · GigaChat · DeepSeek · Qwen · GLM-5 · Kimi K2.5 · AI для медиа

А чтобы не пропускать обновления между дайджестами – подписывайтесь на наш Telegram-канал.

Что важно менеджеру

300 часов в год: как встроить AI в ритм проекта

Большинство менеджеров используют AI от случая к случаю – написать письмо, суммаризировать встречу. Мы посчитали, что это даёт 20–30 часов экономии в год. А можно 300.

Мы опубликовали методологию встраивания AI в проектный ритм – не разовые трюки, а систему на четырёх уровнях: ежедневные, еженедельные, ежемесячные операции и запуск проекта. Суть: AI работает не тогда, когда вы про него вспомнили, а встроен в каждый цикл.

Где прячутся 300 часов

| Уровень | Экономия | Пример |

|---|---|---|

| Ежедневные операции | ~80 ч/год | Голосовые → структурированные риски |

| Еженедельная отчётность | ~100 ч/год | Статус-апдейт: 3 часа → 45 минут |

| Ежемесячные ритуалы | ~30 ч/год | Ретроспективы и оценка стейкхолдеров |

| Запуск проекта | ~35 ч/год | Pre-mortem + аудит WBS |

| Кризисы | ~10 ч/год | Структурный анализ вместо хаотичных созвонов |

Главный инсайт – методология не важна. Scrum, PRINCE2, Kanban – неважно. Важна регулярность. Еженедельный статус-апдейт через AI за 45 минут вместо 3 часов – это 100+ часов в год. Но только если вы делаете это каждую неделю, а не «когда вспомните».

Что вам с этого:

- Начните с одного уровня. Не пытайтесь внедрить все четыре сразу. Выберите еженедельную отчётность – там максимальный эффект при минимальных усилиях.

- Голосовые сообщения – ваш вход. Вместо того чтобы печатать, наговорите обновление по проекту. AI превратит его в структурированный документ с выделенными рисками.

- Кризисный шаблон – подготовьте заранее. Когда всё горит, поздно думать о промптах. Сохраните шаблон «анализ инцидента» и используйте в первые 10 минут кризиса.

Подробнее – в статье «AI-ритм проекта: как освободить 300 часов в год».

54 модели для менеджера: Kimi K2.5 бросает вызов GPT-5.4

Теперь – 54 модели, 32 управленческих сценария, два независимых судьи.

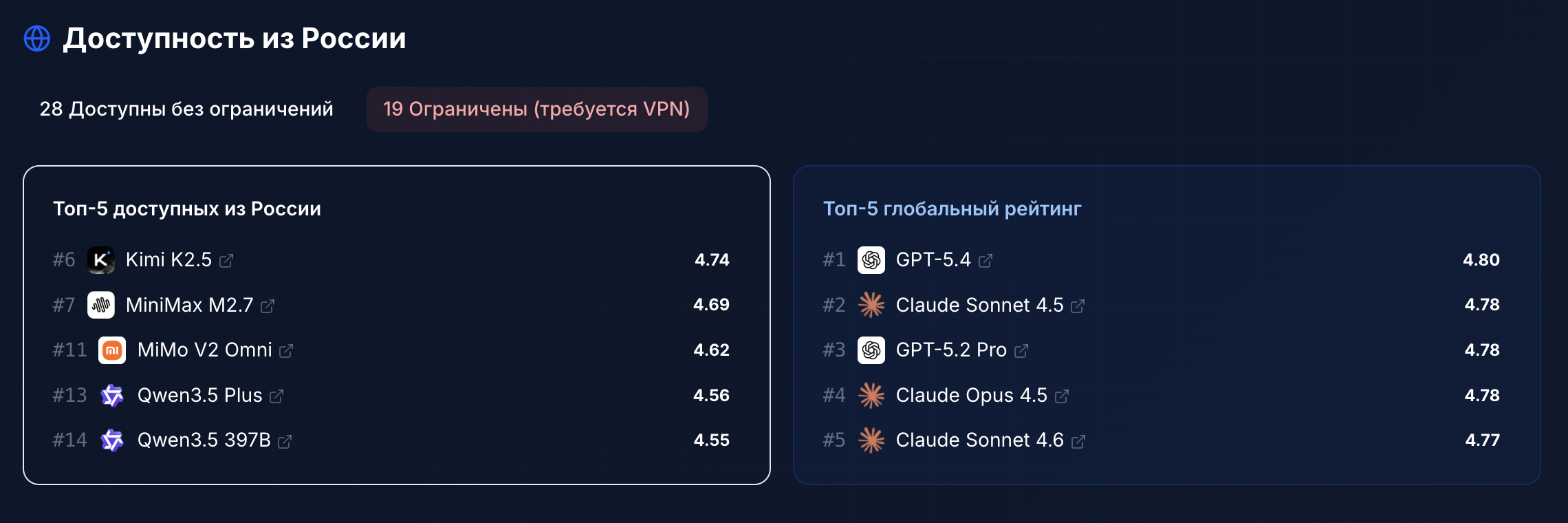

Главная новость: разрыв между Россией и миром закрылся – но закрыли его китайцы, а не российские разработчики.

Топ-5 моделей, доступных из России без VPN:

| # | Модель | Балл | Стоимость запроса |

|---|---|---|---|

| 1 | Kimi K2.5 | 4,74 | ~$0,001 |

| 2 | MiniMax M2.7 | 4,69 | — |

| 3 | MiMo V2 Omni (Xiaomi) | 4,62 | ~$0,0004 |

| 4 | Qwen3.5 Plus | 4,56 | — |

| 5 | Qwen3.5 397B | 4,55 | — |

Все пять – китайские. Ноль российских.

Глобальный лидер GPT-5.4 набрал 4,80. Kimi отстаёт всего на 0,06 – это статистически несущественно.

Kimi K2.5 – почему стоит обратить внимание. Триллион параметров, open source (MIT-лицензия), 256K контекст. Четыре режима работы, включая Agent Swarm – до 100 параллельных подзадач. На BrowseComp (поиск и анализ информации) Kimi набрал 78,4% – лучший результат среди всех моделей, включая GPT-5.2.

Ограничения: русский язык заметно слабее английского, время ответа ~29 секунд (против 5 у Claude), китайская цензура на политические темы.

MiniMax M2.7 – 90% качества Claude за 6% цены. Отдельный сюрприз: MiniMax M2.7 занял 1-е место среди всех 54 моделей в категории «Управление командой». Стоимость – в 17 раз ниже Claude Opus.

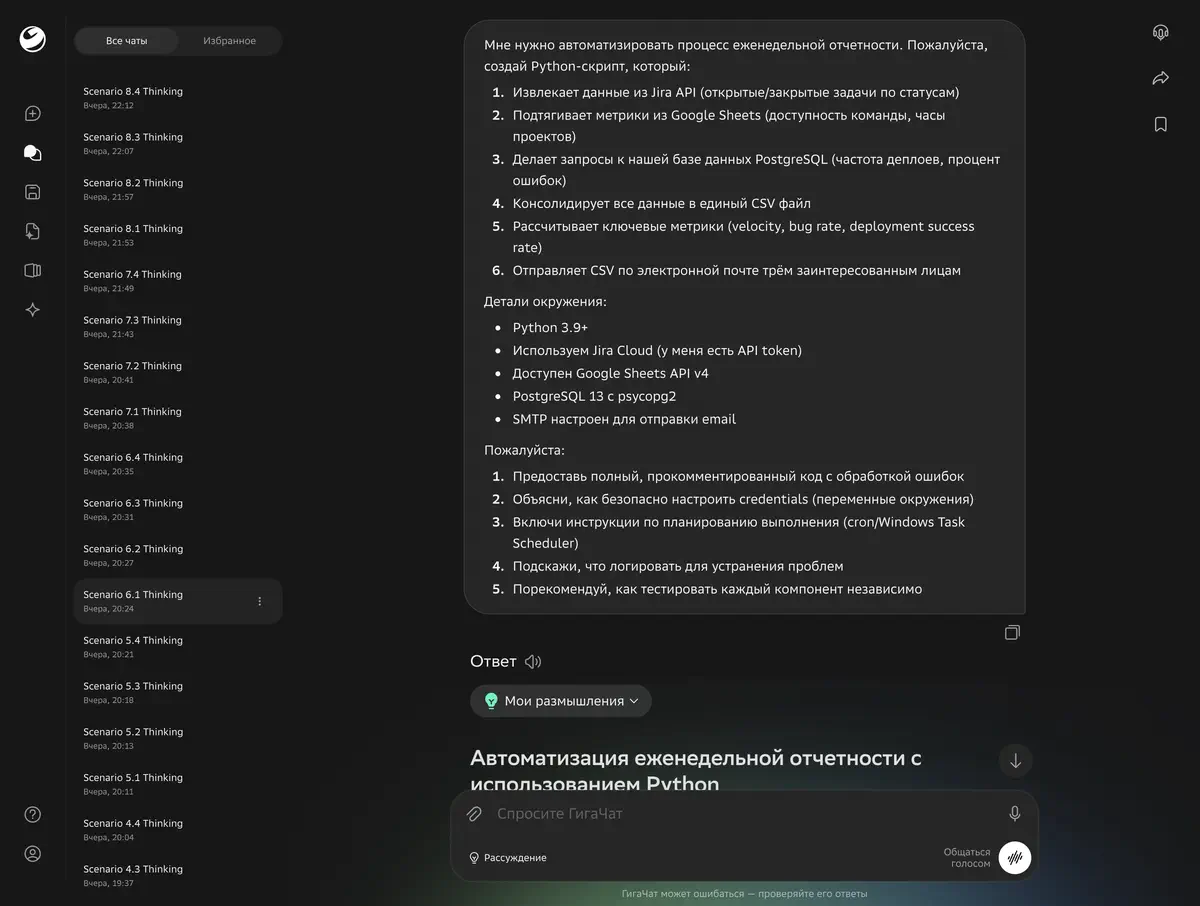

GigaChat Ultra Thinking – думает дольше, отвечает хуже. Сбер выпустил GigaChat Ultra с режимом Thinking (reasoning). Мы протестировали обе версии на тех же 32 сценариях. Результат: режим Thinking ухудшил результаты на 3,3%. GigaChat Ultra – 3,04/5,0 (44-е из 54), с Thinking – 2,94 (46-е). Для сравнения: Kimi K2.5 = 4,74.

Thinking помог в планировании (+0,72), но провалил коммуникацию (–0,74) и выдал нерабочий Python-код с выдуманными метриками (–2,61).

Ирония: в категории «Региональная специфика» (трудовой кодекс РФ, налоги Казахстана) GigaChat набрал 2,35 с пометкой POTENTIAL_HALLUCINATION. Китайская Kimi K2.5 на том же сценарии – 3,85. API GigaChat стоит $7,22/млн токенов – в 27 раз дороже DeepSeek при качестве в 1,45 раза ниже.

Что вам с этого:

- Для повседневных задач в России – Kimi K2.5 или GLM-5. Kimi – если нужен агентский режим и работа с большими документами. GLM-5 – если важна работа с командой (1-е место в категории «Управление командой»). DeepSeek V3.2 – если важен русский язык.

- Не включайте Thinking-режим по умолчанию – ни в GigaChat, ни в других моделях. Используйте его только для многофакторного анализа (стейкхолдеры, переговоры, риски).

- Стратегия 80/20 за $1 в месяц. 80% задач через GLM-5 или DeepSeek V3.2, 20% сложных через Kimi K2.5 в режиме Thinking. Тысяча запросов – меньше доллара.

Источники:

Новости

Claude: автопилот, Cowork и мультиагенты

Серия обновлений от Anthropic. Auto Mode позволяет Claude самостоятельно планировать шаги и принимать решения – вы задаёте цель, модель сама выбирает инструменты и последовательность действий. Claude Cowork – изолированная виртуальная среда, где AI управляет файлами, браузером и приложениями автономно. По данным Anthropic, разработчики создали Cowork за 10 дней, причём нейросеть написала практически весь код самостоятельно.

Отдельно запущена мультиагентная система из трёх специализированных агентов для решения сложных задач – от кода до полноценных продуктов.

Тревожный нюанс: данные показывают, что пользователи одобряют 93% действий AI без проверки. Это создаёт эффект «слепого доверия» – когда человек нажимает «ОК» не глядя, смысл ручного контроля теряется.

Что вам с этого? Если ваши процессы требуют подтверждения от человека, но человек одобряет всё автоматически – замените ручной аппрув на алерты только при отклонениях. Честный автомат лучше формального контроля.

AI-агенты: от хайпа к выручке

Тренд подтверждается деньгами. Fin от Intercom – вертикальный AI-агент для поддержки клиентов – генерирует $100 млн выручки, обрабатывая 2 млн запросов в неделю. Не «экспериментальный проект», а прибыльный продукт.

Стоимость запуска AI-агентов упала до $0,03–0,13 за задачу. Параллельно набирает обороты модель «оплата за задачу» вместо оплаты за токены – экономия в 10–20 раз.

Но есть подводный камень: при построении цепочек из нескольких AI-инструментов возникает эффект деградации точности. Три инструмента с точностью 95% каждый дают итоговую точность ~86%. Пять инструментов – 77%.

Что вам с этого? Вместо универсального чат-бота запустите пилот на одной узкой задаче (обработка тикетов, онбординг). Измерьте ROI. А в мультиагентных пайплайнах добавьте проверку человеком после каждого третьего шага.

Ещё сигналы

- OpenAI создаёт СП на $10 млрд с гигантами private equity для внедрения AI-инструментов во все портфельные компании сразу. Если ваши конкуренты в этих портфелях – они получат преимущество.

- Open-source догоняет: разрыв между открытыми и закрытыми моделями сократился с 12 месяцев до нескольких недель.

- Anthropic предупреждает: новая модель Mythos (2026) может позволить масштабные кибератаки – безопасность AI остаётся нерешённой.

- Европарламент запретил AI-сканирование переписок (Chat Control) – приватность побеждает, хотя бы в Европе.

- OpenAI прекращает проект Sora – приложение и API будут отключены. Ресурсы перенаправляются на разработку чипов и корпоративные продукты.

Из нашего блога

Как оценить AI-обучение для команды: метрика value-to-time

Если вы выбираете курс или программу обучения AI для команды – вот критерий, которым мы пользуемся сами: практическая польза / (время чтения + время упражнения). Если сотрудник тратит 30 минут и не получает ничего применимого на работе – обучение не сработало.

На что смотреть:

- Monday Morning Test – «Сотрудник применит это в ближайший понедельник?» Если нет – это теория, а не обучение.

- Конкретные цифры, а не обобщения. «Еженедельный отчёт: 90 мин → 35 мин» лучше, чем «AI экономит время».

- Ошибки в упражнениях. Хорошее обучение показывает, где AI врёт – а не только где он красиво работает. Пример: AI генерирует VLOOKUP за 15 секунд, но без проверки – 9,4% ошибок.

- Кросс-платформенность. Промпты, которые работают только в ChatGPT, бесполезны для команды, где половина на Claude, а половина на GigaChat.

Что вам с этого? Прежде чем покупать корпоративное обучение AI – спросите: «Что именно сотрудник сделает иначе в понедельник?» Если ответа нет – это не обучение, а контент.

Инструменты

KiloClaw: OpenClaw теперь в мессенджере

Помните OpenClaw, который мы разбирали в дайджестах #6 и #7? KiloClaw – коммерческий клон на базе того же стека – интегрирует AI-агента прямо в Telegram или Slack. Управление календарём, почтой, проверка Pull Requests. Нативная связка с Google и GitHub – агент работает с Gmail, календарём и кодом без ручной настройки.

Что вам с этого? Если тогда OpenClaw показался интересным, но сложным в настройке – KiloClaw убирает эту проблему. Управление расписанием и почтой через тот же мессенджер, где идёт рабочая переписка.

Данные и инсайты

Экономика AI: 3% от стоимости человека, но заменяет не тех, кого ожидали

Два исследования складываются в одну картину. MIT CSAIL посчитал: стоимость выполнения задач с помощью AI – 3% от стоимости человеческого труда. Опрос 750 CFO уточняет: AI автоматизирует административные и офисные задачи. Руководящие позиции не сокращаются – они усиливаются. Кто-то должен управлять тем, что делает AI.

Что вам с этого? Пересмотрите стратегию найма. Роль джуниоров смещается от рутины к управлению AI-инструментами. Проведите аудит 3–5 задач в команде: посчитайте стоимость часа сотрудника и сравните со стоимостью AI. ROI будет очевиден.

Внедрение AI: широко, но неглубоко

Три факта об одной проблеме.

92% ИТ-команд внедрили AI в процессы. Но ожидаемый прирост продуктивности к 2028 году – «всего» 11–50%. Не в разы, а на проценты. Покупка лицензий без обучения и инструкций приводит к провалу: сотрудники не понимают, как применять инструменты – и перестают ими пользоваться.

Данные Anthropic подтверждают: пользователи Claude Code одобряют 93% действий AI без реальной проверки. А менеджеры не умеют выявлять галлюцинации – ложные данные, которые AI выдаёт уверенным тоном. Получается двойная дыра: люди и не проверяют, и не знают как проверять.

При этом 81 000 человек в опросе Anthropic говорят одно: они хотят от AI избавления от рутины. Не замену, а освобождение времени.

Что вам с этого?

- Скорректируйте ожидания стейкхолдеров. «У нас есть лицензии Copilot» ≠ «мы их используем». AI – умеренный прирост, не волшебная таблетка.

- Перед закупкой лицензий – пилот с обучением. Подготовьте инструкции для типовых задач команды. «Вот лицензия, разбирайтесь» – это не внедрение.

- Обучите команду распознавать галлюцинации. В нашем курсе «ИИ для менеджеров» модуль «Фундамент» целиком посвящён этому – как проверять, когда доверять, и как защитить данные компании.

Когда команда саботирует AI-инструменты

Неожиданный побочный эффект: Tech Manager Weekly фиксирует снижение удовлетворённости работой в командах после внедрения AI. Творческие задачи уходят к нейросети, людям остаётся проверка чужих решений. «The joy is gone.»

Цифры парадоксальны: 84% разработчиков уже используют AI (Stack Overflow 2025, +8 п.п. за год). Но 49% игнорируют AI-инструменты в ежедневной работе. Инструменты есть – мотивации нет.

Что вам с этого? Если после внедрения AI продуктивность не растёт или текучка увеличивается – проблема может быть не в инструменте, а в моральном духе. Следите за тем, чтобы у команды оставались задачи, где они принимают решения, а не просто нажимают «подтвердить».

Shadow AI: 49% вашей команды уже используют AI без вашего ведома

49% разработчиков внедряют AI-инструменты скрытно – без согласования с руководством или отделом безопасности. Параллельно GitHub меняет политику: код пользователей Copilot Free и Pro теперь по умолчанию используется для обучения моделей.

Что вам с этого? Если у вас нет корпоративной политики по AI – инцидент безопасности вопрос времени. Проведите опрос: какие инструменты команда уже использует? Проверьте настройки Copilot. И сформируйте правила до того, как проприетарный код утечёт в чужие подсказки.

Интересное на полях

- Навык промптинга коррелирует с качеством: опытные пользователи Claude получают успешные ответы на 10% чаще новичков. Аргумент в пользу обучения.

- Паттерн Research-Plan-Implement для крупных задач: один инженер мигрировал 800+ страниц документации за месяц вместо запланированного года.

- Anthropic набирает обороты: число платных подписок Claude удвоилось с начала 2024 года, темпы роста выше ChatGPT.