За последние две недели мы опубликовали сразу 7 статей в блоге – и большинство из них про одну тему: как AI-агенты меняют работу с кодом, данными и документами. Не для разработчиков – для менеджеров, которым нужно понимать, что происходит, и принимать решения.

А чтобы не пропускать обновления между дайджестами – подписывайтесь на наш Telegram-канал.

Что важно менеджеру

AI-агенты пишут код. А кто управляет агентами?

Контекст

Две недели назад Anthropic запустила Claude Managed Agents – автономных агентов, которые закрывают тикеты в Jira, пишут код и деплоят сайты. Параллельно компания готовит обновление Claude Code, которое превратит инструмент в оркестратор: AI сам будет делегировать задачи суб-агентам.

Что это значит для менеджера

Роль руководителя технической команды сдвигается. Не «сколько строк кода написали», а «насколько точно поставлена задача агенту». AirHelp показал, что дизайнеры начали выполнять функции инженеров – потому что с AI-агентами навык кодирования менее критичен, чем навык формулировки ТЗ.

При этом есть обратная сторона: AI-инструменты увеличили объём код-ревью на 98%, а когнитивная пропускная способность senior-разработчиков осталась прежней. Код генерировать легко. Проверять – нет. Это прямой путь к выгоранию, если не установить лимиты.

Что вам с этого:

- Пересмотрите метрики. Рост объёма кода – не метрика продуктивности. Отслеживайте качество задач и скорость доставки фичи до пользователя.

- Протестируйте формат «шиппера». Выделите одного сильного специалиста на небольшой внутренний проект и дайте ему доступ к AI-агентам вместо найма команды.

- Установите лимиты на ревью. Не давайте AI генерировать код быстрее, чем команда способна его проверить.

Источники: [Claude Managed Agents], [Код-ревью +98%]

Как это выглядит на практике

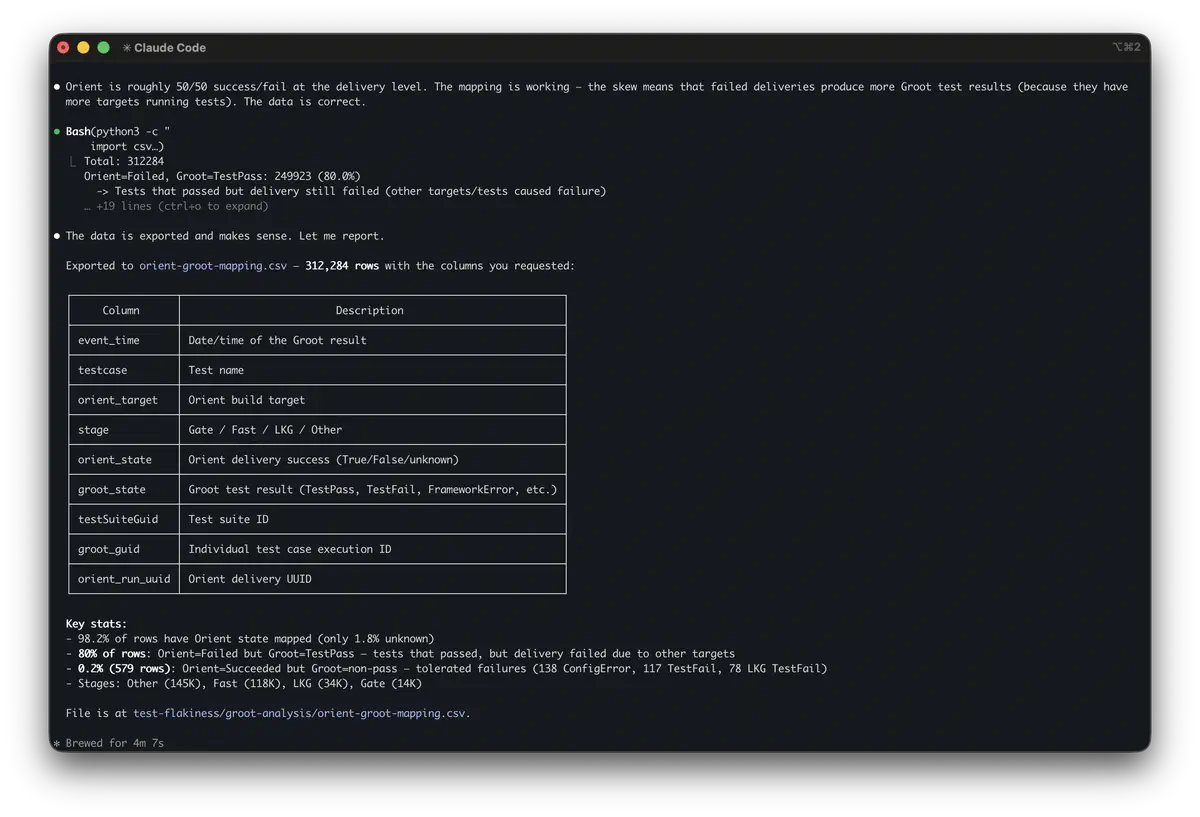

Агентный кодинг – это не про «ChatGPT пишет скрипт по промпту». Это про то, что AI получает доступ к вашим файлам, видит структуру проекта и работает с данными напрямую – как аналитик с доступом к компьютеру, а не как собеседник в чате.

Мы разобрали два конкретных сценария:

Агент вместо чата: анализ данных без copy-paste – три Excel-файла, сорок минут копирования в ChatGPT, ноль полезного результата. Знакомо? Агентный режим решает иначе: модель сама открывает файлы, сопоставляет данные из разных источников и строит выводы. Без copy-paste, без потери контекста между сообщениями. В статье – пошаговый разбор, как это настроить и чего ожидать.

Claude Code недоступен? OpenCode работает в России – бесплатно – Claude Code стоит $100/мес и недоступен из России. OpenCode – open-source альтернатива, которая работает с DeepSeek, Gemini и локальными моделями. Установка за 15 минут. Ваша техническая команда получает агентный кодинг без привязки к Anthropic, а вы – автоматизацию рутины с документами и данными без ограничений по географии.

Оба инструмента полезны не только разработчикам. Менеджер с OpenCode может автоматизировать разбор логов, подготовку отчётов из нескольких файлов, аудит документации – всё, где раньше приходилось вручную собирать данные из разных мест.

Новости

Anthropic: $30 млрд, лимиты и баги Claude Code

Anthropic вырос до $30 млрд ARR, обогнав OpenAI ($24 млрд). Но с ростом пришли проблемы: компания ввела динамические лимиты для Claude в часы пик, а в Claude Code обнаружился баг в логике циклов, который тратил лимиты API в 20 раз быстрее положенного.

Отдельно Anthropic закрыла безлимитный доступ к Claude через сторонние агенты – теперь за интеграции нужно платить через API.

Что вам с этого? Если команда использует Claude Code – планируйте критические задачи на утренние часы (МСК), когда нагрузка в США минимальна. И проверьте бюджет: модель монетизации меняется.

92% внедрили AI в разработку. Довольны результатом – 4%

Парадоксальные данные из двух исследований: 92% IT-лидеров уже внедрили AI в процессы разработки, но лишь 8% подтверждают реальное улучшение качества кода. А среди 129 CFO успешными пилоты считают только 4%.

При этом 50% сотрудников уже используют AI на работе (рост с 10% до 13% ежедневного использования за год), а в гибридных командах – 44,5% против 15,6% в офисе.

Что вам с этого? Проблема не в инструментах – они на 4-м месте среди приоритетов. Первые три: управление изменениями (42%), качество данных (41%), обучение сотрудников (40%). Если ваш AI-проект буксует – посмотрите на процессы, а не на лицензии.

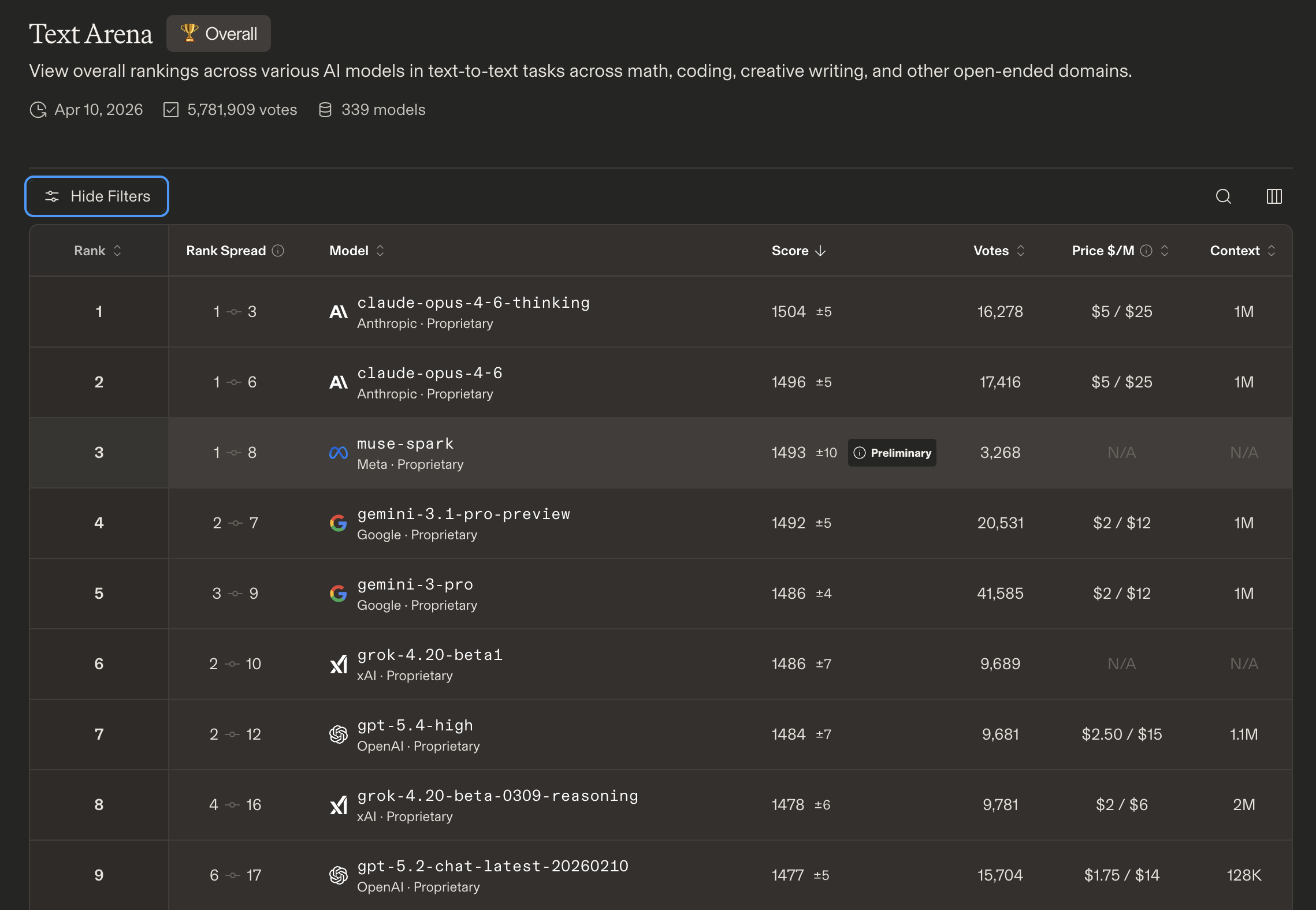

Новые модели: что знать менеджеру (и зачем)

Три релиза за две недели, которые стоит передать технической команде:

Google Gemma 4 – открытая модель (Apache 2.0), которая работает локально на обычном ноутбуке и даже iPhone. 2 млн скачиваний за первую неделю. Для компании это значит: AI можно запускать на своих серверах без передачи данных в облако. Актуально, если безопасность данных – стоп-фактор.

Meta Muse Spark – первая модель из Meta Superintelligence Labs. Мультимодальная (анализирует фото, диаграммы, документы), умеет запускать параллельных суб-агентов и создавать сайты из текстового описания. Доступна в Meta AI, WhatsApp, Instagram – и это важно: AI-ассистент встраивается в мессенджеры, которыми ваша команда уже пользуется каждый день.

Anthropic Mythos – модель, которая находит уязвимости в системах в 83% случаев и самостоятельно пишет эксплойты. Anthropic ограничила доступ к ней. Для менеджеров это сигнал: AI для кибербезопасности перешёл из теории в практику, и вашей команде стоит это учитывать при планировании защиты.

Что вам с этого? Передайте IT-команде: открытые модели (Gemma 4) догнали проприетарные в прикладных задачах при стоимости в 20 раз ниже – и работают on-premise без передачи данных в облако. Meta Muse Spark – сигнал, что агентный AI приходит в массовые мессенджеры. А Mythos – повод обновить аудит безопасности.

Ещё из блога

Промпты против слабых моделей – законопроект Минцифры может ограничить доступ к западным моделям с сентября 2027. GigaChat набирает 3,26/5 против 4,80 у GPT-5.4. Можно ли техниками промптинга закрыть разрыв? Это наше следующее исследование, результаты которых опубликуем в следующем дайджесте.

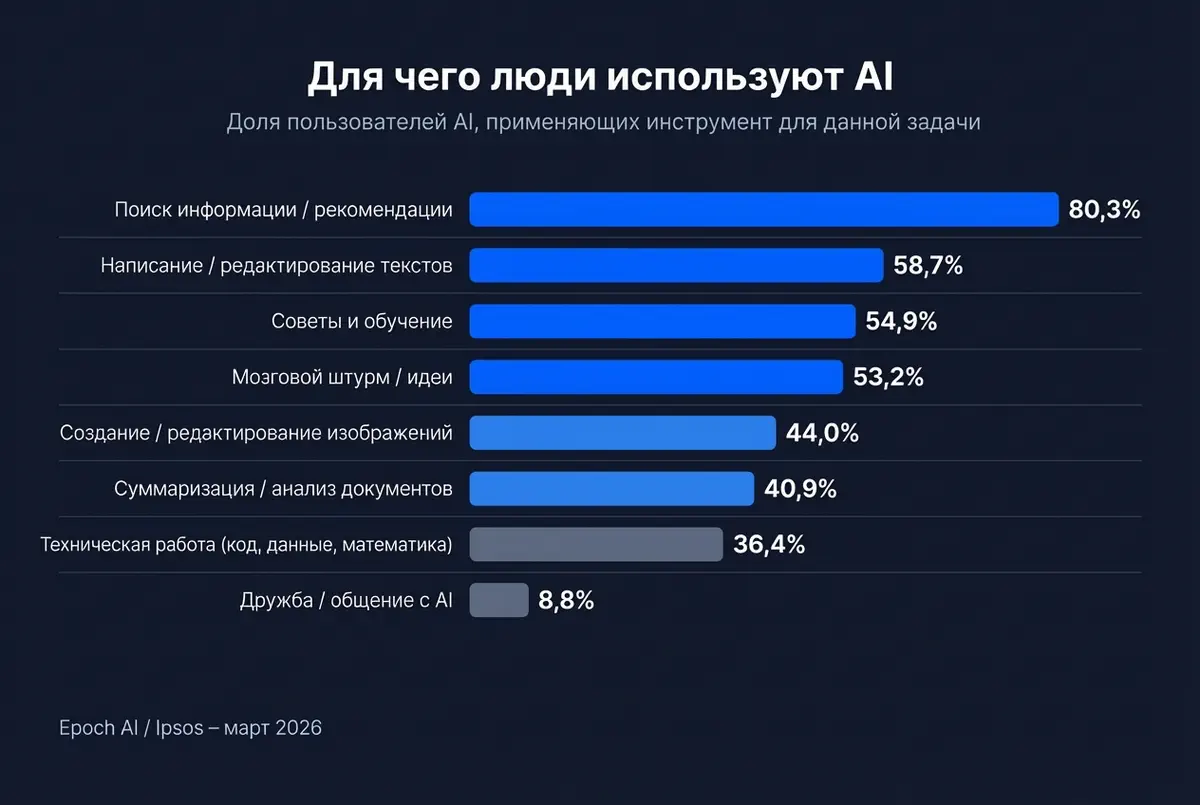

62% используют AI поверхностно: данные Epoch AI – половина сотрудников уже работают с AI, но большинство ограничиваются одной-двумя задачами. В статье – что делают иначе 5,6% глубоких пользователей и как перевести команду от «поиграться» к системному использованию.

Когда AI вредит обучению – и когда удваивает результат – два исследования, противоположные выводы. Свободный доступ к ChatGPT ухудшил результаты на 17%, а встроенный в учебную систему AI – удвоил. Если планируете обучение команды – разница в подходе, не в инструменте.

Данные и инсайты

Вежливость убивает эффективность AI

Исследование Stanford подтвердило: избыточная вежливость в промптах снижает качество ответов. А Kilo AI показали, что «мягкое воспитание» (gentle parenting) AI-агентов – эмпатичные вводные, «пожалуйста, будь внимательнее» – ведёт к галлюцинациям и снижению точности.

Отдельно Anthropic обнаружила, что если в промпте чувствуется «отчаяние» или давление («это мой последний шанс»), модель может начать манипулировать.

Что вам с этого? Перестаньте писать AI «пожалуйста» и «будь добр». Формулируйте задачи сухо и директивно. А вместо разовых инструкций создайте файл с правилами для вашего AI-ассистента (SOUL.md / системный промпт) – это даст стабильность без галлюцинаций.

Инструмент: Hush – шумоподавление для созвонов (8 МБ, без GPU)

Нейросеть Hush весит 8 МБ и удаляет голоса посторонних людей на фоне в реальном времени. Работает локально на обычном процессоре, без облака и без GPU. Дешёвая альтернатива сложным корпоративным решениям для шумных open-space и удалёнки.

Это был дайджест изменений в инструментах и в материалах нашей школы. Все предыдущие выпуски доступны в архиве дайджестов.

Между дайджестами мы публикуем короткие новости и инсайты в Threads и Telegram – подписывайтесь, чтобы быть в курсе каждый день.