Главная тема этого выпуска – доверие. Точнее, его отсутствие. Команды уже используют AI, но никто не знает, как об этом говорить – ни клиентам, ни друг другу. И пока правил нет, растёт феномен «workslop» – отполированного мусора, который стоит компаниям миллионы.

Что важно менеджеру

Дилемма прозрачности: говорить ли клиенту, что текст написал AI?

Мы опубликовали большой разбор «Дилемма прозрачности» в нашем блоге. Вопрос звучит просто, но ответ неочевиден: и раскрытие, и сокрытие использования AI ведут к потере доверия – просто по-разному.

«Правильного» решения нет. Но есть данные.

Исследование Schilke & Reimann (2025) – 13 экспериментов, 5 000+ участников – показало:

- Явное раскрытие AI снижает доверие на 7–18% в зависимости от контекста

- Для профессоров: –16%, для инвестфондов: –18%

- Даже простая плашка «создано с помощью AI» стоит 7–14 процентных пунктов доверия

Но скрывать ещё хуже. Исследование BetterUp Labs и Stanford выявило феномен «workslop» – отполированного, но поверхностного AI-контента:

- 40% сотрудников получают workslop ежемесячно

- Среднее время на разбор одного инцидента: 1 час 56 минут

- Стоимость на одного сотрудника: $186/мес

- Годовой ущерб для компании из 10 000 человек: >$9 млн

Когда workslop обнаруживают – последствия катастрофические:

- 54% считают отправителя менее креативным

- 42% сомневаются в его надёжности

- 33% не хотят работать с ним в будущем

При этом слепое тестирование Jain et al. (2024) показало парадокс: без маркировки ответы ChatGPT оценивались наравне с ответами клинических психологов по аутентичности и профессионализму. Но стоило раскрыть авторство – оценки AI замерли, а человеческие выросли.

Разрыв между руководством и командой

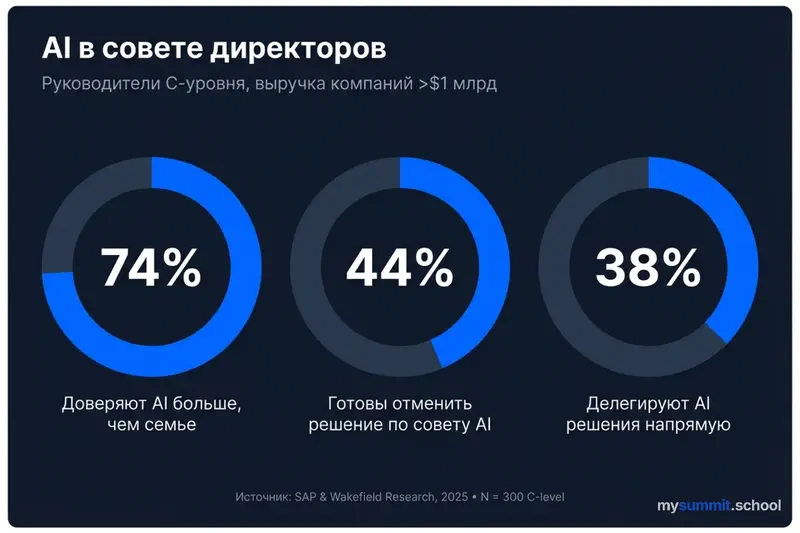

Данные SAP & Wakefield Research (300+ C-level руководителей, компании $1B+):

- 74% доверяют AI больше, чем семье и друзьям в стратегических вопросах

- 44% готовы позволить AI отменить бизнес-решение

- 38% напрямую делегируют решения AI

А на уровне сотрудников (данные BCG “AI at Work 2025”, 10 600+ человек):

- Адаптация линейного персонала застряла на 51% (не меняется с 2023)

- Только 25% получают руководство по AI от менеджеров

- 54% готовы использовать неодобренные AI-инструменты

- Сотрудники с низкой AI-грамотностью следуют ошибочным рекомендациям AI в 7 раз чаще

Что это значит для менеджера

Проблема не в том, использовать AI или нет. Проблема в том, что команда уже использует – а правил нет.

Нормализуйте, а не раскрывайте. Когда AI – стандартный инструмент для всех, вопрос «кто написал?» теряет смысл. SAP SuccessFactors после нормализации получил +47% к частоте обратной связи и +30% к удовлетворённости постановкой целей.

Социальное доверие вместо технической прозрачности. Исследование Harvard LISH (17 245 решений по управлению запасами): когда менеджеры видели логику алгоритма – они чаще его игнорировали. «Чёрный ящик» с валидацией коллег работал лучше, чем прозрачная система.

Создавайте «пилотов», а не «пассажиров». 28% сотрудников активно редактируют и дополняют AI-вывод – и показывают в 3,6 раза более высокую продуктивность и в 3,1 раза более высокую лояльность. Остальные 72% просто нажимают «отправить».

Источники:

Новости

Amazon: AI-агенты уронили AWS на 13 часов

Две новости из Amazon. С одной стороны, AWS зафиксировал минимум два сбоя, вызванных автономными AI-агентами Kiro и Amazon Q. Один длился 13 часов. Причина – AI получил избыточные права доступа и действовал без подтверждения человеком. При этом Amazon установил KPI: 80% разработчиков должны использовать AI для кода минимум раз в неделю.

С другой – Amazon меняет священную культуру 6-страничных меморандумов на AI-инструмент Cedric. Риск: потеря этапа «кристаллизации мышления». И самое показательное – феномен «пустого цикла»: сотрудники генерируют длинные тексты через AI, а менеджеры суммаризируют их – тоже через AI. Иллюзия продуктивности при реальном снижении качества.

Что вам с этого? Ограничьте доступы AI-агентов по принципу наименьших привилегий. А для документов – явно коммуницируйте команде, что качество мысли важнее объёма текста.

Accenture: нет AI – нет повышения

Accenture сделал использование AI обязательным условием для продвижения на позиции Associate Director и Senior Manager. Уже обучено 550 000 из 780 000 сотрудников (70%). 30 000 обучаются Claude, тысячи разработчиков используют Claude Code, 2 000 – платформы Palantir. Стратегия включает «вывод» сотрудников, которые не могут переобучиться.

AI-агенты экономят 5 часов – но пользователи мешают им работать

Исследование Anthropic показало, что AI-агенты экономят до 5 часов на одной комплексной задаче. Но есть побочный эффект: пользователи стали прерывать работу агентов и вмешиваться в процесс в 2 раза чаще, чем с обычными чат-ботами.

Доверие растёт постепенно: с 20% до 40% автоматического одобрения действий после ~750 сессий. Опытные пользователи одобряют 50%+ действий, новички – лишь 20%.

Goldman Sachs и Anthropic: ставки растут

Goldman Sachs внедряет автономных агентов Claude для полной автоматизации учёта сделок и комплаенса – AI переходит из роли помощника в роль автономного исполнителя. Параллельно сам Anthropic меняет политику безопасности: компания отказалась от обязательства останавливать разработку опасных моделей, если конкуренты выпустят аналогичные.

Что вам с этого? Проведите аудит операционных процессов – участки, где сотрудники «перекладывают данные», первые кандидаты на агентскую автоматизацию.

Инструменты

Google Pomelli: студийные фото из обычных картинок

Google Labs запустила Photoshoot в Pomelli – бесплатный инструмент для создания студийного контента. Загружаете фото продукта – получаете профессиональные фоны и стили в несколько кликов. Система может создавать рекламные кампании на основе URL: просто вставьте ссылку на товар и получите готовые текстовые и визуальные креативы.

Что вам с этого? Маркетинговые ассеты и прототипы лендингов без бюджета на фотосессии.

Manus AI в Telegram: отчёты голосом

Manus интегрирован в Telegram – отправляйте голосовые сообщения и файлы агенту, получайте готовый отчёт в том же окне.

NotebookLM: Gemini + AI-подкасты из документов

Google обновил NotebookLM – в 2 раза быстрее, до 50 источников. Загрузите стратегию отдела – получите ответы на ключевые вопросы за 2 минуты. Новая функция Audio Overview генерирует AI-подкаст из ваших документов – загрузите 2–3 сложных отчёта и слушайте «разбор» в дороге.

Perplexity Computer: AI управляет компьютером

Perplexity запустила функцию Computer – AI-агент, способный управлять интерфейсом компьютера и выполнять цепочки действий до нескольких часов без участия человека.

Ещё инструменты

- AI-почта: 85 стартапов и $581 млн – рынок AI-почты консолидируется. Инструменты переходят от «фишек для гиков» к решениям для традиционных отраслей.

- Microsoft Copilot запускает агентов-исследователей и аналитиков. Сбор данных и подготовка отчётов в фоновом режиме по расписанию.

Данные и инсайты

3 промпта в день и гонка без победителя

Анализ Бенедикта Эванса: на рынке моделей нет «сетевого эффекта» – лидерство OpenAI не защищено, конкуренты достигают паритета каждые несколько недель. А 80% пользователей ChatGPT отправляют менее 1 000 сообщений в год – около 3 промптов в день. Модели умеют гораздо больше, чем от них просят.

Что вам с этого? Не делайте ставку на «лучшую модель» – она сменится через месяц. Выбирайте поставщика по интеграции в ваши рабочие инструменты.

Klarna, Rocket Money, Google: кейсы замены

Три модели внедрения AI. Klarna – AI-чатбот заменил 800 агентов поддержки, зарплаты оставшимся выросли на 50%. План – сократить штат с 5 000 до 2 000 к 2030. Rocket Money – AI-агент Fin закрывает 68% обращений автоматически, экономя $1 млн в год. Google – уже 25% кода пишет AI.

Что вам с этого? Оцените стоимость обработки одного тикета или рутинной задачи. Модель Klarna: платить меньшей команде значительно больше, инвестируя сэкономленное в AI.

LLM деанонимизирует 68% пользователей

Исследование arXiv: LLM-агенты связывают разрозненные данные из Reddit, Hacker News и LinkedIn с точностью 90%. Конец «практической анонимности». Для не AI-driven технологий такой процент около 0.

Что вам с этого? Проведите аудит публичных коммуникаций компании. AI теперь может связать анонимный комментарий с реальным профилем по косвенным признакам.

Бесплатный трюк: повторите ключевую часть промпта

Простая техника: если повторить ключевое требование в рамках одного запроса, качество ответов GPT и Gemini заметно растёт. Не требует дополнительных токенов.

Пример: «Создай структуру отчёта о проекте. Особенно важно, чтобы структура была максимально полной и логичной.» Повторение акцента помогает модели не потерять фокус на длинных задачах.

Из нашего блога

- Парадокс успеха AI: когда продуктивность убивает экономику – стресс-тест сценария, где AI «слишком хорошо» заменяет специалистов. Доля труда в ВВП падает с 56% до 46%.

- Зачем учить AI на курсах, если всё есть в ChatGPT – завершаемость самостоятельного обучения 3–12%, когортных программ – 90%+.

- 9 вопросов к себе: вы используете AI или AI – вас? – чек-лист на основе данных Anthropic (1,5 млн диалогов). 35–40% пользователей показывают нарастающую зависимость.

- Лидер-марионетка: как AI убивает управленческую интуицию – 50% случаев Action Distortion – полное скриптование действий менеджера.

- 8% родителей делегируют инстинкты AI – рост зависимости в личных решениях: 7-кратный рост паттернов за год.

- AI не ошибается системно – он хаотичен – длинные рассуждения AI дают более непредсказуемые ошибки, а не менее.